Konfigurere talefunktioner

I denne artikel beskrives de funktioner, der er tilgængelige i Copilot Studio til interaktiv stemmerespons med Dynamics 365 Customer Service.

Hvis du vil gøre din agent klar til taletjenester, skal du se Integrere en stemmeaktiveret agent med Dynamics 365 Customer Service.

Du kan finde en oversigt over taletjenesterne under Brug interaktiv stemmerespons i dine agenter.

Tale- og DTMF-modalitet

En stemmeaktiveret agent adskiller sig fra en chatbaseret agent. Den stemmeaktiverede agent indeholder specifikke talesystememner til håndtering af talescenarier. En chatbaseret agent bruger tekstmodaliteten som standard. En stemmeaktiveret agent bruger modaliteten Tale & DTMF. De to modaliteter er ikke kompatible med hinanden.

Optimer til stemme giver dig mulighed for at oprette stemmeaktiverede agenter på tværs af forskellige modaliteter og sikrer, at talerelaterede funktioner er oprettet korrekt.

Optimer til tale

Hvis du ikke startede din agent med skabelonen Stemme, skal du aktivere indstillingen Optimer til tale i agentens indstillinger.

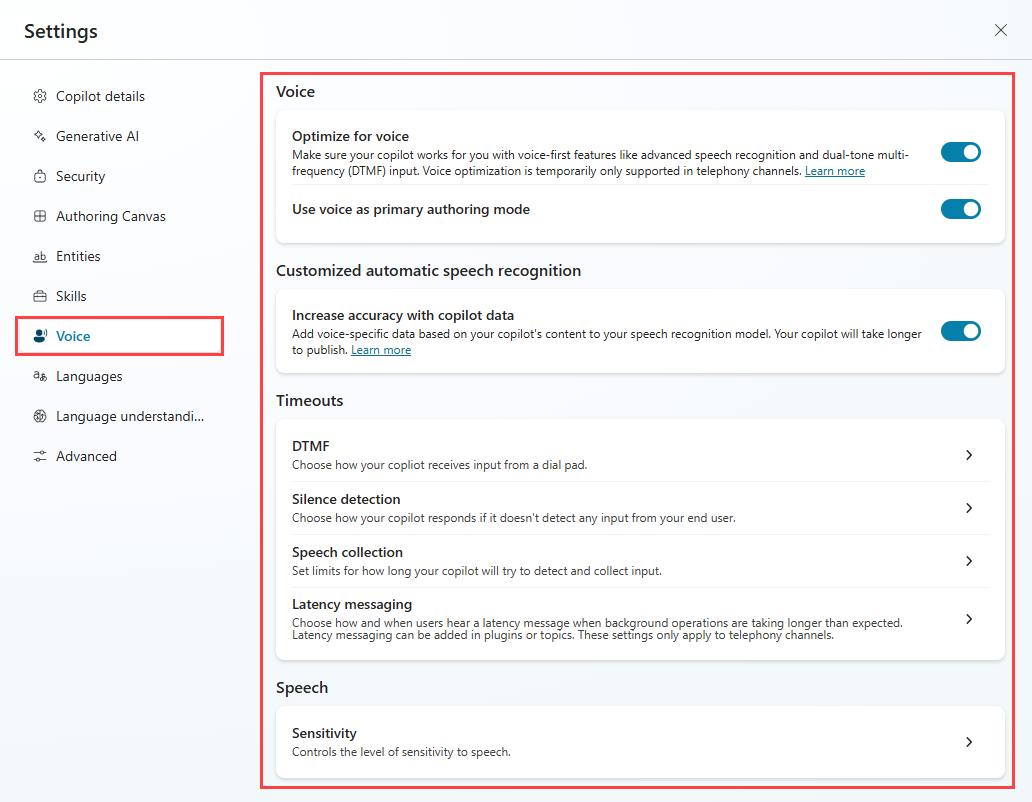

Når en agent er åben, skal du gå til Indstillinger>Stemme.

Vælg Optimere til tale. Indstillingen Brug stemme som primær oprettelsestilstand er også angivet som standard.

Din agent får følgende opdateringer, når du aktiverer indstillingerne Optimer til tale og Brug stemme som primær oprettelsestilstand:

- Muligheden for at skrive stemmefunktioner, når du skifter fra tekst til Tale og DTMF.

- Systememnerne for tale Tavshedsdetektion, Ikke-genkendt tale og Tryk på ukendt numerisk tastatur tilføjes automatisk for at håndtere talerelaterede scenarier.

- Forøg nøjagtigheden med agentdata (aktiveret som standard), hvilket forbedrer nøjagtigheden af talegenkendelsen.

- Der er ingen ændring af det eksisterende agentflow, f.eks. emnet Hovedmenu for at starte samtaler med tilknyttede DTMF-udløsere.

Vigtigt!

- Indstillingen Optimer til tale ændrer kun funktionerne til stemmeoprettelse og ikke kanalindstillingen. Aktivér telefonikanalen for en fuldt stemmeaktiveret agent.

- Hvis du indstiller Optimer til tale på en agent, der ikke oprindeligt er konfigureret til stemmefunktioner, betyder det desuden, at agenten ikke har emnet Hovedmenu (forhåndsversion). Du skal oprette dette emne igen efter behov.

- Hvis du ikke kan aktivere Optimer til tale, skal du kontrollere det Power Platform-miljø, der hoster din agent, og sikre, at Hent nye funktioner tidligt er slået fra for det pågældende miljø. Du kan finde flere oplysninger under Kan ikke aktivere Optimer til tale.

Deaktiver optimering til tale

Du kan deaktivere Optimer til tale i forfatterfunktionen for stemmeaktiverede agenter, hvis du ikke aktiverer Telefoni-kanal. Når du har deaktiveret Optimer til tale, får du følgende ændringer:

- Ingen forfatterfunktion for stemmeagent for funktioner som DTMF og bryd-ind.

- Standardmodaliteten Tekst er angivet.

- Det er ikke sket nogen forbedring af talegenkendelse, da der ikke er talegenkendelse.

- Ingen systememner om stemme eller globale DTMF-emner.

Bemærk

Under publicering rapporterer nogle emner måske fejl, hvis der refereres til det deaktiverede DTMF-emne i andre emner.

- Ingen ændring til dit agentflow og kanalindstilling, da deaktivering af optimering ikke deaktiverer telefonikanalen.

- Aktivering eller deaktivering af indstillingen Optimer til stemme træder først i kraft, når du udgiver din agent. Hvis agenten aktiveres eller deaktiveres ved et uheld og skifter mellem modaliteter, har du tid til at rette det.

Vigtigt!

Hvis dine telefonikanaler er aktiveret, kan deaktivering af Optimer til tale ødelægge din agent, da alle DTMF-udløsere automatisk deaktiveres.

Brug stemme som primær oprettelsestilstand

Modaliteten Tale og DTMF skal vælges for hver node i oprettelse af stemmefunktionen. Du kan vælge agentens forfatterpræference som brug stemme som primær forfattertilstand. Denne indstilling sikrer, at alle inputfelter har den rette modalitet. Hvis du allerede har aktiveret Optimer til tale, aktiveres indstillingen Brug stemme som primær oprettelsestilstand som standard.

Meddelelsestilgængelighed

Brug af tekst- eller talemodaliteten kan påvirke din kanal forskelligt.

| Tekstmodalitet | Talemodalitet | Agenttekst- og talekanal |

|---|---|---|

| Meddelelse tilgængelig | Meddelelse tom | Meddelelse tilgængelig |

| Meddelelse tom | Meddelelse tilgængelig | Meddelelse ikke tilgængelig |

Tilpasset automatisk talegenkendelse

Stemmeaktiverede agenter for et bestemt domæne, f.eks. medicin eller økonomi, kan opleve, at brugerne bruger økonomiske udtryk eller medicinsk jargon. Nogle udtryk og jargon er svære for den stemmeaktiverede agent at konvertere fra tale til tekst.

Du kan forbedre talegenkendelsen for at sikre, at taleinput genkendes nøjagtigt:

Når din agent er åben, skal du vælge Indstillinger>Tale.

Vælg Forøg nøjagtigheden med agentdata for at aktivere agentens tilpassede standardindstillinger for automatisk talegenkendelse.

Vælg Gem for at anvende dine ændringer.

Udgiv din agent for at se de nye ændringer.

Reference til stemmeindstillinger på agentniveau

På siden med indstillinger for agentdetaljer kan du konfigurere timeout for forskellige stemmerelaterede funktioner. De indstillinger, der anvendes på denne side, bliver standard for emner, der er oprettet i din agent.

Sådan foretager du ændringer af indstillingerne for timeout på agentniveau:

Når en agent er åben, skal du vælge Indstillinger>Stemme.

Vælg de ønskede indstillinger, og juster agentens standardindstillinger.

Vælg Gem for at anvende dine ændringer.

Indstillinger på agentniveau

I følgende tabel vises de enkelte indstillinger, og hvordan de er relateret til indstillinger på nodeniveau.

| Sektion på stemmeaktiveret agentniveau | Indstilling | Beskrivelse | Default value | Tilsidesættelse af nodeniveau |

|---|---|---|---|---|

| DTMF | Timeout mellem cifre | Den tid (millisekunder), der højst må gå, mens der ventes på det næste DTMF-tasteinput. Anvender kun flercifrede DTMF-input, når brugere ikke overholder den maksimale inputvarighed. | 3000 ms | Spørgsmålsnode med stemmeegenskaber for multicifret DTMF-input |

| DTMF | Timeout for afbrydelse | Maksimal varighed (millisekunder), der ventes på en DTMF-afslutningstast. Grænsen gælder, når brugeren når den maksimale inputvarighed og ikke trykker på afslutningstasten. Gælder kun for flercifret DTMF-input. Når grænsen udløber, og afsluttende DTMF-nøgle ikke modtages, afslutter agenten genkendelsen og returnerer resultatet indtil dette tidspunkt. Hvis indstillingen er "Fortsæt uden at vente", venter agenten ikke på afslutningsnøglen. Agenten returnerer umiddelbart efter, at brugeren har indtastet den maksimale længde. |

2000 ms | Spørgsmålsnode med stemmeegenskaber for multicifret DTMF-input |

| Registrering af stilhed | Timeout for registrering af stilhed | Den tavshedstid (millisekunder), der højst må gå, mens der ventes på brugerinput. Grænsen gælder, når agenten ikke registrerer brugerinput. Standardværdien er "ingen timeout for stilhed". Agenten venter uendeligt på brugerens input. Tavshedsdetektion for stemme registrerer tiden for perioden, efter at stemmen holder op med at tale. |

Ingen timeout for stilhed | Spørgsmålsnode med stemmeegenskaber for multicifret DTMF-input Systememne (egenskaber for udløser af tavshedsdetektion) for Konfigurere tavshedsdetektion og timeout |

| Talesamling | Timeout for afslutning af udtalelse | Begrænsningen gælder, når brugeren holder pause under eller efter tale. Hvis pausen er længere end timeoutgrænsen, antager agenten, at brugeren er færdig med at tale. Den maksimale værdi for timeout for ytring er 3000 ms. Alt over 3000 ms reduceres til 3000 ms. |

1500 ms | Spørgsmålsnoden med stemmeegenskaber |

| Talesamling | Timeout for talegenkendelse | Bestemmer, hvor lang tid agenten tillader brugerens input, når de begynder at tale. Standardværdien er 12000 millisekunder (ca. 12 sekunder). Ingen timeout for genkendelse betyder uendelig tid. Agenten stiller spørgsmålet igen. Hvis der ikke er noget svar, har stemmen oversteget Timeout for talegenkendelse. | 12,000 ms | Spørgsmålsnoden med stemmeegenskaber |

| Forsinkelsesmeddelelse | Send forsinkelse af meddelelse | Bestemmer, hvor længe agenten venter, før den leverer ventetidsmeddelelsen, efter at en anmodning om baggrundshandling er startet. Tiden angives i millisekunder. | 500 ms | Egenskaber for handlingsnode for langvarig handling |

| Forsinkelsesmeddelelse | Minimumtid for afspilning | Ventetidsmeddelelsen afspilles i kort tid, også selvom baggrundshandlingen fuldføres, mens meddelelsen afspilles. Tiden angives i millisekunder. | 5000 ms | Egenskaber for handlingsnode for langvarig handling |

| Talefølsomhed | Følsomhed | Styrer, hvordan systemet balancerer registrering af tale og baggrundsbillede. Reducer følsomheden for støjende miljøer, offentlige områder og håndfri betjening. Øg følsomheden for stille miljøer, brugere, der taler stille, eller registrering af talekommandoer. Standardindstillingen er 0,5. | 0.5 | Der er ingen tilsidesættelse på node-niveau for dette kontrolelement. |

Aktiver bryd ind

Aktivering af bryd-ind giver dine agentbrugere mulighed for at afbryde din agent. Denne funktion kan være nyttig, når du ikke har brug for, at agentbrugeren hører hele meddelelsen. F.eks. kender dem, der ringer, måske allerede menuindstillingerne, fordi de har hørt dem tidligere. Med bryd-ind kan agentbrugeren angive den ønskede indstilling, selvom agenten ikke er færdig med at angive alle indstillingerne.

Scenarier, hvor bryd ind er deaktiveret

- Deaktiver bryd-ind, hvis du for nylig har opdateret en agentmeddelelse, eller hvis meddelelsen om overholdelse af angivne standarder ikke bør afbrydes.

- Deaktiver bryd ind for den første agentmeddelelse for at sikre, at agentbrugere er opmærksomme på nye eller vigtige oplysninger.

Specifikationer

Bryd-ind understøtter DTMF-baserede og stemmebaserede afbrydelser fra agentbrugeren.

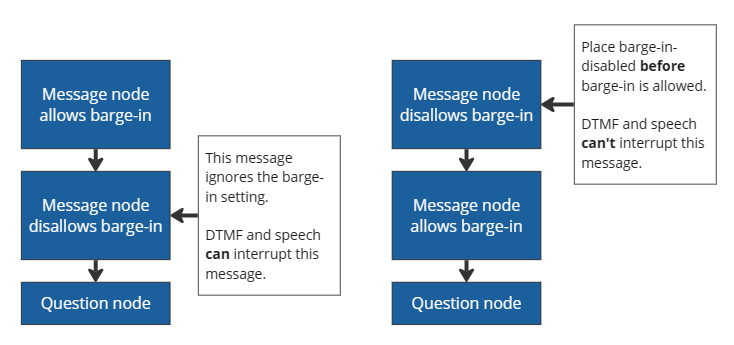

Bryd ind kan styres for hver meddelelse i én batch. Placer

barge-in-disabled-noder i rækkefølge før hver node, hvor bryd ind er tilladt. Ellers behandles "bryd ind deaktiveret" som en "tillad bryd ind"-meddelelse.Når den ene batchkø er færdig, nulstilles den automatiske indstilling for bryd ind for den næste batch og styres af flaget for bryd ind i hver efterfølgende meddelelse. Du kan placere noder for deaktiveret bryd ind, når sekvensen starter igen.

Tip

Hvis der er på hinanden følgende meddelelsesnoder efterfulgt af en spørgsmålsnode, defineres stemmemeddelelser for disse noder som én batch. En batch starter med en meddelelsesnode og stopper ved spørgsmålsnoden, som venter på brugerens input.

Undgå at deaktivere bryd-ind for lange meddelelser, især hvis du forventer, at agentbrugere ofte interagerer med agenten. Hvis din agentbruger allerede kender menupunkterne, kan du lade dem selvbetjene det sted, hvor de vil hen.

Konfigurere bryd ind

Når noden Meddelelse eller Spørgsmål er valgt, skal du angive den ønskede modalitet til Tale og DTMF.

Vælg ikonet Flere (...) i noden, og vælg derefter Egenskaber.

I forbindelse med meddelelsesnoder åbnes panelet Send aktivitetsegenskaber på siden af oprettelseslærredet.

Vælg Tillad bryd ind.

I forbindelse med spørgsmålsnoder åbnes panelet Egenskaber for spørgsmål. Vælg derefter Stemme.

Vælg Tillad bryd ind i egenskaberne for Stemme.

Gem emnet for at bekræfte dine ændringer.

Konfigurere tavshedsdetektion og timeout

Med registrering af stilhed kan du konfigurere, hvor længe agenten skal vente på brugerinput, og den handling, den skal udføre, hvis der ikke modtages input. Registrering af stilhed er mest nyttigt som svar på et spørgsmål på nodeniveau, eller når agenten venter på, at en udløsersætning starter et nyt emne.

Du kan konfigurere standardtimeout for emner.

Sådan tilsidesættes standarderne for en node:

Vælg ikonet Flere (...) i noden, og vælg derefter Egenskaber.

Panelet Egenskaber for spørgsmål åbnes.

Vælg Stemme, og foretag justeringer af følgende indstillinger:

Indstillingen Timeout for tavshedsdetektion Beskrivelse Bruge agentindstilling Noden bruger den globale indstilling til tavshedsdetektion. Deaktiver for denne node Agenten venter på ubestemt tid på et svar. Tilpas i millisekunder Agenten venter i et bestemt tidsrum, før han gentager spørgsmålet.

Fallback-handling

Du kan konfigurere nogle funktionsmåder som reservehandling:

- Hvor mange gange agenten skal gentage et spørgsmål

- Hvad den nye promptmeddelelse skal sige

- Hvad agenten skal gøre efter et angivet antal gentagelser

Taleinput

Du kan angive følgende for taleinput:

- Timeout for afslutning af udtalelse: Hvor længe agenten venter, efter at brugeren er færdig med at tale

- Timeout for talegenkendelse: Hvor lang tid agenten giver brugeren, når vedkommende begynder at svare

Hvis du vil konfigurere funktionsmåden for registrering af stilhed, når din agent venter på en udløserfrase, skal du justere indstillingerne i systememnet Ved stilhed.

Tilføj en ventemeddelelse for langvarige handlinger

Ved lange backend-handlinger kan din agent sende en meddelelse til brugerne for at give dem besked om de længere processer. Agenter på en meddelelseskanal kan også sende en meddelelse om ventetid.

| Afspilning af lyd for ventetidsmeddelelse | Ventetidsmeddelelse i chat |

|---|---|

| Fortsætter med at køre i løkke, indtil handlingen er fuldført. | Sendes kun én gang, når den angivne ventetid nås. |

I Copilot Studio kan din agent gentage en meddelelse, når den har udløst et Power Automate-flow:

Vælg ikonet Flere (...) i noden, og vælg derefter Egenskaber. Panelet Egenskaber for handling åbnes.

Vælg Send en meddelelse

I afsnittet Meddelelse skal du angive, hvad agenten skal sige. Du kan bruge SSML til at ændre meddelelsens lyd. Agenten gentager meddelelsen, indtil flowet er fuldført.

Du kan justere, hvor længe agenten skal vente, før meddelelsen gentages, i afsnittet Forsinkelse. Du kan angive en minimumtid, der skal ventes, også selvom flowet er fuldført.

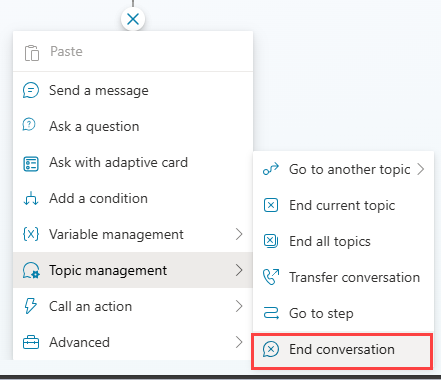

Konfigurere afslutning af opkald

Hvis du vil konfigurere din agent til at afslutte opkaldet og lægge på, skal du tilføje en ny node (+) og derefter vælge Emnestyring>Afslut samtale.

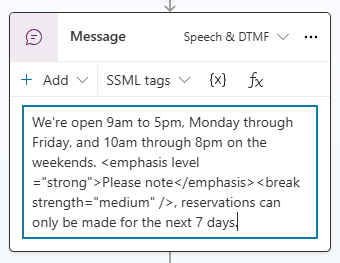

Formatere talesyntese med SSML

Du kan bruge SSML (Speech Synthesis Markup Language) til at ændre, hvordan agenten lyder, når den læser meddelelser højt. Du kan f.eks. ændre tonen eller hyppigheden af talte ord, hastighed og volumen.

SSML bruger koder til at omslutte den tekst, du vil ændre, i stil med HTML. Du kan bruge følgende koder i Copilot Studio:

| SSML-kode | Beskrivelse | Link til dokumentation til taletjeneste |

|---|---|---|

<audio src="_URL to an audio file_"/> |

Føj URL-adressen til en lydfil i koden. Filen skal være tilgængelig for agentbrugeren. | Tilføje optaget lyd |

<break /> |

Indsæt pauser eller pauser mellem ord. Indsæt pauseindstillinger i koden. | Tilføj en pause |

<emphasis>

Tekst, du vil ændre</emphasis> |

Føj trykniveauer til ord eller sætninger. Tilføj indstillinger for fremhævning i åbningskoden. Tilføj den afsluttende kode efter den tekst, du vil ændre. | Justere indstillinger for fremhævning |

<prosody>

Tekst, du vil ændre</prosody> |

Angiv ændringer af tonehøjde, kontour, område, hastighed og lydstyrke. Tilføj indstillinger for prosodi i åbningskoden. Tilføj den afsluttende kode efter den tekst, du vil ændre. | Justere indstillinger for prosodi |

<lang xml:lang="xx-XX">

Tekst, du vil ændre</lang> |

Juster talesproget i den samme meddelelse, når du bruger en flersproget neural stemme. | Tilpas talesprog |

Bemærk

Når du bruger <audio src="_URL to an audio file_"/>-mærket, og URL-adressen er gemt i en variabel, skal URL-adressen kodes, før den indsættes i src SSML-mærket for lyd i meddelelsen. Vi anbefaler, at du bruger EncodeHTML PowerFx-funktionen til at kode URL-adressen, når du tildeler den til en variabel i tildelingshandlingen.

Søge efter og bruge en kode

SSML bruger koder til at omslutte den tekst, du vil ændre, i stil med HTML.

Du kan bruge følgende koder i Copilot Studio:

Når noden Meddelelse eller Spørgsmål er valgt, skal du ændre tilstanden til Tale og DTMF.

Vælg menuen SSML-koder, og vælg en kode.

Meddelelsesfeltet udfyldes med koden. Hvis du allerede har tekst i meddelelsesfeltet, tilføjes koden sidst i meddelelsen.

Omslut den tekst, du vil ændre, med åbnings- og afslutningskoder. Du kan kombinere flere koder og tilpasse de enkelte dele af meddelelsen med individuelle koder.

Tip

Du kan angive SSML-koder manuelt, der ikke vises i hjælpemenuen. Du kan få mere at vide om andre tilgængelige koder i Forbedre overensstemmelse med SSML.

Viderestille et opkald til en repræsentant eller et eksternt telefonnummer

Du kan få agenten til at overføre opkaldet til et eksternt telefonnummer. Copilot Studio understøtter viderestilling til et PSTN-telefonnummer og direct routing-nummer.

Sådan viderestiller du til et eksternt telefonnummer:

Tilføj en ny node (+) i det emne, du vil redigere. Vælg Emnestyring i nodemenuen, og vælg derefter Overfør samtale.

Vælg Overfør til eksternt telefonnummer under Overførselstype, og angiv overførselsnummeret.

(Valgfrit) Du kan føje SIP UUI-header til telefonopkaldet.

Denne header er en streng af

key=value-par uden mellemrum eller specialtegn, der vises, og som eksterne systemer skal læse.Vælg ikonet Flere (...) i noden, og vælg derefter Egenskaber. Panelet Overfør egenskaber for samtale åbnes.

Angiv de oplysninger, du vil sende sammen med overførslen af opkaldet, under SIP UUI-header. Variabler understøttes ikke, når de overføres til et eksternt telefonnummer.

Advarsel

Kun de første 128 tegn i strengen sendes.

I headeren accepteres kun tal, bogstaver, lighedstegn (

=) og semikolon (;). Alle andre tegn, herunder mellemrum, klammeparenteser og kantede parenteser eller formler, understøttes ikke og kan medføre, at overførslen mislykkes.

Tip

Medtag et + i dit telefonnummer for den tilsvarende landekode.

Overførsel af udgående data med SIP UUI for destinationstelefonnummeret skal bruge direct routing. PSTN (Public Switched Telephone Network) telefonnumre understøtter ikke overførsel af SIP UUI-headere.

Hvis du vil overføre til en repræsentant, skal du se Eksplicitte udløsere.

Bruge stemmevariabler

Copilot Studio understøtter udfyldning af variabler. Du kan bruge foruddefinerede variabler eller oprette brugerdefinerede variabler.

Bemærk

- Du kan finde flere oplysninger om, hvordan du kan bruge og oprette variabler i Copilot Studio, i Arbejde med variabler.

- Du kan finde oplysninger om yderligere aktivitets- og samtalevariabler, der er tilgængelige for stemmeaktiverede agenter, under Variabler for stemmeaktiverede agenter.

En stemmeaktiveret agent i Copilot Studio understøtter kontekstvariabler. Disse variabler hjælper dig med at integrere dine agentsamtaler med Dynamics 365 Customer Service, når du viderestiller et opkald.

Du kan finde flere oplysninger om kontekstvariabler i Dynamics 365 Customer Service under Kontekstvariabler for Copilot Studio-robotter.

Denne integration understøtter disse scenarier med følgende variabler, når du overfører:

| Variabel | Type | Beskrivelse |

|---|---|---|

System.Activity.From.Name |

String | Agentbrugerens opkalder-id |

System.Activity.Recipient.Name |

String | Det nummer, der bruges til at ringe til eller oprette forbindelse til agenten |

System.Conversation.SipUuiHeaderValue |

String | Værdien i SIP-headeren, når der overføres via et telefonnummer til direct routing |

System.Activity.UserInputType |

String | Angiver, om agentbrugeren har brugt DTMF eller tale i samtalen |

System.Activity.InputDTMFKey |

String | Agentbrugerens rå DTMF-input |

System.Conversation.OnlyAllowDTMF |

Boolean | Voice ignorerer taleinput, når den angives til sand |

System.Activity.SpeechRecognition.Confidence |

Nummer | Tillidsværdien (mellem 0 og 1) fra den sidste talegenkendelseshændelse |

System.Activity.SpeechRecognition.MinimalFormattedText |

String | Resultater af talegenkendelse (som rå tekst), før Copilot Studio anvendte den dedikerede model for forståelse af naturligt sprog |

Bemærk

- Det tager længere tid at publicere en agent med store udløserfraser og objektstørrelse.

- Hvis flere brugere publicerer den samme agent på samme tid, blokeres publiceringshandlingen. Du skal publicere agenten igen, når andre har afsluttet deres eksisterende agentredigeringer.

Du kan få mere at vide om de grundlæggende principper for publicering under Nøglebegreber – Publicere og udrulle din agent.