Consideraciones sobre DSPM para la inteligencia artificial & las protecciones de cumplimiento y seguridad de datos para Copilot

Guía de licencias de Microsoft 365 para el cumplimiento de la seguridad &

Cuando comprenda cómo puede usar Administración de postura de seguridad de datos de Microsoft Purview (DSPM) para la inteligencia artificial y otras funcionalidades para administrar la seguridad de los datos y las protecciones de cumplimiento para Microsoft 365 Copilot y Microsoft 365 Copilot Chat, use la siguiente información detallada para los requisitos previos, consideraciones y exenciones que puedan aplicarse a su organización. Para Microsoft 365 Copilot y Microsoft 365 Copilot Chat, asegúrese de leerlos junto con los requisitos de Microsoft 365 Copilot y la protección de datos empresariales en Microsoft 365 Copilot y Microsoft Copilot chat 365.

Para obtener información sobre licencias para usar estas funcionalidades para Copilot, consulte los vínculos de descripción de licencias y servicios en la parte superior de la página. Para obtener información sobre las licencias de Copilot, consulte la descripción del servicio para Microsoft 365 Copilot.

Administración de postura de seguridad de datos para IA requisitos previos y consideraciones

En la mayoría de los casos, Administración de postura de seguridad de datos para IA es fácil de usar y se explica por sí mismo, lo que le guiará a través de requisitos previos e informes y directivas preconfigurados. Use esta sección para complementar esa información y proporcionar detalles adicionales que pueda necesitar.

Requisitos previos para Administración de postura de seguridad de datos para IA

Para usar Administración de postura de seguridad de datos para IA desde el portal de Microsoft Purview o el portal de cumplimiento Microsoft Purview, debe tener los siguientes requisitos previos:

Tiene los permisos adecuados.

Necesario para supervisar las interacciones con Copilot:

A los usuarios se les asigna una licencia para Microsoft 365 Copilot.

La auditoría de Microsoft Purview está habilitada para su organización. Aunque este es el valor predeterminado, es posible que desee comprobar las instrucciones para Activar o desactivar la auditoría.

Necesario para supervisar las interacciones con sitios de inteligencia artificial generativos de terceros:

Los dispositivos se incorporan a Microsoft Purview, necesarios para:

- Obtener visibilidad sobre la información confidencial que se comparte con sitios de inteligencia artificial generativos de terceros. Por ejemplo, un usuario pega los números de tarjeta de crédito en ChatGPT.

- Aplicar directivas DLP de punto de conexión para advertir o impedir que los usuarios compartan información confidencial con sitios de inteligencia artificial generativos de terceros. Por ejemplo, un usuario identificado como riesgo elevado en Adaptive Protection se bloquea con la opción de invalidar cuando pega números de tarjeta de crédito en ChatGPT.

La extensión del explorador Microsoft Purview se implementa en los usuarios y es necesaria para detectar visitas al sitio a sitios de inteligencia artificial generativos de terceros.

Encontrará más información sobre los requisitos previos para la auditoría, la incorporación de dispositivos y la extensión del explorador en Administración de postura de seguridad de datos para IA: Navegar a la sección Introducción>Introducción.

Para obtener una lista de las aplicaciones de inteligencia artificial de terceros compatibles actualmente, consulte Sitios de IA admitidos por Microsoft Purview para obtener protección de cumplimiento y seguridad de datos.

Nota:

Aunque las unidades administrativas son compatibles con los informes y el explorador de actividad en Administración de postura de seguridad de datos de Microsoft Purview para IA, no se admiten para las directivas de un solo clic. Esto significa que un administrador asignado a una unidad administrativa específica verá los resultados solo para los usuarios de esa unidad administrativa asignada, pero puede crear directivas para todos los usuarios.

Directivas de un solo clic de Administración de postura de seguridad de datos para IA

Una vez creadas las directivas predeterminadas, puede verlas y editarlas en cualquier momento desde sus respectivas áreas de solución en el portal. Por ejemplo, quiere limitar las directivas a usuarios específicos durante las pruebas o a los requisitos empresariales. O bien, quiere agregar o quitar clasificadores que se usan para detectar información confidencial. Use la página Directivas para navegar rápidamente al lugar correcto en el portal.

Si elimina cualquiera de las directivas, su estado en la página Directivas muestra PendingDeletion y continúa mostrándose como se ha creado en sus tarjetas de recomendación respectivas hasta que se complete el proceso de eliminación.

Para ver las etiquetas de confidencialidad y sus directivas, vea y edite estas etiquetas independientemente de Administración de postura de seguridad de datos para IA; para ello, vaya a Information Protection en el portal. Para obtener más información, use los vínculos de configuración de Etiquetas y directivas predeterminadas para proteger los datos.

Para obtener más información sobre las acciones DLP admitidas y las plataformas que las admiten, consulte las dos primeras filas de la tabla de actividades de punto de conexión en las que puede supervisar y realizar acciones.

En el caso de las directivas predeterminadas que usan La protección adaptable, esta funcionalidad está activada si aún no está activada, usando los niveles de riesgo predeterminados para que todos los usuarios y grupos apliquen dinámicamente acciones de protección. Para obtener más información, consulte Configuración rápida.

Nota:

No se cambiarán las directivas predeterminadas creadas mientras Administración de postura de seguridad de datos para IA estaba en versión preliminar y con el nombre Microsoft Purview Centro de IA. Por ejemplo, los nombres de directiva conservarán su prefijo microsoft Centro de IA- .

Directivas predeterminadas para la detección de datos mediante Administración de postura de seguridad de datos para IA

Directiva DLP: DSPM para IA: Detección de información confidencial agregada a sitios de IA

Esta directiva detecta el contenido confidencial pegado o cargado en Microsoft Edge, Chrome y Firefox en sitios de IA. Esta directiva cubre solo todos los usuarios y grupos de la organización en modo de auditoría.

Directiva de administración de riesgos internos: DSPM para la inteligencia artificial: detectar cuándo los usuarios visitan sitios de IA

Detecta cuándo los usuarios usan un explorador para visitar sitios de inteligencia artificial.

Directiva de administración de riesgos internos: DSPM para la inteligencia artificial: detección del uso de inteligencia artificial de riesgo

Esta directiva ayuda a calcular el riesgo del usuario mediante la detección de mensajes y respuestas de riesgo en Microsoft 365 Copilot y otras aplicaciones de inteligencia artificial generativa.

Cumplimiento de comunicaciones: DSPM para la inteligencia artificial: comportamiento no ético en Copilot

Esta directiva detecta información confidencial en mensajes y respuestas en Microsoft 365 Copilot. Esta directiva cubre todos los usuarios y grupos de la organización.

Directivas predeterminadas de seguridad de datos para ayudarle a proteger los datos confidenciales que se usan en la inteligencia artificial generativa

DSPM de directiva DLP para IA: bloquear información confidencial de sitios de inteligencia artificial

Esta directiva usa Adaptive Protection para proporcionar un bloqueo con invalidación a usuarios de riesgo elevados que intentan pegar o cargar información confidencial en otras aplicaciones de inteligencia artificial en Edge, Chrome y Firefox. Esta directiva cubre todos los usuarios y grupos de la organización en modo de prueba.

Protección de la información

Esta opción crea etiquetas de confidencialidad predeterminadas y directivas de etiquetas de confidencialidad.

Si ya ha configurado etiquetas de confidencialidad y sus directivas, esta configuración se omite.

Eventos del explorador de actividad

Use la siguiente información para ayudarle a comprender los eventos que puede ver en el explorador de actividad de Administración de postura de seguridad de datos para IA. Las referencias a un sitio de inteligencia artificial generativa pueden incluir Microsoft 365 Copilot, Microsoft 365 Copilot Chat y otros copilotos de Microsoft y sitios de inteligencia artificial de terceros.

| Evento | Descripción |

|---|---|

| Interacción con la inteligencia artificial | El usuario interactuó con un sitio de IA generativo. Los detalles incluyen las solicitudes y respuestas. Para Microsoft 365 Copilot y Microsoft 365 Copilot Chat, este evento requiere que se active la auditoría. |

| Visita al sitio web de IA | El usuario ha navegado a un sitio de IA generativo. |

| Coincidencia de reglas DLP | Se coincidió con una regla de prevención de pérdida de datos cuando un usuario interactuó con un sitio de IA generativo Incluye DLP para Microsoft 365 Copilot. |

| Tipos de información confidencial | Se encontraron tipos de información confidencial mientras un usuario interactuaba con un sitio de inteligencia artificial generativo. Para Microsoft 365 Copilot y Microsoft 365 Copilot Chat, este evento requiere que la auditoría esté activada, pero no requiere ninguna directiva activa. |

El evento de interacción de IA no siempre muestra texto para la solicitud y la respuesta de Copilot. A veces, el símbolo del sistema y la respuesta abarcan entradas consecutivas. Otros escenarios pueden incluir:

- Copilot para Word, cuando un usuario selecciona Inspirarme para un documento existente, no se muestra ningún mensaje

- Copilot para Word, cuando un documento no tiene contenido o tiene contenido pero no se guarda, no se muestra ninguna solicitud o respuesta.

- Copilot para Excel, cuando un usuario solicita generar información de datos, no se muestra ninguna solicitud o respuesta.

- Copilot para Excel, cuando un usuario solicita resaltar celdas o formato, no se muestra ninguna solicitud o respuesta.

- Copilot para PowerPoint, cuando no se guarda una presentación, no se muestra ningún mensaje o respuesta.

- Copilot para Teams, no se muestra ningún mensaje

- Copilot para Whiteboard, no se muestra ninguna solicitud o respuesta

- Copilot en Forms, no se muestra ninguna solicitud o respuesta

El evento Tipos de información confidencial detectados no muestra el nivel de riesgo del usuario.

Consideraciones sobre la protección de la información para Copilot

Microsoft 365 Copilot y Microsoft 365 Copilot Chat tienen la capacidad de acceder a los datos almacenados en el inquilino de Microsoft 365, incluidos los buzones de Exchange Online y los documentos de SharePoint o OneDrive.

Además de acceder al contenido de Microsoft 365, Copilot también puede usar el contenido del archivo específico en el que está trabajando en el contexto de una sesión de aplicación de Office, independientemente de dónde se almacene ese archivo. Por ejemplo, almacenamiento local, recursos compartidos de red, almacenamiento en la nube o una memoria USB. Cuando un usuario abre archivos dentro de una aplicación, el acceso suele denominarse datos en uso.

Antes de implementar licencias para Copilot, asegúrese de que está familiarizado con los detalles siguientes que le ayudarán a reforzar las soluciones de protección de datos:

Si el contenido concede a un usuario derechos de uso VIEW pero no EXTRACT:

- Cuando un usuario tiene este contenido abierto en una aplicación, no podrá usar Copilot.

- Copilot no resumirá este contenido, pero puede hacer referencia a él con un vínculo para que el usuario pueda abrir y ver el contenido fuera de Copilot.

Además, puede impedir que Copilot resuma archivos etiquetados (cifrados o no) identificados por una directiva de Protección contra pérdida de datos de Microsoft Purview. Copilot no resumirá este contenido, pero puede hacer referencia a él con un vínculo para que el usuario pueda abrir y ver el contenido fuera de Copilot.

Al igual que las aplicaciones de Office, Copilot puede acceder a las etiquetas de confidencialidad de su organización, pero no a otras organizaciones. Para obtener más información sobre la compatibilidad con el etiquetado entre organizaciones, consulte Compatibilidad con usuarios externos y contenido etiquetado.

Una configuración avanzada de PowerShell para etiquetas de confidencialidad puede impedir que las aplicaciones de Office envíen contenido a algunas experiencias conectadas, lo que incluye Microsoft 365 Copilot.

Copilot no puede acceder a documentos sin abrir en SharePoint y OneDrive cuando se etiquetan y cifran con permisos definidos por el usuario. Copilot puede acceder a estos documentos para un usuario cuando está abierto en la aplicación (datos en uso).

Copilot no puede acceder a documentos sin abrir en SharePoint que se han configurado con una etiqueta de confidencialidad predeterminada que extiende los permisos de SharePoint a los documentos descargados.

Los elementos de esos contenedores no heredan las etiquetas de confidencialidad que se aplican a grupos y sitios (también conocidos como "etiquetas de contenedor"). Como resultado, los elementos no mostrarán su etiqueta de contenedor en Copilot y no podrán admitir la herencia de etiquetas de confidencialidad. Por ejemplo, los mensajes de chat de canal de Teams que se resumen desde un equipo etiquetado como Confidencial no mostrarán esa etiqueta para el contexto de confidencialidad en Microsoft 365 Copilot Chat. De forma similar, el contenido de las páginas y listas del sitio de SharePoint no mostrará la etiqueta de confidencialidad de su etiqueta de contenedor.

Si usa la configuración de la biblioteca de administración de derechos de información (IRM) de SharePoint que impide que los usuarios copien texto, tenga en cuenta que los derechos de uso se aplican cuando se descargan los archivos y no cuando se crean o cargan en SharePoint. Si no quiere que Copilot resuma estos archivos cuando estén en reposo, use etiquetas de confidencialidad que apliquen el cifrado sin el derecho de uso EXTRACT.

A diferencia de otros escenarios de etiquetado automático, una etiqueta heredada al crear contenido nuevo reemplazará una etiqueta de prioridad inferior que se aplicó manualmente.

Cuando no se puede aplicar una etiqueta de confidencialidad heredada, el texto no se agregará al elemento de destino. Por ejemplo:

- El elemento de destino es de solo lectura

- El elemento de destino ya está cifrado y el usuario no tiene permisos para cambiar la etiqueta (requiere derechos de uso EXPORT o FULL CONTROL)

- La etiqueta de confidencialidad heredada no se publica en el usuario

Si un usuario pide a Copilot que cree contenido nuevo a partir de elementos etiquetados y cifrados, no se admite la herencia de etiquetas cuando el cifrado está configurado para permisos definidos por el usuario o si el cifrado se aplicó de forma independiente de la etiqueta. El usuario no podrá enviar estos datos al elemento de destino.

Dado que el cifrado de doble clave (DKE) está diseñado para los datos más confidenciales que están sujetos a los requisitos de protección más estrictos, Copilot no puede acceder a estos datos. Como resultado, Copilot no devolverá los elementos protegidos por DKE y, si un elemento DKE está abierto (datos en uso), no podrá usar Copilot en la aplicación.

Copilot no reconoce actualmente las etiquetas de confidencialidad que protegen las reuniones y el chat de Teams . Por ejemplo, los datos devueltos desde un chat de reunión o un chat de canal no mostrarán una etiqueta de confidencialidad asociada, no se puede impedir la copia de datos de chat para un elemento de destino y la etiqueta de confidencialidad no se puede heredar. Esta limitación no se aplica a las invitaciones a reuniones, las respuestas y los eventos de calendario protegidos por etiquetas de confidencialidad.

Para Microsoft 365 Copilot Chat (anteriormente conocido como Chat empresarial, chat basado en Graph y Microsoft 365 Chat):

- Cuando las invitaciones a reuniones tienen aplicada una etiqueta de confidencialidad, la etiqueta se aplica al cuerpo de la invitación a la reunión, pero no a los metadatos, como la fecha y hora, o a los destinatarios. Como resultado, las preguntas basadas solo en los metadatos devuelven datos sin la etiqueta. Por ejemplo, "¿Qué reuniones tengo el lunes?" Las preguntas que incluyen el cuerpo de la reunión, como la agenda, devuelven los datos como etiquetados.

- Si el contenido se cifra independientemente de su etiqueta de confidencialidad aplicada y ese cifrado no concede al usuario derechos de uso EXTRACT (pero incluye el derecho de uso VIEW), Copilot puede devolver el contenido y, por tanto, enviarlo a un elemento de origen. Ejemplo de cuándo puede producirse esta configuración si un usuario ha aplicado restricciones de Office desde Information Rights Management cuando un documento se etiqueta como "General" y esa etiqueta no aplica cifrado.

- Cuando el contenido devuelto tiene una etiqueta de confidencialidad aplicada, los usuarios no verán la opción Editar en Outlook porque esta característica no se admite actualmente para los datos etiquetados.

- Si usa las funcionalidades de extensión que incluyen complementos y el conector de Microsoft Graph, las etiquetas de confidencialidad y el cifrado que se aplican a estos datos desde orígenes externos no se reconocen por Microsoft 365 Copilot Chat. La mayoría de las veces esta limitación no se aplicará porque es poco probable que los datos admitan etiquetas de confidencialidad y cifrado, aunque una excepción son los datos de Power BI. Siempre puede desconectar los orígenes de datos externos mediante el Centro de administración de Microsoft 365 para desactivar esos complementos para los usuarios y desconectar las conexiones que usan un conector de Graph API.

Excepciones específicas de la aplicación:

Microsoft 365 Copilot en Outlook: debe tener una versión mínima de Outlook para usar Microsoft 365 Copilot para los elementos cifrados en Outlook:

- Outlook (clásico) para Windows: a partir de la versión 2408 en canal actual y canal mensual de empresa

- Outlook para Mac: versión 16.86.609+

- Outlook para iOS: versión 4.2420.0+

- Outlook para Android: versión 4.2420.0+

- Outlook en la Web: Sí

- Nueva Outlook para Windows: Sí

Microsoft 365 Copilot en Edge, Microsoft 365 Copilot en Windows: a menos que se use la prevención de pérdida de datos (DLP) en Edge, Copilot puede hacer referencia a contenido cifrado desde la pestaña del explorador activo en Edge cuando ese contenido no concede al usuario derechos de uso EXTRACT. Por ejemplo, el contenido cifrado procede de Office para la Web o Outlook para la Web.

¿Se reemplazará una etiqueta existente para la herencia de etiquetas de confidencialidad?

Resumen de resultados cuando Copilot aplica automáticamente la protección con herencia de etiquetas de confidencialidad:

| Etiqueta ya existente | Invalidación con herencia de etiquetas de confidencialidad |

|---|---|

| Aplicación manual, prioridad inferior | Yes |

| Aplicación manual, mayor prioridad | No |

| Aplicado automáticamente, prioridad inferior | Yes |

| Aplicado automáticamente, mayor prioridad | No |

| Etiqueta predeterminada de la directiva, prioridad inferior | Yes |

| Etiqueta predeterminada de la directiva, prioridad superior | No |

| Etiqueta de confidencialidad predeterminada para una biblioteca de documentos, prioridad inferior | Yes |

| Etiqueta de confidencialidad predeterminada para una biblioteca de documentos, prioridad superior | No |

Copilot respeta la protección existente con el derecho de uso EXTRACT

Aunque es posible que no esté muy familiarizado con los derechos de uso individuales para el contenido cifrado, han pasado mucho tiempo. Desde Windows Server Rights Management hasta Active Directory Rights Management hasta la versión en la nube que se convirtió en Azure Information Protection con el servicio Azure Rights Management.

Si alguna vez ha recibido un correo electrónico de "No reenviar", usa los derechos de uso para impedir que reenvíe el correo electrónico después de autenticarse. Al igual que con otros derechos de uso agrupados que se asignan a escenarios empresariales comunes, un correo electrónico no reenviar concede al destinatario derechos de uso que controlan lo que pueden hacer con el contenido y no incluye el derecho de uso FORWARD. Además de no reenviar, no puede imprimir este correo electrónico no reenviar ni copiar texto desde él.

El derecho de uso que concede permiso para copiar texto es EXTRACT, con el nombre común y más fácil de usar de Copiar. Este derecho de uso determina si Copilot puede mostrar texto al usuario desde contenido cifrado.

Nota:

Dado que el derecho de uso Control total (PROPIETARIO) incluye todos los derechos de uso, EXTRACT se incluye automáticamente con Control total.

Cuando se usa el portal de Microsoft Purview o el portal de cumplimiento Microsoft Purview para configurar una etiqueta de confidencialidad para aplicar el cifrado, la primera opción es asignar los permisos ahora o permitir que los usuarios asignen los permisos. Si asigna ahora, configure los permisos seleccionando un nivel de permiso predefinido con un grupo preestablecido de derechos de uso, como Co-Author o Reviewer. O bien, puede seleccionar permisos personalizados donde puede seleccionar individualmente los derechos de uso disponibles.

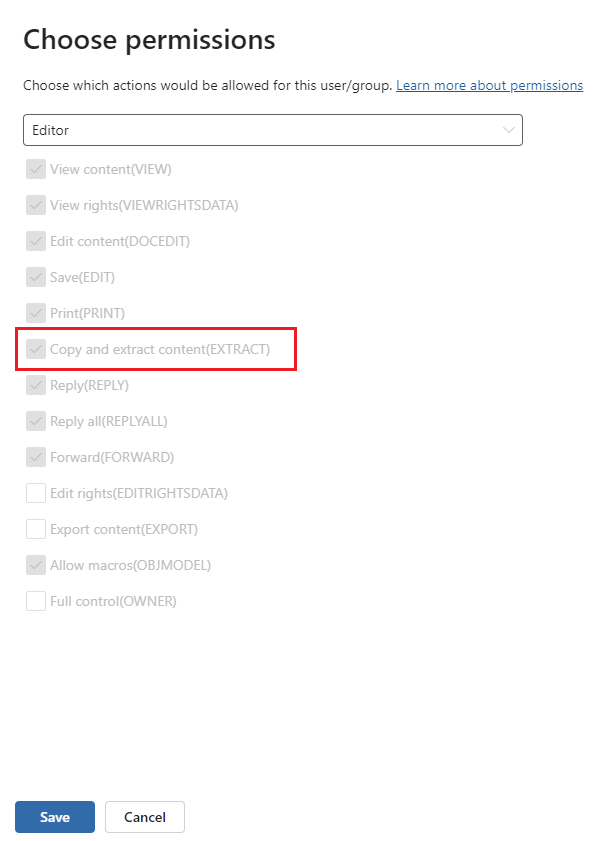

En el portal de Microsoft Purview, el derecho de uso EXTRACT se muestra como Copiar y extraer contenido (EXTRACT). Por ejemplo, el nivel de permiso predeterminado seleccionado es Editor, donde verá Copiar y extraer contenido (EXTRACT). Como resultado, Copilot puede devolver el contenido protegido con esta configuración de cifrado:

Si selecciona Personalizado en el cuadro desplegable y, a continuación, Control total (PROPIETARIO) de la lista, esta configuración también concederá el derecho de uso EXTRACT.

Nota:

La persona que aplica el cifrado siempre tiene el derecho de uso EXTRACT, ya que es el propietario de Rights Management. Este rol especial incluye automáticamente todos los derechos de uso y algunas otras acciones, lo que significa que el contenido que un usuario ha cifrado por sí mismo siempre es apto para ser devuelto por Microsoft 365 Copilot y Microsoft 365 Copilot Chat. Las restricciones de uso configuradas se aplican a otras personas autorizadas para acceder al contenido.

Como alternativa, si selecciona la configuración de cifrado para permitir que los usuarios asignen permisos, para Outlook, esta configuración incluye permisos predefinidos para No reenviar y Cifrar solo. La opción Encrypt-Only, a diferencia de No reenviar, incluye el derecho de uso EXTRACT.

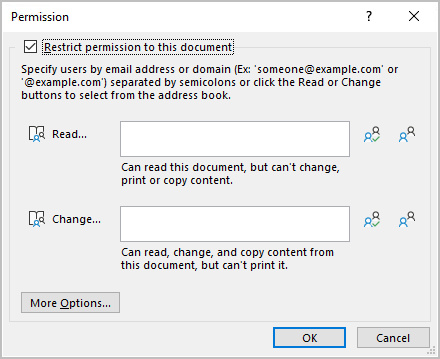

Al seleccionar permisos personalizados para Word, Excel y PowerPoint, los usuarios seleccionan sus propios permisos en la aplicación de Office cuando aplican la etiqueta de confidencialidad. Actualmente hay dos versiones del cuadro de diálogo. En la versión anterior, se les informa de que, a partir de las dos selecciones, Read no incluye el permiso para copiar contenido, pero Change sí. Estas referencias que se van a copiar hacen referencia al derecho de uso EXTRACT. Si el usuario selecciona Más opciones, puede agregar el derecho de uso EXTRACT a Leer; para ello, seleccione Permitir que los usuarios con acceso de lectura copien contenido.

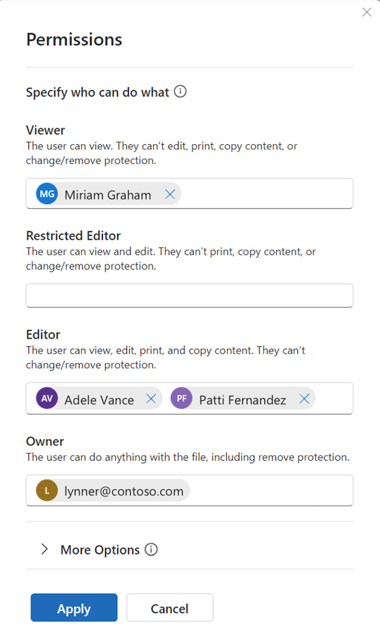

En la versión más reciente del cuadro de diálogo, Lectura y cambio se reemplaza por niveles de permisos donde las descripciones que no se permiten la copia de estado no incluirán el derecho de uso EXTRACT. Los niveles de permisos que incluyen EXTRACT son Editor y Owner. Por ejemplo:

Sugerencia

Si necesita comprobar si un documento que está autorizado a ver incluye el derecho de uso EXTRACT, ábralo en la aplicación Windows Office y personalice la barra de estado para mostrar permisos. Seleccione el icono situado junto al nombre de la etiqueta de confidencialidad para mostrar Mi permiso. Vea el valor de Copiar, que se asigna al derecho de uso EXTRACT y confirme si muestra Sí o No.

En el caso de los correos electrónicos, si los permisos no se muestran en la parte superior del mensaje en Outlook para Windows, seleccione el banner de información con el nombre de la etiqueta y, a continuación, seleccione Ver permiso.

Copilot respeta el derecho de uso EXTRACT para un usuario, sin embargo, se aplicó al contenido. La mayoría de las veces, cuando se etiqueta el contenido, los derechos de uso concedidos al usuario coinciden con los de la configuración de la etiqueta de confidencialidad. Sin embargo, hay algunas situaciones que pueden dar lugar a que los derechos de uso del contenido sean diferentes de la configuración de etiqueta aplicada:

- La etiqueta de confidencialidad se aplica después de que ya se hayan aplicado los derechos de uso.

- Los derechos de uso se aplican después de aplicar una etiqueta de confidencialidad.

Para obtener más información sobre cómo configurar una etiqueta de confidencialidad para el cifrado, consulte Restricción del acceso al contenido mediante etiquetas de confidencialidad para aplicar el cifrado.

Para obtener detalles técnicos sobre los derechos de uso, consulte Configuración de derechos de uso para Azure Information Protection.

Consideraciones de administración de cumplimiento para Copilot

La administración de cumplimiento para interacciones con Copilot se extiende a través de Word, Excel, PowerPoint, Outlook, Teams, Loop y Páginas de Copilot, Whiteboard, OneNote y Microsoft 365 Copilot Chat (anteriormente Chat empresarial, chat basado en Graph y Microsoft 365 Chat).

Nota:

La administración de cumplimiento para Microsoft 365 Copilot Chat incluye mensajes y respuestas hacia y desde la web pública cuando los usuarios inician sesión y seleccionan la opción Trabajo en lugar de Web.

Las herramientas de cumplimiento identifican las interacciones de Copilot de origen por el nombre de la aplicación. Por ejemplo, Copilot en Word, Copilot en Teams y Microsoft 365 Chat (para Microsoft 365 Copilot Chat).

Antes de que la organización use Microsoft 365 Copilot y Microsoft 365 Copilot Chat, asegúrese de que está familiarizado con los detalles siguientes para admitir las soluciones de administración de cumplimiento:

Los datos de auditoría están diseñados para fines de seguridad y cumplimiento de datos y proporcionan una visibilidad completa de las interacciones de Copilot para estos casos de uso. Por ejemplo, para detectar riesgos de uso compartido excesivo de datos o para recopilar interacciones con fines legales o de cumplimiento normativo. No está pensado para usarse como base para los informes de uso de Copilot.

Nota:

Es posible que las métricas agregadas que se basan en estos datos de auditoría, como "recuento de mensajes" o "recuento de usuarios activos", no sean coherentes con los puntos de datos correspondientes en los informes oficiales de uso de Copilot proporcionados por Microsoft. Microsoft no puede proporcionar instrucciones sobre cómo usar los datos de registro de auditoría como base para los informes de uso, ni microsoft guartantee que las métricas de uso agregadas basadas en datos de registro de auditoría coincidan con métricas de uso similares notificadas en otras herramientas.

Para acceder a información precisa sobre el uso de Copilot, use uno de los siguientes informes: el informe de uso de Microsoft 365 Copilot en el Centro de Administración de Microsoft 365 o el Panel de Copilot en Viva Insights.

La auditoría captura la actividad de Copilot de búsqueda, pero no la solicitud o respuesta real del usuario. Para esta información, use eDiscovery. O desde Administración de postura de seguridad de datos de Microsoft Purview para IA, use la interacción de IA desde la página Explorador de actividad.

todavía no se admiten los cambios relacionados con Administración para auditar Copilot.

La información de identificación del dispositivo no se incluye actualmente en los detalles de la auditoría.

Las directivas de retención para las interacciones de Copilot no informan a los usuarios cuando los mensajes se eliminan como resultado de una directiva de retención.

Excepciones específicas de la aplicación:

-

Microsoft 365 Copilot en Teams:

- Si las transcripciones están desactivadas, no se admiten las funcionalidades de auditoría, exhibición de documentos electrónicos y retención.

- Si se hace referencia a las transcripciones, esta acción no se captura para la auditoría.

- Por Microsoft 365 Copilot Chat, Copilot no puede conservar actualmente como datos adjuntos en la nube, archivos a los que se hace referencia que devuelve a los usuarios. Los archivos a los que hacen referencia los usuarios se admiten para conservarse como datos adjuntos en la nube.