Tutorial: Validar dados usando SemPy e Grandes Expectativas (GX)

Neste tutorial, você aprenderá a usar o SemPy junto com o Great Expectations (GX) para executar a validação de dados em modelos semânticos do Power BI.

Este tutorial mostra como:

- Valide restrições num conjunto de dados no seu espaço de trabalho Fabric com a Fonte de Dados do Great Expectations (criada em link semântico).

- Configure um contexto de dados GX, ativos de dados e expectativas.

- Visualize os resultados da validação com um ponto de verificação GX.

- Utilize a ligação semântica para analisar dados brutos.

Pré-requisitos

Obtenha uma assinatura Microsoft Fabric. Ou inscreva-se para obter uma avaliação gratuita do Microsoft Fabric.

Inicie sessão no Microsoft Fabric.

Use o seletor de experiência no canto inferior esquerdo da página inicial para alternar para o Fabric.

- Selecione Workspaces no painel de navegação esquerdo para localizar e selecionar seu espaço de trabalho. Este espaço de trabalho torna-se o seu espaço de trabalho atual.

- Baixe o arquivo Retail Analysis Sample PBIX.pbix.

- No seu espaço de trabalho, selecione Importar>Relatório ou Relatório Paginado>A partir deste computador para carregar o ficheiro Retail Analysis Sample PBIX.pbix no seu espaço de trabalho.

Acompanhe no caderno

great_expectations_tutorial.ipynb é o notebook que acompanha o tutorial.

Para abrir o notebook que acompanha este tutorial, siga as instruções em Preparar o seu sistema para tutoriais de ciência de dados e importar o notebook para o seu espaço de trabalho.

Se preferir copiar e colar o código desta página, pode criar um novo bloco de notas.

Certifique-se de associar um lakehouse ao bloco de notas antes de começar a executar o código.

Configurar o portátil

Nesta seção, você configura um ambiente de notebook com os módulos e dados necessários.

- Instale o

SemPye as bibliotecas relevantes deGreat Expectationsdo PyPI, usando o recurso de instalação diretamente%pipno notebook.

# install libraries

%pip install semantic-link 'great-expectations<1.0' great_expectations_experimental great_expectations_zipcode_expectations

# load %%dax cell magic

%load_ext sempy

- Execute as importações necessárias de módulos que você precisará mais tarde:

import great_expectations as gx

from great_expectations.expectations.expectation import ExpectationConfiguration

from great_expectations_zipcode_expectations.expectations import expect_column_values_to_be_valid_zip5

Configurar o contexto de dados GX e a fonte de dados

Para começar com o Great Expectations, primeiro tens de configurar um GX Data Context. O contexto serve como um ponto de entrada para operações GX e contém todas as configurações relevantes.

context = gx.get_context()

Agora você pode adicionar seu conjunto de dados de malha a esse contexto como uma fonte de dados para começar a interagir com os dados. Este tutorial usa um modelo semântico de exemplo padrão do Power BI o arquivo .pbix de exemplo de análise de varejo.

ds = context.sources.add_fabric_powerbi("Retail Analysis Data Source", dataset="Retail Analysis Sample PBIX")

Especificar ativos de dados

Defina Ativos de Dados para especificar o subconjunto de dados com o qual você gostaria de trabalhar. O ativo pode ser tão simples quanto tabelas completas ou ser tão complexo quanto uma consulta DAX (Data Analysis Expressions) personalizada.

Aqui, você adicionará vários ativos:

- Tabela do Power BI

- Medida do Power BI

- Consulta DAX personalizada

- consulta da Visão de Gestão Dinâmica (DMV)

Tabela do Power BI

Adicione uma tabela do Power BI como um ativo de dados.

ds.add_powerbi_table_asset("Store Asset", table="Store")

Medida do Power BI

Se o conjunto de dados contiver medidas pré-configuradas, você adicionará as medidas como ativos seguindo uma API semelhante à evaluate_measuredo SemPy.

ds.add_powerbi_measure_asset(

"Total Units Asset",

measure="TotalUnits",

groupby_columns=["Time[FiscalYear]", "Time[FiscalMonth]"]

)

DAX

Se quiser definir suas próprias medidas ou ter mais controle sobre linhas específicas, você pode adicionar um ativo DAX com uma consulta DAX personalizada. Aqui, definimos uma medida Total Units Ratio dividindo duas medidas existentes.

ds.add_powerbi_dax_asset(

"Total Units YoY Asset",

dax_string=

"""

EVALUATE SUMMARIZECOLUMNS(

'Time'[FiscalYear],

'Time'[FiscalMonth],

"Total Units Ratio", DIVIDE([Total Units This Year], [Total Units Last Year])

)

"""

)

Consulta do registo de veículos

Em alguns casos, pode ser útil usar cálculos de de exibição de gerenciamento dinâmico (DMV) como parte do processo de validação de dados. Por exemplo, você pode acompanhar o número de violações de integridade referencial em seu conjunto de dados. Para obter mais informações, veja Dados limpos = relatórios mais rápidos.

ds.add_powerbi_dax_asset(

"Referential Integrity Violation",

dax_string=

"""

SELECT

[Database_name],

[Dimension_Name],

[RIVIOLATION_COUNT]

FROM $SYSTEM.DISCOVER_STORAGE_TABLES

"""

)

Expectativas

Para adicionar restrições específicas aos ativos, primeiro é necessário configurar Conjuntos de Expectativas. Depois de adicionar de expectativas de individuais a cada pacote, você pode atualizar o contexto de dados configurado no início com o novo pacote. Para obter uma lista completa das expectativas disponíveis, consulte o GX Expectations Gallery.

Comece por adicionar uma "Suite de Loja de Retalho" com duas expectativas:

- um código postal válido

- uma tabela com contagem de linhas entre 80 e 200

suite_store = context.add_expectation_suite("Retail Store Suite")

suite_store.add_expectation(ExpectationConfiguration("expect_column_values_to_be_valid_zip5", { "column": "PostalCode" }))

suite_store.add_expectation(ExpectationConfiguration("expect_table_row_count_to_be_between", { "min_value": 80, "max_value": 200 }))

context.add_or_update_expectation_suite(expectation_suite=suite_store)

Medida TotalUnits

Adicione um "Retail Measure Suite" com uma expectativa:

- Os valores da coluna devem ser superiores a 50.000

suite_measure = context.add_expectation_suite("Retail Measure Suite")

suite_measure.add_expectation(ExpectationConfiguration(

"expect_column_values_to_be_between",

{

"column": "TotalUnits",

"min_value": 50000

}

))

context.add_or_update_expectation_suite(expectation_suite=suite_measure)

Total Units Ratio DAX

Adicione uma "Retail DAX Suite" com uma única expectativa:

- Os valores de coluna para o Rácio de Unidades Totais devem estar entre 0,8 e 1,5

suite_dax = context.add_expectation_suite("Retail DAX Suite")

suite_dax.add_expectation(ExpectationConfiguration(

"expect_column_values_to_be_between",

{

"column": "[Total Units Ratio]",

"min_value": 0.8,

"max_value": 1.5

}

))

context.add_or_update_expectation_suite(expectation_suite=suite_dax)

Violações de Integridade Referencial (DMV)

Adicione um "Retail DMV Suite" com uma expectativa:

- o RIVIOLATION_COUNT deve ser 0

suite_dmv = context.add_expectation_suite("Retail DMV Suite")

# There should be no RI violations

suite_dmv.add_expectation(ExpectationConfiguration(

"expect_column_values_to_be_in_set",

{

"column": "RIVIOLATION_COUNT",

"value_set": [0]

}

))

context.add_or_update_expectation_suite(expectation_suite=suite_dmv)

Validação

Para realmente executar as expectativas especificadas em relação aos dados, primeiro crie um ponto de verificação e adicione-o ao contexto. Para obter mais informações sobre a configuração do ponto de verificação, consulte fluxo de trabalho de validação de dados.

checkpoint_config = {

"name": f"Retail Analysis Checkpoint",

"validations": [

{

"expectation_suite_name": "Retail Store Suite",

"batch_request": {

"datasource_name": "Retail Analysis Data Source",

"data_asset_name": "Store Asset",

},

},

{

"expectation_suite_name": "Retail Measure Suite",

"batch_request": {

"datasource_name": "Retail Analysis Data Source",

"data_asset_name": "Total Units Asset",

},

},

{

"expectation_suite_name": "Retail DAX Suite",

"batch_request": {

"datasource_name": "Retail Analysis Data Source",

"data_asset_name": "Total Units YoY Asset",

},

},

{

"expectation_suite_name": "Retail DMV Suite",

"batch_request": {

"datasource_name": "Retail Analysis Data Source",

"data_asset_name": "Referential Integrity Violation",

},

},

],

}

checkpoint = context.add_checkpoint(

**checkpoint_config

)

Agora execute a verificação e extraia os resultados como um DataFrame Pandas para formatação simples.

result = checkpoint.run()

Processe e imprima os seus resultados.

import pandas as pd

data = []

for run_result in result.run_results:

for validation_result in result.run_results[run_result]["validation_result"]["results"]:

row = {

"Batch ID": run_result.batch_identifier,

"type": validation_result.expectation_config.expectation_type,

"success": validation_result.success

}

row.update(dict(validation_result.result))

data.append(row)

result_df = pd.DataFrame.from_records(data)

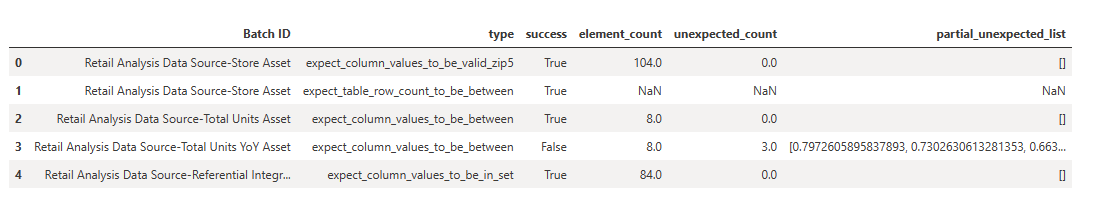

result_df[["Batch ID", "type", "success", "element_count", "unexpected_count", "partial_unexpected_list"]]

A partir desses resultados, você pode ver que todas as suas expectativas passaram pela validação, exceto o "Total de Unidades YoY Asset" que você definiu por meio de uma consulta DAX personalizada.

Diagnóstico

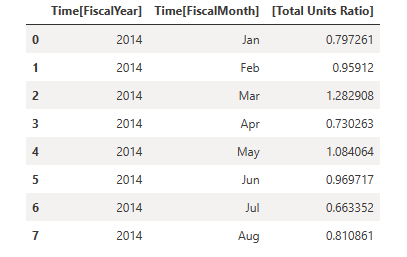

Usando o link semântico, podes obter os dados de origem para perceber quais são os anos exatos que estão fora do intervalo. O link semântico fornece uma mágica embutida para executar consultas DAX. Use o link semântico para executar a mesma consulta que você passou para o GX Data Asset e visualizar os valores resultantes.

%%dax "Retail Analysis Sample PBIX"

EVALUATE SUMMARIZECOLUMNS(

'Time'[FiscalYear],

'Time'[FiscalMonth],

"Total Units Ratio", DIVIDE([Total Units This Year], [Total Units Last Year])

)

Salve esses resultados em um DataFrame.

df = _

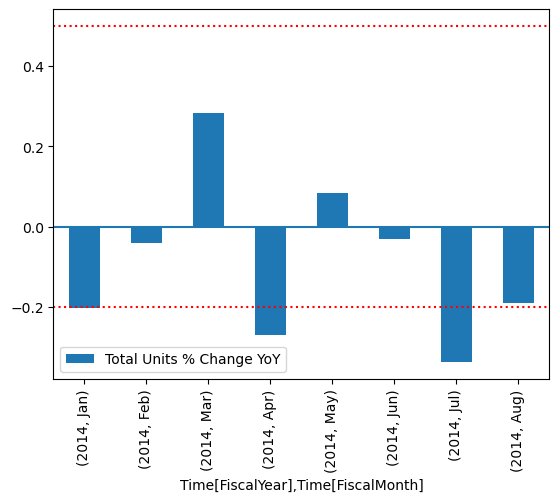

Plote os resultados.

import matplotlib.pyplot as plt

df["Total Units % Change YoY"] = (df["[Total Units Ratio]"] - 1)

df.set_index(["Time[FiscalYear]", "Time[FiscalMonth]"]).plot.bar(y="Total Units % Change YoY")

plt.axhline(0)

plt.axhline(-0.2, color="red", linestyle="dotted")

plt.axhline( 0.5, color="red", linestyle="dotted")

None

Pelo enredo, é possível ver que abril e julho estavam um pouco fora de alcance e podem então tomar outras medidas para investigar.

Armazenando a configuração GX

Como os dados em seu conjunto de dados mudam ao longo do tempo, convém executar novamente as validações GX que acabou de executar. Atualmente, o Contexto de Dados (que contém os Ativos de Dados conectados, os Pacotes de Expectativas e o Ponto de Verificação) vive de forma efêmica, mas pode ser convertido em um Contexto de Arquivo para uso futuro. Como alternativa, você pode instanciar um contexto de arquivo (consulte Instanciar um contexto de dados).

context = context.convert_to_file_context()

Agora que você salvou o contexto, copie o diretório gx para sua casa do lago.

Importante

Esta célula pressupõe que você adicionou um lakehouse ao bloco de anotações. Se não houver nenhuma casa do lago anexada, você não verá um erro, mas também não poderá obter o contexto mais tarde. Se adicionares um lakehouse agora mesmo, o kernel será reiniciado, portanto deverás executar novamente todo o notebook para voltar a este ponto.

# copy GX directory to attached lakehouse

!cp -r gx/ /lakehouse/default/Files/gx

Agora, contextos futuros podem ser criados com context = gx.get_context(project_root_dir="<your path here>") para usar todas as configurações deste tutorial.

Por exemplo, num novo notebook, anexe o mesmo lakehouse e use context = gx.get_context(project_root_dir="/lakehouse/default/Files/gx") para obter o contexto.

Conteúdo relacionado

Confira outros tutoriais para link semântico / SemPy:

- Tutorial: Limpar dados com dependências funcionais

- Tutorial: Analisar dependências funcionais em um modelo semântico de exemplo

- Tutorial: Extrair e calcular medidas do Power BI a partir de um bloco de anotações Jupyter

- Tutorial: Descubra relações em um modelo semântico, usando o link semântico

- Tutorial: Descubra relações no conjunto de dados Synthea, usando o link semântico