Omówienie — zarządzanie stanem zabezpieczeń sztucznej inteligencji

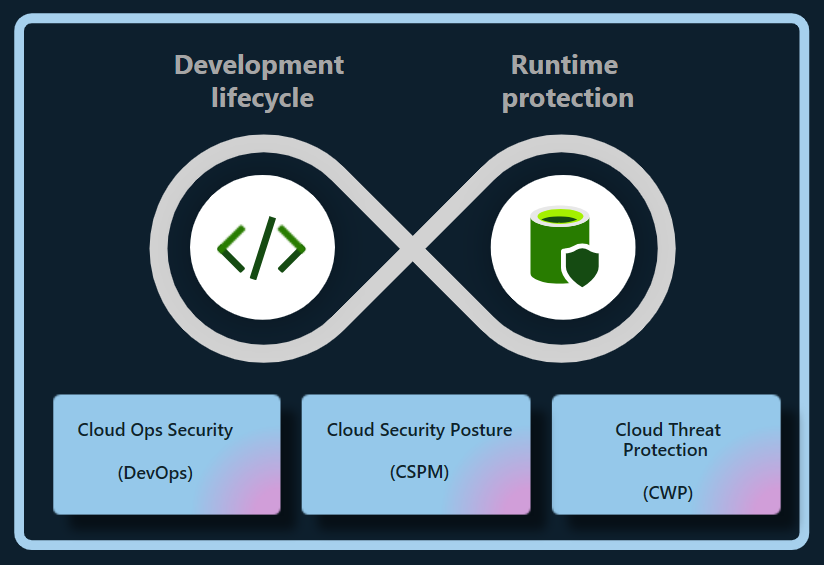

Plan zarządzania stanem zabezpieczeń w chmurze (CSPM) w usłudze Defender w Microsoft Defender dla Chmury zabezpiecza aplikacje sztucznej inteligencji utworzone przez przedsiębiorstwo, wiele lub chmurę hybrydową (obecnie platformę Azure i AWS) w całym cyklu życia. Defender dla Chmury zmniejsza ryzyko obciążeń sztucznej inteligencji między chmurami przez:

- Odkryj generowany rachunek za materiały sztucznej inteligencji (AI BOM), który obejmuje składniki aplikacji, dane i artefakty sztucznej inteligencji z kodu do chmury.

- Wzmocnienie poziomu zabezpieczeń aplikacji generujących sztuczną inteligencję dzięki wbudowanym rekomendacjom oraz eksplorowaniu i korygowaniu zagrożeń bezpieczeństwa.

- Korzystanie z analizy ścieżki ataku w celu identyfikowania i korygowania zagrożeń.

Ważne

Aby włączyć funkcje zarządzania stanem zabezpieczeń sztucznej inteligencji na koncie platformy AWS, które już:

- Jest połączony z kontem platformy Azure.

- Włączono CSPM w usłudze Defender.

- Ma typ uprawnień ustawiony jako Najniższy dostęp uprzywilejowany.

Należy ponownie skonfigurować uprawnienia dla tego łącznika, aby włączyć odpowiednie uprawnienia, wykonując następujące kroki:

- W witrynie Azure Portal przejdź do strony Ustawienia środowiska i wybierz odpowiedni łącznik platformy AWS.

- Wybierz pozycję Konfiguruj dostęp.

- Upewnij się, że typ uprawnień jest ustawiony na Wartość Najmniejszy dostęp uprzywilejowany.

- Wykonaj kroki 5–8 , aby zakończyć konfigurację.

Odnajdywanie aplikacji generacyjnych sztucznej inteligencji

Defender dla Chmury odnajduje obciążenia sztucznej inteligencji i identyfikuje szczegóły modelu BOM sztucznej inteligencji organizacji. Ta widoczność umożliwia identyfikowanie i rozwiązywanie problemów z lukami w zabezpieczeniach oraz ochronę generowanych aplikacji sztucznej inteligencji przed potencjalnymi zagrożeniami.

Defender dla Chmury automatycznie i stale odnajduje wdrożone obciążenia sztucznej inteligencji w następujących usługach:

- Azure OpenAI Service

- Azure Machine Learning

- Amazon Bedrock

Defender dla Chmury mogą również wykrywać luki w zabezpieczeniach w zależnościach biblioteki generowania sztucznej inteligencji, takich jak TensorFlow, PyTorch i Langchain, skanując kod źródłowy infrastruktury jako kodu (IaC) pod kątem błędów konfiguracji i obrazów kontenerów pod kątem luk w zabezpieczeniach. Regularne aktualizowanie lub stosowanie poprawek bibliotek może zapobiegać wykorzystaniu luk w zabezpieczeniach, chronić generujące aplikacje sztucznej inteligencji i utrzymywać ich integralność.

Dzięki tym funkcjom Defender dla Chmury zapewnia pełny wgląd obciążeń sztucznej inteligencji z kodu do chmury.

Zmniejszanie ryzyka generowania aplikacji sztucznej inteligencji

CSPM w usłudze Defender zapewnia kontekstowy wgląd w stan zabezpieczeń sztucznej inteligencji organizacji. W ramach obciążeń sztucznej inteligencji można zmniejszyć ryzyko, korzystając z zaleceń dotyczących zabezpieczeń i analizy ścieżki ataków.

Eksplorowanie zagrożeń przy użyciu zaleceń

Defender dla Chmury ocenia obciążenia sztucznej inteligencji. Wydaje zalecenia dotyczące tożsamości, bezpieczeństwa danych i ekspozycji internetowej w celu identyfikowania i określania priorytetów krytycznych problemów z zabezpieczeniami.

Wykrywanie błędów konfiguracji IaC

Zabezpieczenia devOps wykrywa błędy konfiguracji IaC, które mogą uwidaczniać generowanie aplikacji sztucznej inteligencji w celu luk w zabezpieczeniach, takich jak nadmiernie uwidocznione mechanizmy kontroli dostępu lub niezamierzone uwidocznione publicznie usługi. Te błędy konfiguracji mogą prowadzić do naruszeń danych, nieautoryzowanego dostępu i problemów ze zgodnością, zwłaszcza w przypadku obsługi rygorystycznych przepisów dotyczących prywatności danych.

Defender dla Chmury ocenia konfigurację aplikacji generacyjnych sztucznej inteligencji i udostępnia zalecenia dotyczące zabezpieczeń w celu poprawy stanu zabezpieczeń sztucznej inteligencji.

Aby zapobiec późniejszym złożonym problemom, należy skorygować wykryte błędy konfiguracji na wczesnym etapie cyklu programowania.

Bieżące kontrole zabezpieczeń IaC AI obejmują:

- Korzystanie z prywatnych punktów końcowych usługi Azure AI

- Ograniczanie punktów końcowych usługi Azure AI

- Używanie tożsamości zarządzanej dla kont usługi Azure AI

- Używanie uwierzytelniania opartego na tożsamościach dla kont usługi Azure AI

Eksplorowanie zagrożeń za pomocą analizy ścieżki ataku

Analiza ścieżki ataku wykrywa i zmniejsza ryzyko związane z obciążeniami sztucznej inteligencji. Uziemienia modeli sztucznej inteligencji do określonych danych i dostrajania wstępnie wytrenowanego modelu dla określonego zestawu danych w celu zwiększenia wydajności powiązanego zadania są etapami, w których dane mogą być uwidocznione.

Dzięki ciągłego monitorowania obciążeń sztucznej inteligencji analiza ścieżki ataków może identyfikować słabe strony i potencjalne luki w zabezpieczeniach oraz śledzić zalecenia. Ponadto rozszerza się ona na przypadki, w których dane i zasoby obliczeniowe są dystrybuowane między platformami Azure, AWS i GCP.