De Jupyter Notebook uitvoeren om een objectdetectiemodel te maken met AutoML

In deze sectie blijven we in het Jupyter-notebook werken om de stappen uit te voeren waarmee ons objectdetectiemodel wordt geproduceerd. Deze taak wordt uitgevoerd met Behulp van AutoML voor Computer Vision. Door deductie uit te voeren op een testvoorbeeld dat nog nooit is gezien door het model tijdens de training, kunt u uw model in actie zien.

De Jupyter Notebook uitvoeren om een objectdetectiemodel te maken met AutoML

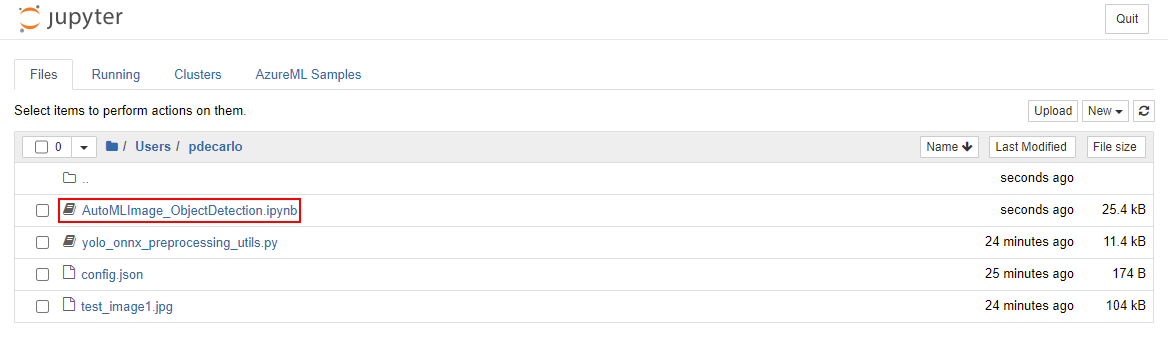

Als u dat nog niet hebt gedaan, gaat u naar uw Jupyter-werkruimte en selecteert u het bestand AutoMLImage_ObjectDetection.ipynb om het Jupyter-notebook te openen.

Ga door naar de sectie AutoML configureren voor afbeeldingstaken en begin met het uitvoeren van de cel in de standaard hyperparameterwaarden voor het opgegeven algoritme gebruiken. In deze stap wordt een AutoMLImageConfig gebruikt om een modeltrainingsconfiguratie te maken waarmee standaard hyperparameters worden toegewezen om een geoptimaliseerd objectdetectiemodel te produceren.

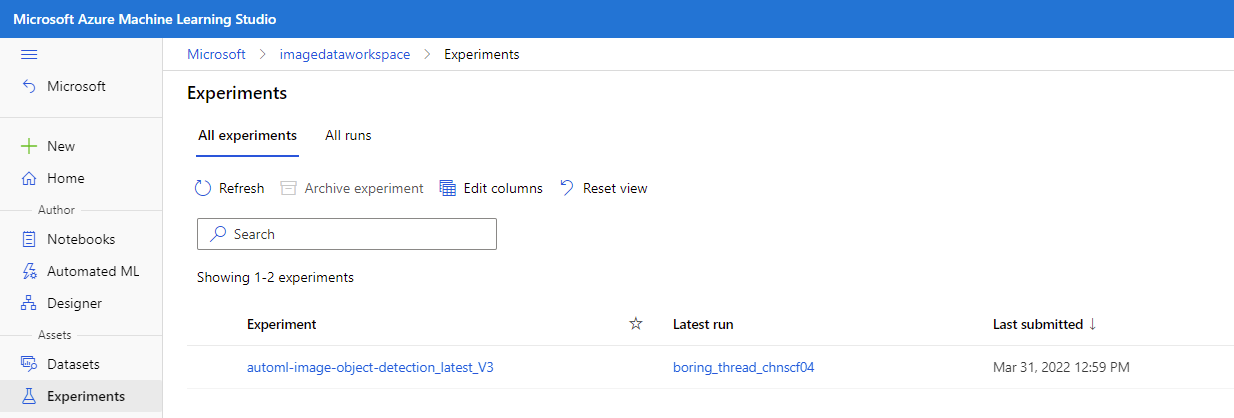

Ga door met het uitvoeren van de cellen in de sectie Een AutoML-uitvoering verzenden voor Computer Vision-taken . Met deze bewerking wordt een experimenttaak verzonden die wordt uitgevoerd op het trainingsexemplaren dat is toegewezen in de sectie Compute-doelinstallatie . Nadat u deze cellen hebt uitgevoerd, kunt u de voortgang in Azure Machine Learning-studio bewaken door de sectie Activa in het linkerdeelvenster te zoeken en Experimenten te selecteren.

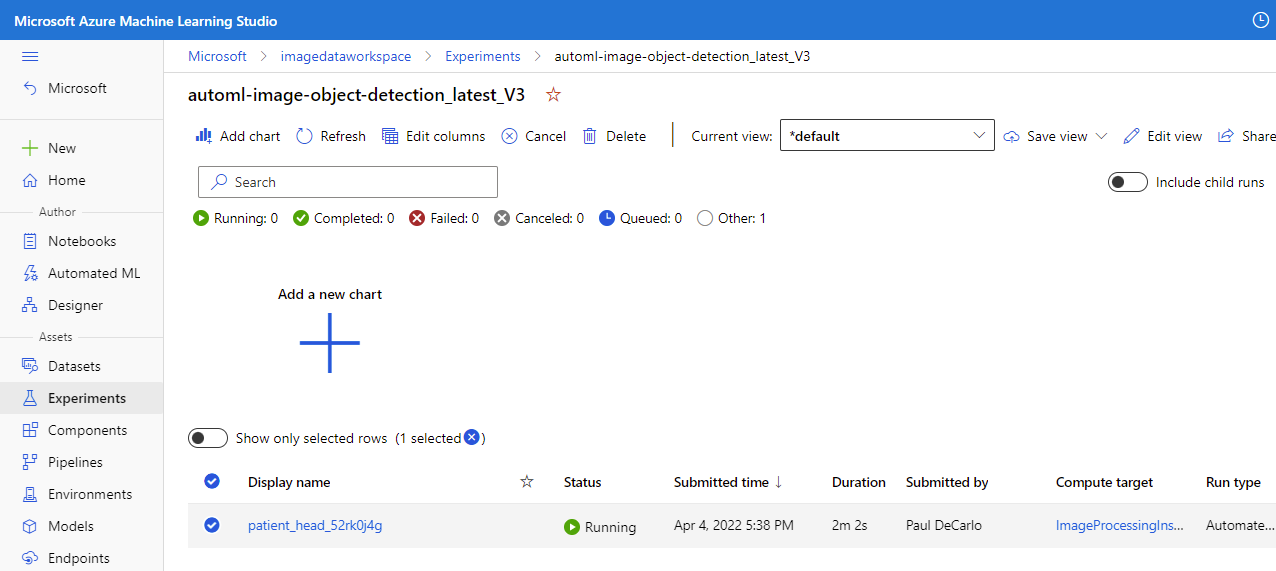

Vervolgens kunt u de actieve taak selecteren, die automl-image-object-detection_latest_V3 moet worden genoemd. Met deze actie kunt u de voortgang van de modeltraining bekijken.

Wanneer het experiment is voltooid, ziet u het volgende.

Selecteer de weergavenaam van de taak om de taakdetails weer te geven, waar u de resultaten van de modeltraining kunt bekijken.

Nu ons model is getraind, kunnen we doorgaan met het uitvoeren van de cellen in het gedeelte Het optimale visiemodel registreren vanuit de sectie AutoML-uitvoering . Dit proces selecteert automatisch de onderliggende uitvoering met de hoogste nauwkeurigheid.

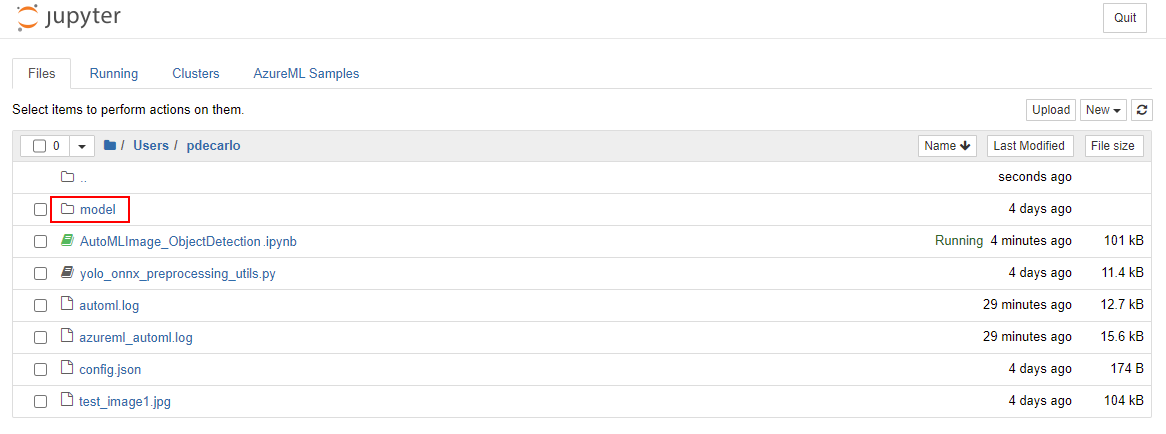

Ga door met het uitvoeren van de cellen in de sectie Labels downloaden van het model en andere gekoppelde bestanden . Er is een optionele cel die u kunt uitvoeren door een specifieke AutoML-run_id op te geven. De uitvoer van een van deze cellen levert het model en labelt het in een zojuist gemaakte modelmap die toegankelijk is in uw Jupyter-werkruimte. Ga naar uw Jupyter-werkruimte en open de map modellen en u ziet de uitvoer labels.json en model.onnx .

Selecteer labels.json en model.onnx en download vervolgens de uitvoerbestanden. Deze bestanden zijn het getrainde model en zijn gekoppelde labels.

Ga terug naar het Jupyter-notebook en voer alle cellen uit in de sectie Labels en ONNX-modelbestanden laden. Met deze stap worden de modeluitvoer en labels geladen om de uitvoering voor te bereiden.

Ga door met het uitvoeren van de cellen in de verwachte invoer- en uitvoergegevens ophalen voor een ONNX-model. Met deze taak wordt het model geanalyseerd om de invoer- en uitvoershapes te bepalen die het convolutionele neurale netwerk definiëren dat aanwezig is in het model.

Ga door met het uitvoeren van de cellen in de sectie Afbeeldingsdeductievoorverwerking . Hiermee wordt het test_image1.jpg voorbeeld dat eerder naar onze werkruimte is geüpload, vooraf verwerkt. De voorverwerkingsstap transformeert de afbeelding zodat deze overeenkomt met de verwachte invoershape die in de vorige stap is bepaald.

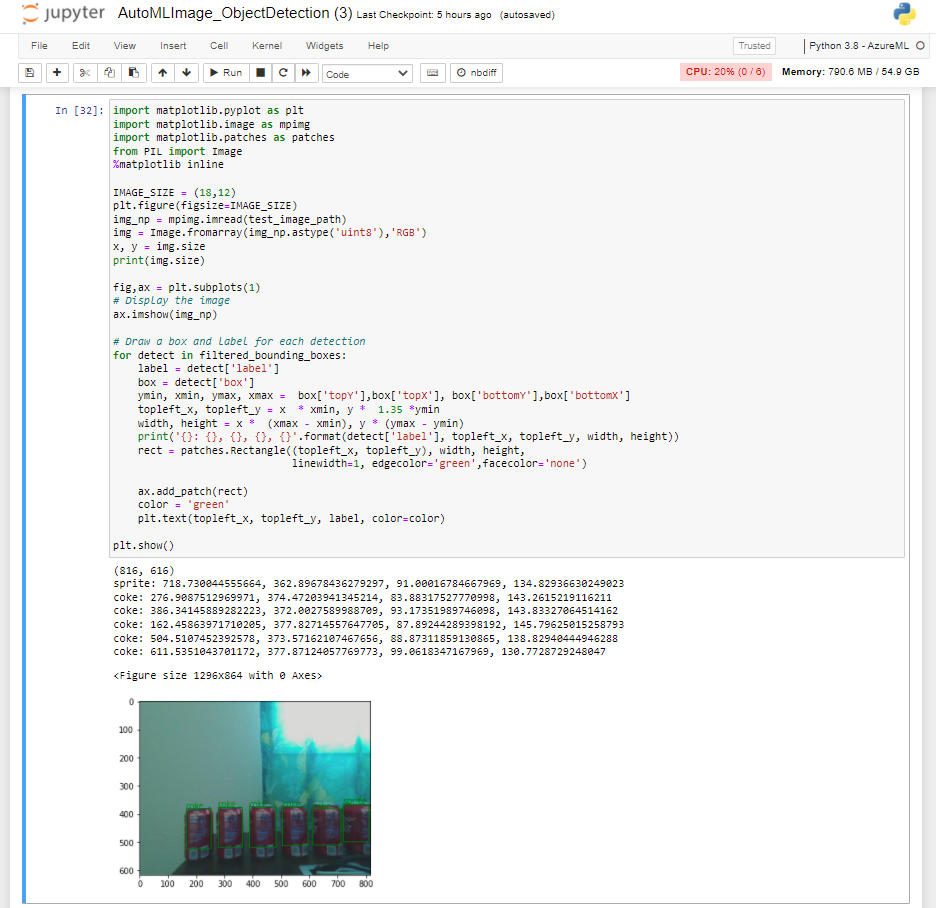

Ga door met het uitvoeren van de cellen in de sectie Objectdetectie met YOLO . In deze sectie wordt deductie uitgevoerd op het test_image1.jpg voorbeeld en wordt de uitvoer van het objectdetectiemodel visueel weergegeven in de laatste cel. Hier ziet u de nauwkeurigheid van uw model, omdat het object detecteert op een nooit eerder gezien afbeeldingsvoorbeeld.