Een verbinding configureren voor het gebruik van Azure AI-modeldeductie in uw AI-project

Belangrijk

Items die in dit artikel zijn gemarkeerd (preview) zijn momenteel beschikbaar als openbare preview. Deze preview wordt aangeboden zonder een service level agreement en we raden deze niet aan voor productieworkloads. Misschien worden bepaalde functies niet ondersteund of zijn de mogelijkheden ervan beperkt. Zie Aanvullende gebruiksvoorwaarden voor Microsoft Azure-previews voor meer informatie.

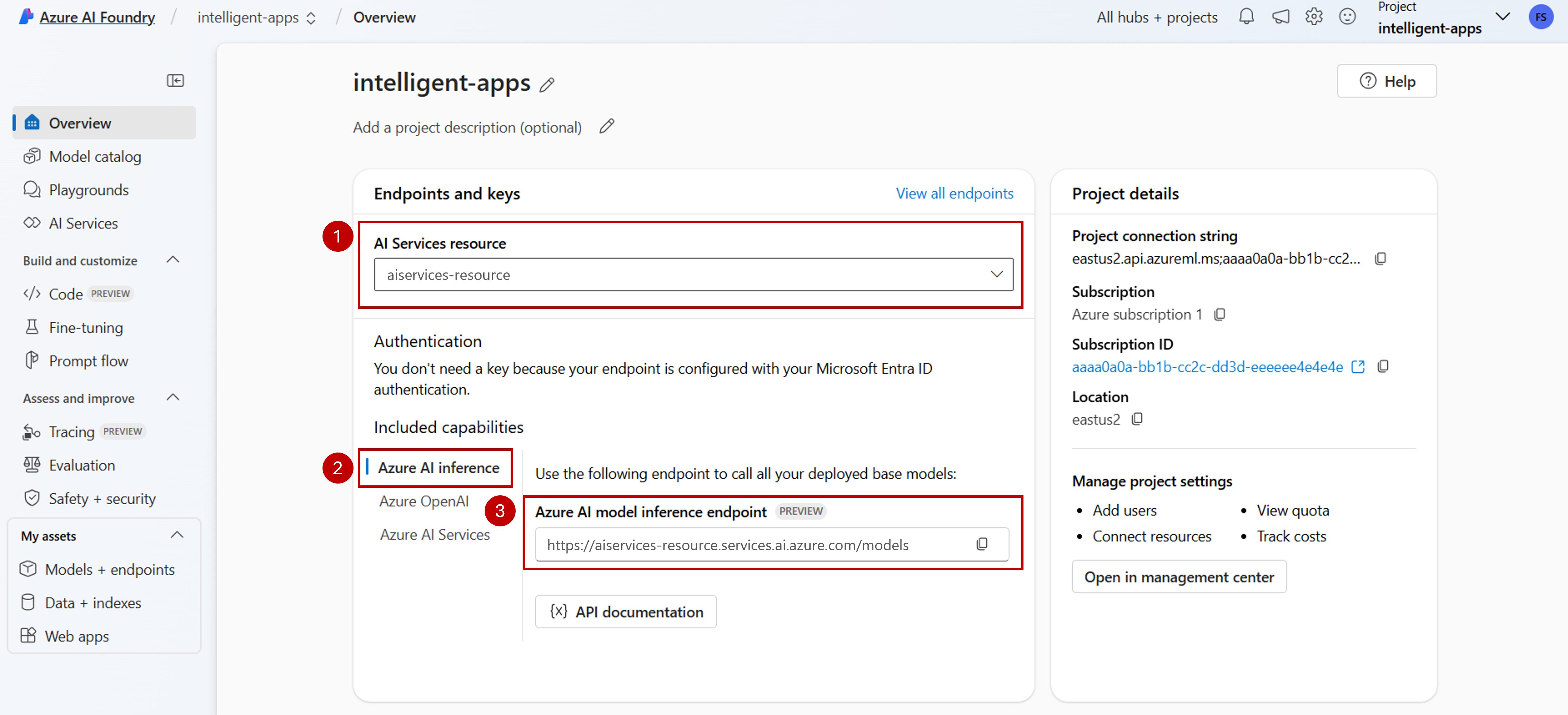

U kunt azure AI-modeldeductie gebruiken in uw projecten in Azure AI Foundry om bereiktoepassingen te maken en de beschikbare modellen te gebruiken/beheren. Als u de Azure AI-modeldeductieservice in uw project wilt gebruiken, moet u een verbinding maken met de Azure AI Services-resource.

In het volgende artikel wordt uitgelegd hoe u een verbinding maakt met de Azure AI Services-resource om het deductie-eindpunt te gebruiken.

Vereisten

U hebt het volgende nodig om dit artikel te voltooien:

Een Azure-abonnement. Als u GitHub-modellen gebruikt, kunt u uw ervaring upgraden en een Azure-abonnement maken in het proces. Lees Upgrade van GitHub-modellen naar Azure AI-modeldeductie als dat uw geval is.

Een Azure AI-servicesresource. Zie Een Azure AI Services-resource maken voor meer informatie.

- Een AI-project dat is verbonden met uw Azure AI Services-resource. U roept de stappen aan bij Deductieservice voor Azure AI-modellen configureren in mijn project in Azure AI Foundry.

Een verbinding toevoegen

U kunt een verbinding maken met een Azure AI-servicesresource met behulp van de volgende stappen:

Ga naar de Azure AI Foundry-portal.

Selecteer beheercentrum in de linkerbenedenhoek van het scherm.

Selecteer nieuwe verbinding in de sectie Verbindingen.

Selecteer Azure AI-services.

Zoek in de browser naar een bestaande Azure AI Services-resource in uw abonnement.

Selecteer Verbinding toevoegen.

De nieuwe verbinding wordt toegevoegd aan uw hub.

Ga terug naar de landingspagina van het project om door te gaan en selecteer nu de nieuwe gemaakte verbinding. Vernieuw de pagina als deze niet onmiddellijk wordt weergegeven.

Modelimplementaties bekijken in de verbonden resource

U kunt de modelimplementaties zien die beschikbaar zijn in de verbonden resource door de volgende stappen uit te voeren:

Ga naar de Azure AI Foundry-portal.

Selecteer modellen en eindpunten in de linkernavigatiebalk.

Op de pagina worden de modelimplementaties weergegeven die beschikbaar zijn voor uw, gegroepeerd op verbindingsnaam. Zoek de verbinding die u zojuist hebt gemaakt. Dit moet van het type Azure AI Services zijn.

Selecteer een modelimplementatie die u wilt inspecteren.

Op de detailpagina ziet u informatie over de specifieke implementatie. Als u het model wilt testen, kunt u de optie Openen in speeltuin gebruiken.

De Azure AI Foundry-speeltuin wordt weergegeven, waar u kunt communiceren met het opgegeven model.

Belangrijk

Items die in dit artikel zijn gemarkeerd (preview) zijn momenteel beschikbaar als openbare preview. Deze preview wordt aangeboden zonder een service level agreement en we raden deze niet aan voor productieworkloads. Misschien worden bepaalde functies niet ondersteund of zijn de mogelijkheden ervan beperkt. Zie Aanvullende gebruiksvoorwaarden voor Microsoft Azure-previews voor meer informatie.

U kunt azure AI-modeldeductie gebruiken in uw projecten in Azure AI Foundry om bereiktoepassingen te maken en de beschikbare modellen te gebruiken/beheren. Als u de Azure AI-modeldeductieservice in uw project wilt gebruiken, moet u een verbinding maken met de Azure AI Services-resource.

In het volgende artikel wordt uitgelegd hoe u een verbinding maakt met de Azure AI Services-resource om het deductie-eindpunt te gebruiken.

Vereisten

U hebt het volgende nodig om dit artikel te voltooien:

Een Azure-abonnement. Als u GitHub-modellen gebruikt, kunt u uw ervaring upgraden en een Azure-abonnement maken in het proces. Lees Upgrade van GitHub-modellen naar Azure AI-modeldeductie als dat uw geval is.

Een Azure AI-servicesresource. Zie Een Azure AI Services-resource maken voor meer informatie.

Installeer de Azure CLI en de

mlextensie voor Azure AI Foundry:az extension add -n mlIdentificeer de volgende informatie:

Uw Azure-abonnements-id.

De resourcenaam van uw Azure AI Services.

De resourcegroep waarin de Azure AI Services-resource wordt geïmplementeerd.

Een verbinding toevoegen

Als u een model wilt toevoegen, moet u eerst het model identificeren dat u wilt implementeren. U kunt als volgt een query uitvoeren op de beschikbare modellen:

Meld u aan bij uw Azure-abonnement:

az loginConfigureer de CLI om naar het project te verwijzen:

az account set --subscription <subscription> az configure --defaults workspace=<project-name> group=<resource-group> location=<location>Maak een verbindingsdefinitie:

connection.yml

name: <connection-name> type: aiservices endpoint: https://<ai-services-resourcename>.services.ai.azure.com api_key: <resource-api-key>Maak de verbinding:

az ml connection create -f connection.ymlOp dit moment is de verbinding beschikbaar voor verbruik.

Belangrijk

Items die in dit artikel zijn gemarkeerd (preview) zijn momenteel beschikbaar als openbare preview. Deze preview wordt aangeboden zonder een service level agreement en we raden deze niet aan voor productieworkloads. Misschien worden bepaalde functies niet ondersteund of zijn de mogelijkheden ervan beperkt. Zie Aanvullende gebruiksvoorwaarden voor Microsoft Azure-previews voor meer informatie.

U kunt azure AI-modeldeductie gebruiken in uw projecten in Azure AI Foundry om bereiktoepassingen te maken en de beschikbare modellen te gebruiken/beheren. Als u de Azure AI-modeldeductieservice in uw project wilt gebruiken, moet u een verbinding maken met de Azure AI Services-resource.

In het volgende artikel wordt uitgelegd hoe u een verbinding maakt met de Azure AI Services-resource om het deductie-eindpunt te gebruiken.

Vereisten

U hebt het volgende nodig om dit artikel te voltooien:

Een Azure-abonnement. Als u GitHub-modellen gebruikt, kunt u uw ervaring upgraden en een Azure-abonnement maken in het proces. Lees Upgrade van GitHub-modellen naar Azure AI-modeldeductie als dat uw geval is.

Een Azure AI-servicesresource. Zie Een Azure AI Services-resource maken voor meer informatie.

Een Azure AI-project met een AI Hub.

Installeer de Azure CLI.

Identificeer de volgende informatie:

Uw Azure-abonnements-id.

De resourcenaam van uw Azure AI Services.

Uw Azure AI Services-resource-id.

De naam van de Azure AI Hub waar het project wordt geïmplementeerd.

De resourcegroep waarin de Azure AI Services-resource wordt geïmplementeerd.

Een verbinding toevoegen

Gebruik de sjabloon

ai-services-connection-template.bicepom de verbinding te beschrijven:ai-services-connection-template.bicep

@description('Name of the hub where the connection will be created') param hubName string @description('Name of the connection') param name string @description('Category of the connection') param category string = 'AIServices' @allowed(['AAD', 'ApiKey', 'ManagedIdentity', 'None']) param authType string = 'AAD' @description('The endpoint URI of the connected service') param endpointUri string @description('The resource ID of the connected service') param resourceId string = '' @secure() param key string = '' resource connection 'Microsoft.MachineLearningServices/workspaces/connections@2024-04-01-preview' = { name: '${hubName}/${name}' properties: { category: category target: endpointUri authType: authType isSharedToAll: true credentials: authType == 'ApiKey' ? { key: key } : null metadata: { ApiType: 'Azure' ResourceId: resourceId } } }Voer de implementatie uit:

RESOURCE_GROUP="<resource-group-name>" ACCOUNT_NAME="<azure-ai-model-inference-name>" ENDPOINT_URI="https://<azure-ai-model-inference-name>.services.ai.azure.com" RESOURCE_ID="<resource-id>" HUB_NAME="<hub-name>" az deployment group create \ --resource-group $RESOURCE_GROUP \ --template-file ai-services-connection-template.bicep \ --parameters accountName=$ACCOUNT_NAME hubName=$HUB_NAME endpointUri=$ENDPOINT_URI resourceId=$RESOURCE_ID