Guida introduttiva: Aggiungere videochiamate 1:1 all'app

Per iniziare a usare Servizi di comunicazione di Azure, usare l'SDK per chiamate di Servizi di comunicazione per aggiungere 1 su 1 videochiamate all'app. Si apprenderà come avviare e rispondere a una videochiamata usando Azure Communication Services Calling SDK per JavaScript.

Codice di esempio

Se si vuole passare direttamente alla fine, è possibile scaricare questa guida introduttiva come esempio in GitHub.

Nota

È possibile accedere alle chiamate in uscita a un utente di Servizi di comunicazione di Azure usando la libreria dell'interfaccia utente di Servizi di comunicazione di Azure. La libreria dell'interfaccia utente consente agli sviluppatori di aggiungere un client di chiamata abilitato per VoIP all'applicazione con solo un paio di righe di codice.

Prerequisiti

Ottenere un account Azure con una sottoscrizione attiva. Creare un account gratuitamente.

È necessario avere Node.js 18. È possibile usare il programma di installazione msi per installarlo.

Creare una risorsa attiva di Servizi di comunicazione. Creare una risorsa di Servizi di comunicazione. Per questa guida introduttiva è necessario registrare la stringa di connessione.

Creare un token di accesso utente per creare un'istanza del client di chiamata. Vedere come creare e gestire i token di accesso utente. È anche possibile usare l'interfaccia della riga di comando di Azure ed eseguire il comando con la stringa di connessione per creare un utente e un token di accesso.

az communication identity token issue --scope voip --connection-string "yourConnectionString"Per informazioni dettagliate, vedere Usare l'interfaccia della riga di comando di Azure per creare e gestire i token di accesso.

Configurazione

Creare una nuova applicazione Node.js

Aprire il terminale o la finestra di comando per creare una nuova directory per l'app e passare a tale directory.

mkdir calling-quickstart && cd calling-quickstart

Eseguire npm init -y per creare un file package.json con le impostazioni predefinite.

npm init -y

Installare il pacchetto

Usare il comando npm install per installare SDK di chiamata di Servizi di comunicazione di Azure per JavaScript.

npm install @azure/communication-common --save

npm install @azure/communication-calling --save

Configurare il framework dell'app

Questa guida di avvio rapido usa webpack per aggregare gli asset dell'applicazione. Eseguire il comando seguente per installare i pacchetti npm webpack, webpack-cli e webpack-dev-server ed elencarli come dipendenze di sviluppo in package.json:

npm install copy-webpack-plugin@^11.0.0 webpack@^5.88.2 webpack-cli@^5.1.4 webpack-dev-server@^4.15.1 --save-dev

Ecco il codice:

Creare un file index.html nella directory radice del progetto. Questo file viene usato per configurare un layout di base che consente all'utente di inserire una videochiamata 1:1.

<!-- index.html -->

<!DOCTYPE html>

<html>

<head>

<title>Azure Communication Services - Calling Web SDK</title>

<link rel="stylesheet" type="text/css" href="styles.css"/>

</head>

<body>

<h4>Azure Communication Services - Calling Web SDK</h4>

<input id="user-access-token"

type="text"

placeholder="User access token"

style="margin-bottom:1em; width: 500px;"/>

<button id="initialize-call-agent" type="button">Initialize Call Agent</button>

<br>

<br>

<input id="callee-acs-user-id"

type="text"

placeholder="Enter callee's Azure Communication Services user identity in format: '8:acs:resourceId_userId'"

style="margin-bottom:1em; width: 500px; display: block;"/>

<button id="start-call-button" type="button" disabled="true">Start Call</button>

<button id="hangup-call-button" type="button" disabled="true">Hang up Call</button>

<button id="accept-call-button" type="button" disabled="true">Accept Call</button>

<button id="start-video-button" type="button" disabled="true">Start Video</button>

<button id="stop-video-button" type="button" disabled="true">Stop Video</button>

<br>

<br>

<div id="connectedLabel" style="color: #13bb13;" hidden>Call is connected!</div>

<br>

<div id="remoteVideosGallery" style="width: 40%;" hidden>Remote participants' video streams:</div>

<br>

<div id="localVideoContainer" style="width: 30%;" hidden>Local video stream:</div>

<!-- points to the bundle generated from client.js -->

<script src="./main.js"></script>

</body>

</html>

Le classi e le interfacce seguenti gestiscono alcune delle principali funzionalità del SDK Chiamate di Servizi di comunicazione di Azure:

| Nome | Descrizione |

|---|---|

CallClient |

Punto di ingresso principale di Calling SDK. |

AzureCommunicationTokenCredential |

Implementa l'interfaccia CommunicationTokenCredential usata per creare un'istanza di callAgent. |

CallAgent |

Usato per avviare e gestire le chiamate. |

DeviceManager |

Usato per gestire i dispositivi multimediali. |

Call |

Utilizzato per rappresentare una chiamata |

LocalVideoStream |

Usato per creare un flusso video locale per un dispositivo fotocamera nel sistema locale. |

RemoteParticipant |

Utilizzato per rappresentare un partecipante remoto nella chiamata |

RemoteVideoStream |

Utilizzato per rappresentare un flusso video remoto da un partecipante remoto. |

Nella directory radice del progetto creare un file denominato index.js in cui contenere la logica dell'applicazione per questa guida di avvio rapido. Aggiungere il codice seguente a index.js:

// Make sure to install the necessary dependencies

const { CallClient, VideoStreamRenderer, LocalVideoStream } = require('@azure/communication-calling');

const { AzureCommunicationTokenCredential } = require('@azure/communication-common');

const { AzureLogger, setLogLevel } = require("@azure/logger");

// Set the log level and output

setLogLevel('verbose');

AzureLogger.log = (...args) => {

console.log(...args);

};

// Calling web sdk objects

let callAgent;

let deviceManager;

let call;

let incomingCall;

let localVideoStream;

let localVideoStreamRenderer;

// UI widgets

let userAccessToken = document.getElementById('user-access-token');

let calleeAcsUserId = document.getElementById('callee-acs-user-id');

let initializeCallAgentButton = document.getElementById('initialize-call-agent');

let startCallButton = document.getElementById('start-call-button');

let hangUpCallButton = document.getElementById('hangup-call-button');

let acceptCallButton = document.getElementById('accept-call-button');

let startVideoButton = document.getElementById('start-video-button');

let stopVideoButton = document.getElementById('stop-video-button');

let connectedLabel = document.getElementById('connectedLabel');

let remoteVideosGallery = document.getElementById('remoteVideosGallery');

let localVideoContainer = document.getElementById('localVideoContainer');

/**

* Using the CallClient, initialize a CallAgent instance with a CommunicationUserCredential which will enable us to make outgoing calls and receive incoming calls.

* You can then use the CallClient.getDeviceManager() API instance to get the DeviceManager.

*/

initializeCallAgentButton.onclick = async () => {

try {

const callClient = new CallClient();

tokenCredential = new AzureCommunicationTokenCredential(userAccessToken.value.trim());

callAgent = await callClient.createCallAgent(tokenCredential)

// Set up a camera device to use.

deviceManager = await callClient.getDeviceManager();

await deviceManager.askDevicePermission({ video: true });

await deviceManager.askDevicePermission({ audio: true });

// Listen for an incoming call to accept.

callAgent.on('incomingCall', async (args) => {

try {

incomingCall = args.incomingCall;

acceptCallButton.disabled = false;

startCallButton.disabled = true;

} catch (error) {

console.error(error);

}

});

startCallButton.disabled = false;

initializeCallAgentButton.disabled = true;

} catch(error) {

console.error(error);

}

}

/**

* Place a 1:1 outgoing video call to a user

* Add an event listener to initiate a call when the `startCallButton` is clicked:

* First you have to enumerate local cameras using the deviceManager `getCameraList` API.

* In this quickstart we're using the first camera in the collection. Once the desired camera is selected, a

* LocalVideoStream instance will be constructed and passed within `videoOptions` as an item within the

* localVideoStream array to the call method. Once your call connects it will automatically start sending a video stream to the other participant.

*/

startCallButton.onclick = async () => {

try {

const localVideoStream = await createLocalVideoStream();

const videoOptions = localVideoStream ? { localVideoStreams: [localVideoStream] } : undefined;

call = callAgent.startCall([{ communicationUserId: calleeAcsUserId.value.trim() }], { videoOptions });

// Subscribe to the call's properties and events.

subscribeToCall(call);

} catch (error) {

console.error(error);

}

}

/**

* Accepting an incoming call with video

* Add an event listener to accept a call when the `acceptCallButton` is clicked:

* After subscribing to the `CallAgent.on('incomingCall')` event, you can accept the incoming call.

* You can pass the local video stream which you want to use to accept the call with.

*/

acceptCallButton.onclick = async () => {

try {

const localVideoStream = await createLocalVideoStream();

const videoOptions = localVideoStream ? { localVideoStreams: [localVideoStream] } : undefined;

call = await incomingCall.accept({ videoOptions });

// Subscribe to the call's properties and events.

subscribeToCall(call);

} catch (error) {

console.error(error);

}

}

/**

* Subscribe to a call obj.

* Listen for property changes and collection updates.

*/

subscribeToCall = (call) => {

try {

// Inspect the initial call.id value.

console.log(`Call Id: ${call.id}`);

//Subscribe to call's 'idChanged' event for value changes.

call.on('idChanged', () => {

console.log(`Call Id changed: ${call.id}`);

});

// Inspect the initial call.state value.

console.log(`Call state: ${call.state}`);

// Subscribe to call's 'stateChanged' event for value changes.

call.on('stateChanged', async () => {

console.log(`Call state changed: ${call.state}`);

if(call.state === 'Connected') {

connectedLabel.hidden = false;

acceptCallButton.disabled = true;

startCallButton.disabled = true;

hangUpCallButton.disabled = false;

startVideoButton.disabled = false;

stopVideoButton.disabled = false;

remoteVideosGallery.hidden = false;

} else if (call.state === 'Disconnected') {

connectedLabel.hidden = true;

startCallButton.disabled = false;

hangUpCallButton.disabled = true;

startVideoButton.disabled = true;

stopVideoButton.disabled = true;

console.log(`Call ended, call end reason={code=${call.callEndReason.code}, subCode=${call.callEndReason.subCode}}`);

}

});

call.on('isLocalVideoStartedChanged', () => {

console.log(`isLocalVideoStarted changed: ${call.isLocalVideoStarted}`);

});

console.log(`isLocalVideoStarted: ${call.isLocalVideoStarted}`);

call.localVideoStreams.forEach(async (lvs) => {

localVideoStream = lvs;

await displayLocalVideoStream();

});

call.on('localVideoStreamsUpdated', e => {

e.added.forEach(async (lvs) => {

localVideoStream = lvs;

await displayLocalVideoStream();

});

e.removed.forEach(lvs => {

removeLocalVideoStream();

});

});

// Inspect the call's current remote participants and subscribe to them.

call.remoteParticipants.forEach(remoteParticipant => {

subscribeToRemoteParticipant(remoteParticipant);

});

// Subscribe to the call's 'remoteParticipantsUpdated' event to be

// notified when new participants are added to the call or removed from the call.

call.on('remoteParticipantsUpdated', e => {

// Subscribe to new remote participants that are added to the call.

e.added.forEach(remoteParticipant => {

subscribeToRemoteParticipant(remoteParticipant)

});

// Unsubscribe from participants that are removed from the call

e.removed.forEach(remoteParticipant => {

console.log('Remote participant removed from the call.');

});

});

} catch (error) {

console.error(error);

}

}

/**

* Subscribe to a remote participant obj.

* Listen for property changes and collection updates.

*/

subscribeToRemoteParticipant = (remoteParticipant) => {

try {

// Inspect the initial remoteParticipant.state value.

console.log(`Remote participant state: ${remoteParticipant.state}`);

// Subscribe to remoteParticipant's 'stateChanged' event for value changes.

remoteParticipant.on('stateChanged', () => {

console.log(`Remote participant state changed: ${remoteParticipant.state}`);

});

// Inspect the remoteParticipants's current videoStreams and subscribe to them.

remoteParticipant.videoStreams.forEach(remoteVideoStream => {

subscribeToRemoteVideoStream(remoteVideoStream)

});

// Subscribe to the remoteParticipant's 'videoStreamsUpdated' event to be

// notified when the remoteParticipant adds new videoStreams and removes video streams.

remoteParticipant.on('videoStreamsUpdated', e => {

// Subscribe to new remote participant's video streams that were added.

e.added.forEach(remoteVideoStream => {

subscribeToRemoteVideoStream(remoteVideoStream)

});

// Unsubscribe from remote participant's video streams that were removed.

e.removed.forEach(remoteVideoStream => {

console.log('Remote participant video stream was removed.');

})

});

} catch (error) {

console.error(error);

}

}

/**

* Subscribe to a remote participant's remote video stream obj.

* You have to subscribe to the 'isAvailableChanged' event to render the remoteVideoStream. If the 'isAvailable' property

* changes to 'true', a remote participant is sending a stream. Whenever availability of a remote stream changes

* you can choose to destroy the whole 'Renderer', a specific 'RendererView' or keep them, but this will result in displaying blank video frame.

*/

subscribeToRemoteVideoStream = async (remoteVideoStream) => {

let renderer = new VideoStreamRenderer(remoteVideoStream);

let view;

let remoteVideoContainer = document.createElement('div');

remoteVideoContainer.className = 'remote-video-container';

let loadingSpinner = document.createElement('div');

loadingSpinner.className = 'loading-spinner';

remoteVideoStream.on('isReceivingChanged', () => {

try {

if (remoteVideoStream.isAvailable) {

const isReceiving = remoteVideoStream.isReceiving;

const isLoadingSpinnerActive = remoteVideoContainer.contains(loadingSpinner);

if (!isReceiving && !isLoadingSpinnerActive) {

remoteVideoContainer.appendChild(loadingSpinner);

} else if (isReceiving && isLoadingSpinnerActive) {

remoteVideoContainer.removeChild(loadingSpinner);

}

}

} catch (e) {

console.error(e);

}

});

const createView = async () => {

// Create a renderer view for the remote video stream.

view = await renderer.createView();

// Attach the renderer view to the UI.

remoteVideoContainer.appendChild(view.target);

remoteVideosGallery.appendChild(remoteVideoContainer);

}

// Remote participant has switched video on/off

remoteVideoStream.on('isAvailableChanged', async () => {

try {

if (remoteVideoStream.isAvailable) {

await createView();

} else {

view.dispose();

remoteVideosGallery.removeChild(remoteVideoContainer);

}

} catch (e) {

console.error(e);

}

});

// Remote participant has video on initially.

if (remoteVideoStream.isAvailable) {

try {

await createView();

} catch (e) {

console.error(e);

}

}

}

/**

* Start your local video stream.

* This will send your local video stream to remote participants so they can view it.

*/

startVideoButton.onclick = async () => {

try {

const localVideoStream = await createLocalVideoStream();

await call.startVideo(localVideoStream);

} catch (error) {

console.error(error);

}

}

/**

* Stop your local video stream.

* This will stop your local video stream from being sent to remote participants.

*/

stopVideoButton.onclick = async () => {

try {

await call.stopVideo(localVideoStream);

} catch (error) {

console.error(error);

}

}

/**

* To render a LocalVideoStream, you need to create a new instance of VideoStreamRenderer, and then

* create a new VideoStreamRendererView instance using the asynchronous createView() method.

* You may then attach view.target to any UI element.

*/

createLocalVideoStream = async () => {

const camera = (await deviceManager.getCameras())[0];

if (camera) {

return new LocalVideoStream(camera);

} else {

console.error(`No camera device found on the system`);

}

}

/**

* Display your local video stream preview in your UI

*/

displayLocalVideoStream = async () => {

try {

localVideoStreamRenderer = new VideoStreamRenderer(localVideoStream);

const view = await localVideoStreamRenderer.createView();

localVideoContainer.hidden = false;

localVideoContainer.appendChild(view.target);

} catch (error) {

console.error(error);

}

}

/**

* Remove your local video stream preview from your UI

*/

removeLocalVideoStream = async() => {

try {

localVideoStreamRenderer.dispose();

localVideoContainer.hidden = true;

} catch (error) {

console.error(error);

}

}

/**

* End current call

*/

hangUpCallButton.addEventListener("click", async () => {

// end the current call

await call.hangUp();

});

Nella directory radice del progetto creare un file denominato styles.css in cui contenere lo styling dell'applicazione per questa guida di avvio rapido. Aggiungere il codice seguente a styles.css:

/**

* CSS for styling the loading spinner over the remote video stream

*/

.remote-video-container {

position: relative;

}

.loading-spinner {

border: 12px solid #f3f3f3;

border-radius: 50%;

border-top: 12px solid #ca5010;

width: 100px;

height: 100px;

-webkit-animation: spin 2s linear infinite; /* Safari */

animation: spin 2s linear infinite;

position: absolute;

margin: auto;

top: 0;

bottom: 0;

left: 0;

right: 0;

transform: translate(-50%, -50%);

}

@keyframes spin {

0% { transform: rotate(0deg); }

100% { transform: rotate(360deg); }

}

/* Safari */

@-webkit-keyframes spin {

0% { -webkit-transform: rotate(0deg); }

100% { -webkit-transform: rotate(360deg); }

}

Aggiungere il codice del server locale webpack

Creare un file nella directory radice del progetto denominato webpack.config.js per contenere la logica del server locale per questa guida introduttiva. Aggiungere il codice seguente a webpack.config.js:

const path = require('path');

const CopyPlugin = require("copy-webpack-plugin");

module.exports = {

mode: 'development',

entry: './index.js',

output: {

filename: 'main.js',

path: path.resolve(__dirname, 'dist'),

},

devServer: {

static: {

directory: path.join(__dirname, './')

},

},

plugins: [

new CopyPlugin({

patterns: [

'./index.html'

]

}),

]

};

Eseguire il codice

Usare webpack-dev-server per compilare ed eseguire l'app. Eseguire il comando seguente per aggregare l'host dell'applicazione in un server Web locale:

npx webpack serve --config webpack.config.js

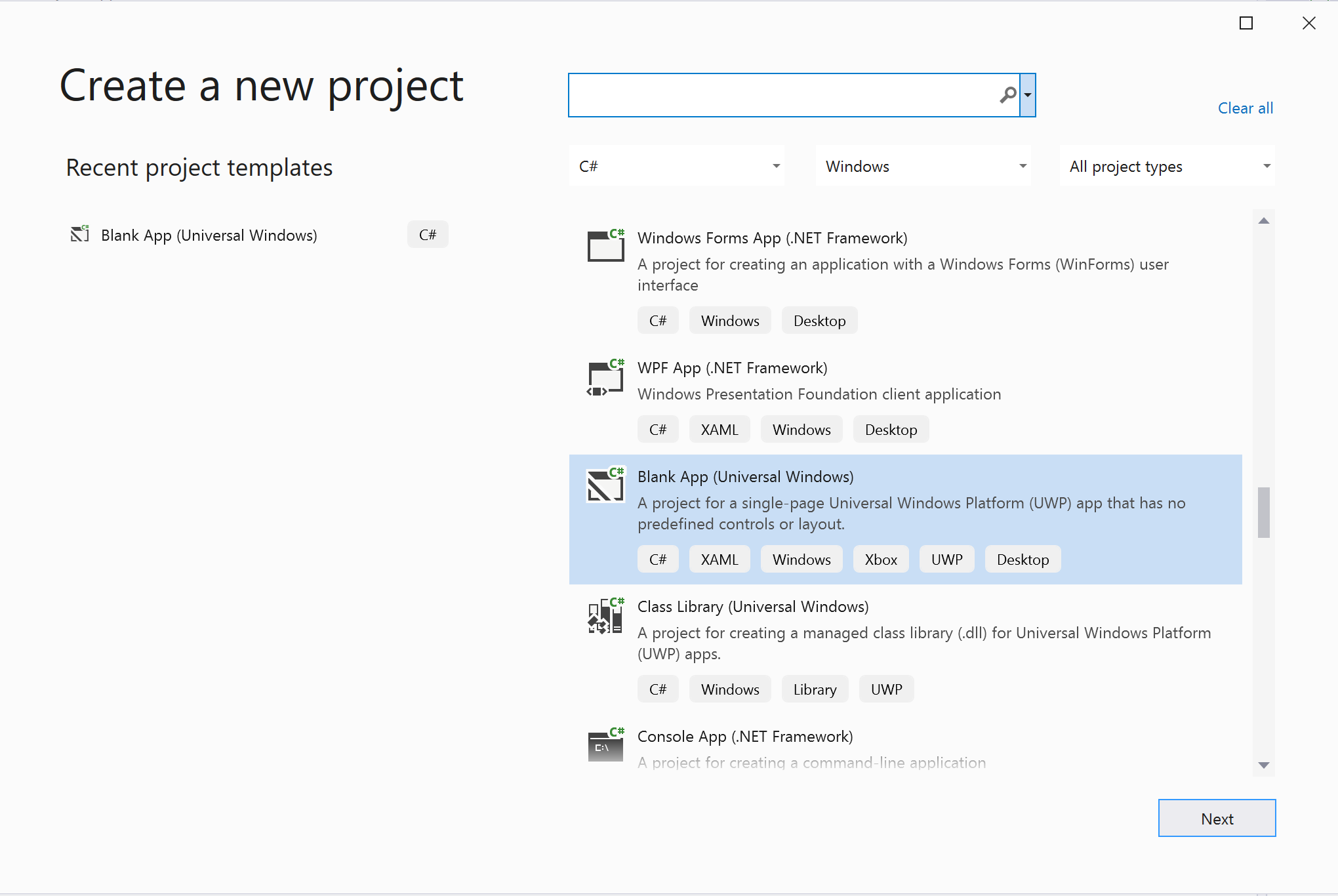

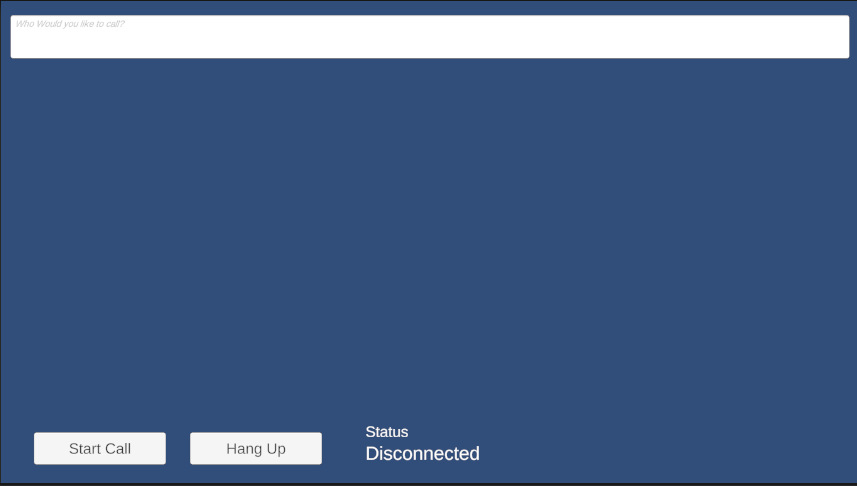

Aprire il browser e in due schede passare a http://localhost:8080/.You dovrebbe visualizzare la schermata seguente:

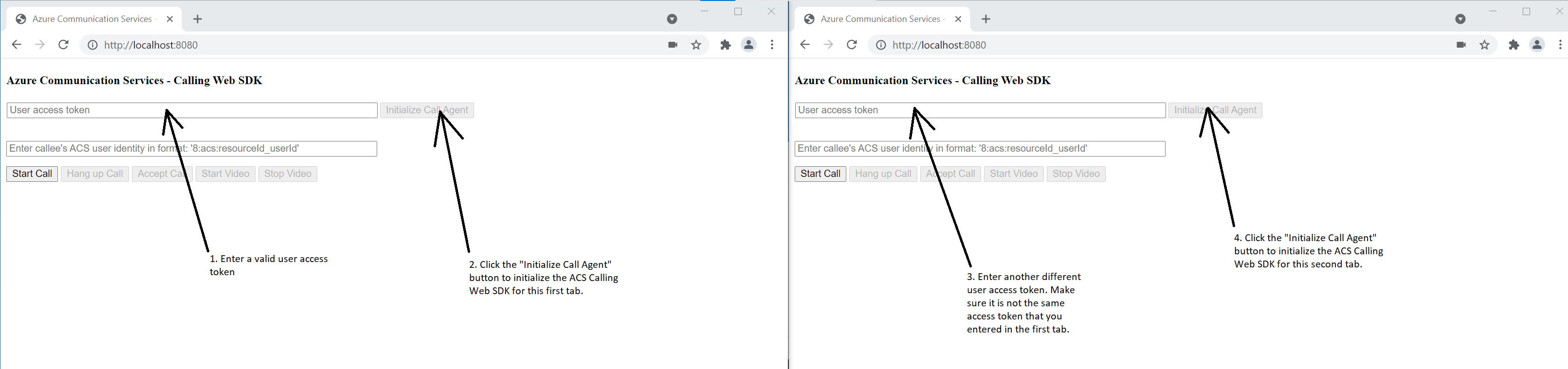

Nella prima scheda immettere un token di accesso utente valido e nell'altra scheda immettere un altro token di accesso utente valido diverso.

Se non sono già disponibili token da usare, fare riferimento alla documentazione del token di accesso utente.

In entrambe le schede fare clic sui pulsanti "Inizializza agente di chiamata". Verrà visualizzata la schermata seguente:

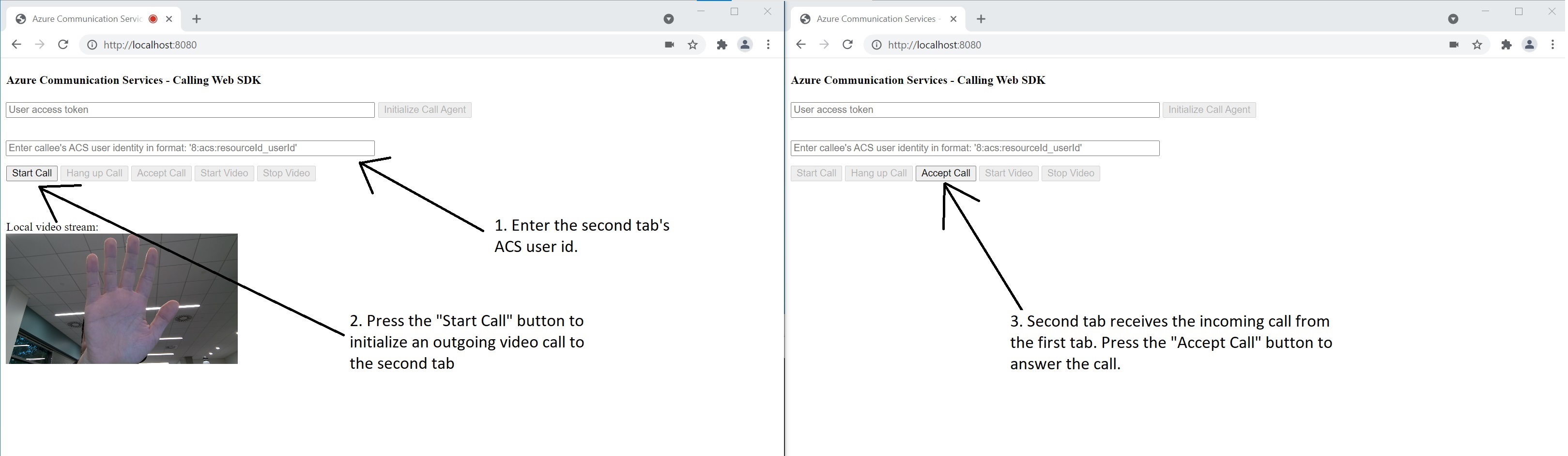

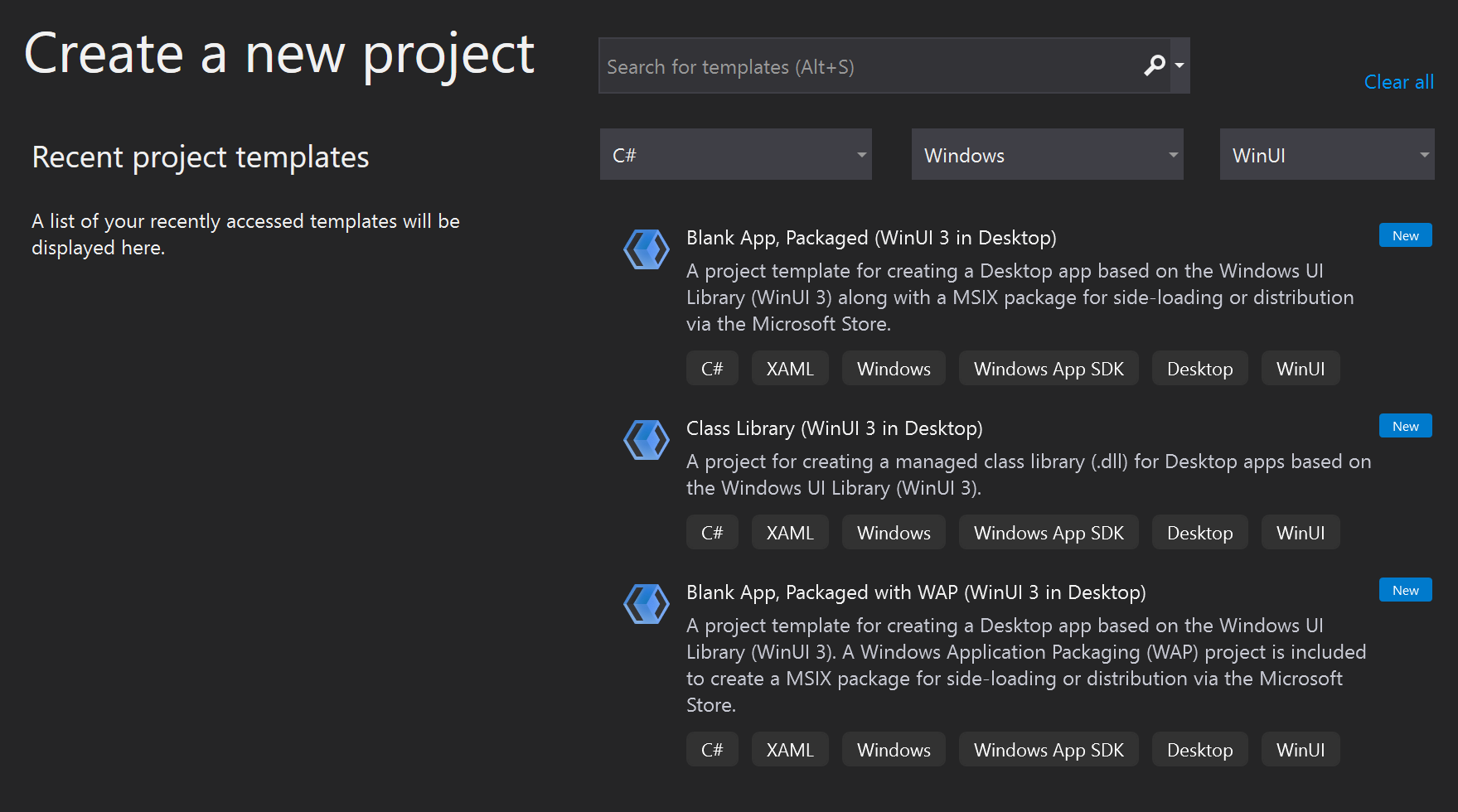

Nella prima scheda immettere l'identità utente di Servizi di comunicazione di Azure della seconda scheda e fare clic sul pulsante "Avvia chiamata". La prima scheda avvia la chiamata in uscita alla seconda scheda e il pulsante "Accetta chiamata" della seconda scheda diventa abilitato:

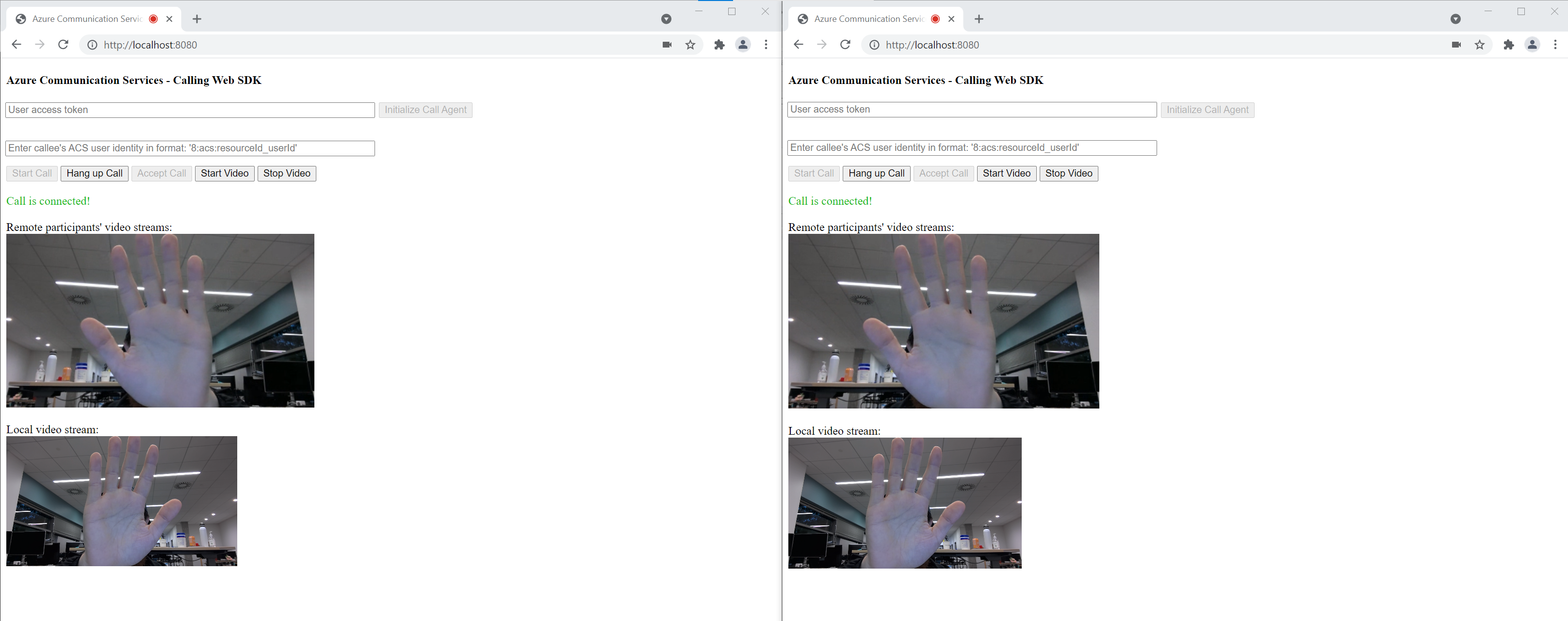

Nella seconda scheda fare clic sul pulsante "Accetta chiamata" e la chiamata viene avviata e connetti. Verrà visualizzata la schermata seguente:

Entrambe le schede sono ora correttamente in una videochiamata da 1 a 1. Entrambe le schede possono ascoltare l'audio dell'altro e vedere tra loro il flusso video.

Introduzione a Servizi di comunicazione di Azure, con l'aggiunta di videochiamate all'app tramite la libreria client Chiamate di Servizi di comunicazione. Informazioni su come includere videochiamate 1:1 e come creare o partecipare a chiamate di gruppo. È anche possibile avviare, rispondere e partecipare a una videochiamata usando Azure Communication Services Calling SDK per Android.

Per iniziare a usare il codice di esempio, è possibile scaricare l'app di esempio.

Prerequisiti

Un account Azure con una sottoscrizione attiva. Creare un account gratuitamente.

Android Studio per creare l'applicazione Android.

Una risorsa di Servizi di comunicazione distribuita. Creare una risorsa di Servizi di comunicazione. Per questa guida introduttiva è necessario registrare la stringa di connessione.

Un token di accesso utente per il servizio di comunicazione di Azure. È anche possibile usare l'interfaccia della riga di comando di Azure ed eseguire il comando con la stringa di connessione per creare un utente e un token di accesso.

az communication identity token issue --scope voip --connection-string "yourConnectionString"Per informazioni dettagliate, vedere Usare l'interfaccia della riga di comando di Azure per creare e gestire i token di accesso.

Creare un'app Android con un'attività vuota

In Android Studio selezionare Avviare un nuovo progetto di Android Studio.

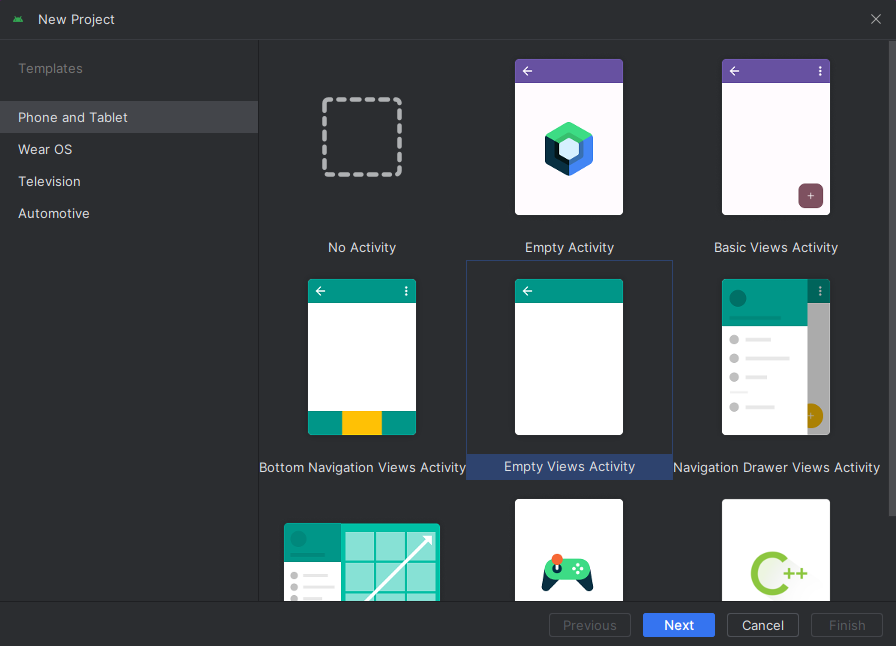

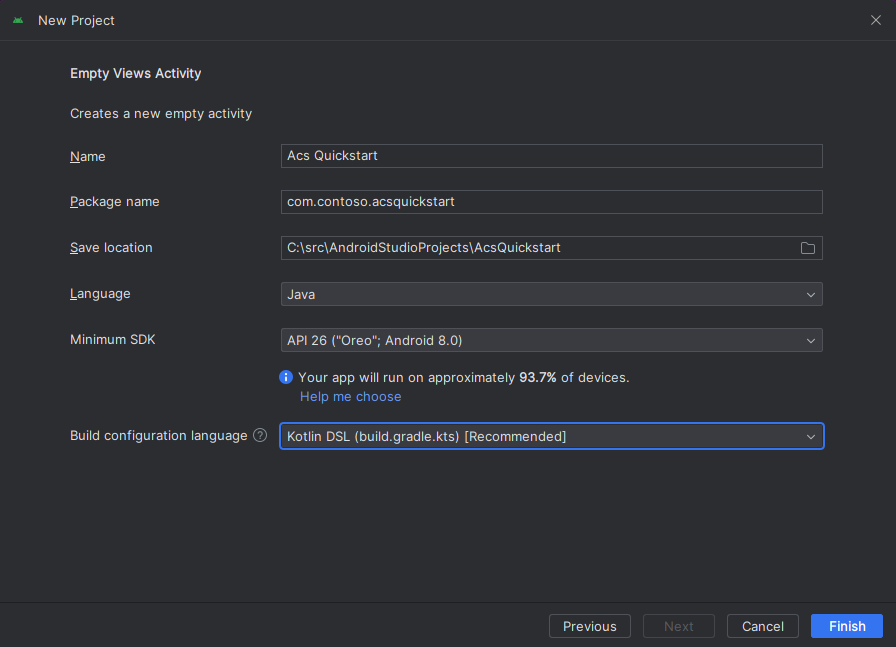

In Telefono e Tabletselezionare il modello di progetto Attività vuota.

Per l’SDK minimo, selezionare API 26: Android 8.0 (Oreo) o versione successiva. Vedere Le versioni del supporto sdk.

Installare il pacchetto

Individuare il livello di progetto build.gradle, e aggiungere mavenCentral() all'elenco dei repository in buildscript e allprojects

buildscript {

repositories {

...

mavenCentral()

...

}

}

allprojects {

repositories {

...

mavenCentral()

...

}

}

Quindi, nel livello del modulo build.gradleaggiungere le righe seguenti alle sezioni dependencies e android:

android {

...

packagingOptions {

pickFirst 'META-INF/*'

}

compileOptions {

sourceCompatibility JavaVersion.VERSION_1_8

targetCompatibility JavaVersion.VERSION_1_8

}

}

dependencies {

...

implementation 'com.azure.android:azure-communication-calling:2.0.0'

...

}

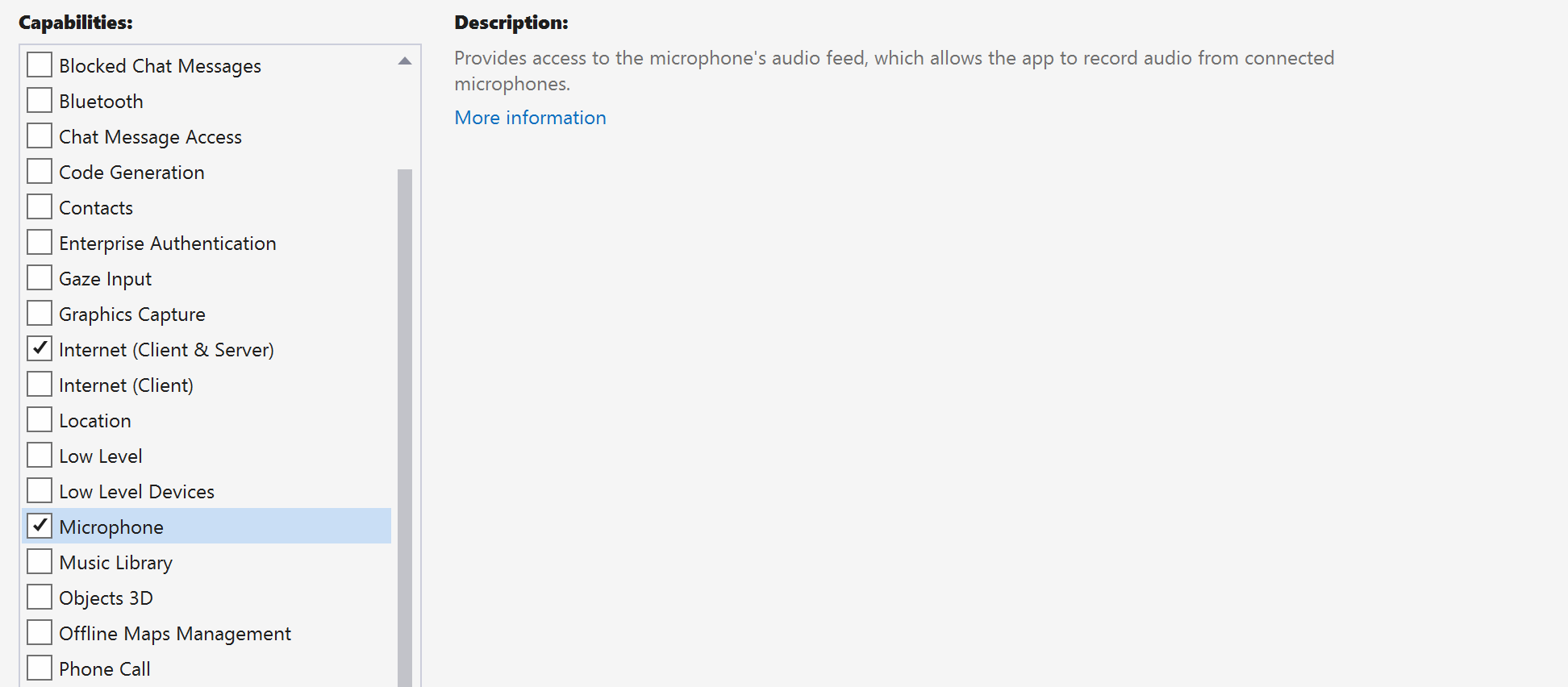

Aggiungere autorizzazioni al manifesto dell'applicazione

Per richiedere le autorizzazioni necessarie per effettuare una chiamata, è prima necessario dichiarare le autorizzazioni nel manifesto dell'applicazione (app/src/main/AndroidManifest.xml). Sostituire il contenuto del file con il codice seguente:

<?xml version="1.0" encoding="utf-8"?>

<manifest xmlns:android="http://schemas.android.com/apk/res/android"

package="com.contoso.acsquickstart">

<uses-permission android:name="android.permission.INTERNET" />

<uses-permission android:name="android.permission.ACCESS_NETWORK_STATE" />

<uses-permission android:name="android.permission.ACCESS_WIFI_STATE" />

<uses-permission android:name="android.permission.RECORD_AUDIO" />

<uses-permission android:name="android.permission.CAMERA" />

<application

android:allowBackup="true"

android:icon="@mipmap/ic_launcher"

android:label="@string/app_name"

android:roundIcon="@mipmap/ic_launcher_round"

android:supportsRtl="true"

android:theme="@style/AppTheme">

<!--Our Calling SDK depends on the Apache HTTP SDK.

When targeting Android SDK 28+, this library needs to be explicitly referenced.

See https://developer.android.com/about/versions/pie/android-9.0-changes-28#apache-p-->

<uses-library android:name="org.apache.http.legacy" android:required="false"/>

<activity android:name=".MainActivity">

<intent-filter>

<action android:name="android.intent.action.MAIN" />

<category android:name="android.intent.category.LAUNCHER" />

</intent-filter>

</activity>

</application>

</manifest>

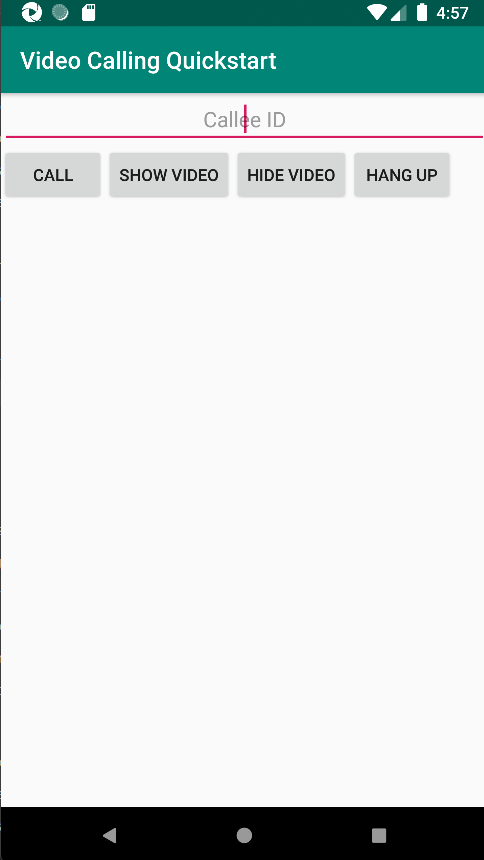

Configurare il layout per l'app

È necessario un input di testo per l'ID del destinatario della chiamata o l'ID del gruppo di chiamata, un pulsante per effettuare la chiamata e un ulteriore pulsante per riagganciare la chiamata.

Sono necessari anche due pulsanti per attivare e disattivare il video locale. È necessario inserire due contenitori per flussi video locali e remoti. È possibile aggiungere questi pulsanti tramite la finestra di progettazione o modificando il codice XML di layout.

Passare a app/src/main/res/layout/activity_main.xml e sostituire il contenuto del file con il codice seguente:

<?xml version="1.0" encoding="utf-8"?>

<androidx.constraintlayout.widget.ConstraintLayout xmlns:android="http://schemas.android.com/apk/res/android"

xmlns:app="http://schemas.android.com/apk/res-auto"

xmlns:tools="http://schemas.android.com/tools"

android:layout_width="match_parent"

android:layout_height="match_parent"

tools:context=".MainActivity">

<LinearLayout

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:orientation="vertical">

<EditText

android:id="@+id/call_id"

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:ems="10"

android:gravity="center"

android:hint="Callee ID"

android:inputType="textPersonName"

app:layout_constraintBottom_toTopOf="@+id/call_button"

app:layout_constraintEnd_toEndOf="parent"

app:layout_constraintStart_toStartOf="parent"

app:layout_constraintTop_toTopOf="parent"

app:layout_constraintVertical_bias="0.064" />

<LinearLayout

android:layout_width="match_parent"

android:layout_height="wrap_content">

<Button

android:id="@+id/call_button"

android:layout_width="wrap_content"

android:layout_height="wrap_content"

android:layout_marginBottom="16dp"

android:gravity="center"

android:text="Call"

app:layout_constraintBottom_toBottomOf="parent"

app:layout_constraintEnd_toEndOf="parent"

app:layout_constraintStart_toStartOf="parent" />

<Button

android:id="@+id/show_preview"

android:layout_width="wrap_content"

android:layout_height="wrap_content"

android:layout_marginBottom="16dp"

android:gravity="center"

android:text="Show Video"

app:layout_constraintBottom_toBottomOf="parent"

app:layout_constraintEnd_toEndOf="parent"

app:layout_constraintStart_toStartOf="parent" />

<Button

android:id="@+id/hide_preview"

android:layout_width="wrap_content"

android:layout_height="wrap_content"

android:layout_marginBottom="16dp"

android:gravity="center"

android:text="Hide Video"

app:layout_constraintBottom_toBottomOf="parent"

app:layout_constraintEnd_toEndOf="parent"

app:layout_constraintStart_toStartOf="parent" />

<Button

android:id="@+id/hang_up"

android:layout_width="wrap_content"

android:layout_height="wrap_content"

android:layout_marginBottom="16dp"

android:gravity="center"

android:text="Hang Up"

app:layout_constraintBottom_toBottomOf="parent"

app:layout_constraintEnd_toEndOf="parent"

app:layout_constraintStart_toStartOf="parent" />

</LinearLayout>

<ScrollView

android:layout_width="match_parent"

android:layout_height="wrap_content">

<GridLayout

android:id="@+id/remotevideocontainer"

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:columnCount="2"

android:rowCount="2"

android:padding="10dp"></GridLayout>

</ScrollView>

</LinearLayout>

<FrameLayout

android:layout_width="match_parent"

android:layout_height="match_parent">

<LinearLayout

android:id="@+id/localvideocontainer"

android:layout_width="180dp"

android:layout_height="300dp"

android:layout_gravity="right|bottom"

android:orientation="vertical"

android:padding="10dp">

<Button

android:id="@+id/switch_source"

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:gravity="center"

android:text="Switch Source"

android:visibility="invisible" />

</LinearLayout>

</FrameLayout>

</androidx.constraintlayout.widget.ConstraintLayout>

Creare lo scaffolding e i binding per l'attività principale

Dopo aver creato il layout, è possibile aggiungere le associazioni e lo scaffolding di base dell'attività. L'attività gestisce la richiesta delle autorizzazioni in fase di esecuzione, la creazione dell'agente di chiamata e l'effettuazione della chiamata quando viene premuto il pulsante.

Il metodo onCreate viene sottoposto a override per richiamare getAllPermissions e createAgent, e aggiungere le associazioni per il pulsante di chiamata. Questo evento si verifica una sola volta quando viene creata l'attività. Per altre informazioni su onCreate, vedere la guida sul ciclo di vita dell'attività.

Passare al file MainActivity.java e sostituire il contenuto con il codice seguente:

package com.example.videocallingquickstart;

import androidx.appcompat.app.AppCompatActivity;

import androidx.core.app.ActivityCompat;

import android.Manifest;

import android.content.pm.PackageManager;

import android.media.AudioManager;

import android.os.Bundle;

import android.util.DisplayMetrics;

import android.util.Log;

import android.view.View;

import android.widget.Button;

import android.widget.EditText;

import android.widget.GridLayout;

import android.widget.Toast;

import android.widget.LinearLayout;

import android.content.Context;

import com.azure.android.communication.calling.CallState;

import com.azure.android.communication.calling.CallingCommunicationException;

import com.azure.android.communication.calling.ParticipantsUpdatedListener;

import com.azure.android.communication.calling.PropertyChangedEvent;

import com.azure.android.communication.calling.PropertyChangedListener;

import com.azure.android.communication.calling.StartCallOptions;

import com.azure.android.communication.calling.VideoDeviceInfo;

import com.azure.android.communication.common.CommunicationIdentifier;

import com.azure.android.communication.common.CommunicationTokenCredential;

import com.azure.android.communication.calling.CallAgent;

import com.azure.android.communication.calling.CallClient;

import com.azure.android.communication.calling.DeviceManager;

import com.azure.android.communication.calling.VideoOptions;

import com.azure.android.communication.calling.LocalVideoStream;

import com.azure.android.communication.calling.VideoStreamRenderer;

import com.azure.android.communication.calling.VideoStreamRendererView;

import com.azure.android.communication.calling.CreateViewOptions;

import com.azure.android.communication.calling.ScalingMode;

import com.azure.android.communication.calling.IncomingCall;

import com.azure.android.communication.calling.Call;

import com.azure.android.communication.calling.AcceptCallOptions;

import com.azure.android.communication.calling.ParticipantsUpdatedEvent;

import com.azure.android.communication.calling.RemoteParticipant;

import com.azure.android.communication.calling.RemoteVideoStream;

import com.azure.android.communication.calling.RemoteVideoStreamsEvent;

import com.azure.android.communication.calling.RendererListener;

import com.azure.android.communication.common.CommunicationUserIdentifier;

import com.azure.android.communication.common.MicrosoftTeamsUserIdentifier;

import com.azure.android.communication.common.PhoneNumberIdentifier;

import com.azure.android.communication.common.UnknownIdentifier;

import java.util.ArrayList;

import java.util.HashSet;

import java.util.List;

import java.util.HashMap;

import java.util.Map;

import java.util.concurrent.ExecutionException;

import java.util.concurrent.Executors;

import java.util.ArrayList;

import java.util.HashSet;

import java.util.List;

import java.util.HashMap;

import java.util.Map;

import java.util.concurrent.ExecutionException;

import java.util.concurrent.Executors;

public class MainActivity extends AppCompatActivity {

private CallAgent callAgent;

private VideoDeviceInfo currentCamera;

private LocalVideoStream currentVideoStream;

private DeviceManager deviceManager;

private IncomingCall incomingCall;

private Call call;

VideoStreamRenderer previewRenderer;

VideoStreamRendererView preview;

final Map<Integer, StreamData> streamData = new HashMap<>();

private boolean renderRemoteVideo = true;

private ParticipantsUpdatedListener remoteParticipantUpdatedListener;

private PropertyChangedListener onStateChangedListener;

final HashSet<String> joinedParticipants = new HashSet<>();

Button switchSourceButton;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

getAllPermissions();

createAgent();

handleIncomingCall();

Button callButton = findViewById(R.id.call_button);

callButton.setOnClickListener(l -> startCall());

Button hangupButton = findViewById(R.id.hang_up);

hangupButton.setOnClickListener(l -> hangUp());

Button startVideo = findViewById(R.id.show_preview);

startVideo.setOnClickListener(l -> turnOnLocalVideo());

Button stopVideo = findViewById(R.id.hide_preview);

stopVideo.setOnClickListener(l -> turnOffLocalVideo());

switchSourceButton = findViewById(R.id.switch_source);

switchSourceButton.setOnClickListener(l -> switchSource());

setVolumeControlStream(AudioManager.STREAM_VOICE_CALL);

}

/**

* Request each required permission if the app doesn't already have it.

*/

private void getAllPermissions() {

// See section on requesting permissions

}

/**

* Create the call agent for placing calls

*/

private void createAgent() {

// See section on creating the call agent

}

/**

* Handle incoming calls

*/

private void handleIncomingCall() {

// See section on answering incoming call

}

/**

* Place a call to the callee id provided in `callee_id` text input.

*/

private void startCall() {

// See section on starting the call

}

/**

* End calls

*/

private void hangUp() {

// See section on ending the call

}

/**

* Mid-call operations

*/

public void turnOnLocalVideo() {

// See section

}

public void turnOffLocalVideo() {

// See section

}

/**

* Change the active camera for the next available

*/

public void switchSource() {

// See section

}

}

Richiedere autorizzazioni in fase di esecuzione

Per Android 6.0 e versioni successive (livello API 23) e targetSdkVersion 23 o versione successiva, le autorizzazioni vengono concesse in fase di esecuzione invece che durante l'installazione dell'app. Per supportare questo requisito, è possibile implementare getAllPermissions per chiamare ActivityCompat.checkSelfPermission e ActivityCompat.requestPermissions per ogni autorizzazione richiesta.

/**

* Request each required permission if the app doesn't already have it.

*/

private void getAllPermissions() {

String[] requiredPermissions = new String[]{Manifest.permission.RECORD_AUDIO, Manifest.permission.CAMERA, Manifest.permission.WRITE_EXTERNAL_STORAGE, Manifest.permission.READ_PHONE_STATE};

ArrayList<String> permissionsToAskFor = new ArrayList<>();

for (String permission : requiredPermissions) {

if (ActivityCompat.checkSelfPermission(this, permission) != PackageManager.PERMISSION_GRANTED) {

permissionsToAskFor.add(permission);

}

}

if (!permissionsToAskFor.isEmpty()) {

ActivityCompat.requestPermissions(this, permissionsToAskFor.toArray(new String[0]), 1);

}

}

Nota

Quando si progetta l'app, valutare quando dovranno essere richieste queste autorizzazioni. È consigliabile che vengano richieste quando è necessario, non prima. Per altre informazioni, vedere la guida alle autorizzazioni di Android..

Modello a oggetti

Le classi e le interfacce seguenti gestiscono alcune delle principali funzionalità del SDK Chiamate di Servizi di comunicazione di Azure:

| Nome | Descrizione |

|---|---|

CallClient |

Punto di ingresso principale di Calling SDK. |

CallAgent |

Usato per avviare e gestire le chiamate. |

CommunicationTokenCredential |

Usato come credenziale del token per creare un'istanza di CallAgent. |

CommunicationIdentifier |

Utilizzato come tipo diverso di partecipante che potrebbe far parte di una chiamata. |

Creare un agente dal token di accesso utente

È necessario un token utente per creare un agente di chiamata autenticato. In genere, questo token viene generato da un servizio con l'autenticazione specifica per l'applicazione. Per altre informazioni sui token di accesso utente, vedere Token di accesso utente.

Per la guida di avvio rapido, sostituire <User_Access_Token> con un token di accesso utente generato per la risorsa dei servizi di comunicazione di Azure.

/**

* Create the call agent for placing calls

*/

private void createAgent() {

Context context = this.getApplicationContext();

String userToken = "<USER_ACCESS_TOKEN>";

try {

CommunicationTokenCredential credential = new CommunicationTokenCredential(userToken);

CallClient callClient = new CallClient();

deviceManager = callClient.getDeviceManager(context).get();

callAgent = callClient.createCallAgent(getApplicationContext(), credential).get();

} catch (Exception ex) {

Toast.makeText(context, "Failed to create call agent.", Toast.LENGTH_SHORT).show();

}

}

Avviare una videochiamata usando l'agente di chiamata

È possibile effettuare la chiamata usando l'agente di chiamata. Tutto quello che bisogna fare è fornire un elenco di ID del destinatario della chiamata e le opzioni di chiamata.

Per effettuare una chiamata con video, è necessario enumerare le fotocamere locali usando l'API deviceManagergetCameras. Dopo aver selezionato una fotocamera desiderata, usarla per costruire un'istanza LocalVideoStream. Passarlo quindi in videoOptions come elemento nella matrice localVideoStream a un metodo di chiamata. Quando la chiamata si connette, avvia automaticamente l'invio di un flusso video dalla fotocamera selezionata all'altro partecipante.

private void startCall() {

Context context = this.getApplicationContext();

EditText callIdView = findViewById(R.id.call_id);

String callId = callIdView.getText().toString();

ArrayList<CommunicationIdentifier> participants = new ArrayList<CommunicationIdentifier>();

List<VideoDeviceInfo> cameras = deviceManager.getCameras();

StartCallOptions options = new StartCallOptions();

if(!cameras.isEmpty()) {

currentCamera = getNextAvailableCamera(null);

currentVideoStream = new LocalVideoStream(currentCamera, context);

LocalVideoStream[] videoStreams = new LocalVideoStream[1];

videoStreams[0] = currentVideoStream;

VideoOptions videoOptions = new VideoOptions(videoStreams);

options.setVideoOptions(videoOptions);

showPreview(currentVideoStream);

}

participants.add(new CommunicationUserIdentifier(callId));

call = callAgent.startCall(

context,

participants,

options);

//Subscribe to events on updates of call state and remote participants

remoteParticipantUpdatedListener = this::handleRemoteParticipantsUpdate;

onStateChangedListener = this::handleCallOnStateChanged;

call.addOnRemoteParticipantsUpdatedListener(remoteParticipantUpdatedListener);

call.addOnStateChangedListener(onStateChangedListener);

}

In questa guida introduttiva si fa affidamento sulla funzione getNextAvailableCamera per selezionare la fotocamera usata dalla chiamata. La funzione accetta l'enumerazione delle fotocamere come input e scorre l'elenco per ottenere la fotocamera successiva disponibile. Se l'argomento è null, la funzione seleziona il primo dispositivo nell'elenco. Se non sono disponibili fotocamere quando si seleziona Avvia chiamata, viene avviata una chiamata audio. Tuttavia, se il partecipante remoto ha risposto con il video, è comunque possibile visualizzare il flusso video remoto.

private VideoDeviceInfo getNextAvailableCamera(VideoDeviceInfo camera) {

List<VideoDeviceInfo> cameras = deviceManager.getCameras();

int currentIndex = 0;

if (camera == null) {

return cameras.isEmpty() ? null : cameras.get(0);

}

for (int i = 0; i < cameras.size(); i++) {

if (camera.getId().equals(cameras.get(i).getId())) {

currentIndex = i;

break;

}

}

int newIndex = (currentIndex + 1) % cameras.size();

return cameras.get(newIndex);

}

Dopo aver costruito un'istanza LocalVideoStream, è possibile creare un renderer per visualizzarlo nell'interfaccia utente.

private void showPreview(LocalVideoStream stream) {

previewRenderer = new VideoStreamRenderer(stream, this);

LinearLayout layout = findViewById(R.id.localvideocontainer);

preview = previewRenderer.createView(new CreateViewOptions(ScalingMode.FIT));

preview.setTag(0);

runOnUiThread(() -> {

layout.addView(preview);

switchSourceButton.setVisibility(View.VISIBLE);

});

}

Per consentire all'utente di attivare o disattivare l'origine video locale, usare switchSource. Questo metodo seleziona la fotocamera disponibile successiva e la definisce come flusso locale.

public void switchSource() {

if (currentVideoStream != null) {

try {

currentCamera = getNextAvailableCamera(currentCamera);

currentVideoStream.switchSource(currentCamera).get();

} catch (InterruptedException e) {

e.printStackTrace();

} catch (ExecutionException e) {

e.printStackTrace();

}

}

}

Accettare una chiamata in arrivo

È possibile ottenere una chiamata in arrivo sottoscrivendo addOnIncomingCallListener su callAgent.

private void handleIncomingCall() {

callAgent.addOnIncomingCallListener((incomingCall) -> {

this.incomingCall = incomingCall;

Executors.newCachedThreadPool().submit(this::answerIncomingCall);

});

}

Per accettare una chiamata con la videocamera, enumerare le fotocamere locali usando l'API deviceManagergetCameras. Selezionare una fotocamera e costruire un'istanza di LocalVideoStream. Passarlo in acceptCallOptions prima di chiamare il metodo accept su un oggetto call.

private void answerIncomingCall() {

Context context = this.getApplicationContext();

if (incomingCall == null){

return;

}

AcceptCallOptions acceptCallOptions = new AcceptCallOptions();

List<VideoDeviceInfo> cameras = deviceManager.getCameras();

if(!cameras.isEmpty()) {

currentCamera = getNextAvailableCamera(null);

currentVideoStream = new LocalVideoStream(currentCamera, context);

LocalVideoStream[] videoStreams = new LocalVideoStream[1];

videoStreams[0] = currentVideoStream;

VideoOptions videoOptions = new VideoOptions(videoStreams);

acceptCallOptions.setVideoOptions(videoOptions);

showPreview(currentVideoStream);

}

try {

call = incomingCall.accept(context, acceptCallOptions).get();

} catch (InterruptedException e) {

e.printStackTrace();

} catch (ExecutionException e) {

e.printStackTrace();

}

//Subscribe to events on updates of call state and remote participants

remoteParticipantUpdatedListener = this::handleRemoteParticipantsUpdate;

onStateChangedListener = this::handleCallOnStateChanged;

call.addOnRemoteParticipantsUpdatedListener(remoteParticipantUpdatedListener);

call.addOnStateChangedListener(onStateChangedListener);

}

Partecipanti remoti e flussi video remoti

Tutti i partecipanti remoti sono disponibili tramite il metodo getRemoteParticipants() in un'istanza di chiamata. Quando la chiamata diventa connessa (CallState.CONNECTED), è possibile accedere ai partecipanti da remoto della chiamata e gestire i flussi video remoti.

Quando si avvia una chiamata o si risponde a una chiamata in arrivo, è necessario sottoscrivere l'evento addOnRemoteParticipantsUpdatedListener per gestire i partecipanti remoti.

remoteParticipantUpdatedListener = this::handleRemoteParticipantsUpdate;

call.addOnRemoteParticipantsUpdatedListener(remoteParticipantUpdatedListener);

Quando si usano listener di eventi definiti all'interno della stessa classe, associare il listener a una variabile. Passare la variabile come argomento per aggiungere e rimuovere i metodi del listener.

Se si tenta di passare il listener direttamente come argomento, si perde il riferimento a tale listener. Java crea nuove istanze di questi listener, non facendo riferimento a quelli creati in precedenza. Non è possibile rimuovere le istanze precedenti, perché non si dispone di un riferimento a tali istanze.

Nota

Quando un utente partecipa a una chiamata, può accedere ai partecipanti remoti correnti tramite il metodo getRemoteParticipants(). L'evento addOnRemoteParticipantsUpdatedListener non verrà attivato per questi partecipanti esistenti. Questo evento viene attivato solo quando un partecipante remoto partecipa o lascia la chiamata mentre l'utente è già nella chiamata.

Aggiornamenti del flusso video remoto

Per le chiamate 1:1, è necessario gestire i partecipanti aggiunti. Quando si rimuove il partecipante remoto, la chiamata termina. Per i partecipanti aggiunti, si sottoscrive addOnVideoStreamsUpdatedListener per gestire gli aggiornamenti del flusso video.

public void handleRemoteParticipantsUpdate(ParticipantsUpdatedEvent args) {

handleAddedParticipants(args.getAddedParticipants());

}

private void handleAddedParticipants(List<RemoteParticipant> participants) {

for (RemoteParticipant remoteParticipant : participants) {

if(!joinedParticipants.contains(getId(remoteParticipant))) {

joinedParticipants.add(getId(remoteParticipant));

if (renderRemoteVideo) {

for (RemoteVideoStream stream : remoteParticipant.getVideoStreams()) {

StreamData data = new StreamData(stream, null, null);

streamData.put(stream.getId(), data);

startRenderingVideo(data);

}

}

remoteParticipant.addOnVideoStreamsUpdatedListener(videoStreamsEventArgs -> videoStreamsUpdated(videoStreamsEventArgs));

}

}

}

private void videoStreamsUpdated(RemoteVideoStreamsEvent videoStreamsEventArgs) {

for(RemoteVideoStream stream : videoStreamsEventArgs.getAddedRemoteVideoStreams()) {

StreamData data = new StreamData(stream, null, null);

streamData.put(stream.getId(), data);

if (renderRemoteVideo) {

startRenderingVideo(data);

}

}

for(RemoteVideoStream stream : videoStreamsEventArgs.getRemovedRemoteVideoStreams()) {

stopRenderingVideo(stream);

}

}

public String getId(final RemoteParticipant remoteParticipant) {

final CommunicationIdentifier identifier = remoteParticipant.getIdentifier();

if (identifier instanceof PhoneNumberIdentifier) {

return ((PhoneNumberIdentifier) identifier).getPhoneNumber();

} else if (identifier instanceof MicrosoftTeamsUserIdentifier) {

return ((MicrosoftTeamsUserIdentifier) identifier).getUserId();

} else if (identifier instanceof CommunicationUserIdentifier) {

return ((CommunicationUserIdentifier) identifier).getId();

} else {

return ((UnknownIdentifier) identifier).getId();

}

}

Eseguire il rendering di video remoti

Creare un renderer del flusso video remoto e collegarlo alla visualizzazione per avviare il rendering della visualizzazione remota. Eliminare la visualizzazione per interrompere il rendering.

void startRenderingVideo(StreamData data){

if (data.renderer != null) {

return;

}

GridLayout layout = ((GridLayout)findViewById(R.id.remotevideocontainer));

data.renderer = new VideoStreamRenderer(data.stream, this);

data.renderer.addRendererListener(new RendererListener() {

@Override

public void onFirstFrameRendered() {

String text = data.renderer.getSize().toString();

Log.i("MainActivity", "Video rendering at: " + text);

}

@Override

public void onRendererFailedToStart() {

String text = "Video failed to render";

Log.i("MainActivity", text);

}

});

data.rendererView = data.renderer.createView(new CreateViewOptions(ScalingMode.FIT));

data.rendererView.setTag(data.stream.getId());

runOnUiThread(() -> {

GridLayout.LayoutParams params = new GridLayout.LayoutParams(layout.getLayoutParams());

DisplayMetrics displayMetrics = new DisplayMetrics();

getWindowManager().getDefaultDisplay().getMetrics(displayMetrics);

params.height = (int)(displayMetrics.heightPixels / 2.5);

params.width = displayMetrics.widthPixels / 2;

layout.addView(data.rendererView, params);

});

}

void stopRenderingVideo(RemoteVideoStream stream) {

StreamData data = streamData.get(stream.getId());

if (data == null || data.renderer == null) {

return;

}

runOnUiThread(() -> {

GridLayout layout = findViewById(R.id.remotevideocontainer);

for(int i = 0; i < layout.getChildCount(); ++ i) {

View childView = layout.getChildAt(i);

if ((int)childView.getTag() == data.stream.getId()) {

layout.removeViewAt(i);

}

}

});

data.rendererView = null;

// Dispose renderer

data.renderer.dispose();

data.renderer = null;

}

static class StreamData {

RemoteVideoStream stream;

VideoStreamRenderer renderer;

VideoStreamRendererView rendererView;

StreamData(RemoteVideoStream stream, VideoStreamRenderer renderer, VideoStreamRendererView rendererView) {

this.stream = stream;

this.renderer = renderer;

this.rendererView = rendererView;

}

}

Aggiornamento dello stato della chiamata

Lo stato di una chiamata può cambiare da connesso a disconnesso. Quando la chiamata è connessa, si gestisce il partecipante remoto e quando la chiamata viene disconnessa, si elimina previewRenderer per arrestare il video locale.

private void handleCallOnStateChanged(PropertyChangedEvent args) {

if (call.getState() == CallState.CONNECTED) {

runOnUiThread(() -> Toast.makeText(this, "Call is CONNECTED", Toast.LENGTH_SHORT).show());

handleCallState();

}

if (call.getState() == CallState.DISCONNECTED) {

runOnUiThread(() -> Toast.makeText(this, "Call is DISCONNECTED", Toast.LENGTH_SHORT).show());

if (previewRenderer != null) {

previewRenderer.dispose();

}

switchSourceButton.setVisibility(View.INVISIBLE);

}

}

Terminare una chiamata

Terminare la chiamata chiamando la funzione hangUp() nell'istanza di chiamata. Eliminare previewRenderer per arrestare il video locale.

private void hangUp() {

try {

call.hangUp().get();

switchSourceButton.setVisibility(View.INVISIBLE);

} catch (ExecutionException | InterruptedException e) {

e.printStackTrace();

}

if (previewRenderer != null) {

previewRenderer.dispose();

}

}

Nascondere e mostrare video locale

Quando la chiamata è stata avviata, è possibile arrestare il rendering e lo streaming video locali con turnOffLocalVideo(), questo metodo rimuove la visualizzazione che esegue il wrapping del rendering locale ed elimina il flusso corrente. Per riprendere il flusso ed eseguire di nuovo il rendering dell'anteprima locale, usare turnOnLocalVideo(), questo metodo mostra l'anteprima video e avvia lo streaming.

public void turnOnLocalVideo() {

List<VideoDeviceInfo> cameras = deviceManager.getCameras();

if(!cameras.isEmpty()) {

try {

currentVideoStream = new LocalVideoStream(currentCamera, this);

showPreview(currentVideoStream);

call.startVideo(this, currentVideoStream).get();

switchSourceButton.setVisibility(View.VISIBLE);

} catch (CallingCommunicationException acsException) {

acsException.printStackTrace();

} catch (ExecutionException | InterruptedException e) {

e.printStackTrace();

}

}

}

public void turnOffLocalVideo() {

try {

LinearLayout container = findViewById(R.id.localvideocontainer);

for (int i = 0; i < container.getChildCount(); ++i) {

Object tag = container.getChildAt(i).getTag();

if (tag != null && (int)tag == 0) {

container.removeViewAt(i);

}

}

switchSourceButton.setVisibility(View.INVISIBLE);

previewRenderer.dispose();

previewRenderer = null;

call.stopVideo(this, currentVideoStream).get();

} catch (CallingCommunicationException acsException) {

acsException.printStackTrace();

} catch (ExecutionException | InterruptedException e) {

e.printStackTrace();

}

}

Eseguire il codice

È ora possibile avviare l'app usando il pulsante Esegui app sulla barra degli strumenti di Android Studio.

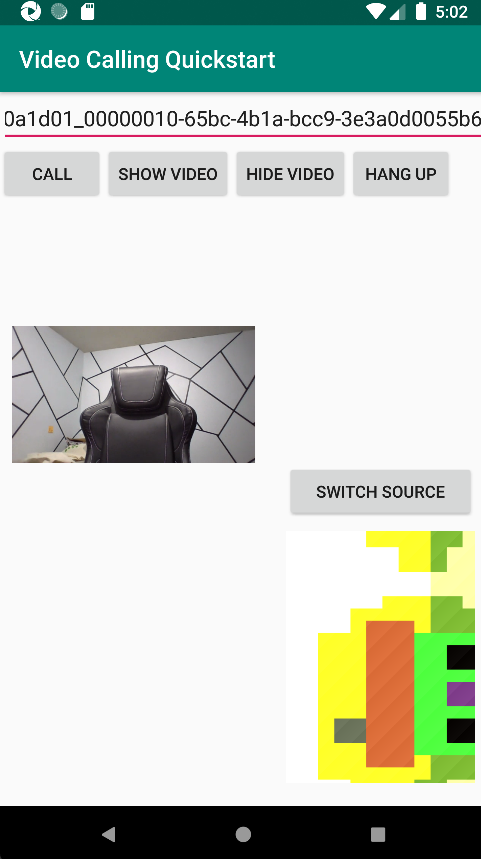

| Applicazione completata | 1:1 Chiamata |

|---|---|

|

|

Aggiungere la funzionalità di chiamata di gruppo

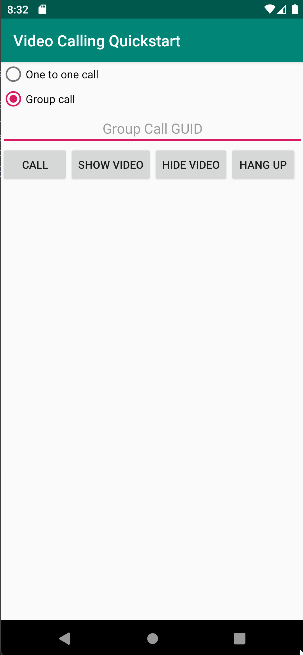

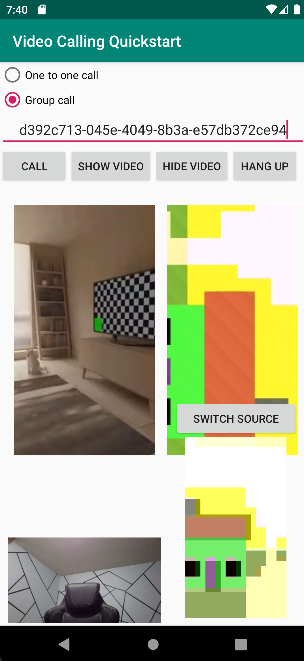

È ora possibile aggiornare l'app per consentire all'utente di scegliere tra chiamate 1:1 o chiamate di gruppo.

Aggiornare il layout

Usare i pulsanti di opzione per selezionare se l'SDK crea una chiamata 1:1 o partecipa a una chiamata di gruppo. I pulsanti di opzione si trovano nella parte superiore, quindi la prima sezione di app/src/main/res/layout/activity_main.xml termina come indicato di seguito.

<?xml version="1.0" encoding="utf-8"?>

<androidx.constraintlayout.widget.ConstraintLayout xmlns:android="http://schemas.android.com/apk/res/android"

xmlns:app="http://schemas.android.com/apk/res-auto"

xmlns:tools="http://schemas.android.com/tools"

android:layout_width="match_parent"

android:layout_height="match_parent"

tools:context=".MainActivity">

<LinearLayout

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:orientation="vertical">

<RadioGroup

android:layout_width="match_parent"

android:layout_height="wrap_content">

<RadioButton

android:id="@+id/one_to_one_call"

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:text="One to one call" />

<RadioButton

android:id="@+id/group_call"

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:text="Group call" />

</RadioGroup>

<EditText

android:id="@+id/call_id"

android:layout_width="match_parent"

android:layout_height="wrap_content"

android:ems="10"

android:gravity="center"

android:hint="Callee ID"

android:inputType="textPersonName"

app:layout_constraintBottom_toTopOf="@+id/call_button"

app:layout_constraintEnd_toEndOf="parent"

app:layout_constraintStart_toStartOf="parent"

app:layout_constraintTop_toTopOf="parent"

app:layout_constraintVertical_bias="0.064" />

.

.

.

</androidx.constraintlayout.widget.ConstraintLayout>

Update MainActivity.Java

È ora possibile aggiornare gli elementi e la logica per decidere quando creare una chiamata 1:1 e quando partecipare a una chiamata di gruppo. La prima parte del codice richiede aggiornamenti per aggiungere dipendenze, elementi e altre configurazioni.

Dipendenze:

import android.widget.RadioButton;

import com.azure.android.communication.calling.GroupCallLocator;

import com.azure.android.communication.calling.JoinCallOptions;

import java.util.UUID;

Elementi globali:

RadioButton oneToOneCall, groupCall;

AggiornamentoonCreate():

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

getAllPermissions();

createAgent();

handleIncomingCall();

Button callButton = findViewById(R.id.call_button);

callButton.setOnClickListener(l -> startCall());

Button hangupButton = findViewById(R.id.hang_up);

hangupButton.setOnClickListener(l -> hangUp());

Button startVideo = findViewById(R.id.show_preview);

startVideo.setOnClickListener(l -> turnOnLocalVideo());

Button stopVideo = findViewById(R.id.hide_preview);

stopVideo.setOnClickListener(l -> turnOffLocalVideo());

switchSourceButton = findViewById(R.id.switch_source);

switchSourceButton.setOnClickListener(l -> switchSource());

setVolumeControlStream(AudioManager.STREAM_VOICE_CALL);

oneToOneCall = findViewById(R.id.one_to_one_call);

oneToOneCall.setOnClickListener(this::onCallTypeSelected);

oneToOneCall.setChecked(true);

groupCall = findViewById(R.id.group_call);

groupCall.setOnClickListener(this::onCallTypeSelected);

}

AggiornamentostartCall():

private void startCall() {

Context context = this.getApplicationContext();

EditText callIdView = findViewById(R.id.call_id);

String callId = callIdView.getText().toString();

ArrayList<CommunicationIdentifier> participants = new ArrayList<CommunicationIdentifier>();

List<VideoDeviceInfo> cameras = deviceManager.getCameras();

if(oneToOneCall.isChecked()){

StartCallOptions options = new StartCallOptions();

if(!cameras.isEmpty()) {

currentCamera = getNextAvailableCamera(null);

currentVideoStream = new LocalVideoStream(currentCamera, context);

LocalVideoStream[] videoStreams = new LocalVideoStream[1];

videoStreams[0] = currentVideoStream;

VideoOptions videoOptions = new VideoOptions(videoStreams);

options.setVideoOptions(videoOptions);

showPreview(currentVideoStream);

}

participants.add(new CommunicationUserIdentifier(callId));

call = callAgent.startCall(

context,

participants,

options);

}

else{

JoinCallOptions options = new JoinCallOptions();

if(!cameras.isEmpty()) {

currentCamera = getNextAvailableCamera(null);

currentVideoStream = new LocalVideoStream(currentCamera, context);

LocalVideoStream[] videoStreams = new LocalVideoStream[1];

videoStreams[0] = currentVideoStream;

VideoOptions videoOptions = new VideoOptions(videoStreams);

options.setVideoOptions(videoOptions);

showPreview(currentVideoStream);

}

GroupCallLocator groupCallLocator = new GroupCallLocator(UUID.fromString(callId));

call = callAgent.join(

context,

groupCallLocator,

options);

}

remoteParticipantUpdatedListener = this::handleRemoteParticipantsUpdate;

onStateChangedListener = this::handleCallOnStateChanged;

call.addOnRemoteParticipantsUpdatedListener(remoteParticipantUpdatedListener);

call.addOnStateChangedListener(onStateChangedListener);

}

Aggiungere onCallTypeSelected():

public void onCallTypeSelected(View view) {

boolean checked = ((RadioButton) view).isChecked();

EditText callIdView = findViewById(R.id.call_id);

switch(view.getId()) {

case R.id.one_to_one_call:

if (checked){

callIdView.setHint("Callee id");

}

break;

case R.id.group_call:

if (checked){

callIdView.setHint("Group Call GUID");

}

break;

}

}

Eseguire l'app aggiornata

A questo punto, è possibile avviare l'app usando il pulsante esegui app sulla barra degli strumenti di Android Studio.

| Aggiornamento dello schermo | Chiamata di gruppo |

|---|---|

|

|

Per iniziare a usare Servizi di comunicazione di Azure, usare l'SDK per chiamate di Servizi di comunicazione per aggiungerlo a una sola videochiamata all'app. Si apprenderà come avviare e rispondere a una videochiamata usando Azure Communication Services Calling SDK per iOS.

Codice di esempio

Se si vuole passare direttamente alla fine, è possibile scaricare questa guida introduttiva come esempio in GitHub.

Prerequisiti

Ottenere un account Azure con una sottoscrizione attiva. Creare un account gratuitamente.

Un Mac che esegue Xcode, insieme a un certificato dello sviluppatore valido installato nel portachiavi.

Creare una risorsa attiva di Servizi di comunicazione. Creare una risorsa di Servizi di comunicazione. Per questa guida introduttiva è necessario registrare la stringa di connessione.

Un token di accesso utente per il servizio di comunicazione di Azure. È anche possibile usare l'interfaccia della riga di comando di Azure ed eseguire il comando con la stringa di connessione per creare un utente e un token di accesso.

az communication identity token issue --scope voip --connection-string "yourConnectionString"Per informazioni dettagliate, vedere Usare l'interfaccia della riga di comando di Azure per creare e gestire i token di accesso.

Configurazione

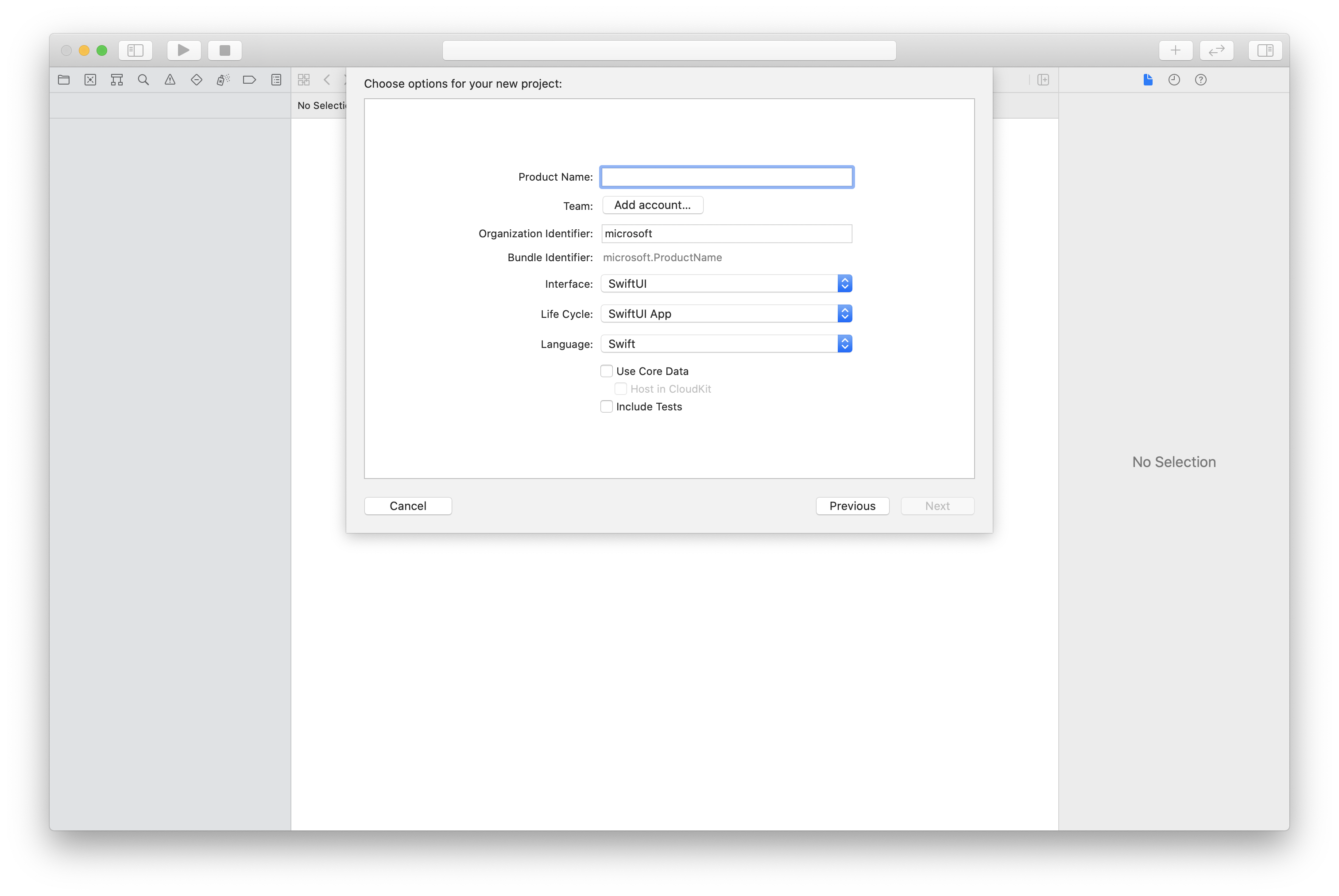

Creazione del progetto Xcode

In Xcode creare un nuovo progetto iOS e selezionare il modello Single View Application. Questa esercitazione usa il framework SwiftUI, quindi è necessario impostare Linguaggio su Swift e Interfaccia utente su SwiftUI. In questo argomento di avvio rapido non verranno creati test. È possibile deselezionare Includi test.

Installazione di CocoaPods

Usare questa guida per installare CocoaPods nel Mac.

Installare il pacchetto e le dipendenze con CocoaPods

Per creare un oggetto

Podfileper l'applicazione, aprire il terminale e passare alla cartella del progetto ed eseguire il pod init.Aggiungere il codice seguente a

Podfilee salvare. Vedere Le versioni del supporto sdk.

platform :ios, '13.0'

use_frameworks!

target 'VideoCallingQuickstart' do

pod 'AzureCommunicationCalling', '~> 1.0.0'

end

Eseguire l'installazione del pod.

Aprire

.xcworkspacecon Xcode.

Uso diretto di XCFramework

Se non si usa CocoaPods come gestore delle dipendenze, è possibile scaricare AzureCommunicationCalling.xcframework direttamente dalla pagina di versione.

È importante sapere che AzureCommunicationCalling ha una dipendenza da AzureCommunicationCommon, quindi è necessario installarlo anche nel progetto.

Nota

Anche se AzureCommunicationCommon è un pacchetto swift puro, non è possibile installarlo usando Swift Package Manager per usarlo con AzureCommunicationCalling perché quest'ultimo è un framework Objective-C e Swift Package Manager non supportano deliberatamente intestazioni di interfaccia Swift ObjC per progettazione, il che significa che non è possibile collaborare con AzureCommunicationCalling se installato usando Swift Package Manager. È necessario eseguire l'installazione tramite un altro gestore delle dipendenze o generare un xcframework da origini AzureCommunicationCommon e importare nel progetto.

Richiedere l'accesso al microfono e alla fotocamera

Per accedere al microfono e alla fotocamera del dispositivo, è necessario aggiornare l'elenco delle proprietà delle informazioni dell'app con un NSMicrophoneUsageDescription e NSCameraUsageDescription. Impostare il valore associato su una stringa inclusa nella finestra di dialogo usata dal sistema per richiedere l'accesso all'utente.

Fare clic con il pulsante destro del mouse sulla voce Info.plist dell'albero del progetto e selezionare Apri come > Codice sorgente. Aggiungere le righe seguenti nella sezione <dict> di primo livello e quindi salvare il file.

<key>NSMicrophoneUsageDescription</key>

<string>Need microphone access for VOIP calling.</string>

<key>NSCameraUsageDescription</key>

<string>Need camera access for video calling</string>

Configurare il framework dell'app

Aprire il file ContentView.swift del progetto e aggiungere una dichiarazione di importazione all'inizio del file per importare la libreria AzureCommunicationCalling e AVFoundation. AVFoundation viene usato per acquisire l'autorizzazione audio dal codice.

import AzureCommunicationCalling

import AVFoundation

Modello a oggetti

Le classi e le interfacce seguenti gestiscono alcune delle principali funzionalità del SDK Chiamate di Servizi di comunicazione di Azure per iOS.

| Nome | Descrizione |

|---|---|

CallClient |

CallClient è il punto di ingresso principale di Calling SDK. |

CallAgent |

CallAgent viene usato per avviare e gestire le chiamate. |

CommunicationTokenCredential |

CommunicationTokenCredential viene usato come credenziale del token per creare un'istanza di CallAgent. |

CommunicationIdentifier |

CommunicationIdentifier viene usato per rappresentare l'identità dell'utente, che può essere una delle opzioni seguenti: CommunicationUserIdentifier, PhoneNumberIdentifier o CallingApplication. |

Creare l'agente di chiamata

Sostituire l'implementazione del ContentView struct con alcuni semplici controlli dell'interfaccia utente che consentano a un utente di avviare e terminare una chiamata. In questa guida di avvio rapido viene aggiunta logica di business a questi controlli.

struct ContentView: View {

@State var callee: String = ""

@State var callClient: CallClient?

@State var callAgent: CallAgent?

@State var call: Call?

@State var deviceManager: DeviceManager?

@State var localVideoStream:[LocalVideoStream]?

@State var incomingCall: IncomingCall?

@State var sendingVideo:Bool = false

@State var errorMessage:String = "Unknown"

@State var remoteVideoStreamData:[Int32:RemoteVideoStreamData] = [:]

@State var previewRenderer:VideoStreamRenderer? = nil

@State var previewView:RendererView? = nil

@State var remoteRenderer:VideoStreamRenderer? = nil

@State var remoteViews:[RendererView] = []

@State var remoteParticipant: RemoteParticipant?

@State var remoteVideoSize:String = "Unknown"

@State var isIncomingCall:Bool = false

@State var callObserver:CallObserver?

@State var remoteParticipantObserver:RemoteParticipantObserver?

var body: some View {

NavigationView {

ZStack{

Form {

Section {

TextField("Who would you like to call?", text: $callee)

Button(action: startCall) {

Text("Start Call")

}.disabled(callAgent == nil)

Button(action: endCall) {

Text("End Call")

}.disabled(call == nil)

Button(action: toggleLocalVideo) {

HStack {

Text(sendingVideo ? "Turn Off Video" : "Turn On Video")

}

}

}

}

// Show incoming call banner

if (isIncomingCall) {

HStack() {

VStack {

Text("Incoming call")

.padding(10)

.frame(maxWidth: .infinity, alignment: .topLeading)

}

Button(action: answerIncomingCall) {

HStack {

Text("Answer")

}

.frame(width:80)

.padding(.vertical, 10)

.background(Color(.green))

}

Button(action: declineIncomingCall) {

HStack {

Text("Decline")

}

.frame(width:80)

.padding(.vertical, 10)

.background(Color(.red))

}

}

.frame(maxWidth: .infinity, alignment: .topLeading)

.padding(10)

.background(Color.gray)

}

ZStack{

VStack{

ForEach(remoteViews, id:\.self) { renderer in

ZStack{

VStack{

RemoteVideoView(view: renderer)

.frame(width: .infinity, height: .infinity)

.background(Color(.lightGray))

}

}

Button(action: endCall) {

Text("End Call")

}.disabled(call == nil)

Button(action: toggleLocalVideo) {

HStack {

Text(sendingVideo ? "Turn Off Video" : "Turn On Video")

}

}

}

}.frame(maxWidth: .infinity, maxHeight: .infinity, alignment: .topLeading)

VStack{

if(sendingVideo)

{

VStack{

PreviewVideoStream(view: previewView!)

.frame(width: 135, height: 240)

.background(Color(.lightGray))

}

}

}.frame(maxWidth:.infinity, maxHeight:.infinity,alignment: .bottomTrailing)

}

}

.navigationBarTitle("Video Calling Quickstart")

}.onAppear{

// Authenticate the client

// Initialize the CallAgent and access Device Manager

// Ask for permissions

}

}

}

//Functions and Observers

struct PreviewVideoStream: UIViewRepresentable {

let view:RendererView

func makeUIView(context: Context) -> UIView {

return view

}

func updateUIView(_ uiView: UIView, context: Context) {}

}

struct RemoteVideoView: UIViewRepresentable {

let view:RendererView

func makeUIView(context: Context) -> UIView {

return view

}

func updateUIView(_ uiView: UIView, context: Context) {}

}

struct ContentView_Previews: PreviewProvider {

static var previews: some View {

ContentView()

}

}

Autenticare il client

Per inizializzare un'istanza CallAgent, è necessario un token di accesso utente che consente di effettuare e ricevere chiamate. Se non è disponibile un token, vedere la documentazione dei token di accesso utente.

Dopo aver ottenuto un token, aggiungere il codice seguente al callback onAppear in ContentView.swift. È necessario sostituire <USER ACCESS TOKEN> con un token di accesso utente valido per la risorsa:

var userCredential: CommunicationTokenCredential?

do {

userCredential = try CommunicationTokenCredential(token: "<USER ACCESS TOKEN>")

} catch {

print("ERROR: It was not possible to create user credential.")

return

}

Inizializzare CallAgent e accedere a Gestione dispositivi

Per creare un'istanza CallAgent da callClient, utilizzare il metodo callClient.createCallAgent che restituisce in modo asincrono un oggetto CallAgent dopo l'inizializzazione. DeviceManager consente di enumerare i dispositivi locali che possono essere usati in una chiamata per trasmettere flussi audio/video. Consente inoltre di richiedere l'autorizzazione da un utente per accedere al microfono o alla fotocamera.

self.callClient = CallClient()

self.callClient?.createCallAgent(userCredential: userCredential!) { (agent, error) in

if error != nil {

print("ERROR: It was not possible to create a call agent.")

return

}

else {

self.callAgent = agent

print("Call agent successfully created.")

self.callAgent!.delegate = incomingCallHandler

self.callClient?.getDeviceManager { (deviceManager, error) in

if (error == nil) {

print("Got device manager instance")

self.deviceManager = deviceManager

} else {

print("Failed to get device manager instance")

}

}

}

}

Richiedere le autorizzazioni

È necessario aggiungere il codice seguente al callback onAppear per richiedere autorizzazioni per audio e video.

AVAudioSession.sharedInstance().requestRecordPermission { (granted) in

if granted {

AVCaptureDevice.requestAccess(for: .video) { (videoGranted) in

/* NO OPERATION */

}

}

}

Configurare la sessione audio

Usare un oggetto AVAudioSession per configurare la sessione audio dell'app. Ecco un esempio di abilitazione del dispositivo audio Bluetooth per l'app:

func configureAudioSession() -> Error? {

// Retrieve the audio session.

let audioSession: AVAudioSession = AVAudioSession.sharedInstance()

// set options to allow bluetooth device

let options: AVAudioSession.CategoryOptions = .allowBluetooth

var configError: Error?

do {

// Set the audio session category.

try audioSession.setCategory(.playAndRecord, options: options)

print("configureAudioSession successfully")

} catch {

print("configureAudioSession failed")

configError = error

}

return configError

}

Visualizzare il video locale

Prima di avviare una chiamata, è possibile gestire le impostazioni correlate al video. In questo argomento di avvio rapido viene introdotta l'implementazione di attivazione/disattivazione del video locale prima o durante una chiamata.

Prima di tutto è necessario accedere alle fotocamere locali con deviceManager. Dopo aver selezionato la fotocamera desiderata, è possibile costruire LocalVideoStream e creare un VideoStreamRenderer, e quindi collegarlo a previewView. Durante la chiamata, è possibile usare startVideo o stopVideo per avviare o interrompere l'invio di LocalVideoStream ai partecipanti remoti. Questa funzione funziona anche con la gestione delle chiamate in ingresso.

func toggleLocalVideo() {

// toggling video before call starts

if (call == nil)

{

if(!sendingVideo)

{

self.callClient = CallClient()

self.callClient?.getDeviceManager { (deviceManager, error) in

if (error == nil) {

print("Got device manager instance")

self.deviceManager = deviceManager

} else {

print("Failed to get device manager instance")

}

}

guard let deviceManager = deviceManager else {

return

}

let camera = deviceManager.cameras.first

let scalingMode = ScalingMode.fit

if (self.localVideoStream == nil) {

self.localVideoStream = [LocalVideoStream]()

}

localVideoStream!.append(LocalVideoStream(camera: camera!))

previewRenderer = try! VideoStreamRenderer(localVideoStream: localVideoStream!.first!)

previewView = try! previewRenderer!.createView(withOptions: CreateViewOptions(scalingMode:scalingMode))

self.sendingVideo = true

}

else{

self.sendingVideo = false

self.previewView = nil

self.previewRenderer!.dispose()

self.previewRenderer = nil

}

}

// toggle local video during the call

else{

if (sendingVideo) {

call!.stopVideo(stream: localVideoStream!.first!) { (error) in

if (error != nil) {

print("cannot stop video")

}

else {

self.sendingVideo = false

self.previewView = nil

self.previewRenderer!.dispose()

self.previewRenderer = nil

}

}

}

else {

guard let deviceManager = deviceManager else {

return

}

let camera = deviceManager.cameras.first

let scalingMode = ScalingMode.fit

if (self.localVideoStream == nil) {

self.localVideoStream = [LocalVideoStream]()

}

localVideoStream!.append(LocalVideoStream(camera: camera!))

previewRenderer = try! VideoStreamRenderer(localVideoStream: localVideoStream!.first!)

previewView = try! previewRenderer!.createView(withOptions: CreateViewOptions(scalingMode:scalingMode))

call!.startVideo(stream:(localVideoStream?.first)!) { (error) in

if (error != nil) {

print("cannot start video")

}

else {

self.sendingVideo = true

}

}

}

}

}

Effettuare una chiamata in uscita