Eseguire l'aggiornamento da modelli GitHub al servizio di inferenza del modello di intelligenza artificiale di Azure

Se si vuole sviluppare un'applicazione di intelligenza artificiale generativa, è possibile usare i modelli GitHub per trovare e sperimentare gratuitamente i modelli di intelligenza artificiale. L'utilizzo dell'API gratuita e del playground è limitato dalle richieste al minuto, dalle richieste al giorno, dai token per richiesta e dalle richieste simultanee. Se si ottiene un limite di frequenza, è necessario attendere il limite di frequenza raggiunto per reimpostare prima di poter effettuare più richieste.

Dopo aver portato l'applicazione nell'ambiente di produzione, è possibile aggiornare l'esperienza distribuendo una risorsa di Servizi di intelligenza artificiale di Azure in una sottoscrizione di Azure e iniziare a usare il servizio di inferenza del modello di intelligenza artificiale di Azure. Non è necessario modificare altri elementi nel codice.

L'articolo seguente illustra come iniziare a usare i modelli GitHub nei modelli di intelligenza artificiale di Azure per i servizi di intelligenza artificiale di Azure.

Prerequisiti

Per completare questa esercitazione è necessario:

Un account GitHub con accesso a GitHub Models.

Una sottoscrizione di Azure. Se non ne è disponibile uno, viene richiesto di creare o aggiornare l'account Azure con pagamento quando si è pronti per distribuire il modello nell'ambiente di produzione.

Eseguire l'aggiornamento a Servizi di intelligenza artificiale di Azure

I limiti di frequenza per il playground e l'utilizzo gratuito dell'API sono progettati per consentire di sperimentare i modelli e sviluppare l'applicazione di intelligenza artificiale. Quando si è pronti per portare l'applicazione nell'ambiente di produzione, usare una chiave e un endpoint da un account Azure a pagamento. Non è necessario modificare altri elementi nel codice.

Per ottenere la chiave e l'endpoint:

Nel playground per il modello selezionare Recupera chiave API.

Selezionare Recupera chiave di produzione.

Se non si ha un account Azure, selezionare Crea account personale e seguire i passaggi per crearne uno.

Se si ha un account Azure, selezionare Accedi di nuovo.

Se il tuo account esistente è un account gratuito, devi prima eseguire l'aggiornamento a un piano con pagamento in base al consumo. Dopo l'aggiornamento, tornare al playground e selezionare di nuovo Recupera chiave API, quindi accedere con l'account aggiornato.

Dopo aver eseguito l'accesso all'account Azure, si accede ad Azure AI Foundry.

Nella parte superiore della pagina selezionare Vai alla risorsa gitHub per intelligenza artificiale per passare ad Azure AI Foundry/Github](https://ai.azure.com/github). Il caricamento dei dettagli del modello iniziale nel portale di AI Foundry potrebbe richiedere uno o due minuti.

La pagina viene caricata con i dettagli del modello. Selezionare il pulsante Crea una distribuzione per distribuire il modello nell'account.

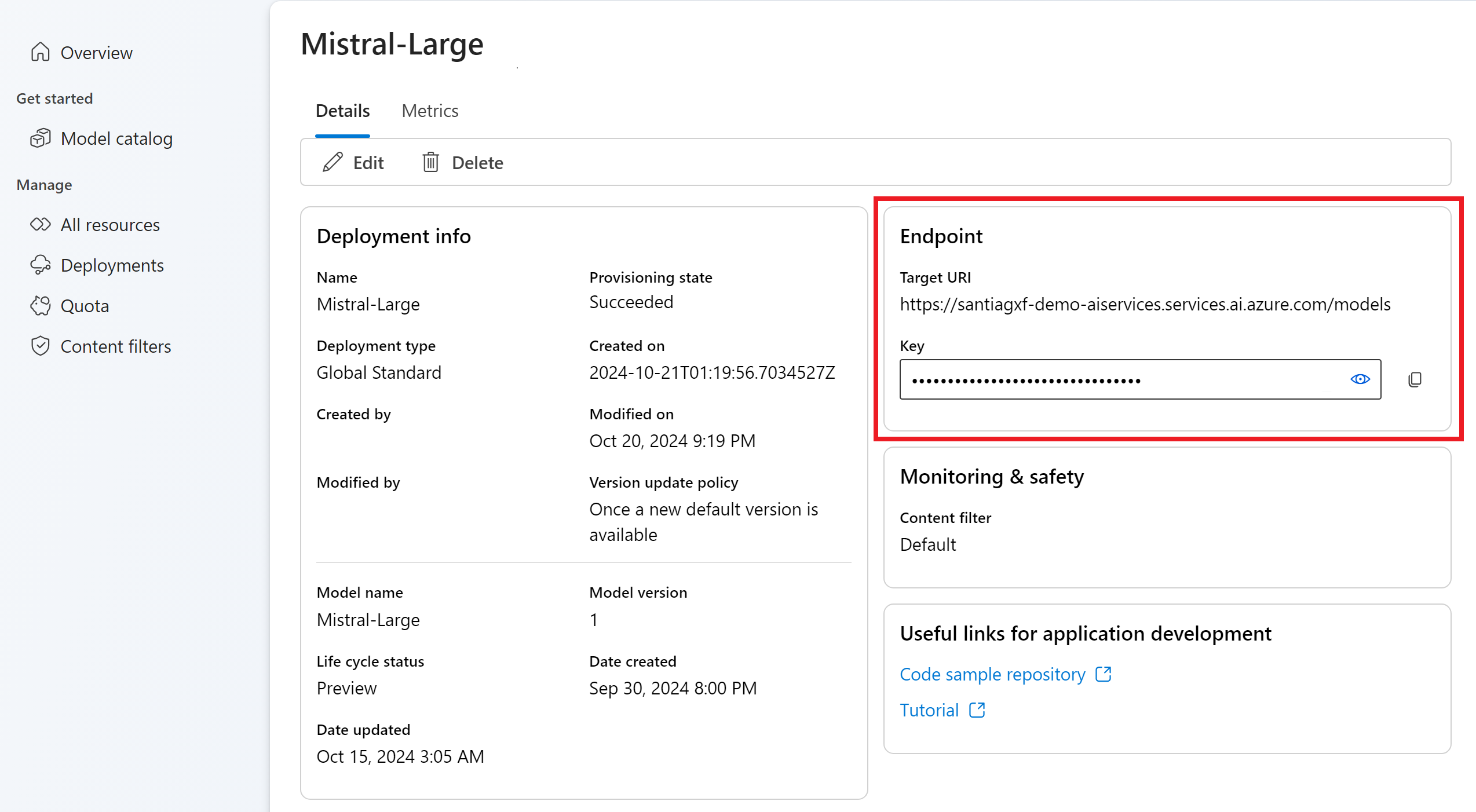

Dopo la distribuzione, la chiave API e l'endpoint del modello vengono visualizzati nella panoramica. Usare questi valori nel codice per usare il modello nell'ambiente di produzione.

A questo punto, il modello selezionato è pronto per l'utilizzo.

Suggerimento

Usare il parametro model="<deployment-name> per instradare la richiesta a questa distribuzione. Le distribuzioni funzionano come alias di un determinato modello in determinate configurazioni. Per informazioni su come instradare le distribuzioni dei servizi di intelligenza artificiale di Azure, vedere la pagina Concetto di routing .

Aggiornare il codice per usare il nuovo endpoint

Dopo aver configurato la risorsa di Servizi di intelligenza artificiale di Azure, è possibile iniziare a usarla dal codice. Sono necessari l'URL e la chiave dell'endpoint, disponibili nella sezione Panoramica :

È possibile usare uno degli SDK supportati per ottenere stime dall'endpoint. Gli SDK seguenti sono ufficialmente supportati:

- OpenAI SDK

- SDK di Azure OpenAI

- Azure AI Inference SDK

Per altri dettagli ed esempi, vedere la sezione SDK e lingue supportate. L'esempio seguente illustra come usare l'SDK di inferenza del modello di intelligenza artificiale di Azure con il modello appena distribuito:

Installare il pacchetto azure-ai-inference usando la propria gestione pacchetti, come pip:

pip install azure-ai-inference>=1.0.0b5

Avviso

La risorsa di Servizi di intelligenza artificiale di Azure richiede la versione azure-ai-inference>=1.0.0b5 per Python.

Quindi, è possibile usare il pacchetto per utilizzare il modello. Gli esempi seguenti mostrano come creare un client per utilizzare i completamenti chat:

import os

from azure.ai.inference import ChatCompletionsClient

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint=os.environ["AZUREAI_ENDPOINT_URL"],

credential=AzureKeyCredential(os.environ["AZUREAI_ENDPOINT_KEY"]),

)

Esplorare gli esempi e leggere la documentazione di riferimento sulle API per iniziare.

Generare il primo completamento della chat:

from azure.ai.inference.models import SystemMessage, UserMessage

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="Explain Riemann's conjecture in 1 paragraph"),

],

model="mistral-large"

)

print(response.choices[0].message.content)

Esplorare altre funzionalità

L'inferenza del modello di intelligenza artificiale di Azure supporta altre funzionalità non disponibili nei modelli GitHub, tra cui:

- Esplorare il catalogo dei modelli per visualizzare altri modelli non disponibili in GitHub Models.

- Configurare il filtro del contenuto.

- Configurare la limitazione della frequenza (per modelli specifici).

- Esplorare altri SKU di distribuzione (per modelli specifici).

- Configurare la rete privata.

Hai problemi?

Per altre informazioni, vedere la sezione Domande frequenti.

Passaggi successivi

- Aggiungere altri modelli all'endpoint.

- Esplorare il catalogo dei modelli nel portale di Azure AI Foundry.