Configurer une connexion pour utiliser l’inférence de modèle Azure AI dans votre projet d’IA

Important

Les éléments marqués (préversion) dans cet article sont actuellement en préversion publique. Cette préversion est fournie sans contrat de niveau de service, nous la déconseillons dans des charges de travail de production. Certaines fonctionnalités peuvent être limitées ou non prises en charge. Pour plus d’informations, consultez Conditions d’Utilisation Supplémentaires relatives aux Évaluations Microsoft Azure.

Vous pouvez utiliser l’inférence de modèle Azure AI dans vos projets dans Azure AI Foundry pour créer/atteindre des applications et interagir/gérer les modèles disponibles. Pour utiliser le service d’inférence de modèle Azure AI dans votre projet, vous devez créer une connexion à la ressource Azure AI Services.

L’article suivant explique comment créer une connexion à la ressource Azure AI Services pour utiliser le point de terminaison d’inférence.

Prérequis

Pour effectuer ce qui est décrit dans cet article, vous avez besoin des éléments suivants :

Un abonnement Azure. Si vous utilisez des modèles GitHub, vous pouvez mettre à niveau votre expérience et créer un abonnement Azure dans le processus. Lire Mise à niveau des modèles GitHub vers l’inférence de modèle Azure AI, le cas échéant.

Une ressource Azure AI services. Consulter Créer une ressource Azure AI Services pour plus de détails.

- Projet IA connecté à votre ressource Azure AI Services. Vous pouvez suivre les étapes décrites dans Configurer un service d’inférence de modèle Azure AI dans mon projet dans Azure AI Foundry.

Ajouter une connexion

Vous pouvez créer une connexion à une ressource Azure AI Services en procédant comme suit :

Accédez au Portail Azure AI Foundry.

Dans le coin inférieur gauche de l’écran, sélectionnez Centre de gestion.

Dans la section Connexions, sélectionnez Nouvelle connexion.

Sélectionnez Azure AI services.

Dans le navigateur, recherchez une ressource Azure AI Services existante dans votre abonnement.

Sélectionnez Ajouter une connexion.

La nouvelle connexion est ajoutée à votre Hub.

Revenez à la page d’arrivée du projet pour continuer et sélectionnez maintenant la connexion nouvellement créée. Actualisez la page si elle ne s’affiche pas immédiatement.

Voir les modèles de déploiement dans la ressource connectée

Vous pouvez voir les modèles de déploiement disponibles dans la ressource connectée en procédant comme suit :

Accédez au Portail Azure AI Foundry.

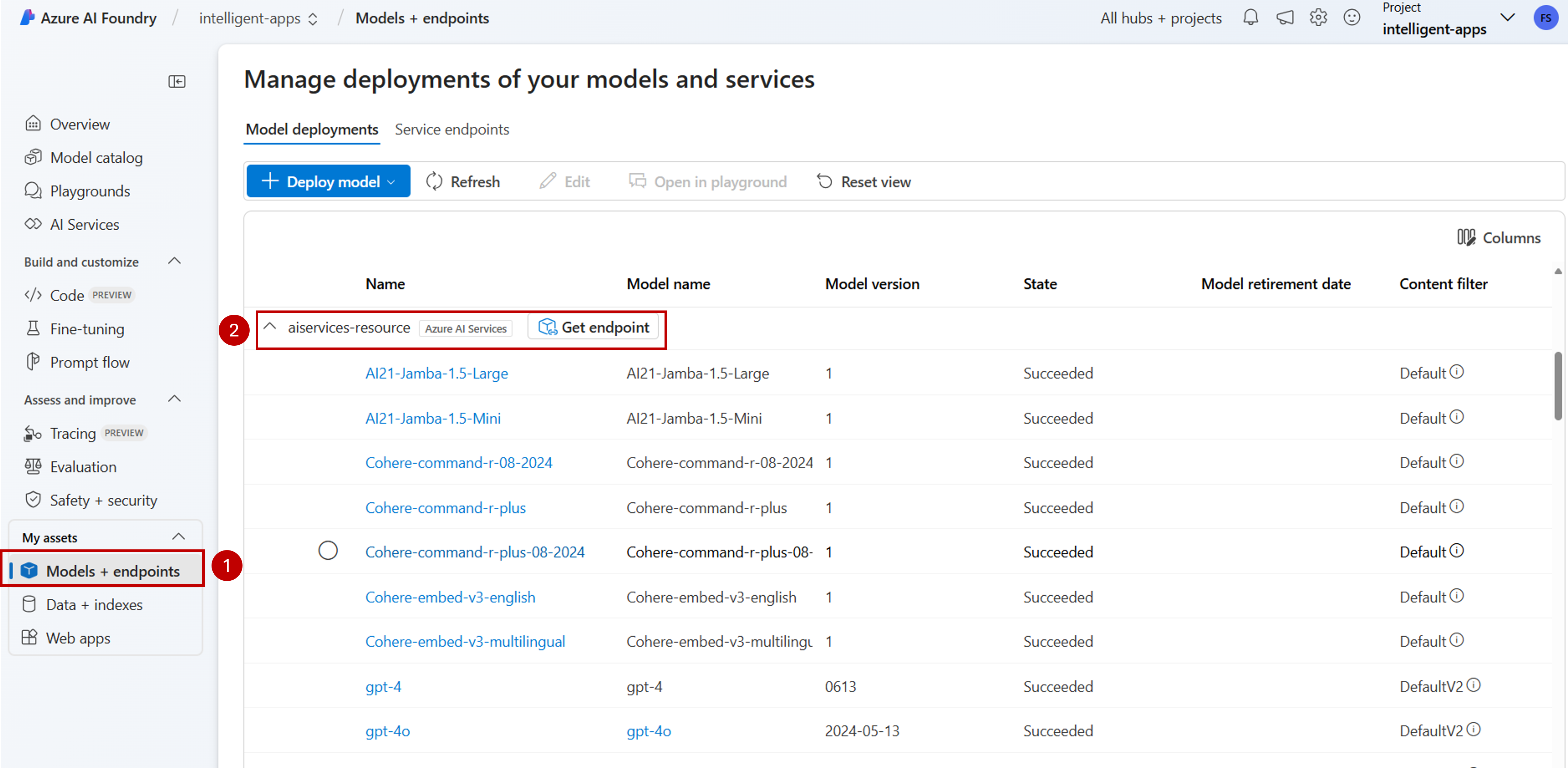

Dans la barre de navigation de gauche, sélectionnez Modèles + points de terminaison.

La page affiche les modèles de déploiement disponibles, regroupés par nom de connexion. Recherchez la connexion que vous venez de créer, qui doit être de type Azure AI Services.

Sélectionnez le modèle de déploiement que vous souhaitez inspecter.

La page de détails affiche des informations sur le déploiement spécifique. Si vous souhaitez tester le modèle, vous pouvez utiliser l’option Ouvrir dans le terrain de jeu.

Le terrain de jeu Azure AI Foundry s’affiche, dans lequel vous pouvez interagir avec le modèle donné.

Important

Les éléments marqués (préversion) dans cet article sont actuellement en préversion publique. Cette préversion est fournie sans contrat de niveau de service, nous la déconseillons dans des charges de travail de production. Certaines fonctionnalités peuvent être limitées ou non prises en charge. Pour plus d’informations, consultez Conditions d’Utilisation Supplémentaires relatives aux Évaluations Microsoft Azure.

Vous pouvez utiliser l’inférence de modèle Azure AI dans vos projets dans Azure AI Foundry pour créer/atteindre des applications et interagir/gérer les modèles disponibles. Pour utiliser le service d’inférence de modèle Azure AI dans votre projet, vous devez créer une connexion à la ressource Azure AI Services.

L’article suivant explique comment créer une connexion à la ressource Azure AI Services pour utiliser le point de terminaison d’inférence.

Prérequis

Pour effectuer ce qui est décrit dans cet article, vous avez besoin des éléments suivants :

Un abonnement Azure. Si vous utilisez des modèles GitHub, vous pouvez mettre à niveau votre expérience et créer un abonnement Azure dans le processus. Lire Mise à niveau des modèles GitHub vers l’inférence de modèle Azure AI, le cas échéant.

Une ressource Azure AI services. Consulter Créer une ressource Azure AI Services pour plus de détails.

Installer l’interface de ligne de commande Azure et l’extension

mlpour Azure AI Foundry :az extension add -n mlIdentifiez les informations suivantes :

Votre ID d’abonnement Azure.

Le nom de votre ressource Azure AI Services.

Le groupe de ressources dans lequel la ressource Azure AI Services est déployée.

Ajouter une connexion

Pour ajouter un modèle, vous devez d’abord identifier le modèle que vous souhaitez déployer. Vous pouvez interroger les modèles disponibles comme suit :

Connectez-vous à votre abonnement Azure :

az loginConfigurer l’interface CLI pour qu’elle pointe vers le projet :

az account set --subscription <subscription> az configure --defaults workspace=<project-name> group=<resource-group> location=<location>Créer une définition de connexion :

connection.yml

name: <connection-name> type: aiservices endpoint: https://<ai-services-resourcename>.services.ai.azure.com api_key: <resource-api-key>Créez la connexion :

az ml connection create -f connection.ymlÀ ce stade, la connexion est disponible pour la consommation.

Important

Les éléments marqués (préversion) dans cet article sont actuellement en préversion publique. Cette préversion est fournie sans contrat de niveau de service, nous la déconseillons dans des charges de travail de production. Certaines fonctionnalités peuvent être limitées ou non prises en charge. Pour plus d’informations, consultez Conditions d’Utilisation Supplémentaires relatives aux Évaluations Microsoft Azure.

Vous pouvez utiliser l’inférence de modèle Azure AI dans vos projets dans Azure AI Foundry pour créer/atteindre des applications et interagir/gérer les modèles disponibles. Pour utiliser le service d’inférence de modèle Azure AI dans votre projet, vous devez créer une connexion à la ressource Azure AI Services.

L’article suivant explique comment créer une connexion à la ressource Azure AI Services pour utiliser le point de terminaison d’inférence.

Prérequis

Pour effectuer ce qui est décrit dans cet article, vous avez besoin des éléments suivants :

Un abonnement Azure. Si vous utilisez des modèles GitHub, vous pouvez mettre à niveau votre expérience et créer un abonnement Azure dans le processus. Lire Mise à niveau des modèles GitHub vers l’inférence de modèle Azure AI, le cas échéant.

Une ressource Azure AI services. Consulter Créer une ressource Azure AI Services pour plus de détails.

Projet Azure AI avec un Hub IA.

Installez Azure CLI.

Identifiez les informations suivantes :

Votre ID d’abonnement Azure.

Le nom de votre ressource Azure AI Services.

L’ID de votre ressource Azure AI Services.

Nom du Hub Azure AI dans lequel le projet est déployé.

Le groupe de ressources dans lequel la ressource Azure AI Services est déployée.

Ajouter une connexion

Utilisez le modèle

ai-services-connection-template.biceppour décrire la connexion :ai-services-connection-template.bicep

@description('Name of the hub where the connection will be created') param hubName string @description('Name of the connection') param name string @description('Category of the connection') param category string = 'AIServices' @allowed(['AAD', 'ApiKey', 'ManagedIdentity', 'None']) param authType string = 'AAD' @description('The endpoint URI of the connected service') param endpointUri string @description('The resource ID of the connected service') param resourceId string = '' @secure() param key string = '' resource connection 'Microsoft.MachineLearningServices/workspaces/connections@2024-04-01-preview' = { name: '${hubName}/${name}' properties: { category: category target: endpointUri authType: authType isSharedToAll: true credentials: authType == 'ApiKey' ? { key: key } : null metadata: { ApiType: 'Azure' ResourceId: resourceId } } }Exécutez le déploiement :

RESOURCE_GROUP="<resource-group-name>" ACCOUNT_NAME="<azure-ai-model-inference-name>" ENDPOINT_URI="https://<azure-ai-model-inference-name>.services.ai.azure.com" RESOURCE_ID="<resource-id>" HUB_NAME="<hub-name>" az deployment group create \ --resource-group $RESOURCE_GROUP \ --template-file ai-services-connection-template.bicep \ --parameters accountName=$ACCOUNT_NAME hubName=$HUB_NAME endpointUri=$ENDPOINT_URI resourceId=$RESOURCE_ID