Captura de datos de Event Hubs en formato de Delta Lake

En este artículo se explica cómo usar el editor de no código para capturar automáticamente datos de streaming en Event Hubs en una cuenta de Azure Data Lake Storage Gen2 en formato de Delta Lake.

Requisitos previos

- Los recursos de Azure Event Hubs y Azure Data Lake Storage Gen2 deben tener acceso público y no pueden estar detrás de un firewall o protegidos en una red virtual de Azure.

- Los datos de Event Hubs deben serializarse en formato JSON, CSV o Avro.

Configuración de un trabajo para capturar datos

Siga estos pasos para configurar un trabajo de Stream Analytics para capturar datos en Azure Data Lake Storage Gen2.

En Azure Portal, vaya al centro de eventos.

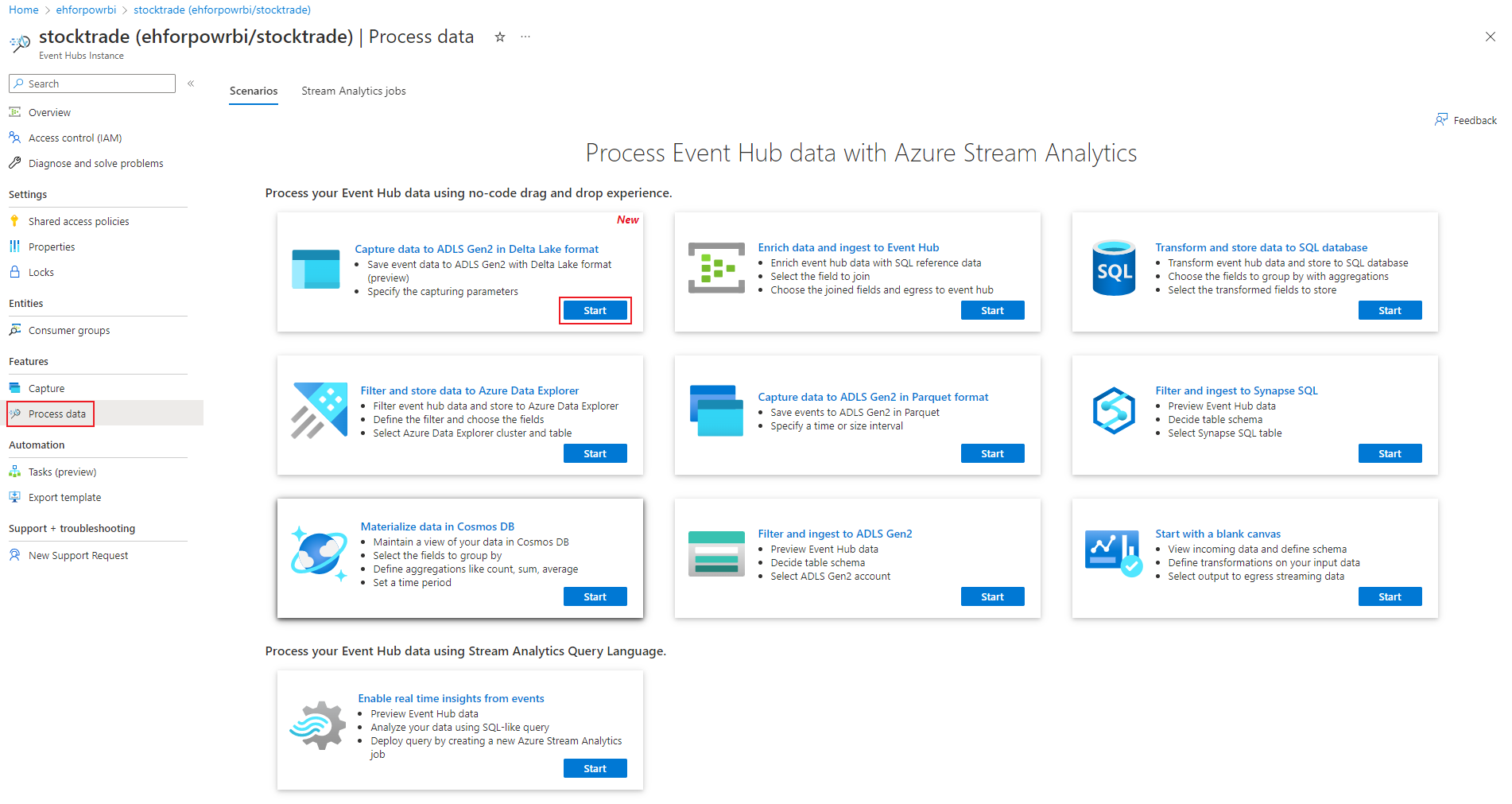

Seleccione Características>Procesar datos, y seleccione Iniciar en la tarjeta Capturar datos a ADLS Gen2 en formato de Delta Lake.

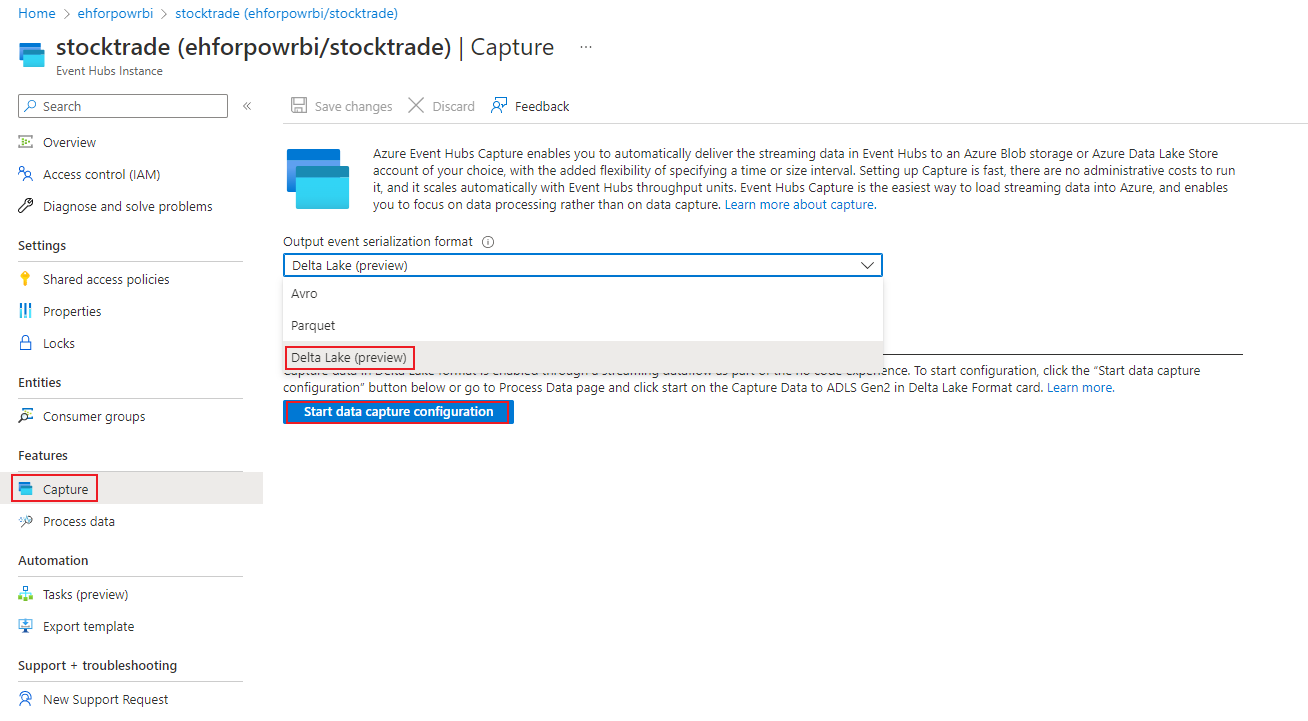

Como alternativa, seleccione Características>Capturar. Después, seleccione la opción Delta Lake en "Formato de serialización de eventos de salida"y, luego, seleccione Iniciar configuración de captura de datos.

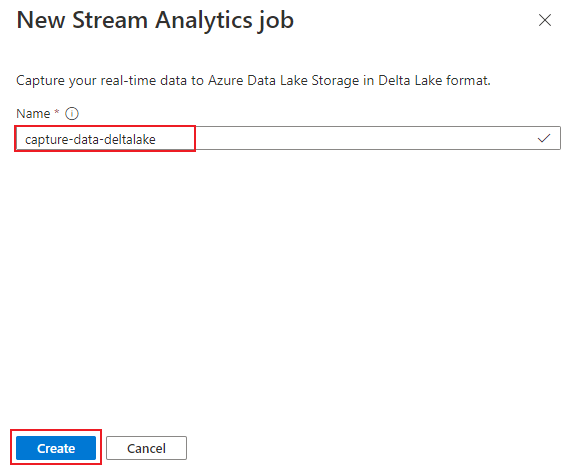

Escriba un nombre para identificar el trabajo de Stream Analytics. Seleccione Crear.

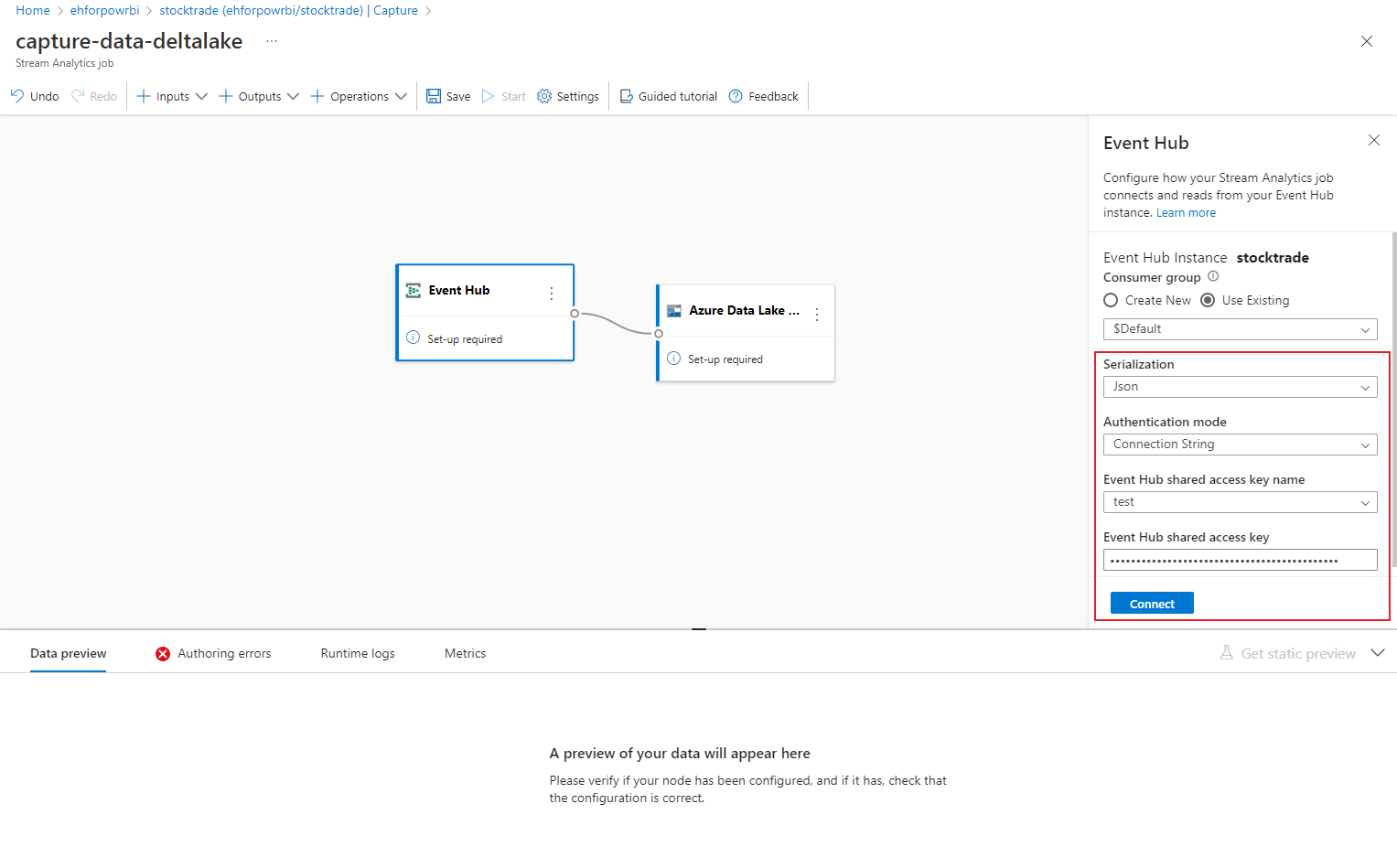

Especifique el tipo de Serialización de los datos en Event Hubs y el Método de autenticación que usa el trabajo para conectarse a Event Hubs. A continuación, seleccione Conectar.

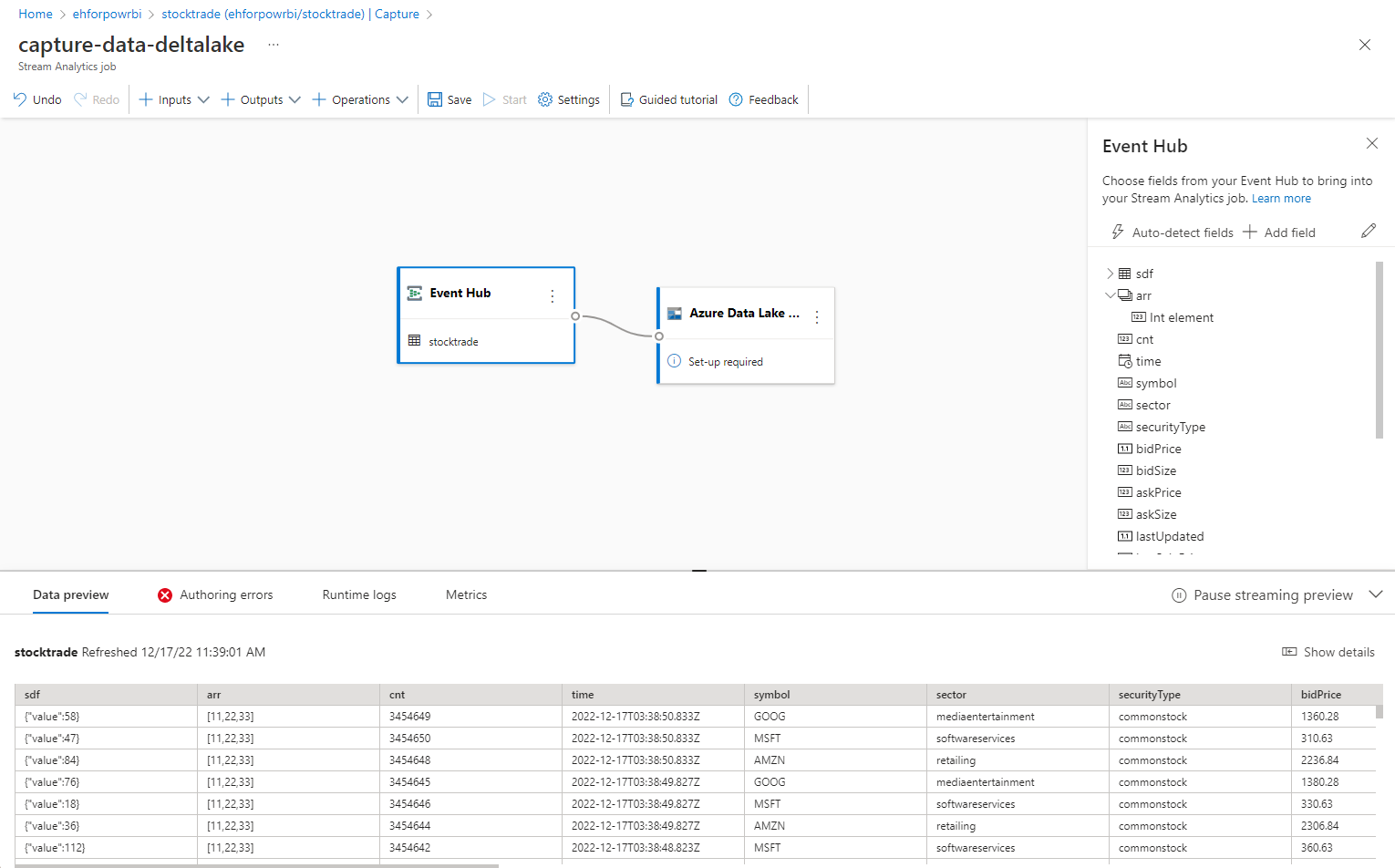

Cuando la conexión se establezca correctamente, verá lo siguiente:

- Campos que están presentes en los datos de entrada. Puede elegir Agregar campo o puede seleccionar el símbolo de los tres puntos junto a un campo para, opcionalmente, eliminar, renombrar o cambiar su nombre.

- Ejemplo dinámico de datos entrantes en la tabla de Vista previa de los datos en la vista de diagrama. Se actualiza periódicamente. Puede seleccionar Pausar la versión preliminar del streaming para ver una vista estática de la entrada de la muestra.

Seleccione el mosaico Azure Data Lake Storage Gen2 para editar la configuración.

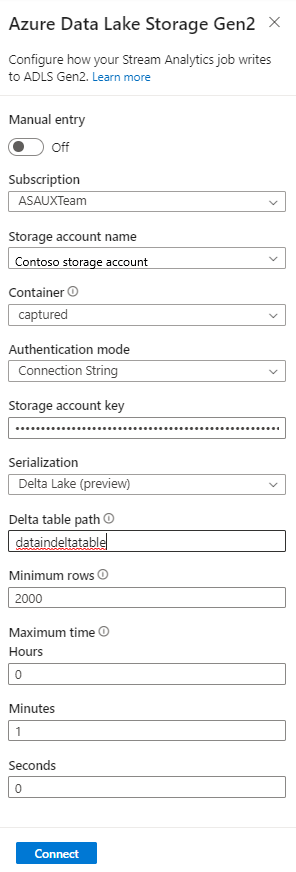

En la página de configuración de Azure Data Lake Storage Gen2, siga estos pasos:

Seleccione la suscripción, el nombre de la cuenta de almacenamiento y el contenedor en el menú desplegable.

Una vez seleccionada la suscripción, el método de autenticación y la clave de la cuenta de almacenamiento deberían rellenarse automáticamente.

En el caso de la ruta de acceso de tabla de Delta se usa para especificar la ubicación y el nombre de la tabla de Delta Lake almacenada en Azure Data Lake Storage Gen2. Puede optar por usar uno o varios segmentos de ruta de acceso para definir la ruta de acceso a la tabla Delta y el nombre de la tabla Delta. Para más información, consulte Escritura en tablas de Delta Lake.

Seleccione Conectar.

Cuando se establezca la conexión, verá los campos que están presentes en los datos de salida.

Seleccione Guardar en la barra de comandos para guardar la configuración.

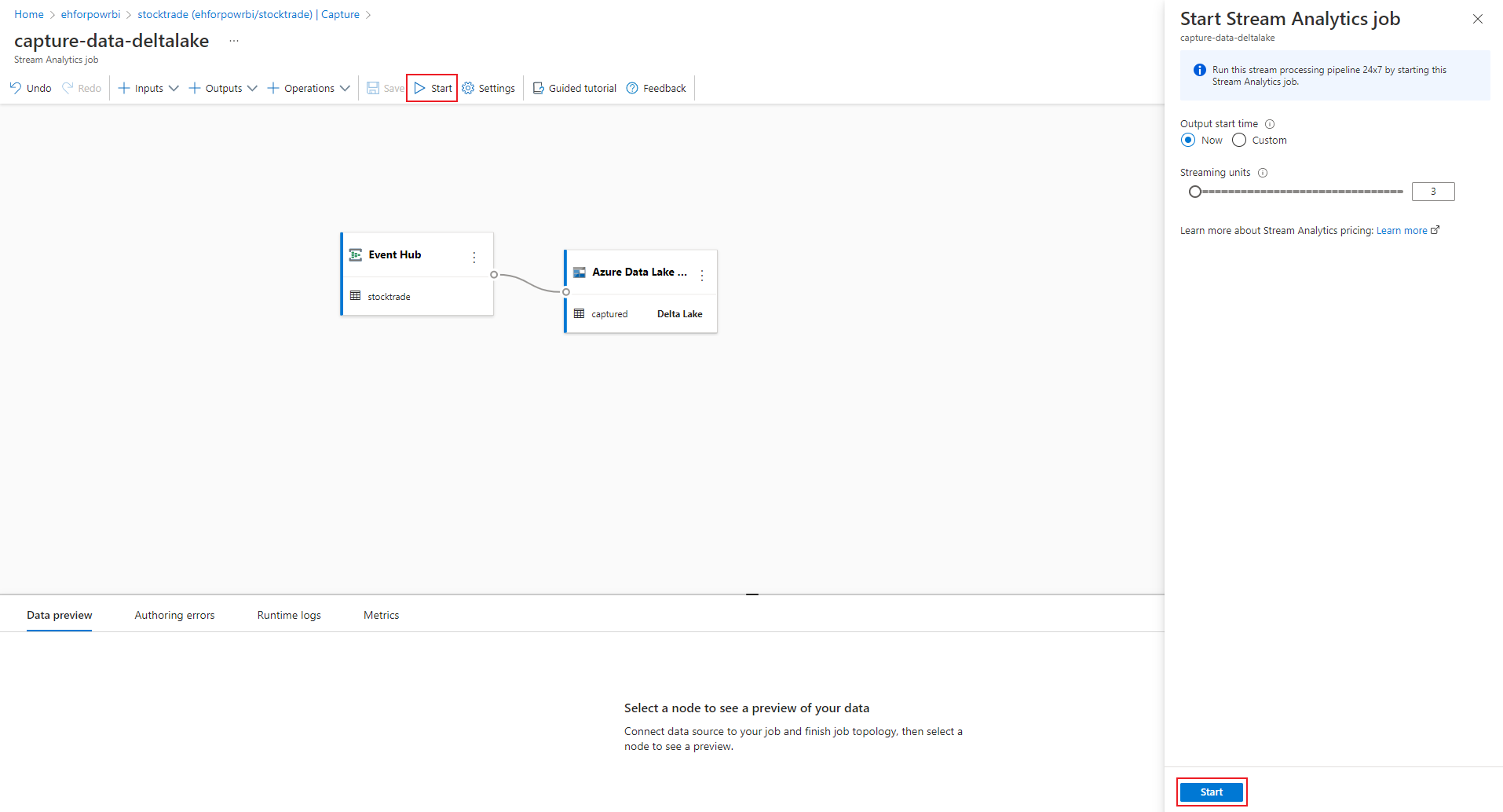

Seleccione Iniciar en la barra de comandos para iniciar el flujo de streaming y capturar datos. A continuación, en la ventana Iniciar trabajo de Stream Analytics:

- Seleccione la hora de inicio de la salida.

- Seleccione el número de Unidades de streaming (SU) con las que se ejecuta el trabajo. Las unidades de streaming representan los recursos informáticos que se asignan para ejecutar un trabajo de Stream Analytics. Para más información, consulte Unidades de streaming en Azure Stream Analytics.

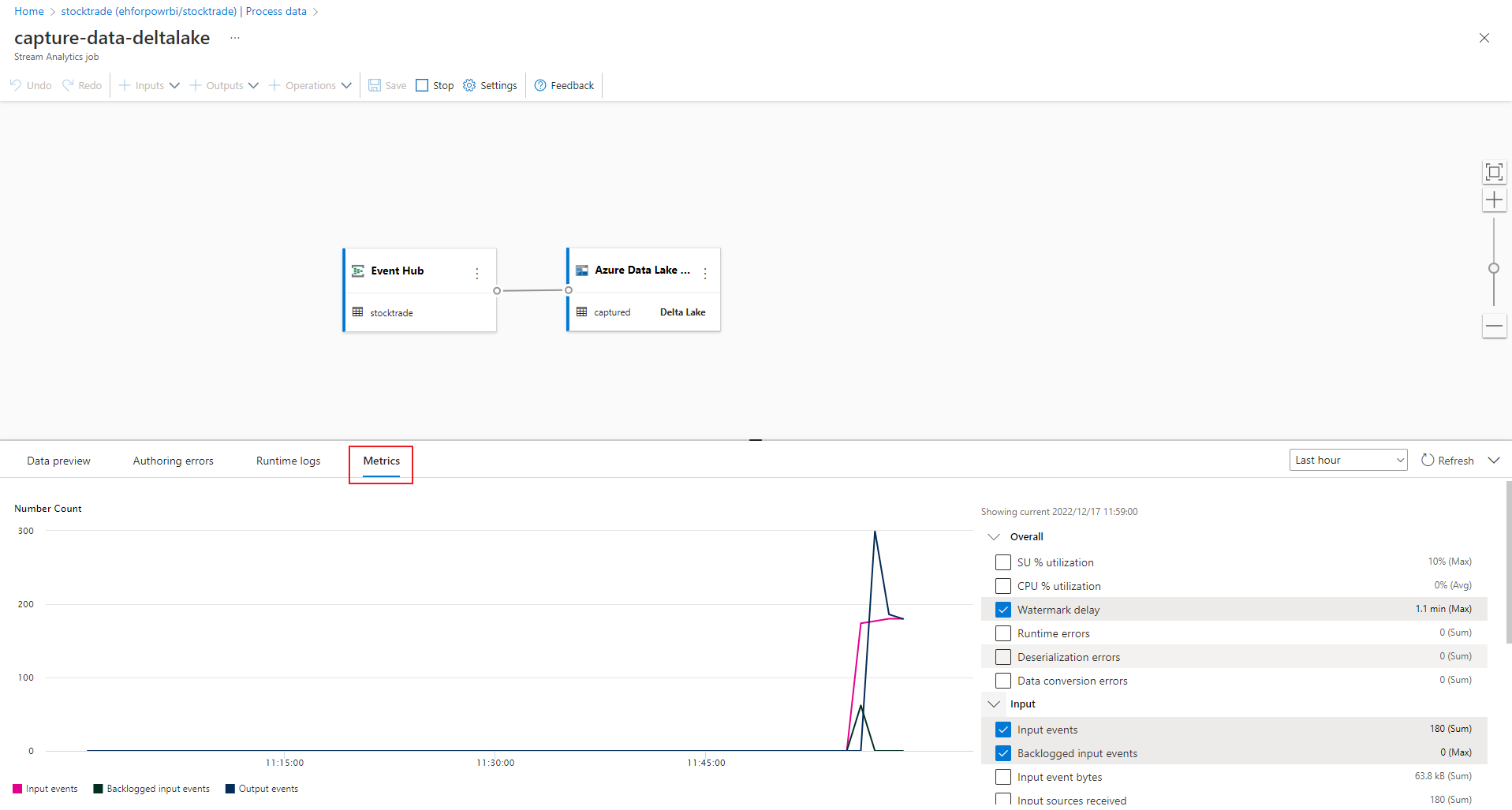

Después de seleccionar Iniciar, el trabajo comienza a ejecutarse en un máximo de dos minutos y las métricas se abrirán en la sección de pestañas como se muestra en la imagen siguiente.

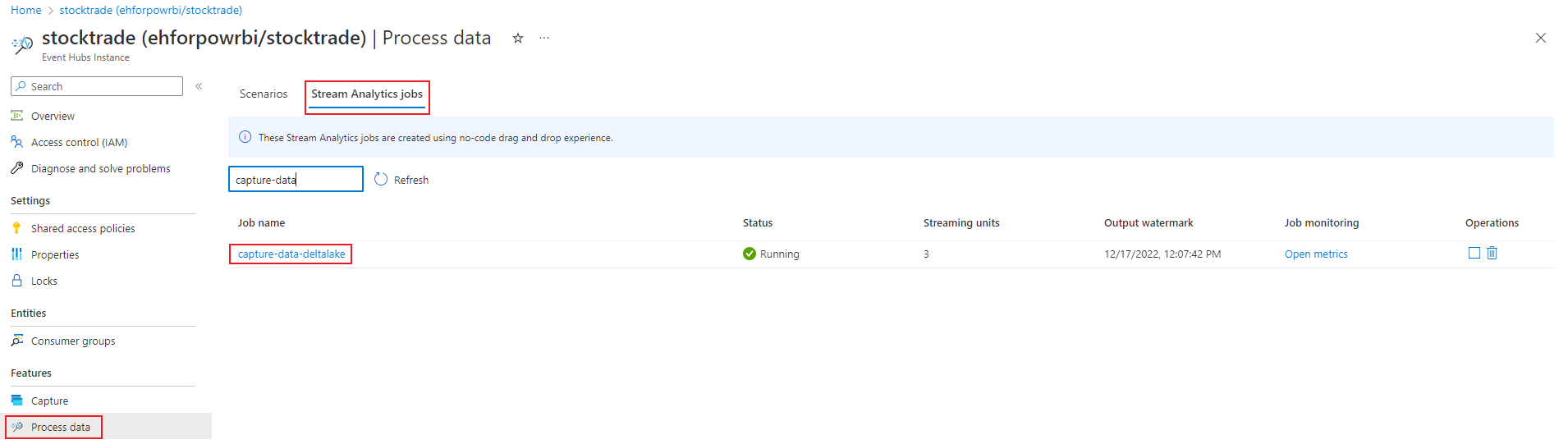

El nuevo trabajo se puede ver en la pestaña Trabajos de Stream Analytics.

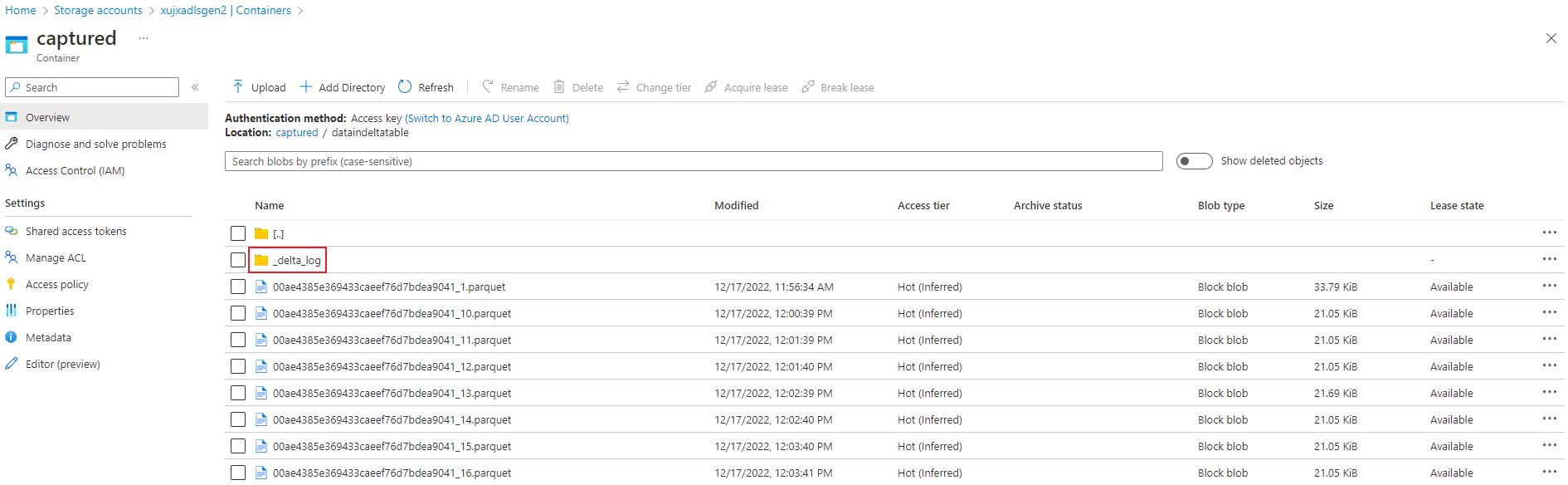

Comprobar salida

Compruebe que los archivos de Parquet con formato de Delta Lake se generan en el contenedor de Azure Data Lake Storage.

Consideraciones al usar la característica de replicación geográfica de Event Hubs

Azure Event Hubs lanzó recientemente la característica Replicación geográfica en versión preliminar pública. Esta característica es diferente de la característica de Recuperación ante desastres geográfica de Azure Event Hubs.

Cuando el tipo de conmutación por error es Forzado y la coherencia de la replicación es Asincrónica, el trabajo de Stream Analytics no garantiza exactamente una salida una vez en una salida de Azure Event Hubs.

Azure Stream Analytics, como productor con un centro de eventos una salida, podría observar el retraso de la marca de agua en el trabajo durante la duración de la conmutación por error y durante la limitación por Event Hubs en caso de que el retraso de replicación entre principal y secundario alcance el retraso máximo configurado.

Azure Stream Analytics, como consumidor con Event Hubs como entrada, puede observar el retraso de la marca de agua en el trabajo durante la duración de la conmutación por error y podría omitir los datos o buscar datos duplicados una vez completada la conmutación por error.

Debido a estas advertencias, se recomienda reiniciar el trabajo de Stream Analytics con la hora de inicio adecuada justo después de que se complete la conmutación por error de Event Hubs. Además, dado que la característica de replicación geográfica de Event Hubs está en versión preliminar pública, no se recomienda usar este patrón para trabajos de producción de Stream Analytics en este momento. El comportamiento actual de Stream Analytics mejorará antes de que la característica de replicación geográfica de Event Hubs esté disponible con carácter general y se pueda usar en trabajos de producción de Stream Analytics.

Pasos siguientes

Ya sabe cómo usar el editor de código de Stream Analytics para crear un trabajo que capture los datos de Event Hubs para Azure Data Lake Storage Gen2 en formato de Delta Lake. A continuación, puede obtener más información sobre Azure Stream Analytics y cómo supervisar el trabajo que ha creado.