Skalieren von Azure OpenAI für Python mit Azure API Management

Erfahren Sie, wie Sie Ihrer Anwendung lastenausgleich auf Unternehmensniveau hinzufügen, um die Chat-App über die Azure OpenAI-Token- und Modellkontingentgrenzen hinaus zu erweitern. Dieser Ansatz verwendet Azure API Management, um den Datenverkehr zwischen drei Azure OpenAI-Ressourcen intelligent zu leiten.

In diesem Artikel müssen Sie zwei separate Beispiele bereitstellen:

Chat-App

- Wenn Sie die Chat-App noch nicht bereitgestellt haben, warten Sie, bis das Beispiel zum Lastenausgleich bereitgestellt wurde.

- Wenn Sie die Chat-App bereits einmal bereitgestellt haben, ändern Sie die Umgebungsvariable so, dass ein benutzerdefinierter Endpunkt für das Lastenausgleichsmodul unterstützt und erneut bereitgestellt wird.

Lastenausgleich mit Azure API Management

Hinweis

In diesem Artikel werden eine oder mehrere KI-App-Vorlagen als Grundlage für die Beispiele und Anleitungen im Artikel verwendet. KI-App-Vorlagen bieten Ihnen gut Standard tained, einfach bereitzustellende Referenzimplementierungen, die helfen, einen qualitativ hochwertigen Ausgangspunkt für Ihre KI-Apps zu gewährleisten.

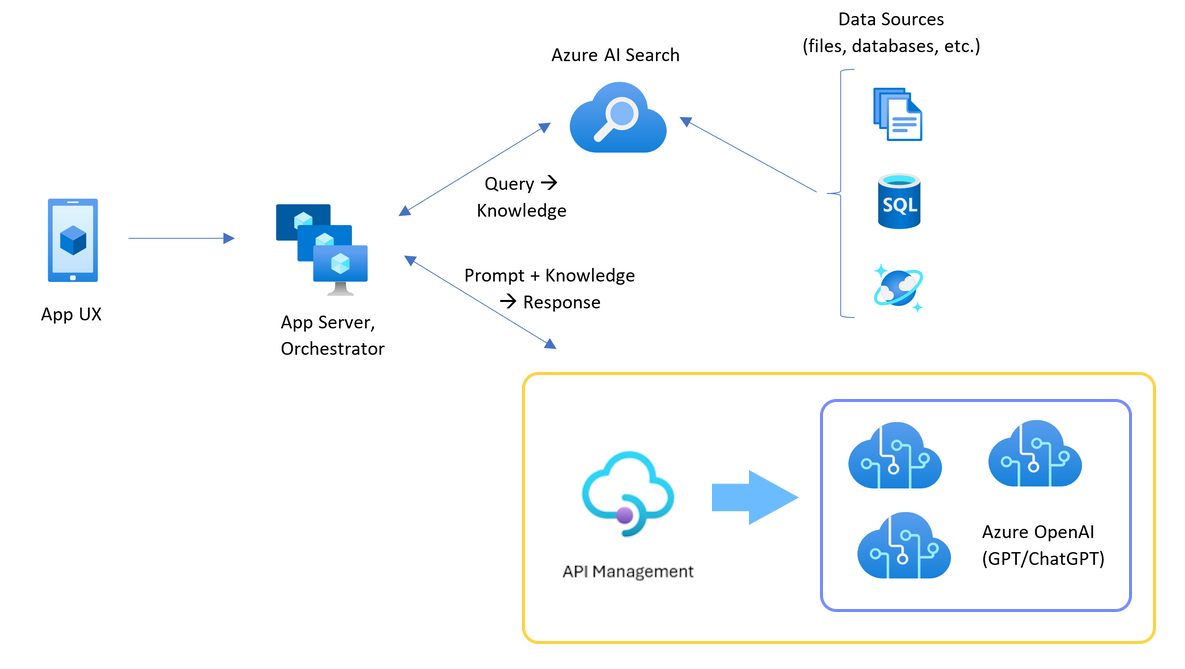

Architektur für den Lastenausgleich von Azure OpenAI mit Azure API Management

Da die Azure OpenAI-Ressource bestimmte Token- und Modellkontingentbeschränkungen aufweist, ist eine Chat-App mit einer einzelnen Azure OpenAI-Ressource anfällig für Unterhaltungsfehler aufgrund dieser Grenzwerte.

Um die Chat-App zu verwenden, ohne diese Grenzwerte zu erreichen, verwenden Sie eine Lastenausgleichslösung mit Azure API Management. Diese Lösung macht einen einzelnen Endpunkt von Azure API Management nahtlos für Ihren Chat-App-Server verfügbar.

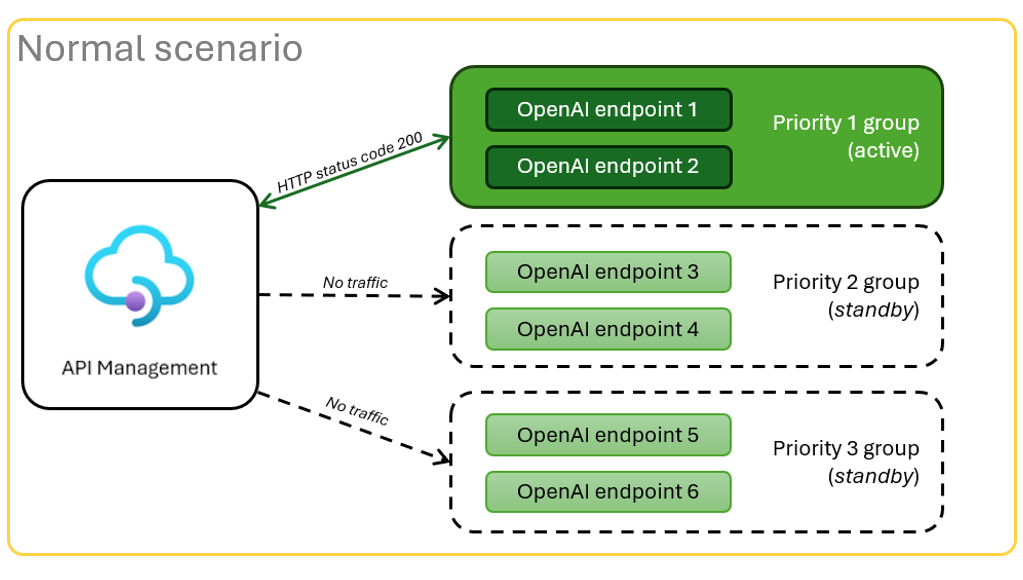

Die Azure API Management-Ressource als API-Ebene befindet sich vor einer Reihe von Azure OpenAI-Ressourcen. Die API-Ebene gilt für zwei Szenarien: normal und gedrosselt. Während eines normalen Szenarios , in dem Token- und Modellkontingent verfügbar ist, gibt die Azure OpenAI-Ressource eine 200 zurück über die API-Ebene und den Back-End-App-Server zurück.

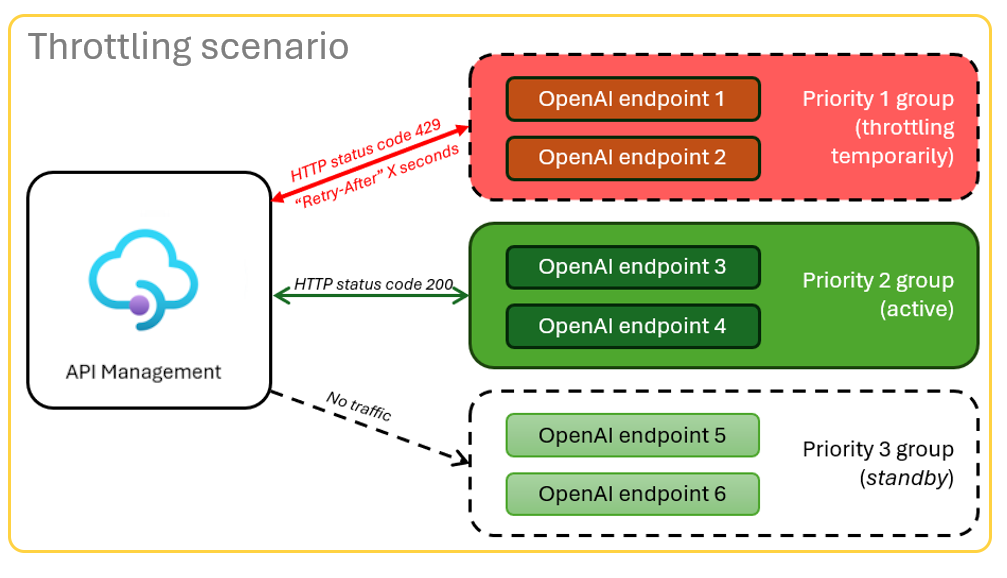

Wenn eine Ressource aufgrund von Kontingentbeschränkungen gedrosselt wird, kann die API-Ebene eine andere Azure OpenAI-Ressource sofort wiederholen, um die ursprüngliche Chat-App-Anforderung zu erfüllen.

Voraussetzungen

Azure-Abonnement. Kostenloses Konto erstellen

Zugriff auf Azure OpenAI im gewünschten Azure-Abonnement gewährt.

Derzeit wird der Zugriff auf diesen Dienst nur auf Antrag gewährt. Sie können den Zugriff auf Azure OpenAI beantragen, indem Sie das Formular unter https://aka.ms/oai/access ausfüllen.

Dev-Container sind für beide Beispiele verfügbar, wobei alle Abhängigkeiten erforderlich sind, um diesen Artikel abzuschließen. Sie können die Dev-Container in GitHub-Codespaces (in einem Browser) oder lokal mit Visual Studio Code ausführen.

- Es ist nur ein GitHub-Konto erforderlich, um Codespaces zu verwenden.

Open Azure API Management local balancer sample app

GitHub Codespaces führt einen von GitHub verwalteten Entwicklungscontainer mit Visual Studio Code für Web als Benutzeroberfläche aus. Verwenden Sie für die einfachste Entwicklungsumgebung GitHub Codespaces, damit Sie die richtigen Entwicklertools und Abhängigkeiten vorinstalliert haben, um diesen Artikel abzuschließen.

Wichtig

Alle GitHub-Konten können Codespaces für bis zu 60 Stunden pro Monat mit zwei Kerninstanzen kostenlos verwenden. Weitere Informationen finden Sie im Artikel zu monatlich enthaltener Speicherkapazität und Kernstunden in GitHub Codespaces.

Bereitstellen des Lastenausgleichs für Azure API Management

Um das Lastenausgleichsmodul für Azure bereitzustellen, melden Sie sich bei Azure Developer CLI (AZD) an.

azd auth loginSchließen Sie die Anmeldeanweisungen ab.

Stellen Sie die Lastenausgleichs-App bereit.

azd upSie müssen ein Abonnement und eine Region für die Bereitstellung auswählen. Diese müssen nicht dasselbe Abonnement und dieselbe Region wie die Chat-App sein.

Warten Sie auf den Abschluss der Bereitstellung, bevor Sie fortfahren. Dies kann bis zu 30 Minuten dauern.

Abrufen des Lastenausgleichsendpunkts

Führen Sie den folgenden Bash-Befehl aus, um die Umgebungsvariablen aus der Bereitstellung anzuzeigen. Sie benötigen diese Informationen später.

azd env get-values | grep APIM_GATEWAY_URL

Erneutes Bereitstellen einer Chat-App mit Lastenausgleichsendpunkt

Dies wird im Beispiel der Chat-App abgeschlossen.

Öffnen Sie den Dev-Container des Chat-App-Beispiels mit einer der folgenden Optionen.

Sprache Codespaces Visual Studio Code .NET JavaScript Python Melden Sie sich bei Azure Developer CLI (AZD) an.

azd auth loginSchließen Sie die Anmeldeanweisungen ab.

Erstellen Sie eine AZD-Umgebung mit einem Namen wie z. B.

chat-app.azd env new <name>Fügen Sie die folgende Umgebungsvariable hinzu, die das Backend der Chat-App anweist, eine benutzerdefinierte URL für die OpenAI-Anfragen zu verwenden.

azd env set OPENAI_HOST azure_customFügen Sie die folgende Umgebungsvariable hinzu, die das Backend der Chat-App anweist, eine benutzerdefinierte URL für die OpenAI-Anfragen zu verwenden.

azd env set AZURE_OPENAI_CUSTOM_URL <APIM_GATEWAY_URL>Stellen Sie die Chat-App bereit.

azd up

Konfigurieren der Token pro Minute-Kontingent (TPM)

Standardmäßig werden alle OpenAI-Instanzen im Lastenausgleich mit einer Kapazität von 30.000 TPM (Token pro Minute) bereitgestellt. Sie können die Chat-App mit dem Vertrauen verwenden, dass sie für viele Benutzer entwickelt wurde, ohne dass das Kontingent überschritten wird. Ändern Sie diesen Wert in folgenden Fällen:

- Sie erhalten Fehler bei der Bereitstellungskapazität: Verringern Sie diesen Wert.

- Wenn Sie eine höhere Kapazität planen, erhöhen Sie den Wert.

Verwenden Sie den folgenden Befehl, um den Wert zu ändern.

azd env set OPENAI_CAPACITY 50Stellen Sie den Lastenausgleich erneut bereit.

azd up

Bereinigen von Ressourcen

Wenn Sie mit der Chat-App und dem Lastenausgleich fertig sind, bereinigen Sie die Ressourcen. Die in diesem Artikel erstellten Azure-Ressourcen werden Ihrem Azure-Abonnement in Rechnung gestellt. Wenn Sie nicht erwarten, dass diese Ressourcen in Zukunft benötigt werden, löschen Sie sie, um weitere Gebühren zu vermeiden.

Bereinigen Sie die Chat-App-Ressourcen

Kehren Sie zum Artikel der Chat-App zurück, um diese Ressourcen zu bereinigen.

Bereinigen von Lastenausgleichsressourcen

Führen Sie den folgenden Azure Developer CLI-Befehl aus, um die Azure-Ressourcen zu löschen und den Quellcode zu entfernen:

azd down --purge --force

Die Schalter bieten:

purge: Gelöschte Ressourcen werden sofort endgültig gelöscht. Auf diese Weise können Sie das Azure OpenAI-TPM wiederverwenden.force: Der Löschvorgang erfolgt im Hintergrund, ohne dass die Zustimmung des Benutzers erforderlich ist.

Bereinigen von GitHub-Codespaces

Durch das Löschen der GitHub Codespaces-Umgebung wird sichergestellt, dass Sie die Anzahl der kostenlosen Berechtigungsstunden pro Kern maximieren können, die Sie für Ihr Konto erhalten.

Wichtig

Weitere Informationen zu den Berechtigungen Ihres GitHub-Kontos finden Sie im Artikel zu monatlich enthaltener Speicherkapazität und Kernstunden in GitHub Codespaces.

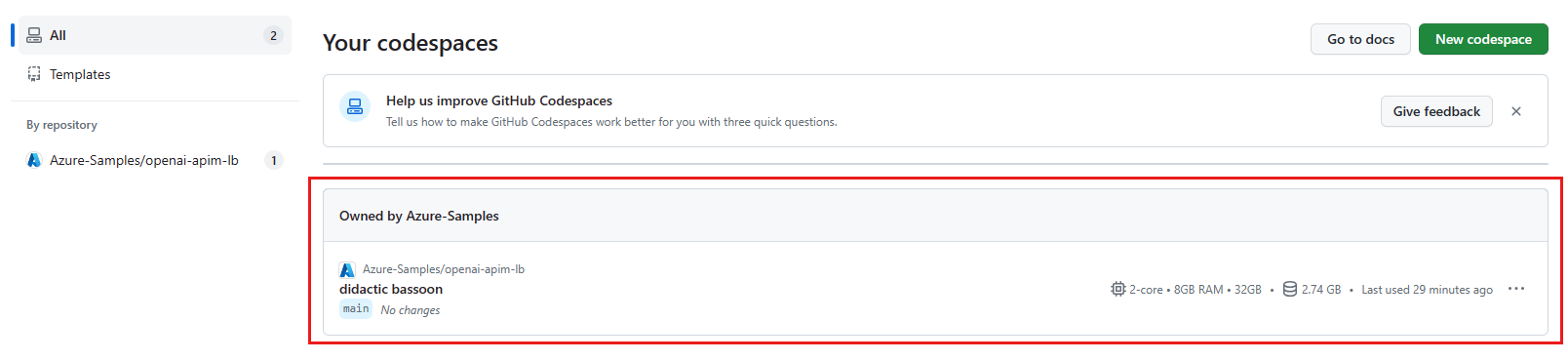

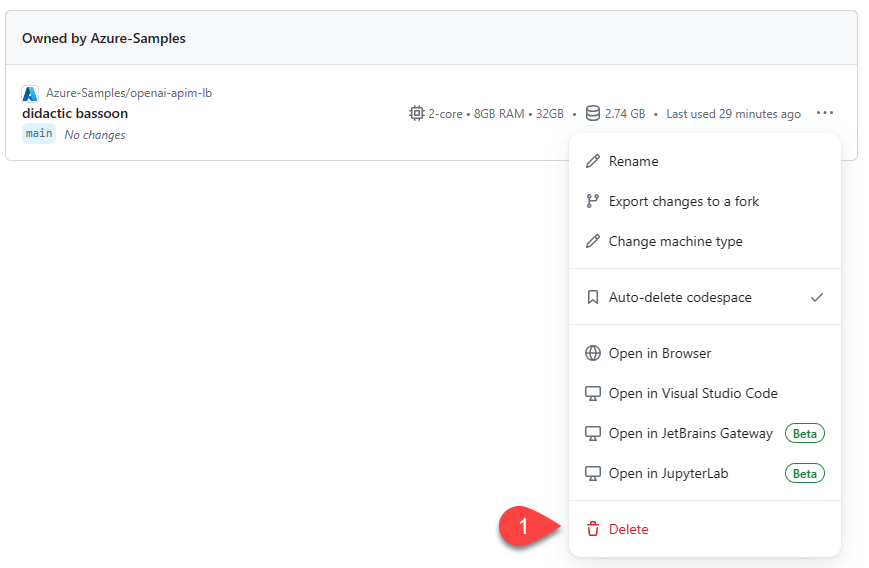

Melden Sie sich beim GitHub Codespaces-Dashboard (https://github.com/codespaces) an.

Suchen Sie Ihre derzeit ausgeführten Codespaces, die aus dem GitHub-Repository

azure-samples/openai-apim-lbstammen.

Öffnen Sie das Kontextmenü für das Codespaces-Element, und wählen Sie dann "Löschen" aus.

Hilfe erhalten

Wenn Sie Probleme beim Bereitstellen des Azure API Management-Lastenausgleichs haben, protokollieren Sie Ihr Problem mit den Problemen des Repositorys.

Beispielcode

Beispiele, die in diesem Artikel verwendet werden, umfassen:

Nächster Schritt

- Anzeigen von Azure API Management-Diagnosedaten in Azure Monitor

- Verwenden von Azure Load Testing zum Laden des Tests Ihrer Chat-App mit