Erkunden von Risiken für generative KI-Artefakte vor der Bereitstellung

Der Plan Defender Cloud Security Posture Management (CSPM) in Microsoft Defender for Cloud hilft Ihnen, die Sicherheitslage von generativen KI-Apps zu verbessern, indem er Sicherheitslücken in generativen KI-Bibliotheken identifiziert, die in Ihren KI-Artefakten wie Container-Images und Code-Repositorys vorhanden sind. In diesem Artikel erfahren Sie, wie Sie die Sicherheitsrisiken für diese Anwendungen ermitteln und identifizieren können.

Voraussetzungen

Lesen Sie mehr über die KI-Sicherheitsstatusverwaltung.

Erfahren Sie mehr über die Untersuchung von Risiken mit dem Cloudsicherheits-Explorer und Angriffspfaden.

Sie benötigen ein Microsoft Azure -Abonnement. Sollten Sie über kein Azure-Abonnement verfügen, können Sie sich für ein kostenloses Abonnement registrieren.

Aktivieren von Defender for Cloud in Ihrem Azure-Abonnement.

Aktivieren Sie Defender Cloud Security Posture Management (CSPM) in Ihrem Azure-Abonnement.

Sie verfügen über mindestens eine Azure OpenAI-Ressource, wobei mindestens eine Modellimplementierung über das Azure AI Foundry-Portal verbunden ist.

Identifizieren Sie Container, die auf anfälligen generativen KI-Containerimages ausgeführt werden

Der Cloudsicherheitsexplorer kann verwendet werden, um Container zu identifizieren, auf denen generative KI-Container-Images mit bekannten Sicherheitslücken ausgeführt werden.

Melden Sie sich beim Azure-Portal an.

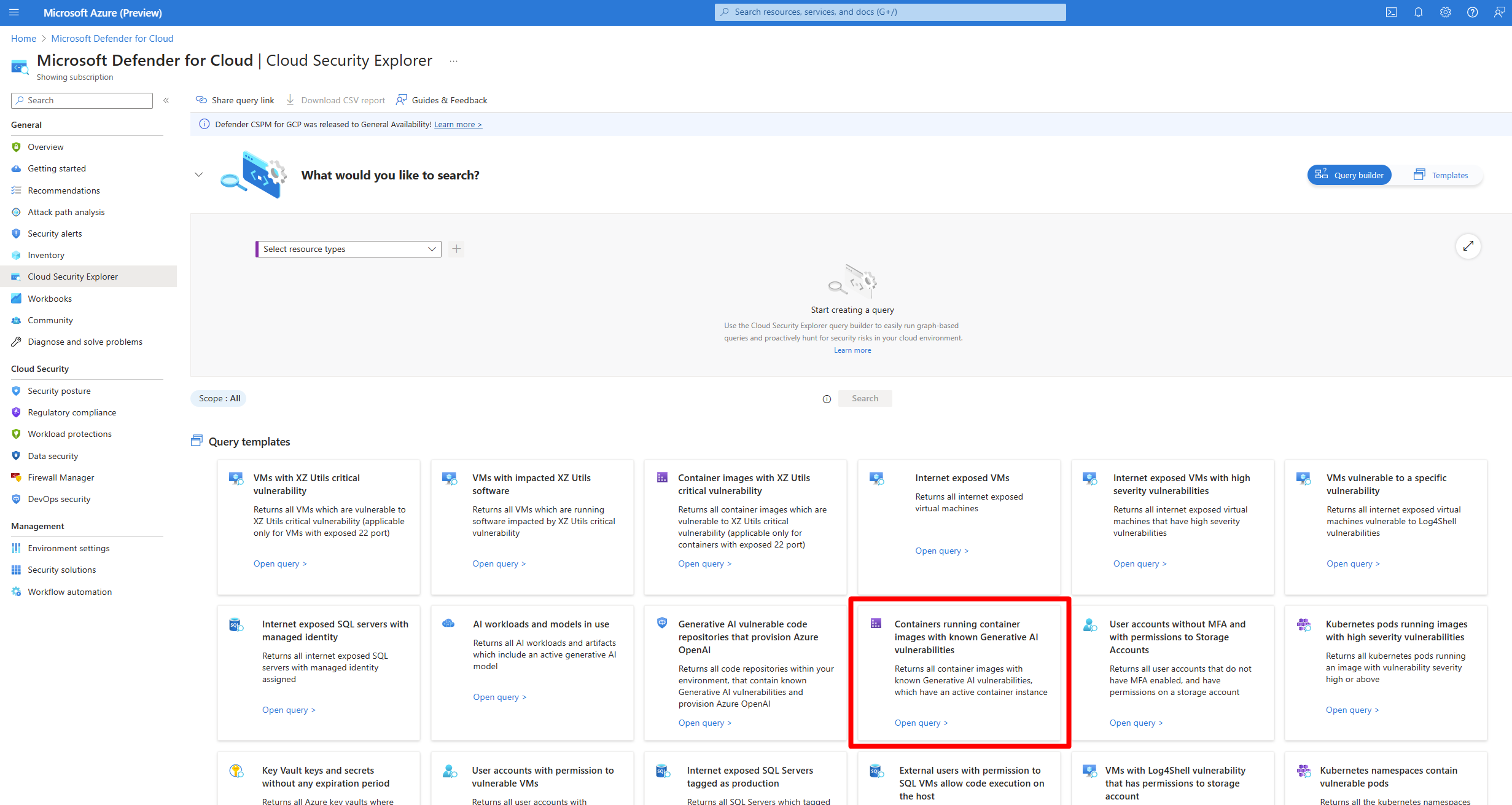

Suchen Sie nach Microsoft Defender for Cloud>Cloudsicherheits-Explorer, und wählen Sie dies aus.

Wählen Sie die Abfragevorlage Container, die Containerimages mit bekannten generativen KI-Sicherheitsrisiken ausführen aus.

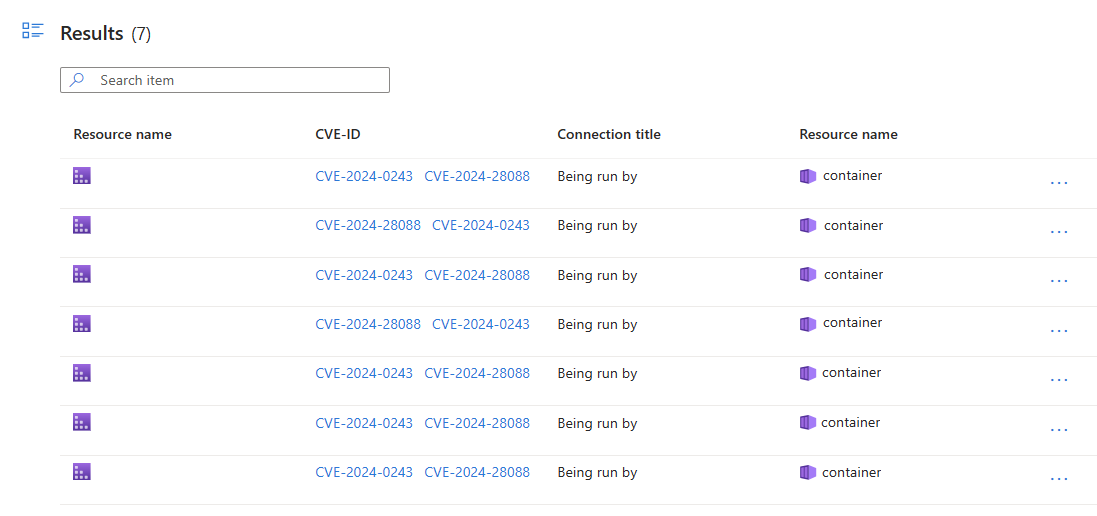

Klicken Sie auf Suchen.

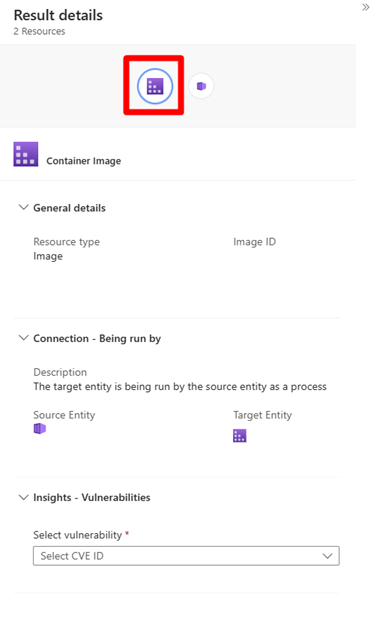

Wählen Sie ein Ergebnis aus, um die Details zu überprüfen.

Wählen Sie einen Knoten aus, um die Ergebnisse zu überprüfen.

Wählen Sie im Abschnitt Einblicke eine CVE-ID aus dem Dropdownmenü aus.

Wählen Sie Seite „Sicherheitsrisiko“ öffnen aus.

Identifizieren anfälliger generativer KI-Coderepositorys

Der Cloudsicherheitsexplorer kann verwendet werden, um anfällige generative KI-Coderepositorys zu identifizieren, die Azure OpenAI bereitstellen.

Melden Sie sich beim Azure-Portal an.

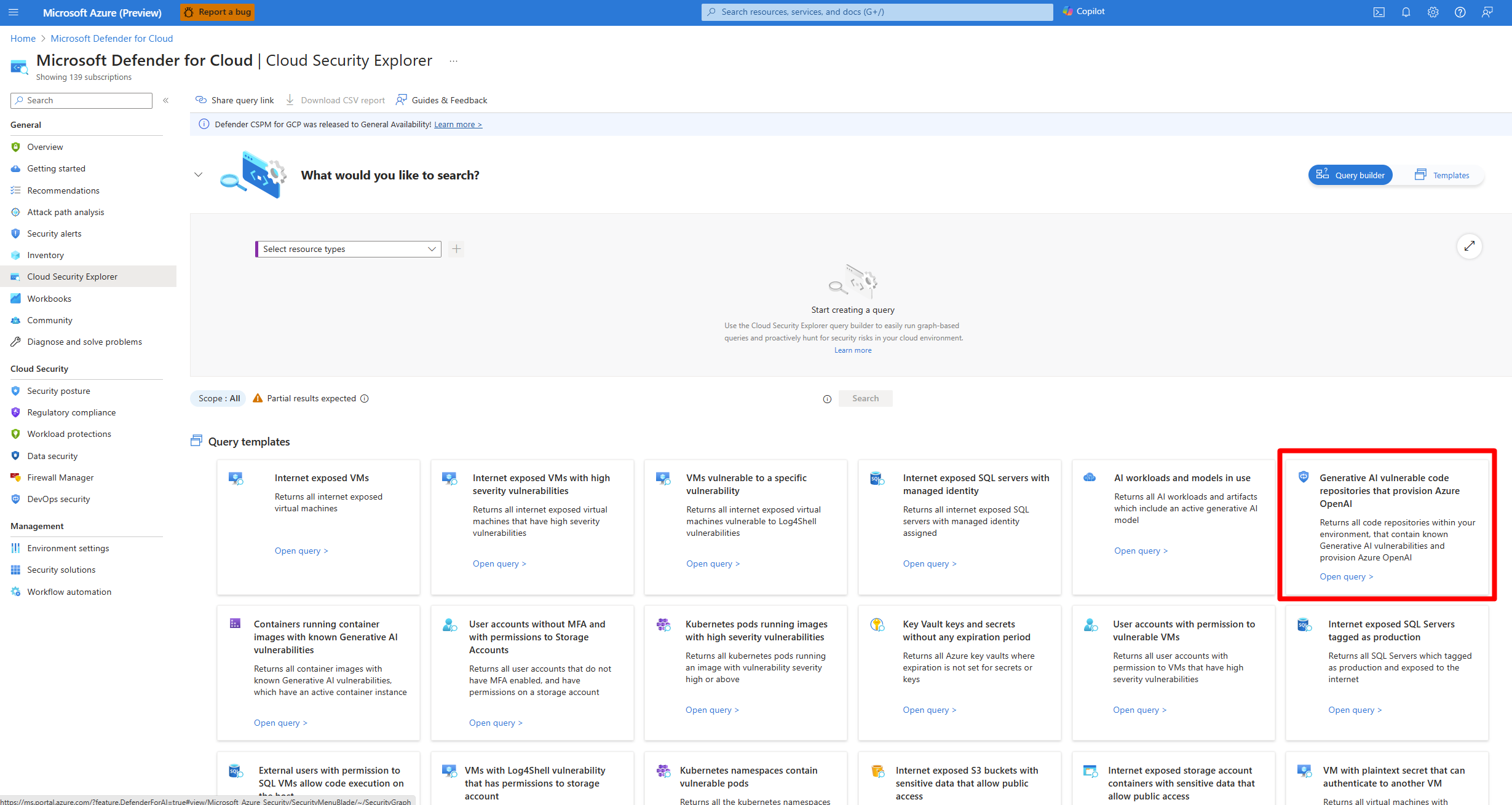

Suchen Sie nach Microsoft Defender for Cloud>Cloudsicherheits-Explorer, und wählen Sie dies aus.

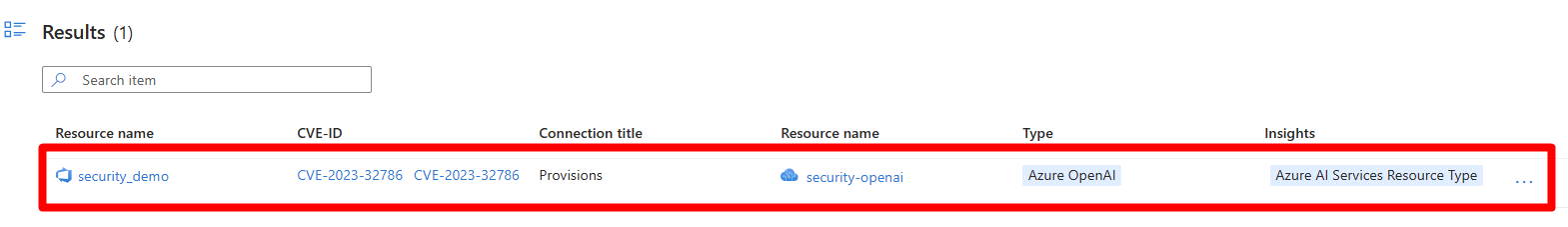

Wählen Sie die Abfragevorlage Sicherheitslücken in der generativen KI, die Azure OpenAI bereitstellt aus.

Klicken Sie auf Suchen.

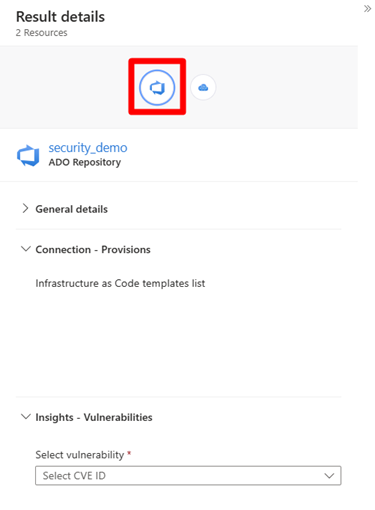

Wählen Sie ein Ergebnis aus, um die Details zu überprüfen.

Wählen Sie einen Knoten aus, um die Ergebnisse zu überprüfen.

Wählen Sie im Abschnitt Einblicke eine CVE-ID aus dem Dropdownmenü aus.

Wählen Sie Seite „Sicherheitsrisiko“ öffnen aus.