Einrichtung von Mikrofon und Kamera vor einem Anruf mithilfe der Benutzeroberflächenbibliothek von Azure Communication Services

Wichtig

Dieses Feature von Azure Communication Services befindet sich derzeit in der Vorschau.

Vorschau-APIs und -SDKs werden ohne Vereinbarung zum Servicelevel bereitgestellt. Es wird empfohlen, diese nicht für Produktionsworkloads zu verwenden. Einige Features werden möglicherweise nicht unterstützt oder bieten nur eingeschränkte Funktionalität.

Weitere Informationen finden Sie in den ergänzenden Nutzungsbestimmungen für Microsoft Azure-Vorschauversionen.

Dieses Tutorial gehört zu einer dreiteiligen Reihe von Tutorials zur Vorbereitung auf Anrufe und ist die Fortsetzung der vorherigen zwei Teile:

- Sicherstellen, dass ein unterstützter Browser verwendet wird.

- Anfordern von Kamera- und Mikrofonzugriff.

Code herunterladen

Greifen Sie auf den vollständigen Quellcode für dieses Tutorial auf GitHub zu.

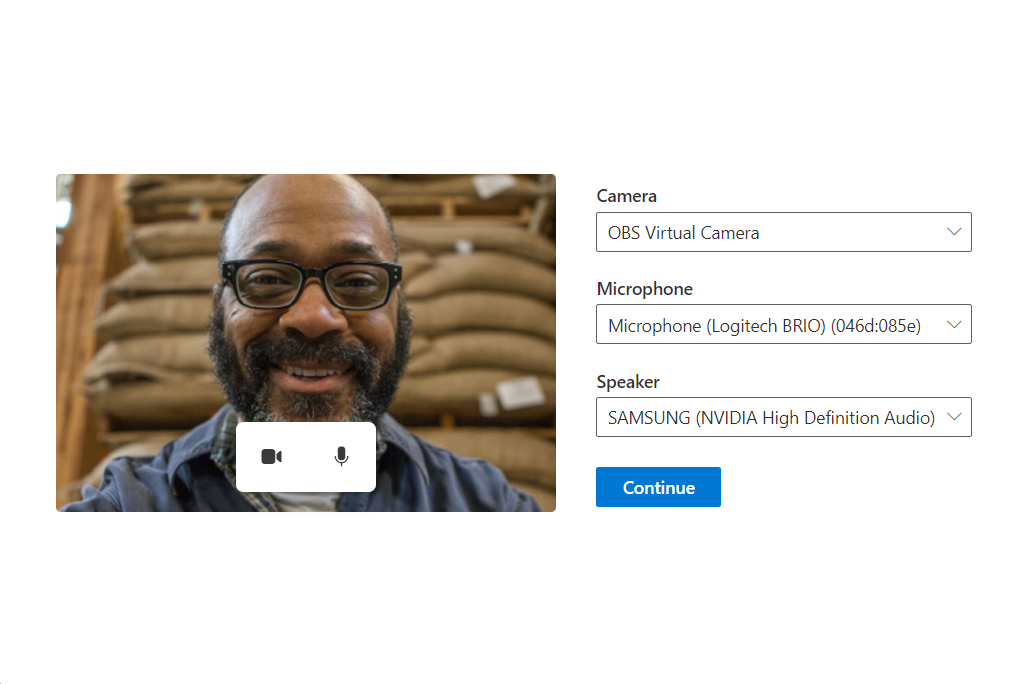

Dem Benutzenden die Wahl seiner Kamera, des Mikrofons und des Lautsprechers erlauben

In den beiden vorherigen Teilen des Tutorials befindet sich der Benutzende in einem unterstützten Browser, und er hat uns die Berechtigung erteilt, auf seine Kamera und sein Mikrofon zuzugreifen. Wir können jetzt sicherstellen, dass der Benutzende das richtige Mikrofon, die richtige Kamera und den richtigen Lautsprecher für seinen Anruf auswählen kann. Wir präsentieren dem Benutzenden eine umfassende Benutzeroberfläche zur Auswahl von Kamera, Mikrofon und Lautsprecher. Unsere abschließende Benutzeroberfläche für die Geräteeinrichtung sieht wie folgt aus:

Erstellen eines Konfigurationsbildschirms

Zuerst erstellen wir eine neue Datei namens DeviceSetup.tsx und fügen Einrichtungscode mit einem Rückruf hinzu, der die ausgewählten Geräte der Benutzenden zur App zurückgibt:

src/DeviceSetup.tsx

import { PrimaryButton, Stack } from '@fluentui/react';

export const DeviceSetup = (props: {

/** Callback to let the parent component know what the chosen user device settings were */

onDeviceSetupComplete: (userChosenDeviceState: { cameraOn: boolean; microphoneOn: boolean }) => void

}): JSX.Element => {

return (

<Stack tokens={{ childrenGap: '1rem' }} verticalAlign="center" verticalFill>

<PrimaryButton text="Continue" onClick={() => props.onDeviceSetupComplete({ cameraOn: false, microphoneOn: false })} />

</Stack>

);

}

Anschließend können wir dieses DeviceSetup unserer App hinzufügen.

- Wenn PreCallChecksComponent abgeschlossen ist, wird der Benutzende in den Zustand

deviceSetupweitergeleitet. - Wenn sich der Benutzende im Zustand

deviceSetupbefindet, rendern wir die KomponenteDeviceSetup. - Wenn die Geräteeinrichtung abgeschlossen ist, wird der Benutzende in den Zustand

finishedweitergeleitet. In einer Produktions-App ist dies in der Regel der Fall, wenn Sie den Benutzenden auf einen Anrufbildschirm leiten.

Importieren Sie zuerst die von uns erstellte Komponente „DeviceSetup“:

src/App.tsx

import { DeviceSetup } from './DeviceSetup';

Aktualisieren Sie dann die App so, dass sie einen neuen Teststatus deviceSetup aufweist:

type TestingState = 'runningEnvironmentChecks' | 'runningDeviceAccessChecks' | 'deviceSetup' | 'finished';

Aktualisieren Sie schließlich unsere Komponente App, um die App auf die Geräteeinrichtung umzustellen, nachdem die Gerätezugriffsprüfungen abgeschlossen sind:

/**

* Entry point of a React app.

*

* This shows a PreparingYourSession component while the CallReadinessChecks are running.

* Once the CallReadinessChecks are finished, the TestComplete component is shown.

*/

const App = (): JSX.Element => {

const [testState, setTestState] = useState<TestingState>('runningEnvironmentChecks');

return (

<FluentThemeProvider>

<CallClientProvider callClient={callClient}>

{/* Show a Preparing your session screen while running the environment checks */}

{testState === 'runningEnvironmentChecks' && (

<>

<PreparingYourSession />

<EnvironmentChecksComponent onTestsSuccessful={() => setTestState('runningDeviceAccessChecks')} />

</>

)}

{/* Show a Preparing your session screen while running the device access checks */}

{testState === 'runningDeviceAccessChecks' && (

<>

<PreparingYourSession />

<DeviceAccessChecksComponent onTestsSuccessful={() => setTestState('deviceSetup')} />

</>

)}

{/* After the initial checks are complete, take the user to a device setup page call readiness checks are finished */}

{testState === 'deviceSetup' && (

<DeviceSetup

onDeviceSetupComplete={(userChosenDeviceState) => {

setTestState('finished');

}}

/>

)}

{/* After the device setup is complete, take the user to the call. For this sample we show a test complete page. */}

{testState === 'finished' && <TestComplete />}

</CallClientProvider>

</FluentThemeProvider>

);

}

Abrufen und Aktualisieren von Mikrofon-, Kamera- und Lautsprecherlisten vom zustandsbehafteten Client

Um dem Benutzenden eine Liste der auswählbaren Kameras, Mikrofone und Lautsprecher zu präsentieren, können wir den zustandsbehafteten Anrufclient verwenden.

Hier erstellen wir eine Reihe von React-Hooks. Diese React-Hooks verwenden den Aufrufclient, um verfügbare Geräte abzufragen.

Die Hooks stellen sicher, dass unsere Anwendung immer dann erneut gerendert wird, wenn sich die Liste ändert, z. B. wenn eine neue Kamera an den Computer des Benutzenden angeschlossen wird.

Für diese Hooks erstellen wir eine Datei namens deviceSetupHooks.ts und erstellen drei Hooks: useMicrophones, useSpeakers und useCameras.

Jeder dieser Hooks verwendet useCallClientStateChange, um seine Listen zu aktualisieren, wenn der Benutzende ein Gerät ein-/aussteckt:

src/deviceSetupHooks.ts

import { AudioDeviceInfo, VideoDeviceInfo } from "@azure/communication-calling";

import { CallClientState, StatefulDeviceManager, useCallClient, VideoStreamRendererViewState } from "@azure/communication-react";

import { useCallback, useEffect, useRef, useState } from "react";

/** A helper hook to get and update microphone device information */

export const useMicrophones = (): {

microphones: AudioDeviceInfo[],

selectedMicrophone: AudioDeviceInfo | undefined,

setSelectedMicrophone: (microphone: AudioDeviceInfo) => Promise<void>

} => {

const callClient = useCallClient();

useEffect(() => {

callClient.getDeviceManager().then(deviceManager => deviceManager.getMicrophones())

}, [callClient]);

const setSelectedMicrophone = async (microphone: AudioDeviceInfo) =>

(await callClient.getDeviceManager()).selectMicrophone(microphone);

const state = useCallClientStateChange();

return {

microphones: state.deviceManager.microphones,

selectedMicrophone: state.deviceManager.selectedMicrophone,

setSelectedMicrophone

};

}

/** A helper hook to get and update speaker device information */

export const useSpeakers = (): {

speakers: AudioDeviceInfo[],

selectedSpeaker: AudioDeviceInfo | undefined,

setSelectedSpeaker: (speaker: AudioDeviceInfo) => Promise<void>

} => {

const callClient = useCallClient();

useEffect(() => {

callClient.getDeviceManager().then(deviceManager => deviceManager.getSpeakers())

}, [callClient]);

const setSelectedSpeaker = async (speaker: AudioDeviceInfo) =>

(await callClient.getDeviceManager()).selectSpeaker(speaker);

const state = useCallClientStateChange();

return {

speakers: state.deviceManager.speakers,

selectedSpeaker: state.deviceManager.selectedSpeaker,

setSelectedSpeaker

};

}

/** A helper hook to get and update camera device information */

export const useCameras = (): {

cameras: VideoDeviceInfo[],

selectedCamera: VideoDeviceInfo | undefined,

setSelectedCamera: (camera: VideoDeviceInfo) => Promise<void>

} => {

const callClient = useCallClient();

useEffect(() => {

callClient.getDeviceManager().then(deviceManager => deviceManager.getCameras())

}, [callClient]);

const setSelectedCamera = async (camera: VideoDeviceInfo) =>

(await callClient.getDeviceManager() as StatefulDeviceManager).selectCamera(camera);

const state = useCallClientStateChange();

return {

cameras: state.deviceManager.cameras,

selectedCamera: state.deviceManager.selectedCamera,

setSelectedCamera

};

}

/** A helper hook to act when changes to the stateful client occur */

const useCallClientStateChange = (): CallClientState => {

const callClient = useCallClient();

const [state, setState] = useState<CallClientState>(callClient.getState());

useEffect(() => {

const updateState = (newState: CallClientState) => {

setState(newState);

}

callClient.onStateChange(updateState);

return () => {

callClient.offStateChange(updateState);

};

}, [callClient]);

return state;

}

Erstellen von Dropdownlisten zum Auswählen von Geräten

Damit der Benutzer seine Kamera, sein Mikrofon und seinen Lautsprecher auswählen kann, verwenden wir die Komponente Dropdown aus der Fluent-Benutzeroberfläche React.

Wir erstellen neue Komponenten, die die Hooks verwenden, die wir in deviceSetupHooks.tsx erstellt haben, um die Dropdownliste aufzufüllen und das ausgewählte Gerät zu aktualisieren, wenn der Benutzende ein anderes Gerät aus der Dropdownliste auswählt.

Um diese neuen Komponenten zu speichern, erstellen wir eine Datei namens DeviceSelectionComponents.tsx, die drei neue Komponenten exportiert: CameraSelectionDropdown, MicrophoneSelectionDropdown und SpeakerSelectionDropdown.

src/DeviceSelectionComponents.tsx

import { Dropdown } from '@fluentui/react';

import { useCameras, useMicrophones, useSpeakers } from './deviceSetupHooks';

/** Dropdown that allows the user to choose their desired camera */

export const CameraSelectionDropdown = (): JSX.Element => {

const { cameras, selectedCamera, setSelectedCamera } = useCameras();

return (

<DeviceSelectionDropdown

placeholder={cameras.length === 0 ? 'No cameras found' : 'Select a camera'}

label={'Camera'}

devices={cameras}

selectedDevice={selectedCamera}

onSelectionChange={(selectedDeviceId) => {

const newlySelectedCamera = cameras.find((camera) => camera.id === selectedDeviceId);

if (newlySelectedCamera) {

setSelectedCamera(newlySelectedCamera);

}

}}

/>

);

};

/** Dropdown that allows the user to choose their desired microphone */

export const MicrophoneSelectionDropdown = (): JSX.Element => {

const { microphones, selectedMicrophone, setSelectedMicrophone } = useMicrophones();

return (

<DeviceSelectionDropdown

placeholder={microphones.length === 0 ? 'No microphones found' : 'Select a microphone'}

label={'Microphone'}

devices={microphones}

selectedDevice={selectedMicrophone}

onSelectionChange={(selectedDeviceId) => {

const newlySelectedMicrophone = microphones.find((microphone) => microphone.id === selectedDeviceId);

if (newlySelectedMicrophone) {

setSelectedMicrophone(newlySelectedMicrophone);

}

}}

/>

);

};

/** Dropdown that allows the user to choose their desired speaker */

export const SpeakerSelectionDropdown = (): JSX.Element => {

const { speakers, selectedSpeaker, setSelectedSpeaker } = useSpeakers();

return (

<DeviceSelectionDropdown

placeholder={speakers.length === 0 ? 'No speakers found' : 'Select a speaker'}

label={'Speaker'}

devices={speakers}

selectedDevice={selectedSpeaker}

onSelectionChange={(selectedDeviceId) => {

const newlySelectedSpeaker = speakers.find((speaker) => speaker.id === selectedDeviceId);

if (newlySelectedSpeaker) {

setSelectedSpeaker(newlySelectedSpeaker);

}

}}

/>

);

};

const DeviceSelectionDropdown = (props: {

placeholder: string,

label: string,

devices: { id: string, name: string }[],

selectedDevice: { id: string, name: string } | undefined,

onSelectionChange: (deviceId: string | undefined) => void

}): JSX.Element => {

return (

<Dropdown

placeholder={props.placeholder}

label={props.label}

options={props.devices.map((device) => ({ key: device.id, text: device.name }))}

selectedKey={props.selectedDevice?.id}

onChange={(_, option) => props.onSelectionChange?.(option?.key as string | undefined)}

/>

);

};

Hinzufügen von Dropdownlisten zur Geräteeinrichtung

Die Dropdownlisten für Kamera, Mikrofon und Lautsprecher können dann der Komponente „DeviceSetup“ hinzugefügt werden.

Importieren Sie zunächst die neuen Dropdownlisten:

src/DeviceSetup.tsx

import { CameraSelectionDropdown, MicrophoneSelectionDropdown, SpeakerSelectionDropdown } from './DeviceSelectionComponents';

Erstellen Sie dann eine Komponente namens DeviceSetup, die diese Dropdownlisten enthält. Diese Komponente enthält die lokale Videovorschau, die wir später erstellen.

export const DeviceSetup = (props: {

/** Callback to let the parent component know what the chosen user device settings were */

onDeviceSetupComplete: (userChosenDeviceState: { cameraOn: boolean; microphoneOn: boolean }) => void

}): JSX.Element => {

return (

<Stack verticalFill verticalAlign="center" horizontalAlign="center" tokens={{ childrenGap: '1rem' }}>

<Stack horizontal tokens={{ childrenGap: '2rem' }}>

<Stack tokens={{ childrenGap: '1rem' }} verticalAlign="center" verticalFill>

<CameraSelectionDropdown />

<MicrophoneSelectionDropdown />

<SpeakerSelectionDropdown />

<Stack.Item styles={{ root: { paddingTop: '0.5rem' }}}>

<PrimaryButton text="Continue" onClick={() => props.onDeviceSetupComplete({ cameraOn: false, microphoneOn: false })} />

</Stack.Item>

</Stack>

</Stack>

</Stack>

);

};

Erstellen einer lokalen Videovorschau

Neben den Dropdownlisten erstellen wir eine lokale Videovorschau, damit der Benutzende sehen kann, was seine Kamera erfasst. Sie enthält eine kleine Anrufsteuerungsleiste mit Schaltflächen für Kamera und Mikrofon, mit denen Sie die Kamera ein- und ausschalten und das Mikrofon stumm schalten können.

Zuerst fügen wir einen neuen Hook zu unserem deviceSetupHooks.ts namens useLocalPreview hinzu. Dieser Hook bietet unserer React-Komponente eine lokale Vorschau zum Rendern und Funktionen zum Starten und Beenden der lokalen Vorschau:

src/deviceSetupHooks.ts

/** A helper hook to providing functionality to create a local video preview */

export const useLocalPreview = (): {

localPreview: VideoStreamRendererViewState | undefined,

startLocalPreview: () => Promise<void>,

stopLocalPreview: () => void

} => {

const callClient = useCallClient();

const state = useCallClientStateChange();

const localPreview = state.deviceManager.unparentedViews[0];

const startLocalPreview = useCallback(async () => {

const selectedCamera = state.deviceManager.selectedCamera;

if (!selectedCamera) {

console.warn('no camera selected to start preview with');

return;

}

callClient.createView(

undefined,

undefined,

{

source: selectedCamera,

mediaStreamType: 'Video'

},

{

scalingMode: 'Crop'

}

);

}, [callClient, state.deviceManager.selectedCamera]);

const stopLocalPreview = useCallback(() => {

if (!localPreview) {

console.warn('no local preview ti dispose');

return;

}

callClient.disposeView(undefined, undefined, localPreview)

}, [callClient, localPreview]);

const selectedCameraRef = useRef(state.deviceManager.selectedCamera);

useEffect(() => {

if (selectedCameraRef.current !== state.deviceManager.selectedCamera) {

stopLocalPreview();

startLocalPreview();

selectedCameraRef.current = state.deviceManager.selectedCamera;

}

}, [startLocalPreview, state.deviceManager.selectedCamera, stopLocalPreview]);

return {

localPreview: localPreview?.view,

startLocalPreview,

stopLocalPreview

}

}

Anschließend erstellen wir eine neue Komponente namens LocalPreview.tsx, die diesen Hook verwendet, um dem Benutzenden die lokale Videovorschau anzuzeigen:

src/LocalPreview.tsx

import { StreamMedia, VideoTile, ControlBar, CameraButton, MicrophoneButton, useTheme } from '@azure/communication-react';

import { Stack, mergeStyles, Text, ITheme } from '@fluentui/react';

import { VideoOff20Filled } from '@fluentui/react-icons';

import { useEffect } from 'react';

import { useCameras, useLocalPreview } from './deviceSetupHooks';

/** LocalPreview component has a camera and microphone toggle buttons, along with a video preview of the local camera. */

export const LocalPreview = (props: {

cameraOn: boolean,

microphoneOn: boolean,

cameraToggled: (isCameraOn: boolean) => void,

microphoneToggled: (isMicrophoneOn: boolean) => void

}): JSX.Element => {

const { cameraOn, microphoneOn, cameraToggled, microphoneToggled } = props;

const { localPreview, startLocalPreview, stopLocalPreview } = useLocalPreview();

const canTurnCameraOn = useCameras().cameras.length > 0;

// Start and stop the local video preview based on if the user has turned the camera on or off and if the camera is available.

useEffect(() => {

if (!localPreview && cameraOn && canTurnCameraOn) {

startLocalPreview();

} else if (!cameraOn) {

stopLocalPreview();

}

}, [canTurnCameraOn, cameraOn, localPreview, startLocalPreview, stopLocalPreview]);

const theme = useTheme();

const shouldShowLocalVideo = canTurnCameraOn && cameraOn && localPreview;

return (

<Stack verticalFill verticalAlign="center">

<Stack className={localPreviewContainerMergedStyles(theme)}>

<VideoTile

renderElement={shouldShowLocalVideo ? <StreamMedia videoStreamElement={localPreview.target} /> : undefined}

onRenderPlaceholder={() => <CameraOffPlaceholder />}

>

<ControlBar layout="floatingBottom">

<CameraButton

checked={cameraOn}

onClick={() => {

cameraToggled(!cameraOn)

}}

/>

<MicrophoneButton

checked={microphoneOn}

onClick={() => {

microphoneToggled(!microphoneOn)

}}

/>

</ControlBar>

</VideoTile>

</Stack>

</Stack>

);

};

/** Placeholder shown in the local preview window when the camera is off */

const CameraOffPlaceholder = (): JSX.Element => {

const theme = useTheme();

return (

<Stack style={{ width: '100%', height: '100%' }} verticalAlign="center">

<Stack.Item align="center">

<VideoOff20Filled primaryFill="currentColor" />

</Stack.Item>

<Stack.Item align="center">

<Text variant='small' styles={{ root: { color: theme.palette.neutralTertiary }}}>Your camera is turned off</Text>

</Stack.Item>

</Stack>

);

};

/** Default styles for the local preview container */

const localPreviewContainerMergedStyles = (theme: ITheme): string =>

mergeStyles({

minWidth: '25rem',

maxHeight: '18.75rem',

minHeight: '16.875rem',

margin: '0 auto',

background: theme.palette.neutralLighter,

color: theme.palette.neutralTertiary

});

Hinzufügen der lokalen Vorschau zur Geräteeinrichtung

Die lokale Vorschaukomponente kann dann der Geräteeinrichtung hinzugefügt werden:

src/DeviceSetup.tsx

import { LocalPreview } from './LocalPreview';

import { useState } from 'react';

export const DeviceSetup = (props: {

/** Callback to let the parent component know what the chosen user device settings were */

onDeviceSetupComplete: (userChosenDeviceState: { cameraOn: boolean; microphoneOn: boolean }) => void

}): JSX.Element => {

const [microphoneOn, setMicrophoneOn] = useState(false);

const [cameraOn, setCameraOn] = useState(false);

return (

<Stack verticalFill verticalAlign="center" horizontalAlign="center" tokens={{ childrenGap: '1rem' }}>

<Stack horizontal tokens={{ childrenGap: '2rem' }}>

<Stack.Item>

<LocalPreview

cameraOn={cameraOn}

microphoneOn={microphoneOn}

cameraToggled={setCameraOn}

microphoneToggled={setMicrophoneOn}

/>

</Stack.Item>

<Stack tokens={{ childrenGap: '1rem' }} verticalAlign="center" verticalFill>

<CameraSelectionDropdown />

<MicrophoneSelectionDropdown />

<SpeakerSelectionDropdown />

<Stack.Item styles={{ root: { paddingTop: '0.5rem' }}}>

<PrimaryButton text="Continue" onClick={() => props.onDeviceSetupComplete({ cameraOn, microphoneOn })} />

</Stack.Item>

</Stack>

</Stack>

</Stack>

);

};

Ausführen der Benutzeroberfläche

Nachdem Sie den Bildschirm für die Gerätekonfiguration erstellt haben, können Sie die App ausführen und die Benutzeroberfläche anzeigen: