Použití služeb Azure AI se službou SynapseML v Microsoft Fabric

služby Azure AI pomáhají vývojářům a organizacím rychle vytvářet inteligentní, špičkové, pro trh připravené a zodpovědné aplikace s předem připravenými a přizpůsobitelnými rozhraními API a modely. V tomto článku použijete různé služby dostupné ve službách Azure AI k provádění úloh, mezi které patří analýza textu, překlad, analýza dokumentů, zpracování obrazu, vyhledávání obrázků, převod řeči na text a text na převod řeči, detekce anomálií a extrakce dat z webových rozhraní API.

Cílem služeb Azure AI je pomoct vývojářům vytvářet aplikace, které můžou vidět, slyšet, mluvit, rozumět a dokonce začít zdůvodnit. Katalog služeb v rámci služeb Azure AI je možné zařadit do pěti hlavních pilířů: Vision, Speech, Language, web searcha Decision.

Požadavky

Získejte předplatné Microsoft Fabric. Nebo si zaregistrujte bezplatnou zkušební verzi Microsoft Fabric.

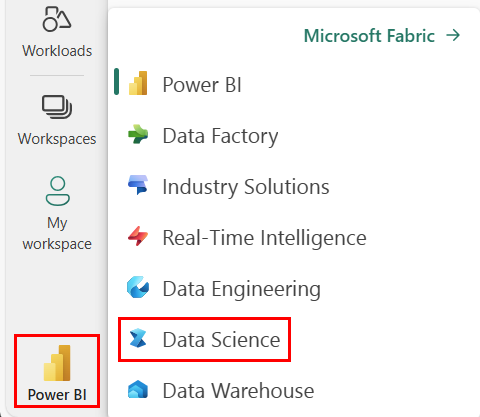

Přihlaste se k Microsoft Fabric.

Použijte přepínač zkušeností v levém dolním rohu vaší domovské stránky k přepnutí na Fabric.

- Vytvořte nový poznámkový blok.

- Připojte poznámkový blok k jezeru. Na levé straně poznámkového bloku vyberte Přidat a přidejte existující jezero nebo vytvořte nový.

- Získejte klíč služeb Azure AI podle pokynů v rychlém průvodci : Vytvoření prostředku s více službami pro služby Azure AI. Zkopírujte hodnotu klíče, kterou chcete použít v ukázkách kódu níže.

Příprava systému

Začněte importem požadovaných knihoven a inicializací relace Sparku.

from pyspark.sql.functions import udf, col

from synapse.ml.io.http import HTTPTransformer, http_udf

from requests import Request

from pyspark.sql.functions import lit

from pyspark.ml import PipelineModel

from pyspark.sql.functions import col

import os

from pyspark.sql import SparkSession

from synapse.ml.core.platform import *

# Bootstrap Spark Session

spark = SparkSession.builder.getOrCreate()

Importujte knihovny služeb Azure AI a nahraďte klíče a umístění v následujícím fragmentu kódu klíčem a umístěním služeb Azure AI.

from synapse.ml.cognitive import *

# A general Azure AI services key for Text Analytics, Vision and Document Intelligence (or use separate keys that belong to each service)

service_key = "<YOUR-KEY-VALUE>" # Replace <YOUR-KEY-VALUE> with your Azure AI service key, check prerequisites for more details

service_loc = "eastus"

# A Bing Search v7 subscription key

bing_search_key = "<YOUR-KEY-VALUE>" # Replace <YOUR-KEY-VALUE> with your Bing v7 subscription key, check prerequisites for more details

# An Anomaly Detector subscription key

anomaly_key = <"YOUR-KEY-VALUE"> # Replace <YOUR-KEY-VALUE> with your anomaly service key, check prerequisites for more details

anomaly_loc = "westus2"

# A Translator subscription key

translator_key = "<YOUR-KEY-VALUE>" # Replace <YOUR-KEY-VALUE> with your translator service key, check prerequisites for more details

translator_loc = "eastus"

# An Azure search key

search_key = "<YOUR-KEY-VALUE>" # Replace <YOUR-KEY-VALUE> with your search key, check prerequisites for more details

Analýza sentimentu v textu

Služba Analýza textu poskytuje několik algoritmů pro extrakci inteligentních přehledů z textu. Pomocí služby můžete například najít mínění v určitém vstupním textu. Služba vrátí skóre mezi 0,0 a 1,0, kde nízké skóre značí negativní mínění a vysoké skóre označují pozitivní mínění.

Následující ukázka kódu vrátí mínění pro tři jednoduché věty.

# Create a dataframe that's tied to it's column names

df = spark.createDataFrame(

[

("I am so happy today, its sunny!", "en-US"),

("I am frustrated by this rush hour traffic", "en-US"),

("The cognitive services on spark aint bad", "en-US"),

],

["text", "language"],

)

# Run the Text Analytics service with options

sentiment = (

TextSentiment()

.setTextCol("text")

.setLocation(service_loc)

.setSubscriptionKey(service_key)

.setOutputCol("sentiment")

.setErrorCol("error")

.setLanguageCol("language")

)

# Show the results of your text query in a table format

display(

sentiment.transform(df).select(

"text", col("sentiment.document.sentiment").alias("sentiment")

)

)

Analýza textu pro data o stavu

Analýza textu pro službu Health Service extrahuje a označí relevantní lékařské informace z nestrukturovaného textu, jako jsou poznámky lékaře, souhrny udělení absolutoria, klinické dokumenty a elektronické zdravotní záznamy.

Následující ukázka kódu analyzuje a transformuje text od lékařů do strukturovaných dat.

df = spark.createDataFrame(

[

("20mg of ibuprofen twice a day",),

("1tsp of Tylenol every 4 hours",),

("6-drops of Vitamin B-12 every evening",),

],

["text"],

)

healthcare = (

AnalyzeHealthText()

.setSubscriptionKey(service_key)

.setLocation(service_loc)

.setLanguage("en")

.setOutputCol("response")

)

display(healthcare.transform(df))

Překlad textu do jiného jazyka

Translator je cloudová služba strojového překladu a je součástí řady služeb Azure AI pro kognitivní rozhraní API sloužící k vytváření inteligentních aplikací. Translator se snadno integruje do vašich aplikací, webů, nástrojů a řešení. Umožňuje přidat vícejazyčná uživatelská prostředí v 90 jazycích a dialektech a dá se použít k překladu textu s jakýmkoli operačním systémem.

Následující ukázka kódu provede jednoduchý překlad textu tím, že poskytne věty, na které chcete přeložit a cílové jazyky, na které je chcete přeložit.

from pyspark.sql.functions import col, flatten

# Create a dataframe including sentences you want to translate

df = spark.createDataFrame(

[(["Hello, what is your name?", "Bye"],)],

[

"text",

],

)

# Run the Translator service with options

translate = (

Translate()

.setSubscriptionKey(translator_key)

.setLocation(translator_loc)

.setTextCol("text")

.setToLanguage(["zh-Hans"])

.setOutputCol("translation")

)

# Show the results of the translation.

display(

translate.transform(df)

.withColumn("translation", flatten(col("translation.translations")))

.withColumn("translation", col("translation.text"))

.select("translation")

)

Extrahování informací z dokumentu do strukturovaných dat

azure AI Document Intelligence je součástí služeb Azure AI, které umožňují vytvářet automatizovaný software pro zpracování dat pomocí technologie strojového učení. Díky funkci Document Intelligence v Azure AI můžete identifikovat a extrahovat text, páry klíč/hodnota, značky výběru, tabulky a strukturu z dokumentů. Služba vypíše strukturovaná data, která zahrnují relace v původním souboru, ohraničující rámečky, spolehlivost a další.

Následující ukázka kódu analyzuje obrázek vizitky a extrahuje jeho informace do strukturovaných dat.

from pyspark.sql.functions import col, explode

# Create a dataframe containing the source files

imageDf = spark.createDataFrame(

[

(

"https://mmlspark.blob.core.windows.net/datasets/FormRecognizer/business_card.jpg",

)

],

[

"source",

],

)

# Run the Form Recognizer service

analyzeBusinessCards = (

AnalyzeBusinessCards()

.setSubscriptionKey(service_key)

.setLocation(service_loc)

.setImageUrlCol("source")

.setOutputCol("businessCards")

)

# Show the results of recognition.

display(

analyzeBusinessCards.transform(imageDf)

.withColumn(

"documents", explode(col("businessCards.analyzeResult.documentResults.fields"))

)

.select("source", "documents")

)

Analýza a označování obrázků

počítačové zpracování obrazu analyzuje obrázky a identifikuje strukturu, jako jsou tváře, objekty a popisy přirozeného jazyka.

Následující ukázka kódu analyzuje obrázky a označí je značkami . Značky jsou jednoslovné popisy věcí na obrázku, jako jsou rozpoznatelné objekty, lidé, scenérie a akce.

# Create a dataframe with the image URLs

base_url = "https://raw.githubusercontent.com/Azure-Samples/cognitive-services-sample-data-files/master/ComputerVision/Images/"

df = spark.createDataFrame(

[

(base_url + "objects.jpg",),

(base_url + "dog.jpg",),

(base_url + "house.jpg",),

],

[

"image",

],

)

# Run the Computer Vision service. Analyze Image extracts information from/about the images.

analysis = (

AnalyzeImage()

.setLocation(service_loc)

.setSubscriptionKey(service_key)

.setVisualFeatures(

["Categories", "Color", "Description", "Faces", "Objects", "Tags"]

)

.setOutputCol("analysis_results")

.setImageUrlCol("image")

.setErrorCol("error")

)

# Show the results of what you wanted to pull out of the images.

display(analysis.transform(df).select("image", "analysis_results.description.tags"))

Hledání obrázků souvisejících s dotazem v přirozeném jazyce

Bing Vyhledávání Obrázků prohledává web, aby vyhledalo obrázky související s dotazem v přirozeném jazyce uživatele.

Následující ukázka kódu používá textový dotaz, který hledá obrázky s uvozovkami. Výstupem kódu je seznam adres URL obrázků, které obsahují fotky související s dotazem.

# Number of images Bing will return per query

imgsPerBatch = 10

# A list of offsets, used to page into the search results

offsets = [(i * imgsPerBatch,) for i in range(100)]

# Since web content is our data, we create a dataframe with options on that data: offsets

bingParameters = spark.createDataFrame(offsets, ["offset"])

# Run the Bing Image Search service with our text query

bingSearch = (

BingImageSearch()

.setSubscriptionKey(bing_search_key)

.setOffsetCol("offset")

.setQuery("Martin Luther King Jr. quotes")

.setCount(imgsPerBatch)

.setOutputCol("images")

)

# Transformer that extracts and flattens the richly structured output of Bing Image Search into a simple URL column

getUrls = BingImageSearch.getUrlTransformer("images", "url")

# This displays the full results returned, uncomment to use

# display(bingSearch.transform(bingParameters))

# Since we have two services, they are put into a pipeline

pipeline = PipelineModel(stages=[bingSearch, getUrls])

# Show the results of your search: image URLs

display(pipeline.transform(bingParameters))

Transformace řeči na text

Služba převodu řeči na text převádí datové proudy nebo soubory mluveného zvuku na text. Následující ukázka kódu přepisuje jeden zvukový soubor na text.

# Create a dataframe with our audio URLs, tied to the column called "url"

df = spark.createDataFrame(

[("https://mmlspark.blob.core.windows.net/datasets/Speech/audio2.wav",)], ["url"]

)

# Run the Speech-to-text service to translate the audio into text

speech_to_text = (

SpeechToTextSDK()

.setSubscriptionKey(service_key)

.setLocation(service_loc)

.setOutputCol("text")

.setAudioDataCol("url")

.setLanguage("en-US")

.setProfanity("Masked")

)

# Show the results of the translation

display(speech_to_text.transform(df).select("url", "text.DisplayText"))

Transformace textu na řeč

Převod textu na řeč je služba, která umožňuje vytvářet aplikace a služby, které přirozeně hovoří, s výběrem z více než 270 neurálních hlasů ve 119 jazycích a variantách.

Následující ukázka kódu transformuje text na zvukový soubor, který obsahuje obsah textu.

from synapse.ml.cognitive import TextToSpeech

fs = ""

if running_on_databricks():

fs = "dbfs:"

elif running_on_synapse_internal():

fs = "Files"

# Create a dataframe with text and an output file location

df = spark.createDataFrame(

[

(

"Reading out loud is fun! Check out aka.ms/spark for more information",

fs + "/output.mp3",

)

],

["text", "output_file"],

)

tts = (

TextToSpeech()

.setSubscriptionKey(service_key)

.setTextCol("text")

.setLocation(service_loc)

.setVoiceName("en-US-JennyNeural")

.setOutputFileCol("output_file")

)

# Check to make sure there were no errors during audio creation

display(tts.transform(df))

Detekce anomálií v datech časových řad

Detektor anomálií je skvělý pro detekci nesrovnalostí v datech časových řad. Následující ukázka kódu používá službu Detektor anomálií k vyhledání anomálií v datech celé časové řady.

# Create a dataframe with the point data that Anomaly Detector requires

df = spark.createDataFrame(

[

("1972-01-01T00:00:00Z", 826.0),

("1972-02-01T00:00:00Z", 799.0),

("1972-03-01T00:00:00Z", 890.0),

("1972-04-01T00:00:00Z", 900.0),

("1972-05-01T00:00:00Z", 766.0),

("1972-06-01T00:00:00Z", 805.0),

("1972-07-01T00:00:00Z", 821.0),

("1972-08-01T00:00:00Z", 20000.0),

("1972-09-01T00:00:00Z", 883.0),

("1972-10-01T00:00:00Z", 898.0),

("1972-11-01T00:00:00Z", 957.0),

("1972-12-01T00:00:00Z", 924.0),

("1973-01-01T00:00:00Z", 881.0),

("1973-02-01T00:00:00Z", 837.0),

("1973-03-01T00:00:00Z", 9000.0),

],

["timestamp", "value"],

).withColumn("group", lit("series1"))

# Run the Anomaly Detector service to look for irregular data

anamoly_detector = (

SimpleDetectAnomalies()

.setSubscriptionKey(anomaly_key)

.setLocation(anomaly_loc)

.setTimestampCol("timestamp")

.setValueCol("value")

.setOutputCol("anomalies")

.setGroupbyCol("group")

.setGranularity("monthly")

)

# Show the full results of the analysis with the anomalies marked as "True"

display(

anamoly_detector.transform(df).select("timestamp", "value", "anomalies.isAnomaly")

)

Získání informací z libovolných webových rozhraní API

Pomocí PROTOKOLU HTTP ve Sparku můžete ve svém kanálu pro velké objemy dat použít libovolnou webovou službu. Následující ukázka kódu používá rozhraní API světové banky k získání informací o různých zemích po celém světě.

# Use any requests from the python requests library

def world_bank_request(country):

return Request(

"GET", "http://api.worldbank.org/v2/country/{}?format=json".format(country)

)

# Create a dataframe with specifies which countries we want data on

df = spark.createDataFrame([("br",), ("usa",)], ["country"]).withColumn(

"request", http_udf(world_bank_request)(col("country"))

)

# Much faster for big data because of the concurrency :)

client = (

HTTPTransformer().setConcurrency(3).setInputCol("request").setOutputCol("response")

)

# Get the body of the response

def get_response_body(resp):

return resp.entity.content.decode()

# Show the details of the country data returned

display(

client.transform(df).select(

"country", udf(get_response_body)(col("response")).alias("response")

)

)