将 LightGBM 模型与 Microsoft Fabric 中的 SynapseML 配合使用

LightGBM 框架专用于创建高质量且支持 GPU 的决策树算法,可用于排名、分类和许多其他机器学习任务。 在本文中,你将使用 LightGBM 构建分类、回归和排名模型。

LightGBM是一种开源的分布式高性能梯度提升(GBDT、GBRT、GBM 或 MART)框架。 LightGBM 是 Microsoft DMTK项目的一部分。 可以使用 LightGBMClassifier、LightGBMRegressor 和 LightGBMRanker。 LightGBM 可以合并到现有的 SparkML 管道中,并用于批处理、流式处理和服务工作负载,具备许多优势。 此外,LightGBM 还提供各种可调整参数,可用于自定义其决策树系统。 Spark 上的 LightGBM 还支持新类型的问题,例如分位数回归。

先决条件

获取 Microsoft Fabric 订阅。 或者注册免费的 Microsoft Fabric 试用版。

登录 Microsoft Fabric。

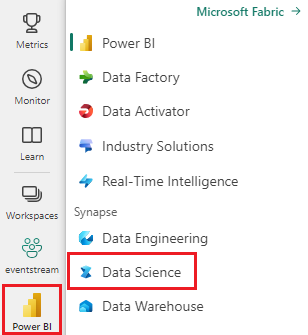

使用主页左下侧的体验切换器切换到 Fabric。

- 转到 Microsoft Fabric 中的数据科学体验。

- 创建新的笔记本。

- 将笔记本附加到湖屋。 在笔记本左侧,选择“添加”以添加现有的湖屋或创建新湖屋。

使用 LightGBMClassifier 训练分类模型

在本部分中,你将使用 LightGBM 构建用于预测破产的分类模型。

读取数据集。

from pyspark.sql import SparkSession # Bootstrap Spark Session spark = SparkSession.builder.getOrCreate() from synapse.ml.core.platform import *df = ( spark.read.format("csv") .option("header", True) .option("inferSchema", True) .load( "wasbs://publicwasb@mmlspark.blob.core.windows.net/company_bankruptcy_prediction_data.csv" ) ) # print dataset size print("records read: " + str(df.count())) print("Schema: ") df.printSchema()display(df)将数据集拆分为训练集和测试集。

train, test = df.randomSplit([0.85, 0.15], seed=1)添加特征化器以将特征转换为矢量。

from pyspark.ml.feature import VectorAssembler feature_cols = df.columns[1:] featurizer = VectorAssembler(inputCols=feature_cols, outputCol="features") train_data = featurizer.transform(train)["Bankrupt?", "features"] test_data = featurizer.transform(test)["Bankrupt?", "features"]检查数据是否不均衡。

display(train_data.groupBy("Bankrupt?").count())使用

LightGBMClassifier训练模型。from synapse.ml.lightgbm import LightGBMClassifier model = LightGBMClassifier( objective="binary", featuresCol="features", labelCol="Bankrupt?", isUnbalance=True, dataTransferMode="bulk" )model = model.fit(train_data)可视化特征重要性

import pandas as pd import matplotlib.pyplot as plt feature_importances = model.getFeatureImportances() fi = pd.Series(feature_importances, index=feature_cols) fi = fi.sort_values(ascending=True) f_index = fi.index f_values = fi.values # print feature importances print("f_index:", f_index) print("f_values:", f_values) # plot x_index = list(range(len(fi))) x_index = [x / len(fi) for x in x_index] plt.rcParams["figure.figsize"] = (20, 20) plt.barh( x_index, f_values, height=0.028, align="center", color="tan", tick_label=f_index ) plt.xlabel("importances") plt.ylabel("features") plt.show()根据模型生成预测

predictions = model.transform(test_data) predictions.limit(10).toPandas()from synapse.ml.train import ComputeModelStatistics metrics = ComputeModelStatistics( evaluationMetric="classification", labelCol="Bankrupt?", scoredLabelsCol="prediction", ).transform(predictions) display(metrics)

使用 LightGBMRegressor 训练分位数回归模型

在本部分中,你将使用 LightGBM 构建药物研发的回归模型。

读取数据集。

triazines = spark.read.format("libsvm").load( "wasbs://publicwasb@mmlspark.blob.core.windows.net/triazines.scale.svmlight" )# print some basic info print("records read: " + str(triazines.count())) print("Schema: ") triazines.printSchema() display(triazines.limit(10))将数据集拆分为训练集和测试集。

train, test = triazines.randomSplit([0.85, 0.15], seed=1)使用

LightGBMRegressor训练模型。from synapse.ml.lightgbm import LightGBMRegressor model = LightGBMRegressor( objective="quantile", alpha=0.2, learningRate=0.3, numLeaves=31, dataTransferMode="bulk" ).fit(train)print(model.getFeatureImportances())根据模型生成预测。

scoredData = model.transform(test) display(scoredData)from synapse.ml.train import ComputeModelStatistics metrics = ComputeModelStatistics( evaluationMetric="regression", labelCol="label", scoresCol="prediction" ).transform(scoredData) display(metrics)

使用 LightGBMRanker 训练排名模型

在本部分中,你将使用 LightGBM 构建排名模型。

读取数据集。

df = spark.read.format("parquet").load( "wasbs://publicwasb@mmlspark.blob.core.windows.net/lightGBMRanker_train.parquet" ) # print some basic info print("records read: " + str(df.count())) print("Schema: ") df.printSchema() display(df.limit(10))使用

LightGBMRanker训练排名模型。from synapse.ml.lightgbm import LightGBMRanker features_col = "features" query_col = "query" label_col = "labels" lgbm_ranker = LightGBMRanker( labelCol=label_col, featuresCol=features_col, groupCol=query_col, predictionCol="preds", leafPredictionCol="leafPreds", featuresShapCol="importances", repartitionByGroupingColumn=True, numLeaves=32, numIterations=200, evalAt=[1, 3, 5], metric="ndcg", dataTransferMode="bulk" )lgbm_ranker_model = lgbm_ranker.fit(df)根据模型生成预测。

dt = spark.read.format("parquet").load( "wasbs://publicwasb@mmlspark.blob.core.windows.net/lightGBMRanker_test.parquet" ) predictions = lgbm_ranker_model.transform(dt) predictions.limit(10).toPandas()