数据集分为两部分:一组用于训练,一组用于测试。 训练集用于训练模型,而测试集用作训练后的模型测试,以计算模型性能和评估。 测试集不会通过训练过程引入到模型中,以确保模型在新数据上进行测试。

成功完成训练后,将自动触发模型评估。 评估过程首先使用经过训练的模型预测测试集中文档的用户定义实体,并将其与提供的数据标记进行比较(这将建立真实的基线)。 返回结果后,可以查看模型的性能。 对于评估,自定义 NER 使用以下指标:

精准率:度量模型的精确度/准确度。 它是正确识别的正值(真正)与所有识别出的正值之间的比率。 精准率指标显示正确标记的预测实体的数量。

Precision = #True_Positive / (#True_Positive + #False_Positive)召回率:度量模型预测实际正类的能力。 这是预测的真正值与实际标记的结果之间的比率。 召回率指标显示正确的预测实体的数量。

Recall = #True_Positive / (#True_Positive + #False_Negatives)F1 分数:F1 分数是精准率和召回率的函数。 在精准率和召回率之间进行平衡时,需要用到它。

F1 Score = 2 * Precision * Recall / (Precision + Recall)

注意

分别为每个实体(实体级评估)和整个模型(模型级评估)计算精准率、召回率和 F1 分数。

模型级和实体级评估指标

针对每个实体分别计算(实体级评估)并针对模型总体计算(模型级评估)精准率、召回率和 F1 分数。

对于实体级评估和模型级评估,精准率、召回率和计算的定义是相同的。 但是,真正、假正和假负的计数可能有所不同。 例如,请考虑以下文本。

示例

此合同的第一方是 John Smith,居住于内布拉斯加州弗雷德里克市 Main Rd 5678 号。 第二方是 Forrest Ray,居住于新墨西哥州科罗那市 Integer Rd 123-345 号。 还有 Fannie Thomas,居住于科罗拉多州科罗拉多斯普林斯市 River Road 7890 号。

从此文本中提取实体的模型可以有以下预测:

| 实体 | 预测为 | 实际类型 |

|---|---|---|

| John Smith | 人员 | 人员 |

| Frederick | 人员 | City |

| Forrest | City | 人员 |

| Fannie Thomas | 人员 | 人员 |

| Colorado Springs | City | City |

人员实体的实体级评估

该模型将针对人员实体进行以下实体级评估:

| 键 | 计数 | 说明 |

|---|---|---|

| 真正 | 2 | John Smith 和 Fannie Thomas 被正确预测为人员。 |

| 假正 | 1 | Frederick 被错误地预测为人员,它应为城市。 |

| 假负 | 1 | Forrest 被错误地预测为城市,它应为人员。 |

- 精准率:

#True_Positive / (#True_Positive + #False_Positive)=2 / (2 + 1) = 0.67 - 召回率:

#True_Positive / (#True_Positive + #False_Negatives)=2 / (2 + 1) = 0.67 - F1 分数:

2 * Precision * Recall / (Precision + Recall)=(2 * 0.67 * 0.67) / (0.67 + 0.67) = 0.67

城市实体的实体级评估

该模型将针对城市实体进行以下实体级评估:

| 键 | 计数 | 说明 |

|---|---|---|

| 真正 | 1 | Colorado Springs 被正确预测为城市。 |

| 假正 | 1 | Forrest 被错误地预测为城市,它应为人员。 |

| 假负 | 1 | Frederick 被错误地预测为人员,它应为城市。 |

- 精准率 =

#True_Positive / (#True_Positive + #False_Positive)=1 / (1 + 1) = 0.5 - 召回率 =

#True_Positive / (#True_Positive + #False_Negatives)=1 / (1 + 1) = 0.5 - F1 分数 =

2 * Precision * Recall / (Precision + Recall)=(2 * 0.5 * 0.5) / (0.5 + 0.5) = 0.5

对整体模型进行模型级评估

该模型将针对整个模型进行以下评估:

| 键 | 计数 | 说明 |

|---|---|---|

| 真正 | 3 | John Smith 和 Fannie Thomas 被正确预测为人员。 Colorado Springs 被正确预测为城市。 这是所有实体的真正数总和。 |

| 假正 | 2 | Forrest 被错误地预测为城市,它应为人员。 Frederick 被错误地预测为人员,它应为城市。 这是所有实体的假正数总和。 |

| 假负 | 2 | Forrest 被错误地预测为城市,它应为人员。 Frederick 被错误地预测为人员,它应为城市。 这是所有实体的假负数总和。 |

- 精准率 =

#True_Positive / (#True_Positive + #False_Positive)=3 / (3 + 2) = 0.6 - 召回率 =

#True_Positive / (#True_Positive + #False_Negatives)=3 / (3 + 2) = 0.6 - F1 分数 =

2 * Precision * Recall / (Precision + Recall)=(2 * 0.6 * 0.6) / (0.6 + 0.6) = 0.6

解释实体级评估指标

那么,对于某个实体来说,具有高精准率或高召回率实际上意味着什么?

| 召回 | Precision | 解释 |

|---|---|---|

| 高 | 高 | 模型可以妥善处理此实体。 |

| 低 | 高 | 模型不能始终提取此实体,但在提取时,它具有高置信度。 |

| 高 | 低 | 模型可以很好地提取此实体,但它的置信度较低,因为它有时会被提取为另一种类型。 |

| 低 | 低 | 模型未能很好地处理此实体类型,因为通常不提取该类型。 如果提取,则不会有高置信度。 |

指南

训练模型后,你将看到一些关于如何改进模型的指导和建议。 建议使用一个涵盖指南部分中所有要点的模型。

训练集有足够的数据:实体类型在训练数据中的标记实例少于 15 个时,由于没有针对这些事例对模型进行充分训练,可能会导致准确性降低。 在此情况下,请考虑在训练集中添加更多标记数据。 可以查看“数据分布”选项卡获取更多指南。

所有实体类型都存在于测试集中:测试数据缺少实体类型的标记实例时,由于存在未经测试的方案,模型的测试性能可能会变得不太全面。 可以查看“测试集数据分布”选项卡获取更多指南。

实体类型在训练集和测试集中是平衡的:采样偏差导致实体类型频率的表示形式不准确时,由于模型预期实体类型出现的频率太高或太低,可能导致准确性降低。 可以查看“数据分布”选项卡获取更多指南。

实体类型在训练集和测试集之间均匀分布:混合实体类型在训练集和测试集之间不匹配时,由于模型的训练方式与测试方式不同,可能导致准确性降低。 可以查看“数据分布”选项卡获取更多指南。

训练集中实体类型之间的区别不明确:多个实体类型的训练数据相似时,由于实体类型可能经常被错误分类为彼此,可能会导致准确性降低。 查看以下实体类型,并考虑合并相似的实体类型。 否则,请添加更多示例以更好地区分它们。 可以查看“混淆矩阵”选项卡获取更多指南。

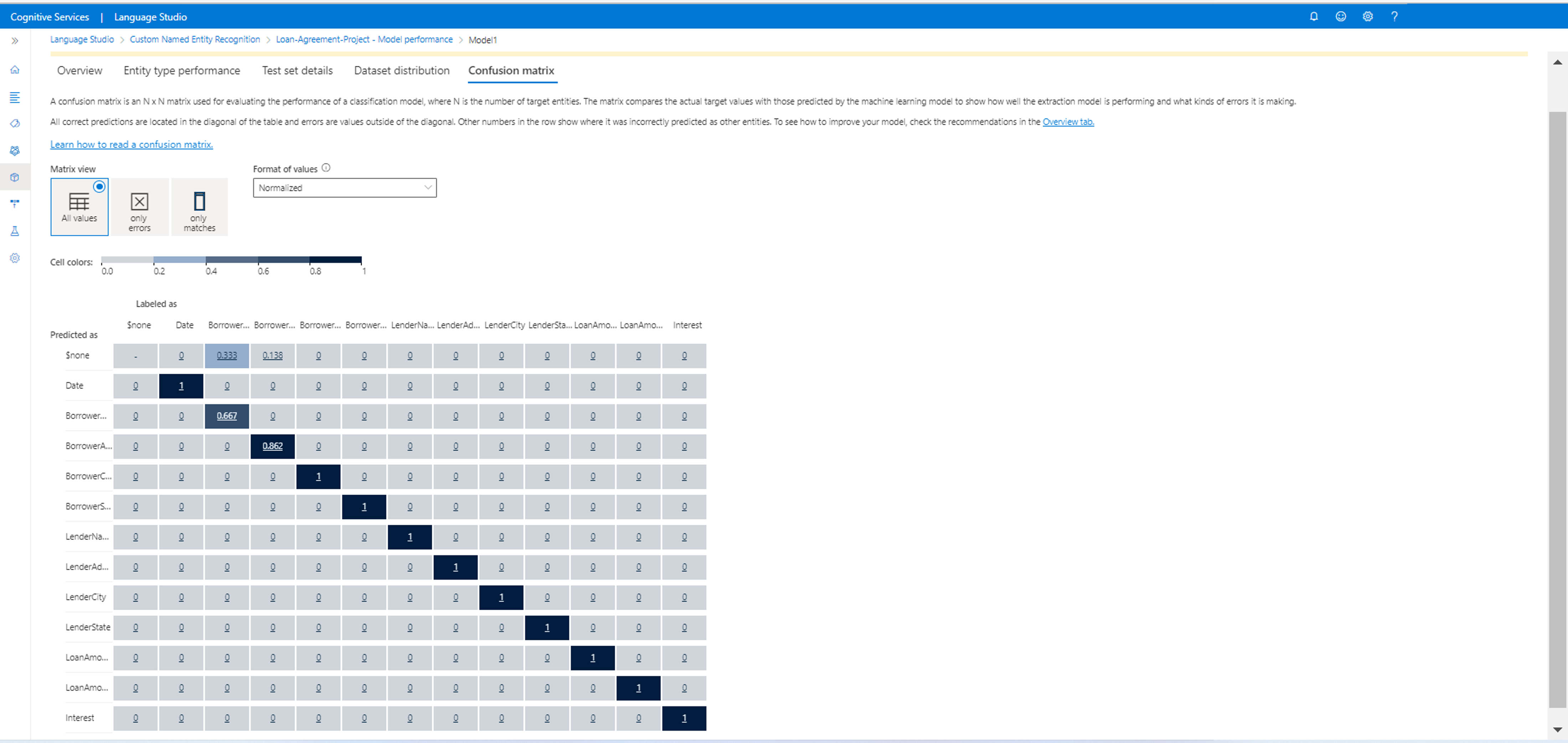

混淆矩阵

混淆矩阵是用于模型性能评估的 N x N 矩阵,其中 N 是实体数目。 该矩阵将预期标签与模型预测的标签进行比较。 这为模型的性能以及它所犯的错误类型提供了整体视图。

可以使用混淆矩阵来识别彼此之间过于接近且经常被弄错(歧义)的实体。 在这种情况下,请考虑将这些实体类型合并在一起。 如果无法做到这一点,请考虑添加这两个实体的更多标记示例,帮助模型区分它们。

下图中突出显示的对角线是正确预测的实体,其中预测标记与实际标记相同。

可以根据混淆矩阵计算实体级别和模型级别的评估指标:

- 对角线的值是每个实体的真正值。

- 实体行中值的总和(不包括对角线)是模型的假正值。

- 实体列中值的总和(不包括对角线)是模型的假负值。

同样,

- 模型的真正值为所有实体的真正值的总和。

- 模型的假正值为所有实体的假正值的总和。

- 模型的假负值为所有实体的假负值的总和。