GlusterFS på virtuella Azure-datorer på Red Hat Enterprise Linux för SAP NetWeaver

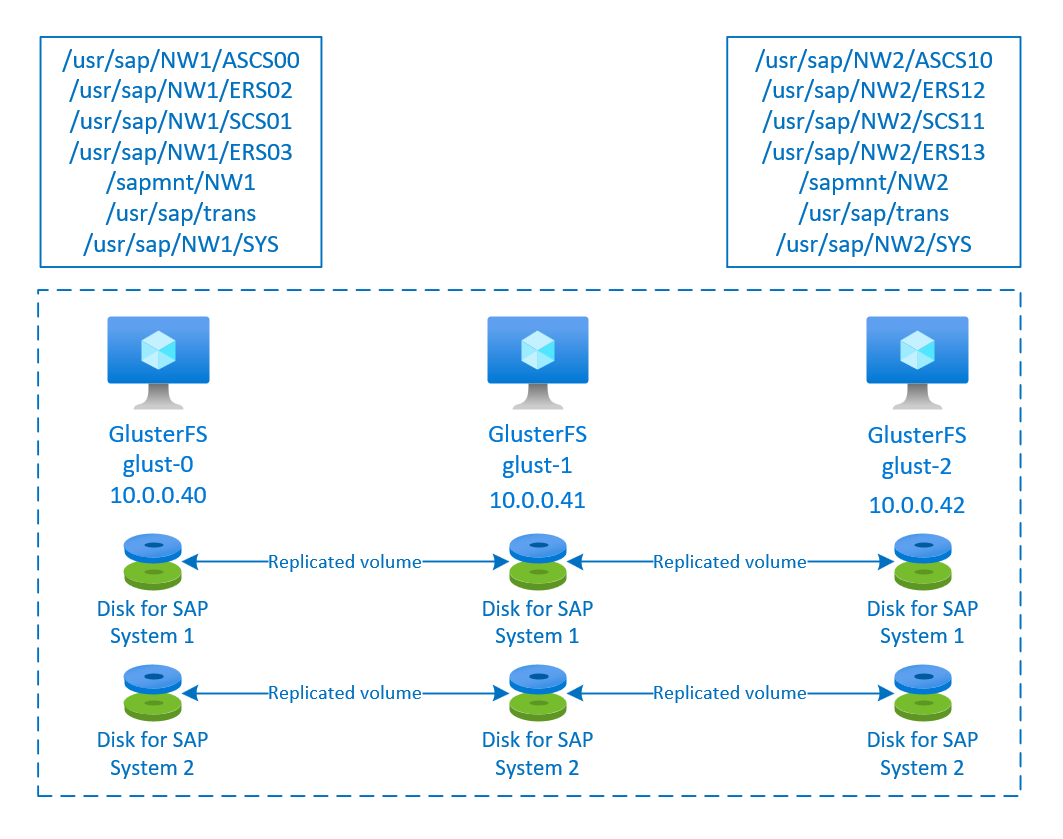

Den här artikeln beskriver hur du distribuerar de virtuella datorerna, konfigurerar de virtuella datorerna och installerar ett GlusterFS-kluster som kan användas för att lagra delade data i ett SAP-system med hög tillgänglighet. Den här guiden beskriver hur du konfigurerar GlusterFS som används av två SAP-system, NW1 och NW2. Namnen på resurserna (till exempel virtuella datorer, virtuella nätverk) i exemplet förutsätter att du har använt SAP-filservermallen med resursprefixet glust.

Tänk på att enligt beskrivningen i Red Hat Gluster Storage Life Cycle Red Hat Gluster Storage når slutet av livet i slutet av 2024. Konfigurationen kommer att stödjas för SAP på Azure tills den når livscykelns slutfas. GlusterFS bör inte användas för nya distributioner. Vi rekommenderar att du distribuerar SAP-delade kataloger på NFS på Azure Files- eller Azure NetApp Files-volymer enligt beskrivningen i HA för SAP NW på RHEL med NFS på Azure Files eller HA för SAP NW på RHEL med Azure NetApp Files.

Läs följande SAP-anteckningar och dokument först

SAP Note 1928533, som har:

- Lista över storlekar på virtuella Azure-datorer som stöds för distribution av SAP-programvara

- Viktig kapacitetsinformation för vm-storlekar i Azure

- SAP-programvara och kombinationer av operativsystem (OS) och databaser som stöds

- Nödvändig SAP-kernelversion för Windows och Linux på Microsoft Azure

SAP Note 2015553 listar krav för SAP-programdistributioner som stöds i Azure.

SAP Obs 2002167 har rekommenderade operativsysteminställningar för Red Hat Enterprise Linux

SAP Note 2009879 har SAP HANA-riktlinjer för Red Hat Enterprise Linux

SAP Note 2178632 innehåller detaljerad information om alla övervakningsmått som rapporterats för SAP i Azure.

SAP Note 2191498 har den sap-värdagentversion som krävs för Linux i Azure.

SAP Note 2243692 har information om SAP-licensiering på Linux i Azure.

SAP Note 1999351 har ytterligare felsökningsinformation för Azure Enhanced Monitoring Extension för SAP.

SAP Community WIKI har alla nödvändiga SAP-anteckningar för Linux.

Planering och implementering av Azure Virtual Machines för SAP i Linux

Azure Virtual Machines-distribution för SAP på Linux (den här artikeln)

Allmän RHEL-dokumentation

Azure-specifik RHEL-dokumentation:

Översikt

För att uppnå hög tillgänglighet kräver SAP NetWeaver delad lagring. GlusterFS konfigureras i ett separat kluster och kan användas av flera SAP-system.

Konfigurera GlusterFS

I det här exemplet distribuerades resurserna manuellt via Azure Portal.

Distribuera Linux manuellt via Azure Portal

Det här dokumentet förutsätter att du redan har distribuerat en resursgrupp, Azure Virtual Network och undernät.

Distribuera virtuella datorer för GlusterFS. Välj en lämplig RHEL-avbildning som stöds för Gluster Storage. Du kan distribuera en virtuell dator i något av tillgänglighetsalternativen – skalningsuppsättning, tillgänglighetszon eller tillgänglighetsuppsättning.

Konfigurera GlusterFS

Följande objekt är prefix med antingen [A] - gäller för alla noder, [1] - gäller endast för nod 1, [2] - gäller endast för nod 2, [3] - endast för nod 3.

[A] Konfigurera värdnamnsmatchning

Du kan antingen använda en DNS-server eller ändra /etc/hosts på alla noder. Det här exemplet visar hur du använder filen /etc/hosts. Ersätt IP-adressen och värdnamnet i följande kommandon

sudo vi /etc/hostsInfoga följande rader i /etc/hosts. Ändra IP-adressen och värdnamnet så att de matchar din miljö

# IP addresses of the Gluster nodes 10.0.0.40 glust-0 10.0.0.41 glust-1 10.0.0.42 glust-2[A] Registrera dig

Registrera dina virtuella datorer och koppla dem till en pool som innehåller lagringsplatser för RHEL 7 och GlusterFS

sudo subscription-manager register sudo subscription-manager attach --pool=<pool id>[A] Aktivera GlusterFS-lagringsplatser

Om du vill installera de nödvändiga paketen aktiverar du följande lagringsplatser.

sudo subscription-manager repos --disable "*" sudo subscription-manager repos --enable=rhel-7-server-rpms sudo subscription-manager repos --enable=rh-gluster-3-for-rhel-7-server-rpms[A] Installera GlusterFS-paket

Installera dessa paket på alla GlusterFS-noder

sudo yum -y install redhat-storage-serverStarta om noderna efter installationen.

[A] Ändra brandvägg

Lägg till brandväggsregler för att tillåta klienttrafik till GlusterFS-noderna.

# list the available zones firewall-cmd --get-active-zones sudo firewall-cmd --zone=public --add-service=glusterfs --permanent sudo firewall-cmd --zone=public --add-service=glusterfs[A] Aktivera och starta GlusterFS-tjänsten

Starta GlusterFS-tjänsten på alla noder.

sudo systemctl start glusterd sudo systemctl enable glusterd[1] Skapa GluserFS

Kör följande kommandon för att skapa GlusterFS-klustret

sudo gluster peer probe glust-1 sudo gluster peer probe glust-2 # Check gluster peer status sudo gluster peer status # Number of Peers: 2 # # Hostname: glust-1 # Uuid: 10d43840-fee4-4120-bf5a-de9c393964cd # State: Accepted peer request (Connected) # # Hostname: glust-2 # Uuid: 9e340385-12fe-495e-ab0f-4f851b588cba # State: Accepted peer request (Connected)[2] Testa peer-status

Testa peer-statusen på den andra noden

sudo gluster peer status # Number of Peers: 2 # # Hostname: glust-0 # Uuid: 6bc6927b-7ee2-461b-ad04-da123124d6bd # State: Peer in Cluster (Connected) # # Hostname: glust-2 # Uuid: 9e340385-12fe-495e-ab0f-4f851b588cba # State: Peer in Cluster (Connected)[3] Testa peer-status

Testa peer-statusen på den tredje noden

sudo gluster peer status # Number of Peers: 2 # # Hostname: glust-0 # Uuid: 6bc6927b-7ee2-461b-ad04-da123124d6bd # State: Peer in Cluster (Connected) # # Hostname: glust-1 # Uuid: 10d43840-fee4-4120-bf5a-de9c393964cd # State: Peer in Cluster (Connected)[A] Skapa LVM

I det här exemplet används GlusterFS för två SAP-system, NW1 och NW2. Använd följande kommandon för att skapa LVM-konfigurationer för dessa SAP-system.

Använd dessa kommandon för NW1

sudo pvcreate --dataalignment 1024K /dev/disk/azure/scsi1/lun0 sudo pvscan sudo vgcreate --physicalextentsize 256K rhgs-NW1 /dev/disk/azure/scsi1/lun0 sudo vgscan sudo lvcreate -l 50%FREE -n rhgs-NW1/sapmnt sudo lvcreate -l 20%FREE -n rhgs-NW1/trans sudo lvcreate -l 10%FREE -n rhgs-NW1/sys sudo lvcreate -l 50%FREE -n rhgs-NW1/ascs sudo lvcreate -l 100%FREE -n rhgs-NW1/aers sudo lvscan sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW1/sapmnt sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW1/trans sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW1/sys sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW1/ascs sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW1/aers sudo mkdir -p /rhs/NW1/sapmnt sudo mkdir -p /rhs/NW1/trans sudo mkdir -p /rhs/NW1/sys sudo mkdir -p /rhs/NW1/ascs sudo mkdir -p /rhs/NW1/aers sudo chattr +i /rhs/NW1/sapmnt sudo chattr +i /rhs/NW1/trans sudo chattr +i /rhs/NW1/sys sudo chattr +i /rhs/NW1/ascs sudo chattr +i /rhs/NW1/aers echo -e "/dev/rhgs-NW1/sapmnt\t/rhs/NW1/sapmnt\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW1/trans\t/rhs/NW1/trans\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW1/sys\t/rhs/NW1/sys\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW1/ascs\t/rhs/NW1/ascs\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW1/aers\t/rhs/NW1/aers\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab sudo mount -aAnvänd dessa kommandon för NW2

sudo pvcreate --dataalignment 1024K /dev/disk/azure/scsi1/lun1 sudo pvscan sudo vgcreate --physicalextentsize 256K rhgs-NW2 /dev/disk/azure/scsi1/lun1 sudo vgscan sudo lvcreate -l 50%FREE -n rhgs-NW2/sapmnt sudo lvcreate -l 20%FREE -n rhgs-NW2/trans sudo lvcreate -l 10%FREE -n rhgs-NW2/sys sudo lvcreate -l 50%FREE -n rhgs-NW2/ascs sudo lvcreate -l 100%FREE -n rhgs-NW2/aers sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW2/sapmnt sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW2/trans sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW2/sys sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW2/ascs sudo mkfs.xfs -f -K -i size=512 -n size=8192 /dev/rhgs-NW2/aers sudo mkdir -p /rhs/NW2/sapmnt sudo mkdir -p /rhs/NW2/trans sudo mkdir -p /rhs/NW2/sys sudo mkdir -p /rhs/NW2/ascs sudo mkdir -p /rhs/NW2/aers sudo chattr +i /rhs/NW2/sapmnt sudo chattr +i /rhs/NW2/trans sudo chattr +i /rhs/NW2/sys sudo chattr +i /rhs/NW2/ascs sudo chattr +i /rhs/NW2/aers sudo lvscan echo -e "/dev/rhgs-NW2/sapmnt\t/rhs/NW2/sapmnt\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW2/trans\t/rhs/NW2/trans\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW2/sys\t/rhs/NW2/sys\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW2/ascs\t/rhs/NW2/ascs\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab echo -e "/dev/rhgs-NW2/aers\t/rhs/NW2/aers\txfs\tdefaults,inode64,nobarrier,noatime,nouuid 0 2" | sudo tee -a /etc/fstab sudo mount -a[1] Skapa den distribuerade volymen

Använd följande kommandon för att skapa GlusterFS-volymen för NW1 och starta den.

sudo gluster vol create NW1-sapmnt replica 3 glust-0:/rhs/NW1/sapmnt glust-1:/rhs/NW1/sapmnt glust-2:/rhs/NW1/sapmnt force sudo gluster vol create NW1-trans replica 3 glust-0:/rhs/NW1/trans glust-1:/rhs/NW1/trans glust-2:/rhs/NW1/trans force sudo gluster vol create NW1-sys replica 3 glust-0:/rhs/NW1/sys glust-1:/rhs/NW1/sys glust-2:/rhs/NW1/sys force sudo gluster vol create NW1-ascs replica 3 glust-0:/rhs/NW1/ascs glust-1:/rhs/NW1/ascs glust-2:/rhs/NW1/ascs force sudo gluster vol create NW1-aers replica 3 glust-0:/rhs/NW1/aers glust-1:/rhs/NW1/aers glust-2:/rhs/NW1/aers force sudo gluster volume start NW1-sapmnt sudo gluster volume start NW1-trans sudo gluster volume start NW1-sys sudo gluster volume start NW1-ascs sudo gluster volume start NW1-aersAnvänd följande kommandon för att skapa GlusterFS-volymen för NW2 och starta den.

sudo gluster vol create NW2-sapmnt replica 3 glust-0:/rhs/NW2/sapmnt glust-1:/rhs/NW2/sapmnt glust-2:/rhs/NW2/sapmnt force sudo gluster vol create NW2-trans replica 3 glust-0:/rhs/NW2/trans glust-1:/rhs/NW2/trans glust-2:/rhs/NW2/trans force sudo gluster vol create NW2-sys replica 3 glust-0:/rhs/NW2/sys glust-1:/rhs/NW2/sys glust-2:/rhs/NW2/sys force sudo gluster vol create NW2-ascs replica 3 glust-0:/rhs/NW2/ascs glust-1:/rhs/NW2/ascs glust-2:/rhs/NW2/ascs force sudo gluster vol create NW2-aers replica 3 glust-0:/rhs/NW2/aers glust-1:/rhs/NW2/aers glust-2:/rhs/NW2/aers force sudo gluster volume start NW2-sapmnt sudo gluster volume start NW2-trans sudo gluster volume start NW2-sys sudo gluster volume start NW2-ascs sudo gluster volume start NW2-aers

Nästa steg

- Installera SAP ASCS och databasen

- Planering och implementering av Azure Virtual Machines för SAP

- Distribution av virtuella Azure-datorer för SAP

- Azure Virtual Machines DBMS-distribution för SAP

- Information om hur du etablerar hög tillgänglighet och planerar för haveriberedskap för SAP HANA i Azure (stora instanser) finns i HÖG tillgänglighet och haveriberedskap för SAP HANA (stora instanser) i Azure.

- Information om hur du etablerar hög tillgänglighet och planerar för haveriberedskap för SAP HANA på virtuella Azure-datorer finns i Hög tillgänglighet för SAP HANA på virtuella Azure-datorer (VM)