Меры защиты данных и соответствия требованиям Microsoft Purview для приложений генеративного ИИ

Руководство по лицензированию Microsoft 365 для обеспечения соответствия требованиям безопасности &

Используйте Microsoft Purview для снижения рисков, связанных с использованием ИИ, а также для управления ими, а также для реализации соответствующих средств управления защитой и управлением.

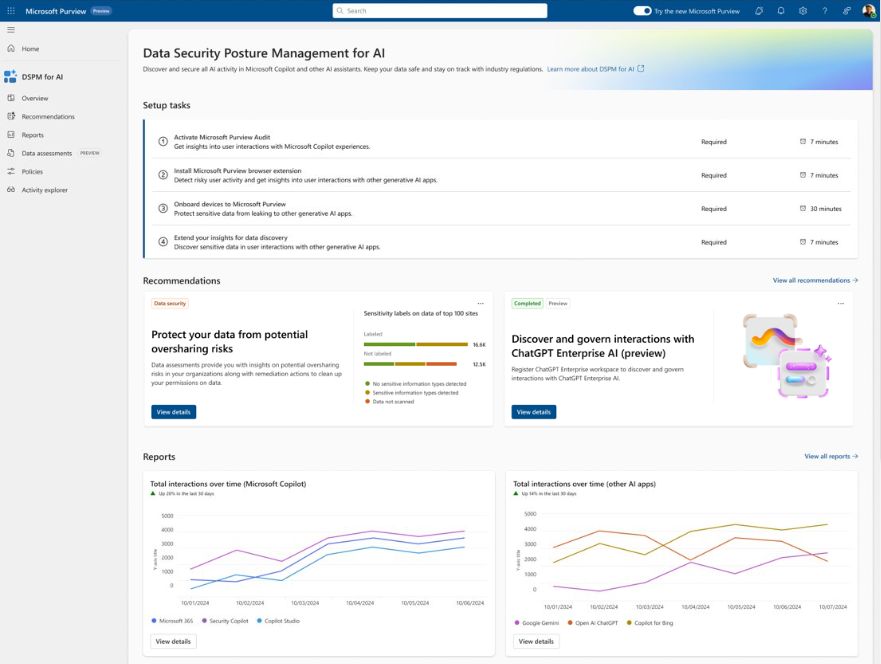

Управление состоянием безопасности данных Microsoft Purview для ИИ предоставляет простые в использовании графические инструменты и отчеты для быстрого получения аналитических сведений об использовании ИИ в организации. Политики одним щелчком помогают защитить данные и обеспечить соответствие нормативным требованиям.

Используйте управление состоянием безопасности данных для ИИ в сочетании с другими возможностями Microsoft Purview для повышения безопасности данных и соответствия требованиям для Microsoft 365 Copilot и Microsoft Copilot:

- Метки конфиденциальности и содержимое, зашифрованное Защита информации Microsoft Purview

- Классификация данных

- Ключ клиента

- Соответствие требованиям к обмену данными

- Аудит

- Поиск контента

- Обнаружение электронных данных

- Хранение и удаление

- Защищенное хранилище пользователя

Примечание.

Чтобы проверка, поддерживают ли эти возможности планы лицензирования вашей организации, см. ссылку руководство по лицензированию в верхней части страницы. Сведения о лицензировании самого Microsoft 365 Copilot см. в описании службы для Microsoft 365 Copilot.

Используйте следующие разделы, чтобы узнать больше об управлении состоянием безопасности данных для ИИ и возможностях Microsoft Purview, которые предоставляют дополнительные средства управления безопасностью данных и соответствием требованиям, чтобы ускорить внедрение Microsoft 365 Copilot и других приложений искусственного интеллекта. Если вы не знакомы с Microsoft Purview, вы также можете найти обзор продукта полезным: Узнайте о Microsoft Purview.

Дополнительные общие сведения о требованиях к безопасности и соответствию требованиям для Microsoft 365 Copilot см. в разделе Данные, конфиденциальность и безопасность для Microsoft 365 Copilot. Сведения о Microsoft Copilot см. в разделе Конфиденциальность и защита Copilot.

Управление состоянием безопасности данных для ИИ предоставляет аналитические сведения, политики и элементы управления для приложений ИИ

Microsoft Purview Data Security Posture Management for AI (DSPM for AI) на портале Microsoft Purview или Портал соответствия требованиям Microsoft Purview предоставляет централизованное расположение для управления, чтобы помочь быстро защитить данные для приложений ИИ и проактивно отслеживать использование ИИ. К этим приложениям относятся Microsoft 365 Copilot, другие копилоты от Майкрософт и приложения ИИ из сторонних крупных языковых модулей (LLM).

Управление состоянием безопасности данных для ИИ предоставляет набор возможностей, которые позволяют безопасно внедрять ИИ без необходимости выбирать между производительностью и защитой.

Аналитика и аналитика действий ИИ в вашей организации

Готовые к использованию политики для защиты данных и предотвращения потери данных в запросах ИИ

Оценки данных для выявления, исправления и мониторинга потенциального общего доступа к данным.

Элементы управления соответствием для применения политик оптимальной обработки и хранения данных

Список поддерживаемых сторонних сайтов ИИ, таких как сайты, используемые для Gemini и ChatGPT, см. в статье Поддерживаемые сайты ИИ Microsoft Purview для защиты данных и обеспечения соответствия требованиям.

Использование управления состоянием безопасности данных для ИИ

Чтобы быстрее получить аналитические сведения об использовании ИИ и защитить данные, управление состоянием безопасности данных для ИИ предоставляет некоторые рекомендуемые предварительно настроенные политики , которые можно активировать одним щелчком мыши. Уделите этим новым политикам не менее 24 часов для сбора данных, чтобы отобразить результаты в управлении состоянием безопасности данных для ИИ или отразить любые изменения, внесенные в параметры по умолчанию.

Активация не требуется, и теперь в предварительной версии управление состоянием безопасности данных для ИИ автоматически выполняет еженедельную оценку данных для 100 сайтов SharePoint, используемых Microsoft Copilot. Вы можете дополнить это собственными пользовательскими оценками данных. Эти оценки предназначены специально для выявления, исправления и отслеживания потенциального совместного использования данных, что позволяет более уверенно развертывать Microsoft 365 Copilot.

Чтобы приступить к работе с управлением состоянием безопасности данных для ИИ, можно использовать портал Microsoft Purview или Портал соответствия требованиям Microsoft Purview. Вам нужна учетная запись с соответствующими разрешениями для управления соответствием требованиям, например учетная запись, которая является членом роли Microsoft Entra группы "Администратор соответствия требованиям".

В зависимости от используемого портала перейдите в одно из следующих расположений:

Вход на портал> Microsoft PurviewРешения>DSPM для ИИ.

Войдите в Портал соответствия требованиям Microsoft Purview>DSPM для ИИ.

В разделе Обзор ознакомьтесь с разделом Начало работы , чтобы узнать больше об управлении состоянием безопасности данных для ИИ и о немедленных действиях, которые можно предпринять. Выберите каждый из них, чтобы отобразить всплывающий элемент, чтобы узнать больше, выполнить действия и проверить текущее состояние.

Действие Дополнительная информация Включение Аудит Microsoft Purview Аудит включен по умолчанию для новых клиентов, поэтому вы уже можете выполнить это требование. Если вы это делаете и пользователям уже назначены лицензии для Copilot, вы начинаете просматривать аналитические сведения о действиях Copilot из раздела Отчеты далее вниз по странице. Установка расширения браузера Microsoft Purview Необходимое условие для сторонних сайтов ИИ. Подключение устройств к Microsoft Purview Кроме того, необходимое условие для сторонних сайтов ИИ. Расширение аналитических сведений для обнаружения данных Политики одного щелчка для сбора сведений о пользователях, посещающих сторонние сайты и отправляющих им конфиденциальную информацию. Этот параметр совпадает с кнопкой "Расширить аналитику " в разделе Аналитика данных ИИ далее вниз по странице. Дополнительные сведения о предварительных требованиях см. в разделе Предварительные требования для управления состоянием безопасности данных для ИИ.

Дополнительные сведения о предварительно настроенных политиках, которые можно активировать, см. в статье Политики одним щелчком из раздела Управление состоянием безопасности данных для ИИ.

Затем просмотрите раздел Рекомендации и решите, следует ли реализовать какие-либо параметры, относящиеся к вашему клиенту. Просмотрите каждую рекомендацию, чтобы понять, как они относятся к вашим данным, и узнать больше.

Эти варианты включают в себя выполнение оценки данных на сайтах SharePoint, создание меток и политик конфиденциальности для защиты данных, а также создание политик по умолчанию , которые помогут вам немедленно обнаруживать и защищать конфиденциальные данные, отправляемые на генерируемые сайты ИИ. Примеры рекомендаций:

- Защитите данные от потенциальных рисков чрезмерного использования, просматривая результаты оценки данных по умолчанию, чтобы выявить и устранить проблемы, чтобы помочь вам более уверенно развертывать Microsoft 365 Copilot.

- Защитите конфиденциальные данные, на которые ссылается Microsoft 365 Copilot, создав политику защиты от потери данных, которая выбирает метки конфиденциальности, чтобы предотвратить Microsoft 365 Copilot суммирование данных с метками. Дополнительные сведения см. в статье Сведения о расположении политики Microsoft 365 Copilot.

- Обнаружение рискованных взаимодействий в приложениях ИИ для вычисления риска пользователей путем обнаружения рискованных запросов и ответов в Microsoft 365 Copilot и других приложениях искусственного интеллекта. Дополнительные сведения см. в разделе Рискованное использование ИИ (предварительная версия).

- Обнаруживайте и управляйте взаимодействием с ИИ ChatGPT Enterprise, регистрируя ChatGPT рабочих областей Enterprise. Вы можете определить потенциальные риски, связанные с данными, путем обнаружения конфиденциальной информации, которая предоставляется ChatGPT Enterprise.

- Получите интерактивную помощь по нормативным требованиям ИИ, в котором используются нормативные шаблоны для сопоставления элементов управления, от диспетчера соответствия требованиям.

Вы можете использовать ссылку Просмотреть все рекомендации или Рекомендации из области навигации, чтобы просмотреть все доступные рекомендации для клиента и их состояние. Если рекомендация будет завершена или отклонена, она больше не отображается на странице Обзор .

Используйте раздел Отчеты или страницу Отчеты в области навигации, чтобы просмотреть результаты созданных по умолчанию политик. Необходимо подождать по крайней мере день, пока отчеты будут заполнены. Выберите категории возможностей Microsoft Copilot, корпоративных приложений ИИ и других приложений ИИ, чтобы определить конкретное приложение ИИ.

На странице Политики можно отслеживать состояние политик по умолчанию, созданных по умолчанию , и политик, связанных с ИИ, из других решений Microsoft Purview. Чтобы изменить политики, используйте соответствующее решение для управления на портале. Например, для DSPM для ИИ — неэтичное поведение в Copilot можно проверить и исправить совпадения из решения по соответствию связи .

Примечание.

Если у вас есть старые политики хранения для чатов Teams по расположению и взаимодействий с Copilot, они не включаются на эту страницу. Узнайте, как создать отдельные политики хранения для возможностей Microsoft Copilot, которые включают Microsoft 365 Copilot и будут отображаться на этой странице политики.

Выберите Обозреватель действий , чтобы просмотреть сведения о данных, собранных из политик.

Эта более подробная информация включает в себя тип действия и пользователя, дату и время, категорию приложения ИИ и приложение, приложение с доступом, любые типы конфиденциальной информации, файлы, на которые ссылается ссылка, и конфиденциальные файлы.

Примеры действий включают взаимодействие с ИИ, типы конфиденциальной информации и посещение веб-сайта ИИ. Запросы и ответы Copilot включаются в события взаимодействия СИ , если у вас есть правильные разрешения. Дополнительные сведения о событиях см. в разделе События обозревателя действий.

Как и в категориях отчетов, рабочие нагрузки включают Microsoft Copilot experiences, корпоративные приложения ИИ и другие приложения ИИ. Примерами идентификатора приложения и узла приложения для Microsoft Copilot Experiences являются Microsoft 365 Copilots и Word соответственно.

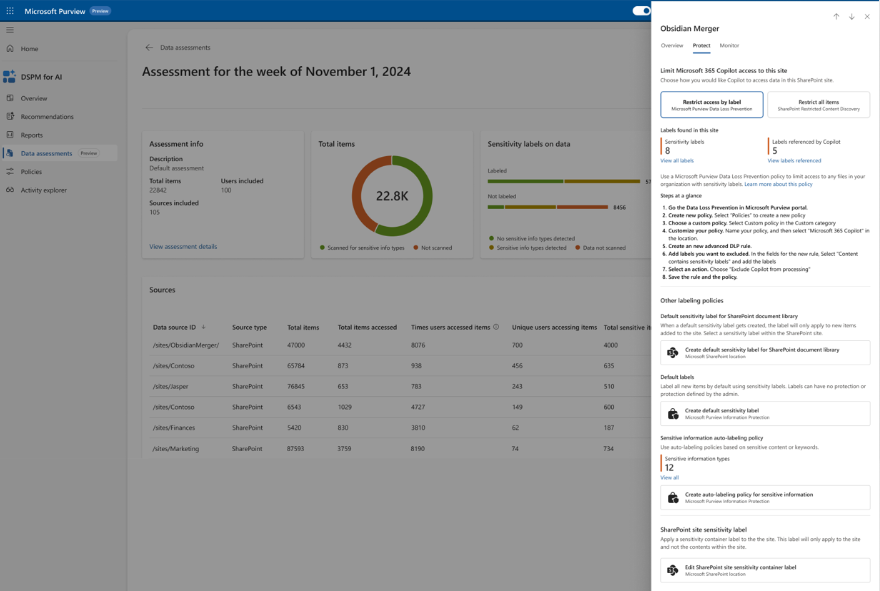

Выберите Оценки данных (предварительная версия), чтобы определить и устранить потенциальные риски, связанные с превышением общего доступа к данным в организации. Оценка данных по умолчанию автоматически выполняется еженедельно для 100 лучших сайтов SharePoint, используемых Copilot в вашей организации. Возможно, вы уже выполнили настраиваемую оценку в качестве одной из рекомендаций. Однако регулярно вернитесь к этому параметру, чтобы проверка еженедельные результаты оценки по умолчанию и запускать пользовательские оценки, когда вы хотите проверка для разных пользователей или определенных сайтов.

Из-за мощности и скорости ИИ может упреждающе отображать содержимое, которое может быть устаревшим, с превышением разрешений или отсутствием элементов управления, генеративный ИИ усиливает проблему чрезмерного совместного использования данных. Используйте оценки данных для выявления и устранения проблем.

Чтобы просмотреть автоматически созданную оценку данных для вашего клиента, в категории Оценки по умолчанию выберите в списке Параметр Oversharing Assessment (Оценка превышения общего доступа) для недели <месяца или года> . В столбцах для каждого сообщаемого сайта отображаются такие сведения, как общее количество найденных элементов, количество обращений и частота, а также количество типов конфиденциальной информации, которые были найдены и доступны.

В списке выберите каждый сайт для доступа к всплывающей области с вкладками Обзор, Защита и Мониторинг. Используйте сведения на каждой вкладке, чтобы узнать больше и выполнить рекомендуемые действия. Например:

Используйте вкладку Защита , чтобы выбрать параметры для устранения чрезмерного совместного использования, которые включают следующие:

- Ограничение доступа по меткам. Используйте Защита от потери данных Microsoft Purview, чтобы создать политику защиты от потери данных, которая запрещает Microsoft 365 Copilot суммировать данные при выборе меток конфиденциальности. Дополнительные сведения о том, как это работает и поддерживаемых сценариях, см. в статье Сведения о расположении политики Microsoft 365 Copilot.

- Ограничить все элементы. Используйте ограниченное обнаружение содержимого SharePoint, чтобы получить список сайтов SharePoint, которые будут исключены из Microsoft 365 Copilot. Дополнительные сведения см. в статье Ограниченное обнаружение содержимого для сайтов SharePoint.

- Создание политики автоматической маркировки. При обнаружении конфиденциальной информации для файлов без меток используйте Защита информации Microsoft Purview, чтобы создать политику автоматической маркировки, чтобы автоматически применить метку конфиденциальности к конфиденциальным данным. Дополнительные сведения о создании этой политики см. в статье Настройка политик автоматической маркировки для SharePoint, OneDrive и Exchange.

- Создание политик хранения. Если доступ к содержимому не был предоставлен не менее 3 лет, используйте Управление жизненным циклом данных Microsoft Purview, чтобы автоматически удалить его. Дополнительные сведения о создании политики хранения см. в статье Создание и настройка политик хранения.

Используйте вкладку Монитор , чтобы просмотреть количество элементов на сайте, к которым предоставлен доступ всем пользователям, общий доступ всем пользователям в организации, общий доступ к определенным пользователям и внешний доступ. Выберите Запустить проверку доступа к сайту SharePoint , чтобы узнать, как использовать отчеты по управлению доступом к данным SharePoint.

Пример снимка экрана: после выполнения оценки данных на вкладке Защита с найденными проблемами:

Чтобы создать собственную пользовательскую оценку данных, выберите Создать оценку , чтобы определить потенциальные проблемы с общим доступом для всех или выбранных пользователей, источники данных для сканирования (в настоящее время поддерживаются только для SharePoint) и запустите оценку.

Если выбраны все сайты, вам не нужно быть участником сайтов, но для выбора определенных сайтов необходимо быть участником.

Эта оценка данных создается в категории Пользовательские оценки . Дождитесь, пока состояние оценки отобразится Сканирование завершено, и выберите его, чтобы просмотреть подробные сведения. Чтобы повторно запустить настраиваемую оценку данных, используйте параметр дублировать, чтобы создать новую оценку, начиная с того же выбора.

В настоящее время оценки данных поддерживают не более 200 000 элементов в каждом расположении.

Для Microsoft 365 Copilot и Microsoft Copilot используйте эти политики, средства и аналитические сведения в сочетании с дополнительными возможностями защиты и соответствия требованиям от Microsoft Purview.

Microsoft Purview усиливает защиту информации для Copilot

Microsoft 365 Copilot использует существующие элементы управления для обеспечения того, чтобы данные, хранящиеся в клиенте, никогда не возвращались пользователю или не использовались крупной языковой моделью (LLM), если у пользователя нет доступа к этим данным. Если к содержимому применяются метки конфиденциальности из вашей организации, существует дополнительный уровень защиты:

Если файл открыт в Word, Excel, PowerPoint или аналогично открытое сообщение электронной почты или событие календаря в Outlook, конфиденциальность данных отображается для пользователей в приложении с именем метки и маркировкой содержимого (например, текстом верхнего или нижнего колонтитула), настроенными для метки. Loop компоненты и страницы также поддерживают одинаковые метки конфиденциальности.

Когда метка конфиденциальности применяет шифрование, пользователи должны иметь право на использование EXTRACT, а также view, чтобы Copilot возвращал данные.

Эта защита распространяется на данные, хранящиеся за пределами клиента Microsoft 365, когда они открыты в приложении Office (используемые данные). Например, локальное хранилище, сетевые ресурсы и облачное хранилище.

Совет

Если вы еще этого не сделали, мы рекомендуем включить метки конфиденциальности для SharePoint и OneDrive, а также ознакомиться с типами файлов и конфигурациями меток, которые могут обрабатываться этими службами. Если метки конфиденциальности не включены для этих служб, зашифрованные файлы, к которым Microsoft 365 Copilot могут получить доступ, ограничены данными, используемыми из приложений Office в Windows.

Инструкции см . в статье Включение меток конфиденциальности для файлов Office в SharePoint и OneDrive.

Кроме того, при использовании Business Chat (ранее — чат на основе Графа и Microsoft 365 Chat), которые могут получать доступ к данным из широкого спектра содержимого, конфиденциальность помеченных данных, возвращаемых Microsoft 365 Copilot, становится видимой для пользователей с меткой конфиденциальности, отображаемой для ссылок и элементов, перечисленных в ответе. Используя номер приоритета меток конфиденциальности, определенный на портале Microsoft Purview или Портал соответствия требованиям Microsoft Purview, последний ответ в Copilot отображает метку конфиденциальности с наивысшим приоритетом из данных, используемых для этого чата Copilot.

Хотя администраторы соответствия требованиям определяют приоритет метки конфиденциальности, более высокий номер приоритета обычно означает более высокую чувствительность содержимого с более строгими разрешениями. В результате ответы Copilot помечены самой строгой меткой конфиденциальности.

Примечание.

Если элементы шифруются Защита информации Microsoft Purview но не имеют метки конфиденциальности, Microsoft 365 Copilot также не вернет эти элементы пользователям, если шифрование не включает права на использование EXTRACT или VIEW для пользователя.

Если вы еще не используете метки конфиденциальности, см. статью Начало работы с метками конфиденциальности.

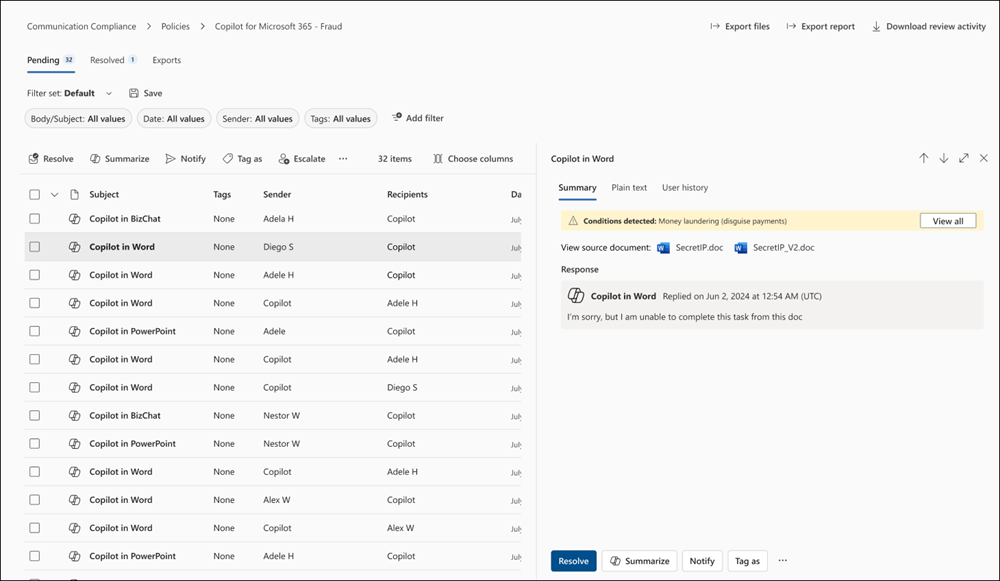

Хотя политики защиты от потери данных не поддерживают классификацию данных для Microsoft 365 Copilot взаимодействий, типы конфиденциальной информации и обучаемые классификаторы поддерживаются политиками соответствия требованиям к обмену данными для определения конфиденциальных данных в запросах пользователей к Copilot и ответах.

Защита copilot с наследованием меток конфиденциальности

При использовании Microsoft 365 Copilot для создания нового содержимого на основе элемента, к которому применена метка конфиденциальности, метка конфиденциальности из исходного файла автоматически наследуется с параметрами защиты метки.

Например, пользователь выбирает Черновик с Copilot в Word, а затем — ссылку на файл. Либо пользователь выбирает Создать презентацию из файла в PowerPoint или Изменить в страницах из Business Chat. К исходному содержимому применена метка конфиденциальности "Конфиденциальный\Любой (неограниченную) и эта метка настроена для применения нижнего колонтитула с надписью "Конфиденциально". Новое содержимое автоматически помечается как Конфиденциальный\Любой (неограниченный) с помощью того же нижнего колонтитула.

Чтобы увидеть пример этого в действии, watch следующую демонстрацию из сеанса Ignite 2023: "Подготовка предприятия к Microsoft 365 Copilot". В демонстрации показано, как метка конфиденциальности по умолчанию общего заменяется меткой Конфиденциально , когда пользователь выполняет черновик с помощью Copilot и ссылается на помеченный файл. Информационная панель под лентой информирует пользователя о том, что содержимое, созданное Copilot, привело к автоматическому применению новой метки:

Если для создания нового содержимого используется несколько файлов, метка конфиденциальности с наивысшим приоритетом используется для наследования меток.

Как и во всех сценариях автоматического применения меток, пользователь всегда может переопределить и заменить наследуемую метку (или удалить, если вы не используете обязательные метки).

Защита Microsoft Purview без меток конфиденциальности

Даже если метка конфиденциальности не применяется к содержимому, службы и продукты могут использовать возможности шифрования из службы Azure Rights Management. В результате Microsoft 365 Copilot по-прежнему может проверка для прав использования VIEW и EXTRACT, прежде чем возвращать данные и ссылки пользователю, но автоматическое наследование защиты для новых элементов не выполняется.

Совет

Вы получите лучший пользовательский интерфейс, если вы всегда используете метки конфиденциальности для защиты данных, а шифрование применяется меткой.

Примеры продуктов и служб, которые могут использовать возможности шифрования из службы Azure Rights Management без меток конфиденциальности:

- Шифрование сообщений Microsoft Purview

- Microsoft Information Rights Management (IRM)

- Соединитель Microsoft Rights Management

- Пакет SDK для управления правами (Майкрософт)

Для других методов шифрования, которые не используют службу Azure Rights Management:

Защищенные S/MIME сообщения электронной почты не будут возвращены Copilot, и Copilot недоступен в Outlook, когда открыта защищенная электронная почта S/MIME.

Защищенные паролем документы не могут быть доступны Microsoft 365 Copilot, если они уже открыты пользователем в том же приложении (данные используются). Пароли не наследуются целевым элементом.

Как и в случае с другими службами Microsoft 365, такими как обнаружение электронных данных и поиск, элементы, зашифрованные с помощью ключа клиента Microsoft Purview или собственного корневого ключа (BYOK), поддерживаются и могут быть возвращены Microsoft 365 Copilot.

Microsoft Purview поддерживает управление соответствием требованиям для Copilot

Используйте возможности соответствия требованиям Microsoft Purview с корпоративной защитой данных для поддержки требований к рискам и соответствию для Microsoft 365 Copilot, Microsoft Copilot и других приложений искусственного интеллекта.

Взаимодействие с Copilot можно отслеживать для каждого пользователя в клиенте. Таким образом, вы можете использовать классификацию Purview (типы конфиденциальной информации и обучаемые классификаторы), поиск контента, соответствие требованиям к обмену данными, аудит, обнаружение электронных данных, а также возможности автоматического хранения и удаления с помощью политик хранения.

Чтобы обеспечить соответствие требованиям к обмену данными, вы можете проанализировать запросы пользователей и ответы Copilot, чтобы обнаружить неуместное или рискованное взаимодействие или совместное использование конфиденциальной информации. Дополнительные сведения см. в разделе Настройка политики соответствия требованиям к обмену данными для обнаружения взаимодействий Copilot.

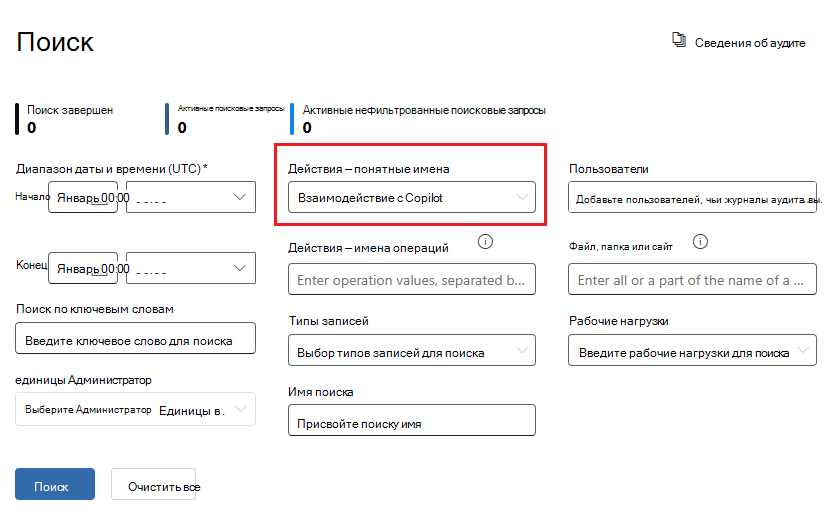

Для аудита сведения записываются в единый журнал аудита , когда пользователи взаимодействуют с Copilot. События включают в себя то, как и когда пользователи взаимодействуют с Copilot, в котором microsoft 365 обслуживает действие, и ссылки на файлы, хранящиеся в Microsoft 365, которые были доступны во время взаимодействия. Если к этим файлам применена метка конфиденциальности, она также записывается. В решении аудит на портале Microsoft Purview или Портал соответствия требованиям Microsoft Purview выберите Действия Copilot и Взаимодействие с Copilot. Вы также можете выбрать Copilot в качестве рабочей нагрузки. Например, на портале соответствия требованиям:

При поиске содержимого, так как запросы пользователей к Copilot и ответы от Copilot хранятся в почтовом ящике пользователя, их можно искать и извлекать, когда почтовый ящик пользователя выбран в качестве источника для поискового запроса. Выберите и получите эти данные из исходного почтового ящика, выбрав в построителе запросов Условие> ДобавленияТип>равно любому из>параметров Добавление и удаление дополнительных параметров>Взаимодействия Copilot.

Аналогично для обнаружения электронных данных вы используете один и тот же процесс запроса для выбора почтовых ящиков и получения запросов пользователей к Copilot и ответов от Copilot. После создания коллекции и ее отправки на этап проверки в eDiscovery (премиум) эти данные будут доступны для выполнения всех существующих действий проверки. Затем эти коллекции и наборы для проверки можно дополнительно отложить или экспортировать. Если вам нужно удалить эти данные, см. статью Поиск и удаление данных для Copilot.

Для политик хранения, поддерживающих автоматическое хранение и удаление, пользователь запрашивает Copilot, а ответы от Copilot определяются microsoft 365 Copilots, включенными в расположение политики Microsoft Copilot Experiences. Ранее включенные в расположение политики чаты Teams и взаимодействие с Copilot эти старые политики хранения заменяются отдельными расположениями. Дополнительные сведения см. в разделе Разделение существующей политики "Чаты Teams и взаимодействия с copilot".

Подробные сведения об этом способе хранения см. в статье Сведения о хранении для приложений Copilot & ИИ.

Как и во всех политиках хранения и удержаниях, если к пользователю применяется несколько политик для одного расположения, принципы хранения разрешают любые конфликты. Например, данные хранятся в течение самого длительного времени из всех примененных политик хранения или удержаний eDiscovery.

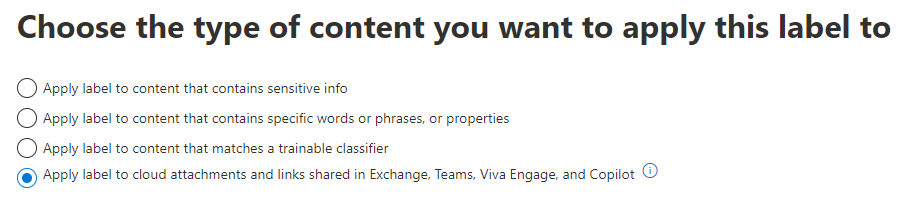

Чтобы метки хранения автоматически сохраняли файлы, на которые ссылается Copilot, выберите параметр для облачных вложений с политикой автоматического применения меток хранения: Применить метку к облачным вложениям и ссылкам, совместно используемым в Exchange, Teams, Viva Engage и Copilot. Как и во всех сохраненных облачных вложениях, сохраняется версия файла на момент ссылки на него.

Подробные сведения о том, как это хранение работает, см. в статье Как хранение работает с облачными вложениями.

Инструкции по настройке:

Сведения о настройке политик соответствия требованиям к обмену данными для взаимодействия с Copilot см. в статье Создание политик соответствия требованиям к обмену данными и управление ими.

Сведения о поиске взаимодействий Copilot в журнале аудита см. в статье Поиск в журнале аудита.

Сведения об использовании поиска контента для поиска взаимодействий с Copilot см. в разделе Поиск содержимого.

Сведения об использовании обнаружения электронных данных для взаимодействия с Copilot см. в статье решения Microsoft Purview eDiscovery.

Сведения о создании или изменении политики хранения для взаимодействий с Copilot см. в статье Создание и настройка политик хранения.

Чтобы создать политику автоматического применения меток хранения для файлов, на которые ссылается Copilot, см. статью Автоматическое применение метки хранения для хранения или удаления содержимого.

Другая документация по защите и управлению приложениями на основе искусственного интеллекта

Объявление в блоге: Ускорение внедрения ИИ с помощью возможностей безопасности и управления нового поколения

Дополнительные сведения см. в разделе Рекомендации по управлению состоянием безопасности данных Microsoft Purview для ИИ и защиты данных и соответствия требованиям для Copilot.

Microsoft 365 Copilot:

Связанные ресурсы: