Создание завершений чата с помощью вывода модели искусственного интеллекта Azure

Внимание

Элементы, обозначенные в этой статье как (предварительная версия), сейчас предлагаются в общедоступной предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Дополнительные сведения см. в статье Дополнительные условия использования Предварительных версий Microsoft Azure.

В этой статье объясняется, как использовать API завершения чата с моделями, развернутыми в модели ИИ Azure в службах ИИ Azure.

Необходимые компоненты

Чтобы использовать модели завершения чата в приложении, вам потребуется:

Подписка Azure. Если вы используете модели GitHub, вы можете обновить интерфейс и создать подписку Azure в процессе. Ознакомьтесь с обновлением моделей GitHub до модели ИИ Azure, если это ваше дело.

Ресурс служб ИИ Azure. Дополнительные сведения см. в статье "Создание ресурса Служб искусственного интеллекта Azure".

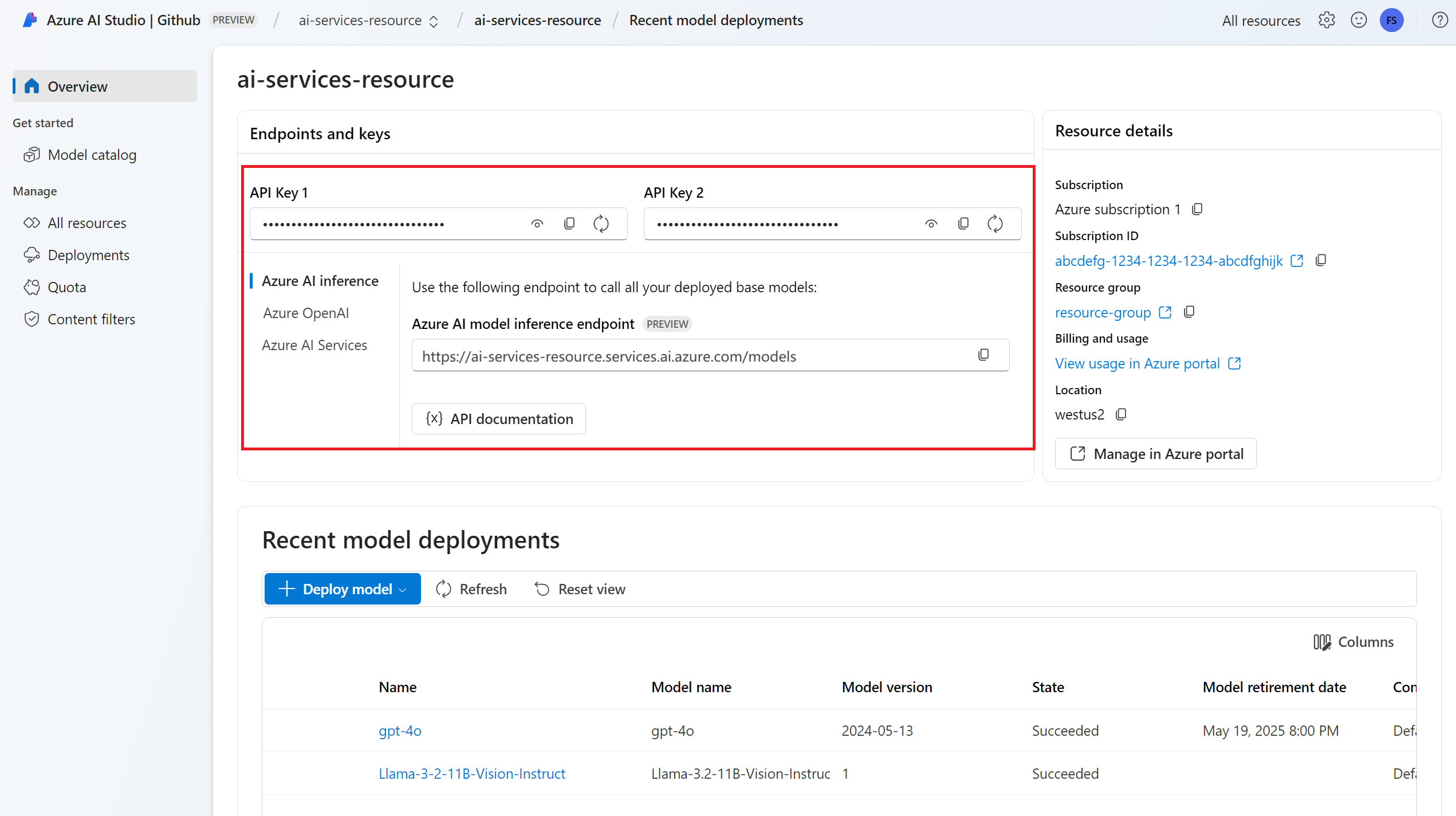

URL-адрес конечной точки и ключ.

Развертывание модели завершения чата. Если у вас нет одного чтения "Добавить и настроить модели" в службы ИИ Azure для добавления модели завершения чата в ресурс.

Установите пакет вывода искусственного интеллекта Azure с помощью следующей команды:

pip install -U azure-ai-inferenceСовет

Дополнительные сведения о пакете вывода и справочнике по выводу искусственного интеллекта Azure.

Использование завершения чата

Сначала создайте клиент для использования модели. В следующем коде используется URL-адрес конечной точки и ключ, хранящиеся в переменных среды.

import os

from azure.ai.inference import ChatCompletionsClient

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint=os.environ["AZURE_INFERENCE_ENDPOINT"],

credential=AzureKeyCredential(os.environ["AZURE_INFERENCE_CREDENTIAL"]),

model="mistral-large-2407"

)

Если вы настроили ресурс в службу поддержки идентификатора Microsoft Entra, можно использовать следующий фрагмент кода для создания клиента.

import os

from azure.ai.inference import ChatCompletionsClient

from azure.identity import DefaultAzureCredential

client = ChatCompletionsClient(

endpoint=os.environ["AZURE_INFERENCE_ENDPOINT"],

credential=DefaultAzureCredential(),

model="mistral-large-2407"

)

Создание запроса на завершение чата

В следующем примере показано, как создать базовый запрос завершения чата в модель.

from azure.ai.inference.models import SystemMessage, UserMessage

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="How many languages are in the world?"),

],

)

Примечание.

Некоторые модели не поддерживают системные сообщения (role="system"). При использовании API вывода модели искусственного интеллекта Azure системные сообщения переводятся в сообщения пользователей, что является наиболее доступной возможностью. Этот перевод предлагается для удобства, но важно убедиться, что модель выполняет инструкции в системном сообщении с правильным уровнем достоверности.

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

print("Response:", response.choices[0].message.content)

print("Model:", response.model)

print("Usage:")

print("\tPrompt tokens:", response.usage.prompt_tokens)

print("\tTotal tokens:", response.usage.total_tokens)

print("\tCompletion tokens:", response.usage.completion_tokens)

Response: As of now, it's estimated that there are about 7,000 languages spoken around the world. However, this number can vary as some languages become extinct and new ones develop. It's also important to note that the number of speakers can greatly vary between languages, with some having millions of speakers and others only a few hundred.

Model: mistral-large-2407

Usage:

Prompt tokens: 19

Total tokens: 91

Completion tokens: 72

Просмотрите usage раздел в ответе, чтобы просмотреть количество маркеров, используемых для запроса, общее количество созданных маркеров и количество маркеров, используемых для завершения.

Потоковая передача содержимого

По умолчанию API завершения возвращает все созданное содержимое в одном ответе. Если вы создаете длительные завершения, ожидание ответа может занять много секунд.

Вы можете передавать содержимое, чтобы получить его по мере создания. Потоковая передача содержимого позволяет начать обработку завершения по мере того, как содержимое становится доступным. Этот режим возвращает объект, который передает ответ как события, отправляемые сервером только для данных. Извлеките блоки из разностного поля, а не поля сообщения.

Чтобы выполнить потоковую передачу завершения, задайте stream=True при вызове модели.

result = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="How many languages are in the world?"),

],

temperature=0,

top_p=1,

max_tokens=2048,

stream=True,

)

Чтобы визуализировать выходные данные, определите вспомогательную функцию для печати потока.

def print_stream(result):

"""

Prints the chat completion with streaming.

"""

import time

for update in result:

if update.choices:

print(update.choices[0].delta.content, end="")

Вы можете визуализировать, как потоковая передача создает содержимое:

print_stream(result)

Дополнительные параметры, поддерживаемые клиентом вывода

Изучите другие параметры, которые можно указать в клиенте вывода. Полный список всех поддерживаемых параметров и их соответствующей документации см . в справочнике по API вывода модели ИИ Azure.

from azure.ai.inference.models import ChatCompletionsResponseFormatText

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="How many languages are in the world?"),

],

presence_penalty=0.1,

frequency_penalty=0.8,

max_tokens=2048,

stop=["<|endoftext|>"],

temperature=0,

top_p=1,

response_format={ "type": ChatCompletionsResponseFormatText() },

)

Некоторые модели не поддерживают форматирование выходных данных JSON. Вы всегда можете запрашивать модель для создания выходных данных JSON. Однако такие выходные данные не гарантируют допустимости JSON.

Если вы хотите передать параметр, который отсутствует в списке поддерживаемых параметров, его можно передать в базовую модель с помощью дополнительных параметров. Дополнительные параметры см. в разделе "Передача дополнительных параметров в модель".

Создание выходных данных JSON

Некоторые модели могут создавать выходные данные JSON. Установите response_format для json_object включения режима JSON и гарантирует, что создается сообщение, которое создает модель, является допустимым JSON. Кроме того, необходимо указать модели, чтобы создать JSON самостоятельно с помощью системного или пользовательского сообщения. Кроме того, содержимое сообщения может быть частично отрезано, если finish_reason="length"это означает, что превышено поколение max_tokens или что беседа превысила максимальную длину контекста.

from azure.ai.inference.models import ChatCompletionsResponseFormatJSON

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant that always generate responses in JSON format, using."

" the following format: { ""answer"": ""response"" }."),

UserMessage(content="How many languages are in the world?"),

],

response_format={ "type": ChatCompletionsResponseFormatJSON() }

)

Передача дополнительных параметров модели

API вывода модели ИИ Azure позволяет передавать дополнительные параметры модели в модель. В следующем примере кода показано, как передать дополнительный параметр logprobs модели.

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="How many languages are in the world?"),

],

model_extras={

"logprobs": True

}

)

Перед передачей дополнительных параметров в API вывода модели ИИ Azure убедитесь, что ваша модель поддерживает эти дополнительные параметры. Когда запрос выполняется в базовую модель, заголовок extra-parameters передается модели со значением pass-through. Это значение указывает конечной точке передавать дополнительные параметры модели. Использование дополнительных параметров с моделью не гарантирует, что модель может фактически обрабатывать их. Ознакомьтесь с документацией по модели, чтобы понять, какие дополнительные параметры поддерживаются.

Использование средств

Некоторые модели поддерживают использование инструментов, которые могут быть чрезвычайным ресурсом, когда необходимо выгрузить конкретные задачи из языковой модели и вместо этого полагаться на более детерминированную систему или даже другую языковую модель. API вывода модели ИИ Azure позволяет определить средства следующим образом.

В следующем примере кода создается определение средства, которое может искать сведения о полете из двух разных городов.

from azure.ai.inference.models import FunctionDefinition, ChatCompletionsFunctionToolDefinition

flight_info = ChatCompletionsFunctionToolDefinition(

function=FunctionDefinition(

name="get_flight_info",

description="Returns information about the next flight between two cities. This includes the name of the airline, flight number and the date and time of the next flight",

parameters={

"type": "object",

"properties": {

"origin_city": {

"type": "string",

"description": "The name of the city where the flight originates",

},

"destination_city": {

"type": "string",

"description": "The flight destination city",

},

},

"required": ["origin_city", "destination_city"],

},

)

)

tools = [flight_info]

В этом примере выходные данные функции заключается в том, что для выбранного маршрута нет рейсов, но пользователь должен рассмотреть вопрос о принятии поезда.

def get_flight_info(loc_origin: str, loc_destination: str):

return {

"info": f"There are no flights available from {loc_origin} to {loc_destination}. You should take a train, specially if it helps to reduce CO2 emissions."

}

Примечание.

Для моделей cohere требуется, чтобы ответы средства были допустимыми содержимым JSON, отформатированными в виде строки. При создании сообщений типа Tool убедитесь, что ответ является допустимой строкой JSON.

Предложите модели забронировать рейсы с помощью этой функции:

messages = [

SystemMessage(

content="You are a helpful assistant that help users to find information about traveling, how to get"

" to places and the different transportations options. You care about the environment and you"

" always have that in mind when answering inqueries.",

),

UserMessage(

content="When is the next flight from Miami to Seattle?",

),

]

response = client.complete(

messages=messages, tools=tools, tool_choice="auto"

)

Вы можете проверить ответ, чтобы узнать, нужно ли вызывать средство. Проверьте причину завершения, чтобы определить, следует ли вызывать средство. Помните, что можно указать несколько типов инструментов. В этом примере показан инструмент типа function.

response_message = response.choices[0].message

tool_calls = response_message.tool_calls

print("Finish reason:", response.choices[0].finish_reason)

print("Tool call:", tool_calls)

Чтобы продолжить, добавьте это сообщение в журнал чата:

messages.append(

response_message

)

Теперь пришло время вызвать соответствующую функцию для обработки вызова средства. Следующий фрагмент кода выполняет итерацию всех вызовов инструментов, указанных в ответе, и вызывает соответствующую функцию с соответствующими параметрами. Ответ также добавляется в журнал чата.

import json

from azure.ai.inference.models import ToolMessage

for tool_call in tool_calls:

# Get the tool details:

function_name = tool_call.function.name

function_args = json.loads(tool_call.function.arguments.replace("\'", "\""))

tool_call_id = tool_call.id

print(f"Calling function `{function_name}` with arguments {function_args}")

# Call the function defined above using `locals()`, which returns the list of all functions

# available in the scope as a dictionary. Notice that this is just done as a simple way to get

# the function callable from its string name. Then we can call it with the corresponding

# arguments.

callable_func = locals()[function_name]

function_response = callable_func(**function_args)

print("->", function_response)

# Once we have a response from the function and its arguments, we can append a new message to the chat

# history. Notice how we are telling to the model that this chat message came from a tool:

messages.append(

ToolMessage(

tool_call_id=tool_call_id,

content=json.dumps(function_response)

)

)

Просмотрите ответ модели:

response = client.complete(

messages=messages,

tools=tools,

)

Применение безопасности содержимого

API вывода модели ИИ Azure поддерживает безопасность содержимого ИИ Azure. При использовании развертываний с включенной безопасностью содержимого искусственного интеллекта Azure входные и выходные данные проходят через ансамбль моделей классификации, направленных на обнаружение и предотвращение вывода вредного содержимого. Система фильтрации содержимого обнаруживает и принимает меры по определенным категориям потенциально вредного содержимого как в запросах ввода, так и в завершении выходных данных.

В следующем примере показано, как обрабатывать события, когда модель обнаруживает вредное содержимое во входном запросе и включена безопасность содержимого.

from azure.ai.inference.models import AssistantMessage, UserMessage, SystemMessage

try:

response = client.complete(

messages=[

SystemMessage(content="You are an AI assistant that helps people find information."),

UserMessage(content="Chopping tomatoes and cutting them into cubes or wedges are great ways to practice your knife skills."),

]

)

print(response.choices[0].message.content)

except HttpResponseError as ex:

if ex.status_code == 400:

response = ex.response.json()

if isinstance(response, dict) and "error" in response:

print(f"Your request triggered an {response['error']['code']} error:\n\t {response['error']['message']}")

else:

raise

raise

Совет

Дополнительные сведения о настройке и управлении параметрами безопасности содержимого ИИ Azure см. в документации по безопасности содержимого ИИ Azure.

Использование завершения чата с изображениями

Некоторые модели могут вызывать текст и изображения и создавать завершения текста на основе обоих типов входных данных. В этом разделе описаны возможности некоторых моделей для визуального зрения в чате:

Внимание

Некоторые модели поддерживают только одно изображение для каждого поворота беседы в чате, и только последний образ сохраняется в контексте. При добавлении нескольких изображений это приведет к ошибке.

Чтобы увидеть эту возможность, скачайте изображение и закодируйте сведения в виде base64 строки. Полученные данные должны находиться внутри URL-адреса данных:

from urllib.request import urlopen, Request

import base64

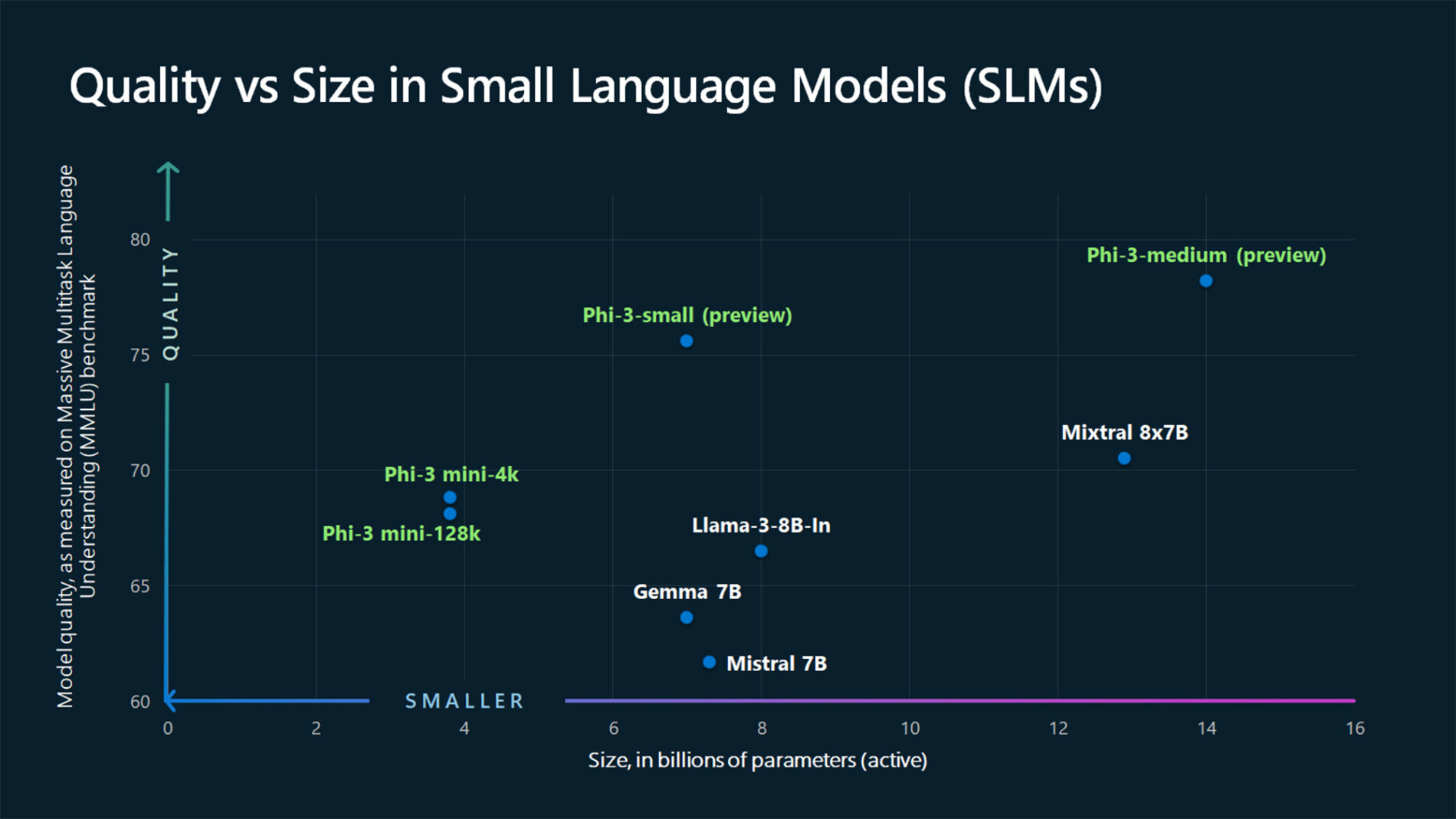

image_url = "https://news.microsoft.com/source/wp-content/uploads/2024/04/The-Phi-3-small-language-models-with-big-potential-1-1900x1069.jpg"

image_format = "jpeg"

request = Request(image_url, headers={"User-Agent": "Mozilla/5.0"})

image_data = base64.b64encode(urlopen(request).read()).decode("utf-8")

data_url = f"data:image/{image_format};base64,{image_data}"

Визуализировать изображение:

import requests

import IPython.display as Disp

Disp.Image(requests.get(image_url).content)

Теперь создайте запрос на завершение чата с изображением:

from azure.ai.inference.models import TextContentItem, ImageContentItem, ImageUrl

response = client.complete(

messages=[

SystemMessage("You are a helpful assistant that can generate responses based on images."),

UserMessage(content=[

TextContentItem(text="Which conclusion can be extracted from the following chart?"),

ImageContentItem(image=ImageUrl(url=data_url))

]),

],

temperature=0,

top_p=1,

max_tokens=2048,

)

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

print(f"{response.choices[0].message.role}:\n\t{response.choices[0].message.content}\n")

print("Model:", response.model)

print("Usage:")

print("\tPrompt tokens:", response.usage.prompt_tokens)

print("\tCompletion tokens:", response.usage.completion_tokens)

print("\tTotal tokens:", response.usage.total_tokens)

ASSISTANT: The chart illustrates that larger models tend to perform better in quality, as indicated by their size in billions of parameters. However, there are exceptions to this trend, such as Phi-3-medium and Phi-3-small, which outperform smaller models in quality. This suggests that while larger models generally have an advantage, there might be other factors at play that influence a model's performance.

Model: mistral-large-2407

Usage:

Prompt tokens: 2380

Completion tokens: 126

Total tokens: 2506

Внимание

Элементы, обозначенные в этой статье как (предварительная версия), сейчас предлагаются в общедоступной предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Дополнительные сведения см. в статье Дополнительные условия использования Предварительных версий Microsoft Azure.

В этой статье объясняется, как использовать API завершения чата с моделями, развернутыми в модели ИИ Azure в службах ИИ Azure.

Необходимые компоненты

Чтобы использовать модели завершения чата в приложении, вам потребуется:

Подписка Azure. Если вы используете модели GitHub, вы можете обновить интерфейс и создать подписку Azure в процессе. Ознакомьтесь с обновлением моделей GitHub до модели ИИ Azure, если это ваше дело.

Ресурс служб ИИ Azure. Дополнительные сведения см. в статье "Создание ресурса Служб искусственного интеллекта Azure".

URL-адрес конечной точки и ключ.

Развертывание модели завершения чата. Если у вас нет одного чтения "Добавить и настроить модели" в службы ИИ Azure для добавления модели завершения чата в ресурс.

Установите библиотеку вывода Azure для JavaScript с помощью следующей команды:

npm install @azure-rest/ai-inferenceСовет

Дополнительные сведения о пакете вывода и справочнике по выводу искусственного интеллекта Azure.

Использование завершения чата

Сначала создайте клиент для использования модели. В следующем коде используется URL-адрес конечной точки и ключ, хранящиеся в переменных среды.

import ModelClient from "@azure-rest/ai-inference";

import { isUnexpected } from "@azure-rest/ai-inference";

import { AzureKeyCredential } from "@azure/core-auth";

const client = new ModelClient(

process.env.AZURE_INFERENCE_ENDPOINT,

new AzureKeyCredential(process.env.AZURE_INFERENCE_CREDENTIAL)

);

Если вы настроили ресурс в службу поддержки идентификатора Microsoft Entra, можно использовать следующий фрагмент кода для создания клиента.

import ModelClient from "@azure-rest/ai-inference";

import { isUnexpected } from "@azure-rest/ai-inference";

import { DefaultAzureCredential } from "@azure/identity";

const client = new ModelClient(

process.env.AZURE_INFERENCE_ENDPOINT,

new DefaultAzureCredential()

);

Создание запроса на завершение чата

В следующем примере показано, как создать базовый запрос завершения чата в модель.

var messages = [

{ role: "system", content: "You are a helpful assistant" },

{ role: "user", content: "How many languages are in the world?" },

];

var response = await client.path("/chat/completions").post({

body: {

messages: messages,

}

});

Примечание.

Некоторые модели не поддерживают системные сообщения (role="system"). При использовании API вывода модели искусственного интеллекта Azure системные сообщения переводятся в сообщения пользователей, что является наиболее доступной возможностью. Этот перевод предлагается для удобства, но важно убедиться, что модель выполняет инструкции в системном сообщении с правильным уровнем достоверности.

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

if (isUnexpected(response)) {

throw response.body.error;

}

console.log("Response: ", response.body.choices[0].message.content);

console.log("Model: ", response.body.model);

console.log("Usage:");

console.log("\tPrompt tokens:", response.body.usage.prompt_tokens);

console.log("\tTotal tokens:", response.body.usage.total_tokens);

console.log("\tCompletion tokens:", response.body.usage.completion_tokens);

Response: As of now, it's estimated that there are about 7,000 languages spoken around the world. However, this number can vary as some languages become extinct and new ones develop. It's also important to note that the number of speakers can greatly vary between languages, with some having millions of speakers and others only a few hundred.

Model: mistral-large-2407

Usage:

Prompt tokens: 19

Total tokens: 91

Completion tokens: 72

Просмотрите usage раздел в ответе, чтобы просмотреть количество маркеров, используемых для запроса, общее количество созданных маркеров и количество маркеров, используемых для завершения.

Потоковая передача содержимого

По умолчанию API завершения возвращает все созданное содержимое в одном ответе. Если вы создаете длительные завершения, ожидание ответа может занять много секунд.

Вы можете передавать содержимое, чтобы получить его по мере создания. Потоковая передача содержимого позволяет начать обработку завершения по мере того, как содержимое становится доступным. Этот режим возвращает объект, который передает ответ как события, отправляемые сервером только для данных. Извлеките блоки из разностного поля, а не поля сообщения.

Для потоковой передачи завершений используйте .asNodeStream() при вызове модели.

var messages = [

{ role: "system", content: "You are a helpful assistant" },

{ role: "user", content: "How many languages are in the world?" },

];

var response = await client.path("/chat/completions").post({

body: {

messages: messages,

}

}).asNodeStream();

Вы можете визуализировать, как потоковая передача создает содержимое:

var stream = response.body;

if (!stream) {

stream.destroy();

throw new Error(`Failed to get chat completions with status: ${response.status}`);

}

if (response.status !== "200") {

throw new Error(`Failed to get chat completions: ${response.body.error}`);

}

var sses = createSseStream(stream);

for await (const event of sses) {

if (event.data === "[DONE]") {

return;

}

for (const choice of (JSON.parse(event.data)).choices) {

console.log(choice.delta?.content ?? "");

}

}

Дополнительные параметры, поддерживаемые клиентом вывода

Изучите другие параметры, которые можно указать в клиенте вывода. Полный список всех поддерживаемых параметров и их соответствующей документации см . в справочнике по API вывода модели ИИ Azure.

var messages = [

{ role: "system", content: "You are a helpful assistant" },

{ role: "user", content: "How many languages are in the world?" },

];

var response = await client.path("/chat/completions").post({

body: {

messages: messages,

presence_penalty: "0.1",

frequency_penalty: "0.8",

max_tokens: 2048,

stop: ["<|endoftext|>"],

temperature: 0,

top_p: 1,

response_format: { type: "text" },

}

});

Некоторые модели не поддерживают форматирование выходных данных JSON. Вы всегда можете запрашивать модель для создания выходных данных JSON. Однако такие выходные данные не гарантируют допустимости JSON.

Если вы хотите передать параметр, который отсутствует в списке поддерживаемых параметров, его можно передать в базовую модель с помощью дополнительных параметров. Дополнительные параметры см. в разделе "Передача дополнительных параметров в модель".

Создание выходных данных JSON

Некоторые модели могут создавать выходные данные JSON. Установите response_format для json_object включения режима JSON и гарантирует, что создается сообщение, которое создает модель, является допустимым JSON. Кроме того, необходимо указать модели, чтобы создать JSON самостоятельно с помощью системного или пользовательского сообщения. Кроме того, содержимое сообщения может быть частично отрезано, если finish_reason="length"это означает, что превышено поколение max_tokens или что беседа превысила максимальную длину контекста.

var messages = [

{ role: "system", content: "You are a helpful assistant that always generate responses in JSON format, using."

+ " the following format: { \"answer\": \"response\" }." },

{ role: "user", content: "How many languages are in the world?" },

];

var response = await client.path("/chat/completions").post({

body: {

messages: messages,

response_format: { type: "json_object" }

}

});

Передача дополнительных параметров модели

API вывода модели ИИ Azure позволяет передавать дополнительные параметры модели в модель. В следующем примере кода показано, как передать дополнительный параметр logprobs модели.

var messages = [

{ role: "system", content: "You are a helpful assistant" },

{ role: "user", content: "How many languages are in the world?" },

];

var response = await client.path("/chat/completions").post({

headers: {

"extra-params": "pass-through"

},

body: {

messages: messages,

logprobs: true

}

});

Перед передачей дополнительных параметров в API вывода модели ИИ Azure убедитесь, что ваша модель поддерживает эти дополнительные параметры. Когда запрос выполняется в базовую модель, заголовок extra-parameters передается модели со значением pass-through. Это значение указывает конечной точке передавать дополнительные параметры модели. Использование дополнительных параметров с моделью не гарантирует, что модель может фактически обрабатывать их. Ознакомьтесь с документацией по модели, чтобы понять, какие дополнительные параметры поддерживаются.

Использование средств

Некоторые модели поддерживают использование инструментов, которые могут быть чрезвычайным ресурсом, когда необходимо выгрузить конкретные задачи из языковой модели и вместо этого полагаться на более детерминированную систему или даже другую языковую модель. API вывода модели ИИ Azure позволяет определить средства следующим образом.

В следующем примере кода создается определение средства, которое может искать сведения о полете из двух разных городов.

const flight_info = {

name: "get_flight_info",

description: "Returns information about the next flight between two cities. This includes the name of the airline, flight number and the date and time of the next flight",

parameters: {

type: "object",

properties: {

origin_city: {

type: "string",

description: "The name of the city where the flight originates",

},

destination_city: {

type: "string",

description: "The flight destination city",

},

},

required: ["origin_city", "destination_city"],

},

}

const tools = [

{

type: "function",

function: flight_info,

},

];

В этом примере выходные данные функции заключается в том, что для выбранного маршрута нет рейсов, но пользователь должен рассмотреть вопрос о принятии поезда.

function get_flight_info(loc_origin, loc_destination) {

return {

info: "There are no flights available from " + loc_origin + " to " + loc_destination + ". You should take a train, specially if it helps to reduce CO2 emissions."

}

}

Примечание.

Для моделей cohere требуется, чтобы ответы средства были допустимыми содержимым JSON, отформатированными в виде строки. При создании сообщений типа Tool убедитесь, что ответ является допустимой строкой JSON.

Предложите модели забронировать рейсы с помощью этой функции:

var result = await client.path("/chat/completions").post({

body: {

messages: messages,

tools: tools,

tool_choice: "auto"

}

});

Вы можете проверить ответ, чтобы узнать, нужно ли вызывать средство. Проверьте причину завершения, чтобы определить, следует ли вызывать средство. Помните, что можно указать несколько типов инструментов. В этом примере показан инструмент типа function.

const response_message = response.body.choices[0].message;

const tool_calls = response_message.tool_calls;

console.log("Finish reason: " + response.body.choices[0].finish_reason);

console.log("Tool call: " + tool_calls);

Чтобы продолжить, добавьте это сообщение в журнал чата:

messages.push(response_message);

Теперь пришло время вызвать соответствующую функцию для обработки вызова средства. Следующий фрагмент кода выполняет итерацию всех вызовов инструментов, указанных в ответе, и вызывает соответствующую функцию с соответствующими параметрами. Ответ также добавляется в журнал чата.

function applyToolCall({ function: call, id }) {

// Get the tool details:

const tool_params = JSON.parse(call.arguments);

console.log("Calling function " + call.name + " with arguments " + tool_params);

// Call the function defined above using `window`, which returns the list of all functions

// available in the scope as a dictionary. Notice that this is just done as a simple way to get

// the function callable from its string name. Then we can call it with the corresponding

// arguments.

const function_response = tool_params.map(window[call.name]);

console.log("-> " + function_response);

return function_response

}

for (const tool_call of tool_calls) {

var tool_response = tool_call.apply(applyToolCall);

messages.push(

{

role: "tool",

tool_call_id: tool_call.id,

content: tool_response

}

);

}

Просмотрите ответ модели:

var result = await client.path("/chat/completions").post({

body: {

messages: messages,

tools: tools,

}

});

Применение безопасности содержимого

API вывода модели ИИ Azure поддерживает безопасность содержимого ИИ Azure. При использовании развертываний с включенной безопасностью содержимого искусственного интеллекта Azure входные и выходные данные проходят через ансамбль моделей классификации, направленных на обнаружение и предотвращение вывода вредного содержимого. Система фильтрации содержимого обнаруживает и принимает меры по определенным категориям потенциально вредного содержимого как в запросах ввода, так и в завершении выходных данных.

В следующем примере показано, как обрабатывать события, когда модель обнаруживает вредное содержимое во входном запросе и включена безопасность содержимого.

try {

var messages = [

{ role: "system", content: "You are an AI assistant that helps people find information." },

{ role: "user", content: "Chopping tomatoes and cutting them into cubes or wedges are great ways to practice your knife skills." },

];

var response = await client.path("/chat/completions").post({

body: {

messages: messages,

}

});

console.log(response.body.choices[0].message.content);

}

catch (error) {

if (error.status_code == 400) {

var response = JSON.parse(error.response._content);

if (response.error) {

console.log(`Your request triggered an ${response.error.code} error:\n\t ${response.error.message}`);

}

else

{

throw error;

}

}

}

Совет

Дополнительные сведения о настройке и управлении параметрами безопасности содержимого ИИ Azure см. в документации по безопасности содержимого ИИ Azure.

Использование завершения чата с изображениями

Некоторые модели могут вызывать текст и изображения и создавать завершения текста на основе обоих типов входных данных. В этом разделе описаны возможности некоторых моделей для визуального зрения в чате:

Внимание

Некоторые модели поддерживают только одно изображение для каждого поворота беседы в чате, и только последний образ сохраняется в контексте. При добавлении нескольких изображений это приведет к ошибке.

Чтобы увидеть эту возможность, скачайте изображение и закодируйте сведения в виде base64 строки. Полученные данные должны находиться внутри URL-адреса данных:

const image_url = "https://news.microsoft.com/source/wp-content/uploads/2024/04/The-Phi-3-small-language-models-with-big-potential-1-1900x1069.jpg";

const image_format = "jpeg";

const response = await fetch(image_url, { headers: { "User-Agent": "Mozilla/5.0" } });

const image_data = await response.arrayBuffer();

const image_data_base64 = Buffer.from(image_data).toString("base64");

const data_url = `data:image/${image_format};base64,${image_data_base64}`;

Визуализировать изображение:

const img = document.createElement("img");

img.src = data_url;

document.body.appendChild(img);

Теперь создайте запрос на завершение чата с изображением:

var messages = [

{ role: "system", content: "You are a helpful assistant that can generate responses based on images." },

{ role: "user", content:

[

{ type: "text", text: "Which conclusion can be extracted from the following chart?" },

{ type: "image_url", image:

{

url: data_url

}

}

]

}

];

var response = await client.path("/chat/completions").post({

body: {

messages: messages,

temperature: 0,

top_p: 1,

max_tokens: 2048,

}

});

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

console.log(response.body.choices[0].message.role + ": " + response.body.choices[0].message.content);

console.log("Model:", response.body.model);

console.log("Usage:");

console.log("\tPrompt tokens:", response.body.usage.prompt_tokens);

console.log("\tCompletion tokens:", response.body.usage.completion_tokens);

console.log("\tTotal tokens:", response.body.usage.total_tokens);

ASSISTANT: The chart illustrates that larger models tend to perform better in quality, as indicated by their size in billions of parameters. However, there are exceptions to this trend, such as Phi-3-medium and Phi-3-small, which outperform smaller models in quality. This suggests that while larger models generally have an advantage, there might be other factors at play that influence a model's performance.

Model: mistral-large-2407

Usage:

Prompt tokens: 2380

Completion tokens: 126

Total tokens: 2506

Внимание

Элементы, обозначенные в этой статье как (предварительная версия), сейчас предлагаются в общедоступной предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Дополнительные сведения см. в статье Дополнительные условия использования Предварительных версий Microsoft Azure.

В этой статье объясняется, как использовать API завершения чата с моделями, развернутыми в модели ИИ Azure в службах ИИ Azure.

Необходимые компоненты

Чтобы использовать модели завершения чата в приложении, вам потребуется:

Подписка Azure. Если вы используете модели GitHub, вы можете обновить интерфейс и создать подписку Azure в процессе. Ознакомьтесь с обновлением моделей GitHub до модели ИИ Azure, если это ваше дело.

Ресурс служб ИИ Azure. Дополнительные сведения см. в статье "Создание ресурса Служб искусственного интеллекта Azure".

URL-адрес конечной точки и ключ.

Развертывание модели завершения чата. Если у вас нет одного чтения "Добавить и настроить модели" в службы ИИ Azure для добавления модели завершения чата в ресурс.

Добавьте пакет вывода искусственного интеллекта Azure в проект:

<dependency> <groupId>com.azure</groupId> <artifactId>azure-ai-inference</artifactId> <version>1.0.0-beta.1</version> </dependency>Совет

Дополнительные сведения о пакете вывода и справочнике по выводу искусственного интеллекта Azure.

Если вы используете идентификатор Записи, вам также потребуется следующий пакет:

<dependency> <groupId>com.azure</groupId> <artifactId>azure-identity</artifactId> <version>1.13.3</version> </dependency>Импортируйте следующее пространство имен:

package com.azure.ai.inference.usage; import com.azure.ai.inference.EmbeddingsClient; import com.azure.ai.inference.EmbeddingsClientBuilder; import com.azure.ai.inference.models.EmbeddingsResult; import com.azure.ai.inference.models.EmbeddingItem; import com.azure.core.credential.AzureKeyCredential; import com.azure.core.util.Configuration; import java.util.ArrayList; import java.util.List;

Использование завершения чата

Сначала создайте клиент для использования модели. В следующем коде используется URL-адрес конечной точки и ключ, хранящиеся в переменных среды.

Если вы настроили ресурс в службу поддержки идентификатора Microsoft Entra, можно использовать следующий фрагмент кода для создания клиента.

Создание запроса на завершение чата

В следующем примере показано, как создать базовый запрос завершения чата в модель.

Примечание.

Некоторые модели не поддерживают системные сообщения (role="system"). При использовании API вывода модели искусственного интеллекта Azure системные сообщения переводятся в сообщения пользователей, что является наиболее доступной возможностью. Этот перевод предлагается для удобства, но важно убедиться, что модель выполняет инструкции в системном сообщении с правильным уровнем достоверности.

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

Response: As of now, it's estimated that there are about 7,000 languages spoken around the world. However, this number can vary as some languages become extinct and new ones develop. It's also important to note that the number of speakers can greatly vary between languages, with some having millions of speakers and others only a few hundred.

Model: mistral-large-2407

Usage:

Prompt tokens: 19

Total tokens: 91

Completion tokens: 72

Просмотрите usage раздел в ответе, чтобы просмотреть количество маркеров, используемых для запроса, общее количество созданных маркеров и количество маркеров, используемых для завершения.

Потоковая передача содержимого

По умолчанию API завершения возвращает все созданное содержимое в одном ответе. Если вы создаете длительные завершения, ожидание ответа может занять много секунд.

Вы можете передавать содержимое, чтобы получить его по мере создания. Потоковая передача содержимого позволяет начать обработку завершения по мере того, как содержимое становится доступным. Этот режим возвращает объект, который передает ответ как события, отправляемые сервером только для данных. Извлеките блоки из разностного поля, а не поля сообщения.

Вы можете визуализировать, как потоковая передача создает содержимое:

Дополнительные параметры, поддерживаемые клиентом вывода

Изучите другие параметры, которые можно указать в клиенте вывода. Полный список всех поддерживаемых параметров и их соответствующей документации см . в справочнике по API вывода модели ИИ Azure. Некоторые модели не поддерживают форматирование выходных данных JSON. Вы всегда можете запрашивать модель для создания выходных данных JSON. Однако такие выходные данные не гарантируют допустимости JSON.

Если вы хотите передать параметр, который отсутствует в списке поддерживаемых параметров, его можно передать в базовую модель с помощью дополнительных параметров. Дополнительные параметры см. в разделе "Передача дополнительных параметров в модель".

Создание выходных данных JSON

Некоторые модели могут создавать выходные данные JSON. Установите response_format для json_object включения режима JSON и гарантирует, что создается сообщение, которое создает модель, является допустимым JSON. Кроме того, необходимо указать модели, чтобы создать JSON самостоятельно с помощью системного или пользовательского сообщения. Кроме того, содержимое сообщения может быть частично отрезано, если finish_reason="length"это означает, что превышено поколение max_tokens или что беседа превысила максимальную длину контекста.

Передача дополнительных параметров модели

API вывода модели ИИ Azure позволяет передавать дополнительные параметры модели в модель. В следующем примере кода показано, как передать дополнительный параметр logprobs модели.

Перед передачей дополнительных параметров в API вывода модели ИИ Azure убедитесь, что ваша модель поддерживает эти дополнительные параметры. Когда запрос выполняется в базовую модель, заголовок extra-parameters передается модели со значением pass-through. Это значение указывает конечной точке передавать дополнительные параметры модели. Использование дополнительных параметров с моделью не гарантирует, что модель может фактически обрабатывать их. Ознакомьтесь с документацией по модели, чтобы понять, какие дополнительные параметры поддерживаются.

Использование средств

Некоторые модели поддерживают использование инструментов, которые могут быть чрезвычайным ресурсом, когда необходимо выгрузить конкретные задачи из языковой модели и вместо этого полагаться на более детерминированную систему или даже другую языковую модель. API вывода модели ИИ Azure позволяет определить средства следующим образом.

В следующем примере кода создается определение средства, которое может искать сведения о полете из двух разных городов.

В этом примере выходные данные функции заключается в том, что для выбранного маршрута нет рейсов, но пользователь должен рассмотреть вопрос о принятии поезда.

Примечание.

Для моделей cohere требуется, чтобы ответы средства были допустимыми содержимым JSON, отформатированными в виде строки. При создании сообщений типа Tool убедитесь, что ответ является допустимой строкой JSON.

Предложите модели забронировать рейсы с помощью этой функции:

Вы можете проверить ответ, чтобы узнать, нужно ли вызывать средство. Проверьте причину завершения, чтобы определить, следует ли вызывать средство. Помните, что можно указать несколько типов инструментов. В этом примере показан инструмент типа function.

Чтобы продолжить, добавьте это сообщение в журнал чата:

Теперь пришло время вызвать соответствующую функцию для обработки вызова средства. Следующий фрагмент кода выполняет итерацию всех вызовов инструментов, указанных в ответе, и вызывает соответствующую функцию с соответствующими параметрами. Ответ также добавляется в журнал чата.

Просмотрите ответ модели:

Применение безопасности содержимого

API вывода модели ИИ Azure поддерживает безопасность содержимого ИИ Azure. При использовании развертываний с включенной безопасностью содержимого искусственного интеллекта Azure входные и выходные данные проходят через ансамбль моделей классификации, направленных на обнаружение и предотвращение вывода вредного содержимого. Система фильтрации содержимого обнаруживает и принимает меры по определенным категориям потенциально вредного содержимого как в запросах ввода, так и в завершении выходных данных.

В следующем примере показано, как обрабатывать события, когда модель обнаруживает вредное содержимое во входном запросе и включена безопасность содержимого.

Совет

Дополнительные сведения о настройке и управлении параметрами безопасности содержимого ИИ Azure см. в документации по безопасности содержимого ИИ Azure.

Использование завершения чата с изображениями

Некоторые модели могут вызывать текст и изображения и создавать завершения текста на основе обоих типов входных данных. В этом разделе описаны возможности некоторых моделей для визуального зрения в чате:

Внимание

Некоторые модели поддерживают только одно изображение для каждого поворота беседы в чате, и только последний образ сохраняется в контексте. При добавлении нескольких изображений это приведет к ошибке.

Чтобы увидеть эту возможность, скачайте изображение и закодируйте сведения в виде base64 строки. Полученные данные должны находиться внутри URL-адреса данных:

Визуализировать изображение:

Теперь создайте запрос на завершение чата с изображением:

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

ASSISTANT: The chart illustrates that larger models tend to perform better in quality, as indicated by their size in billions of parameters. However, there are exceptions to this trend, such as Phi-3-medium and Phi-3-small, which outperform smaller models in quality. This suggests that while larger models generally have an advantage, there might be other factors at play that influence a model's performance.

Model: mistral-large-2407

Usage:

Prompt tokens: 2380

Completion tokens: 126

Total tokens: 2506

Внимание

Элементы, обозначенные в этой статье как (предварительная версия), сейчас предлагаются в общедоступной предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Дополнительные сведения см. в статье Дополнительные условия использования Предварительных версий Microsoft Azure.

В этой статье объясняется, как использовать API завершения чата с моделями, развернутыми в модели ИИ Azure в службах ИИ Azure.

Необходимые компоненты

Чтобы использовать модели завершения чата в приложении, вам потребуется:

Подписка Azure. Если вы используете модели GitHub, вы можете обновить интерфейс и создать подписку Azure в процессе. Ознакомьтесь с обновлением моделей GitHub до модели ИИ Azure, если это ваше дело.

Ресурс служб ИИ Azure. Дополнительные сведения см. в статье "Создание ресурса Служб искусственного интеллекта Azure".

URL-адрес конечной точки и ключ.

Развертывание модели завершения чата. Если у вас нет одного чтения "Добавить и настроить модели" в службы ИИ Azure для добавления модели завершения чата в ресурс.

Установите пакет вывода искусственного интеллекта Azure с помощью следующей команды:

dotnet add package Azure.AI.Inference --prereleaseСовет

Дополнительные сведения о пакете вывода и справочнике по выводу искусственного интеллекта Azure.

Если вы используете идентификатор Записи, вам также потребуется следующий пакет:

dotnet add package Azure.Identity

Использование завершения чата

Сначала создайте клиент для использования модели. В следующем коде используется URL-адрес конечной точки и ключ, хранящиеся в переменных среды.

ChatCompletionsClient client = new ChatCompletionsClient(

new Uri(Environment.GetEnvironmentVariable("AZURE_INFERENCE_ENDPOINT")),

new AzureKeyCredential(Environment.GetEnvironmentVariable("AZURE_INFERENCE_CREDENTIAL")),

"mistral-large-2407"

);

Если вы настроили ресурс в службу поддержки идентификатора Microsoft Entra, можно использовать следующий фрагмент кода для создания клиента.

client = new ChatCompletionsClient(

new Uri(Environment.GetEnvironmentVariable("AZURE_INFERENCE_ENDPOINT")),

new DefaultAzureCredential(includeInteractiveCredentials: true),

"mistral-large-2407"

);

Создание запроса на завершение чата

В следующем примере показано, как создать базовый запрос завершения чата в модель.

ChatCompletionsOptions requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage("You are a helpful assistant."),

new ChatRequestUserMessage("How many languages are in the world?")

},

};

Response<ChatCompletions> response = client.Complete(requestOptions);

Примечание.

Некоторые модели не поддерживают системные сообщения (role="system"). При использовании API вывода модели искусственного интеллекта Azure системные сообщения переводятся в сообщения пользователей, что является наиболее доступной возможностью. Этот перевод предлагается для удобства, но важно убедиться, что модель выполняет инструкции в системном сообщении с правильным уровнем достоверности.

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

Console.WriteLine($"Response: {response.Value.Content}");

Console.WriteLine($"Model: {response.Value.Model}");

Console.WriteLine("Usage:");

Console.WriteLine($"\tPrompt tokens: {response.Value.Usage.PromptTokens}");

Console.WriteLine($"\tTotal tokens: {response.Value.Usage.TotalTokens}");

Console.WriteLine($"\tCompletion tokens: {response.Value.Usage.CompletionTokens}");

Response: As of now, it's estimated that there are about 7,000 languages spoken around the world. However, this number can vary as some languages become extinct and new ones develop. It's also important to note that the number of speakers can greatly vary between languages, with some having millions of speakers and others only a few hundred.

Model: mistral-large-2407

Usage:

Prompt tokens: 19

Total tokens: 91

Completion tokens: 72

Просмотрите usage раздел в ответе, чтобы просмотреть количество маркеров, используемых для запроса, общее количество созданных маркеров и количество маркеров, используемых для завершения.

Потоковая передача содержимого

По умолчанию API завершения возвращает все созданное содержимое в одном ответе. Если вы создаете длительные завершения, ожидание ответа может занять много секунд.

Вы можете передавать содержимое, чтобы получить его по мере создания. Потоковая передача содержимого позволяет начать обработку завершения по мере того, как содержимое становится доступным. Этот режим возвращает объект, который передает ответ как события, отправляемые сервером только для данных. Извлеките блоки из разностного поля, а не поля сообщения.

Для потоковой передачи завершения используйте CompleteStreamingAsync метод при вызове модели. Обратите внимание, что в этом примере вызов упаковывается в асинхронный метод.

static async Task StreamMessageAsync(ChatCompletionsClient client)

{

ChatCompletionsOptions requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage("You are a helpful assistant."),

new ChatRequestUserMessage("How many languages are in the world? Write an essay about it.")

},

MaxTokens=4096

};

StreamingResponse<StreamingChatCompletionsUpdate> streamResponse = await client.CompleteStreamingAsync(requestOptions);

await PrintStream(streamResponse);

}

Чтобы визуализировать выходные данные, определите асинхронный метод для печати потока в консоли.

static async Task PrintStream(StreamingResponse<StreamingChatCompletionsUpdate> response)

{

await foreach (StreamingChatCompletionsUpdate chatUpdate in response)

{

if (chatUpdate.Role.HasValue)

{

Console.Write($"{chatUpdate.Role.Value.ToString().ToUpperInvariant()}: ");

}

if (!string.IsNullOrEmpty(chatUpdate.ContentUpdate))

{

Console.Write(chatUpdate.ContentUpdate);

}

}

}

Вы можете визуализировать, как потоковая передача создает содержимое:

StreamMessageAsync(client).GetAwaiter().GetResult();

Дополнительные параметры, поддерживаемые клиентом вывода

Изучите другие параметры, которые можно указать в клиенте вывода. Полный список всех поддерживаемых параметров и их соответствующей документации см . в справочнике по API вывода модели ИИ Azure.

requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage("You are a helpful assistant."),

new ChatRequestUserMessage("How many languages are in the world?")

},

PresencePenalty = 0.1f,

FrequencyPenalty = 0.8f,

MaxTokens = 2048,

StopSequences = { "<|endoftext|>" },

Temperature = 0,

NucleusSamplingFactor = 1,

ResponseFormat = new ChatCompletionsResponseFormatText()

};

response = client.Complete(requestOptions);

Console.WriteLine($"Response: {response.Value.Content}");

Некоторые модели не поддерживают форматирование выходных данных JSON. Вы всегда можете запрашивать модель для создания выходных данных JSON. Однако такие выходные данные не гарантируют допустимости JSON.

Если вы хотите передать параметр, который отсутствует в списке поддерживаемых параметров, его можно передать в базовую модель с помощью дополнительных параметров. Дополнительные параметры см. в разделе "Передача дополнительных параметров в модель".

Создание выходных данных JSON

Некоторые модели могут создавать выходные данные JSON. Установите response_format для json_object включения режима JSON и гарантирует, что создается сообщение, которое создает модель, является допустимым JSON. Кроме того, необходимо указать модели, чтобы создать JSON самостоятельно с помощью системного или пользовательского сообщения. Кроме того, содержимое сообщения может быть частично отрезано, если finish_reason="length"это означает, что превышено поколение max_tokens или что беседа превысила максимальную длину контекста.

requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage(

"You are a helpful assistant that always generate responses in JSON format, " +

"using. the following format: { \"answer\": \"response\" }."

),

new ChatRequestUserMessage(

"How many languages are in the world?"

)

},

ResponseFormat = new ChatCompletionsResponseFormatJSON()

};

response = client.Complete(requestOptions);

Console.WriteLine($"Response: {response.Value.Content}");

Передача дополнительных параметров модели

API вывода модели ИИ Azure позволяет передавать дополнительные параметры модели в модель. В следующем примере кода показано, как передать дополнительный параметр logprobs модели.

requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage("You are a helpful assistant."),

new ChatRequestUserMessage("How many languages are in the world?")

},

AdditionalProperties = { { "logprobs", BinaryData.FromString("true") } },

};

response = client.Complete(requestOptions, extraParams: ExtraParameters.PassThrough);

Console.WriteLine($"Response: {response.Value.Content}");

Перед передачей дополнительных параметров в API вывода модели ИИ Azure убедитесь, что ваша модель поддерживает эти дополнительные параметры. Когда запрос выполняется в базовую модель, заголовок extra-parameters передается модели со значением pass-through. Это значение указывает конечной точке передавать дополнительные параметры модели. Использование дополнительных параметров с моделью не гарантирует, что модель может фактически обрабатывать их. Ознакомьтесь с документацией по модели, чтобы понять, какие дополнительные параметры поддерживаются.

Использование средств

Некоторые модели поддерживают использование инструментов, которые могут быть чрезвычайным ресурсом, когда необходимо выгрузить конкретные задачи из языковой модели и вместо этого полагаться на более детерминированную систему или даже другую языковую модель. API вывода модели ИИ Azure позволяет определить средства следующим образом.

В следующем примере кода создается определение средства, которое может искать сведения о полете из двух разных городов.

FunctionDefinition flightInfoFunction = new FunctionDefinition("getFlightInfo")

{

Description = "Returns information about the next flight between two cities. This includes the name of the airline, flight number and the date and time of the next flight",

Parameters = BinaryData.FromObjectAsJson(new

{

Type = "object",

Properties = new

{

origin_city = new

{

Type = "string",

Description = "The name of the city where the flight originates"

},

destination_city = new

{

Type = "string",

Description = "The flight destination city"

}

}

},

new JsonSerializerOptions() { PropertyNamingPolicy = JsonNamingPolicy.CamelCase }

)

};

ChatCompletionsFunctionToolDefinition getFlightTool = new ChatCompletionsFunctionToolDefinition(flightInfoFunction);

В этом примере выходные данные функции заключается в том, что для выбранного маршрута нет рейсов, но пользователь должен рассмотреть вопрос о принятии поезда.

static string getFlightInfo(string loc_origin, string loc_destination)

{

return JsonSerializer.Serialize(new

{

info = $"There are no flights available from {loc_origin} to {loc_destination}. You " +

"should take a train, specially if it helps to reduce CO2 emissions."

});

}

Примечание.

Для моделей cohere требуется, чтобы ответы средства были допустимыми содержимым JSON, отформатированными в виде строки. При создании сообщений типа Tool убедитесь, что ответ является допустимой строкой JSON.

Предложите модели забронировать рейсы с помощью этой функции:

var chatHistory = new List<ChatRequestMessage>(){

new ChatRequestSystemMessage(

"You are a helpful assistant that help users to find information about traveling, " +

"how to get to places and the different transportations options. You care about the" +

"environment and you always have that in mind when answering inqueries."

),

new ChatRequestUserMessage("When is the next flight from Miami to Seattle?")

};

requestOptions = new ChatCompletionsOptions(chatHistory);

requestOptions.Tools.Add(getFlightTool);

requestOptions.ToolChoice = ChatCompletionsToolChoice.Auto;

response = client.Complete(requestOptions);

Вы можете проверить ответ, чтобы узнать, нужно ли вызывать средство. Проверьте причину завершения, чтобы определить, следует ли вызывать средство. Помните, что можно указать несколько типов инструментов. В этом примере показан инструмент типа function.

var responseMessage = response.Value;

var toolsCall = responseMessage.ToolCalls;

Console.WriteLine($"Finish reason: {response.Value.Choices[0].FinishReason}");

Console.WriteLine($"Tool call: {toolsCall[0].Id}");

Чтобы продолжить, добавьте это сообщение в журнал чата:

requestOptions.Messages.Add(new ChatRequestAssistantMessage(response.Value));

Теперь пришло время вызвать соответствующую функцию для обработки вызова средства. Следующий фрагмент кода выполняет итерацию всех вызовов инструментов, указанных в ответе, и вызывает соответствующую функцию с соответствующими параметрами. Ответ также добавляется в журнал чата.

foreach (ChatCompletionsToolCall tool in toolsCall)

{

if (tool is ChatCompletionsFunctionToolCall functionTool)

{

// Get the tool details:

string callId = functionTool.Id;

string toolName = functionTool.Name;

string toolArgumentsString = functionTool.Arguments;

Dictionary<string, object> toolArguments = JsonSerializer.Deserialize<Dictionary<string, object>>(toolArgumentsString);

// Here you have to call the function defined. In this particular example we use

// reflection to find the method we definied before in an static class called

// `ChatCompletionsExamples`. Using reflection allows us to call a function

// by string name. Notice that this is just done for demonstration purposes as a

// simple way to get the function callable from its string name. Then we can call

// it with the corresponding arguments.

var flags = BindingFlags.Instance | BindingFlags.Public | BindingFlags.NonPublic | BindingFlags.Static;

string toolResponse = (string)typeof(ChatCompletionsExamples).GetMethod(toolName, flags).Invoke(null, toolArguments.Values.Cast<object>().ToArray());

Console.WriteLine("->", toolResponse);

requestOptions.Messages.Add(new ChatRequestToolMessage(toolResponse, callId));

}

else

throw new Exception("Unsupported tool type");

}

Просмотрите ответ модели:

response = client.Complete(requestOptions);

Применение безопасности содержимого

API вывода модели ИИ Azure поддерживает безопасность содержимого ИИ Azure. При использовании развертываний с включенной безопасностью содержимого искусственного интеллекта Azure входные и выходные данные проходят через ансамбль моделей классификации, направленных на обнаружение и предотвращение вывода вредного содержимого. Система фильтрации содержимого обнаруживает и принимает меры по определенным категориям потенциально вредного содержимого как в запросах ввода, так и в завершении выходных данных.

В следующем примере показано, как обрабатывать события, когда модель обнаруживает вредное содержимое во входном запросе и включена безопасность содержимого.

try

{

requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage("You are an AI assistant that helps people find information."),

new ChatRequestUserMessage(

"Chopping tomatoes and cutting them into cubes or wedges are great ways to practice your knife skills."

),

},

};

response = client.Complete(requestOptions);

Console.WriteLine(response.Value.Content);

}

catch (RequestFailedException ex)

{

if (ex.ErrorCode == "content_filter")

{

Console.WriteLine($"Your query has trigger Azure Content Safety: {ex.Message}");

}

else

{

throw;

}

}

Совет

Дополнительные сведения о настройке и управлении параметрами безопасности содержимого ИИ Azure см. в документации по безопасности содержимого ИИ Azure.

Использование завершения чата с изображениями

Некоторые модели могут вызывать текст и изображения и создавать завершения текста на основе обоих типов входных данных. В этом разделе описаны возможности некоторых моделей для визуального зрения в чате:

Внимание

Некоторые модели поддерживают только одно изображение для каждого поворота беседы в чате, и только последний образ сохраняется в контексте. При добавлении нескольких изображений это приведет к ошибке.

Чтобы увидеть эту возможность, скачайте изображение и закодируйте сведения в виде base64 строки. Полученные данные должны находиться внутри URL-адреса данных:

string imageUrl = "https://news.microsoft.com/source/wp-content/uploads/2024/04/The-Phi-3-small-language-models-with-big-potential-1-1900x1069.jpg";

string imageFormat = "jpeg";

HttpClient httpClient = new HttpClient();

httpClient.DefaultRequestHeaders.Add("User-Agent", "Mozilla/5.0");

byte[] imageBytes = httpClient.GetByteArrayAsync(imageUrl).Result;

string imageBase64 = Convert.ToBase64String(imageBytes);

string dataUrl = $"data:image/{imageFormat};base64,{imageBase64}";

Визуализировать изображение:

Теперь создайте запрос на завершение чата с изображением:

ChatCompletionsOptions requestOptions = new ChatCompletionsOptions()

{

Messages = {

new ChatRequestSystemMessage("You are an AI assistant that helps people find information."),

new ChatRequestUserMessage([

new ChatMessageTextContentItem("Which conclusion can be extracted from the following chart?"),

new ChatMessageImageContentItem(new Uri(dataUrl))

]),

},

MaxTokens=2048,

};

var response = client.Complete(requestOptions);

Console.WriteLine(response.Value.Content);

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

Console.WriteLine($"{response.Value.Role}: {response.Value.Content}");

Console.WriteLine($"Model: {response.Value.Model}");

Console.WriteLine("Usage:");

Console.WriteLine($"\tPrompt tokens: {response.Value.Usage.PromptTokens}");

Console.WriteLine($"\tTotal tokens: {response.Value.Usage.TotalTokens}");

Console.WriteLine($"\tCompletion tokens: {response.Value.Usage.CompletionTokens}");

ASSISTANT: The chart illustrates that larger models tend to perform better in quality, as indicated by their size in billions of parameters. However, there are exceptions to this trend, such as Phi-3-medium and Phi-3-small, which outperform smaller models in quality. This suggests that while larger models generally have an advantage, there might be other factors at play that influence a model's performance.

Model: mistral-large-2407

Usage:

Prompt tokens: 2380

Completion tokens: 126

Total tokens: 2506

Внимание

Элементы, обозначенные в этой статье как (предварительная версия), сейчас предлагаются в общедоступной предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Дополнительные сведения см. в статье Дополнительные условия использования Предварительных версий Microsoft Azure.

В этой статье объясняется, как использовать API завершения чата с моделями, развернутыми в модели ИИ Azure в службах ИИ Azure.

Необходимые компоненты

Чтобы использовать модели завершения чата в приложении, вам потребуется:

Подписка Azure. Если вы используете модели GitHub, вы можете обновить интерфейс и создать подписку Azure в процессе. Ознакомьтесь с обновлением моделей GitHub до модели ИИ Azure, если это ваше дело.

Ресурс служб ИИ Azure. Дополнительные сведения см. в статье "Создание ресурса Служб искусственного интеллекта Azure".

URL-адрес конечной точки и ключ.

- Развертывание модели завершения чата. Если у вас нет одного чтения "Добавить и настроить модели" в службы ИИ Azure для добавления модели завершения чата в ресурс.

Использование завершения чата

Чтобы использовать внедренные тексты, используйте маршрут /chat/completions , добавленный к базовому URL-адресу, а также учетные данные, указанные в api-key.

Authorization Заголовок также поддерживается в формате Bearer <key>.

POST https://<resource>.services.ai.azure.com/models/chat/completions?api-version=2024-05-01-preview

Content-Type: application/json

api-key: <key>

Если вы настроили ресурс с поддержкой идентификатора Microsoft Entra, передайте маркер в заголовке Authorization :

POST https://<resource>.services.ai.azure.com/models/chat/completions?api-version=2024-05-01-preview

Content-Type: application/json

Authorization: Bearer <token>

Создание запроса на завершение чата

В следующем примере показано, как создать базовый запрос завершения чата в модель.

{

"model": "mistral-large-2407",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "How many languages are in the world?"

}

]

}

Примечание.

Некоторые модели не поддерживают системные сообщения (role="system"). При использовании API вывода модели искусственного интеллекта Azure системные сообщения переводятся в сообщения пользователей, что является наиболее доступной возможностью. Этот перевод предлагается для удобства, но важно убедиться, что модель выполняет инструкции в системном сообщении с правильным уровнем достоверности.

Ответ выглядит следующим образом, где можно просмотреть статистику использования модели:

{

"id": "0a1234b5de6789f01gh2i345j6789klm",

"object": "chat.completion",

"created": 1718726686,

"model": "mistral-large-2407",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "As of now, it's estimated that there are about 7,000 languages spoken around the world. However, this number can vary as some languages become extinct and new ones develop. It's also important to note that the number of speakers can greatly vary between languages, with some having millions of speakers and others only a few hundred.",

"tool_calls": null

},

"finish_reason": "stop",

"logprobs": null

}

],

"usage": {

"prompt_tokens": 19,

"total_tokens": 91,

"completion_tokens": 72

}

}

Просмотрите usage раздел в ответе, чтобы просмотреть количество маркеров, используемых для запроса, общее количество созданных маркеров и количество маркеров, используемых для завершения.

Потоковая передача содержимого

По умолчанию API завершения возвращает все созданное содержимое в одном ответе. Если вы создаете длительные завершения, ожидание ответа может занять много секунд.

Вы можете передавать содержимое, чтобы получить его по мере создания. Потоковая передача содержимого позволяет начать обработку завершения по мере того, как содержимое становится доступным. Этот режим возвращает объект, который передает ответ как события, отправляемые сервером только для данных. Извлеките блоки из разностного поля, а не поля сообщения.

{

"model": "mistral-large-2407",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "How many languages are in the world?"

}

],

"stream": true,

"temperature": 0,

"top_p": 1,

"max_tokens": 2048

}

Вы можете визуализировать, как потоковая передача создает содержимое:

{

"id": "23b54589eba14564ad8a2e6978775a39",

"object": "chat.completion.chunk",

"created": 1718726371,

"model": "mistral-large-2407",

"choices": [

{

"index": 0,

"delta": {

"role": "assistant",

"content": ""

},

"finish_reason": null,

"logprobs": null

}

]

}

Последнее сообщение в потоке установлено finish_reason , указывая причину остановки процесса создания.

{

"id": "23b54589eba14564ad8a2e6978775a39",

"object": "chat.completion.chunk",

"created": 1718726371,

"model": "mistral-large-2407",

"choices": [

{

"index": 0,

"delta": {

"content": ""

},

"finish_reason": "stop",

"logprobs": null

}

],

"usage": {

"prompt_tokens": 19,

"total_tokens": 91,

"completion_tokens": 72

}

}

Дополнительные параметры, поддерживаемые клиентом вывода

Изучите другие параметры, которые можно указать в клиенте вывода. Полный список всех поддерживаемых параметров и их соответствующей документации см . в справочнике по API вывода модели ИИ Azure.

{

"model": "mistral-large-2407",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "How many languages are in the world?"

}

],

"presence_penalty": 0.1,

"frequency_penalty": 0.8,

"max_tokens": 2048,

"stop": ["<|endoftext|>"],

"temperature" :0,

"top_p": 1,

"response_format": { "type": "text" }

}

{

"id": "0a1234b5de6789f01gh2i345j6789klm",

"object": "chat.completion",

"created": 1718726686,

"model": "mistral-large-2407",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "As of now, it's estimated that there are about 7,000 languages spoken around the world. However, this number can vary as some languages become extinct and new ones develop. It's also important to note that the number of speakers can greatly vary between languages, with some having millions of speakers and others only a few hundred.",

"tool_calls": null

},

"finish_reason": "stop",

"logprobs": null

}

],

"usage": {

"prompt_tokens": 19,

"total_tokens": 91,

"completion_tokens": 72

}

}

Некоторые модели не поддерживают форматирование выходных данных JSON. Вы всегда можете запрашивать модель для создания выходных данных JSON. Однако такие выходные данные не гарантируют допустимости JSON.

Если вы хотите передать параметр, который отсутствует в списке поддерживаемых параметров, его можно передать в базовую модель с помощью дополнительных параметров. Дополнительные параметры см. в разделе "Передача дополнительных параметров в модель".

Создание выходных данных JSON

Некоторые модели могут создавать выходные данные JSON. Установите response_format для json_object включения режима JSON и гарантирует, что создается сообщение, которое создает модель, является допустимым JSON. Кроме того, необходимо указать модели, чтобы создать JSON самостоятельно с помощью системного или пользовательского сообщения. Кроме того, содержимое сообщения может быть частично отрезано, если finish_reason="length"это означает, что превышено поколение max_tokens или что беседа превысила максимальную длину контекста.

{

"model": "mistral-large-2407",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant that always generate responses in JSON format, using the following format: { \"answer\": \"response\" }"

},

{

"role": "user",

"content": "How many languages are in the world?"

}

],

"response_format": { "type": "json_object" }

}

{

"id": "0a1234b5de6789f01gh2i345j6789klm",

"object": "chat.completion",

"created": 1718727522,

"model": "mistral-large-2407",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "{\"answer\": \"There are approximately 7,117 living languages in the world today, according to the latest estimates. However, this number can vary as some languages become extinct and others are newly discovered or classified.\"}",

"tool_calls": null

},

"finish_reason": "stop",

"logprobs": null

}

],

"usage": {

"prompt_tokens": 39,

"total_tokens": 87,

"completion_tokens": 48

}

}

Передача дополнительных параметров модели

API вывода модели ИИ Azure позволяет передавать дополнительные параметры модели в модель. В следующем примере кода показано, как передать дополнительный параметр logprobs модели.

POST https://<resource>.services.ai.azure.com/models/chat/completions?api-version=2024-05-01-preview

Authorization: Bearer <TOKEN>

Content-Type: application/json

extra-parameters: pass-through

{

"model": "mistral-large-2407",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "How many languages are in the world?"

}

],

"logprobs": true

}

Перед передачей дополнительных параметров в API вывода модели ИИ Azure убедитесь, что ваша модель поддерживает эти дополнительные параметры. Когда запрос выполняется в базовую модель, заголовок extra-parameters передается модели со значением pass-through. Это значение указывает конечной точке передавать дополнительные параметры модели. Использование дополнительных параметров с моделью не гарантирует, что модель может фактически обрабатывать их. Ознакомьтесь с документацией по модели, чтобы понять, какие дополнительные параметры поддерживаются.

Использование средств

Некоторые модели поддерживают использование инструментов, которые могут быть чрезвычайным ресурсом, когда необходимо выгрузить конкретные задачи из языковой модели и вместо этого полагаться на более детерминированную систему или даже другую языковую модель. API вывода модели ИИ Azure позволяет определить средства следующим образом.

В следующем примере кода создается определение средства, которое может искать сведения о полете из двух разных городов.

{

"type": "function",

"function": {

"name": "get_flight_info",

"description": "Returns information about the next flight between two cities. This includes the name of the airline, flight number and the date and time of the next flight",

"parameters": {

"type": "object",

"properties": {

"origin_city": {

"type": "string",

"description": "The name of the city where the flight originates"

},

"destination_city": {

"type": "string",

"description": "The flight destination city"

}

},

"required": [

"origin_city",

"destination_city"

]

}

}

}

В этом примере выходные данные функции заключается в том, что для выбранного маршрута нет рейсов, но пользователь должен рассмотреть вопрос о принятии поезда.

Примечание.

Для моделей cohere требуется, чтобы ответы средства были допустимыми содержимым JSON, отформатированными в виде строки. При создании сообщений типа Tool убедитесь, что ответ является допустимой строкой JSON.

Предложите модели забронировать рейсы с помощью этой функции:

{

"model": "mistral-large-2407",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant that help users to find information about traveling, how to get to places and the different transportations options. You care about the environment and you always have that in mind when answering inqueries"

},

{

"role": "user",