Instalar e executar contêineres personalizados de Reconhecimento de Entidade Nomeada

Os contêineres permitem que você hospede a API de Reconhecimento de Entidade Nomeada Personalizada em sua própria infraestrutura usando seu próprio modelo treinado. Se você tiver requisitos de segurança ou governança de dados que não podem ser atendidos chamando o Reconhecimento de Entidade Nomeada Personalizado remotamente, os contêineres podem ser uma boa opção.

Nota

- A conta gratuita é limitada a 5.000 registros de texto por mês e apenas os níveis de preço Free e Standard são válidos para contêineres. Para obter mais informações sobre taxas de solicitação de transação, consulte Limites de dados e serviços.

Pré-requisitos

- Se não tiver uma subscrição do Azure, crie uma conta gratuita.

- Docker instalado em um computador host. O Docker deve ser configurado para permitir que os contêineres se conectem e enviem dados de cobrança para o Azure.

- No Windows, o Docker também deve ser configurado para suportar contêineres Linux.

- Você deve ter uma compreensão básica dos conceitos do Docker.

- Um recurso de idioma com o nível de preço gratuito (F0) ou padrão (S).

- Um modelo de Reconhecimento de Entidade Nomeada Personalizado treinado e implantado

Reúna os parâmetros necessários

Três parâmetros principais para todos os contêineres de IA do Azure são necessários. Os Termos de Licença para Software Microsoft devem estar presentes com um valor de aceitação. Um URI do ponto de extremidade e uma chave de API também são necessários.

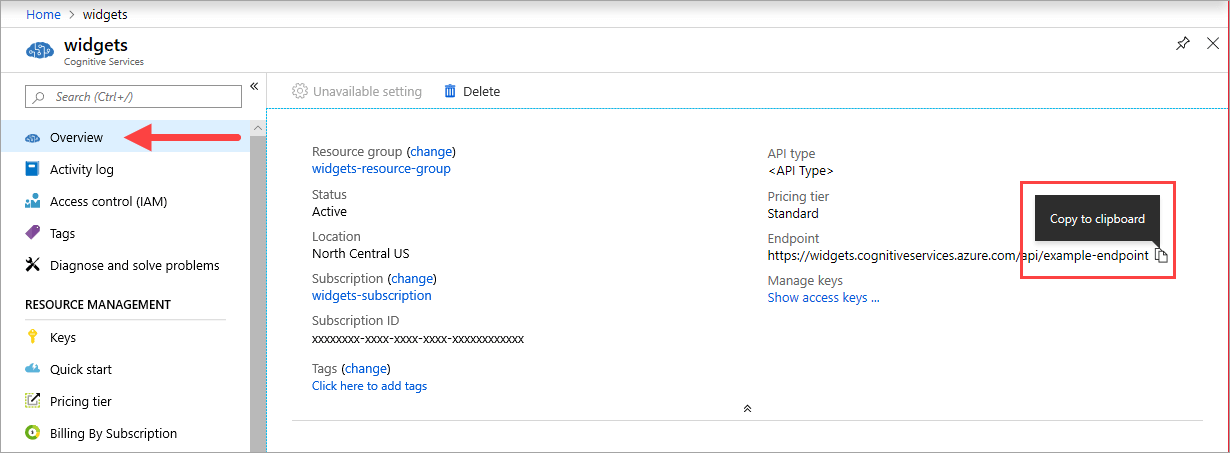

URI do ponto de extremidade

O {ENDPOINT_URI} valor está disponível na página Visão geral do portal do Azure do recurso de serviços de IA do Azure correspondente. Vá para a página Visão geral , passe o mouse sobre o ponto de extremidade e um ícone Copiar para área de transferência será exibido. Copie e use o ponto de extremidade onde necessário.

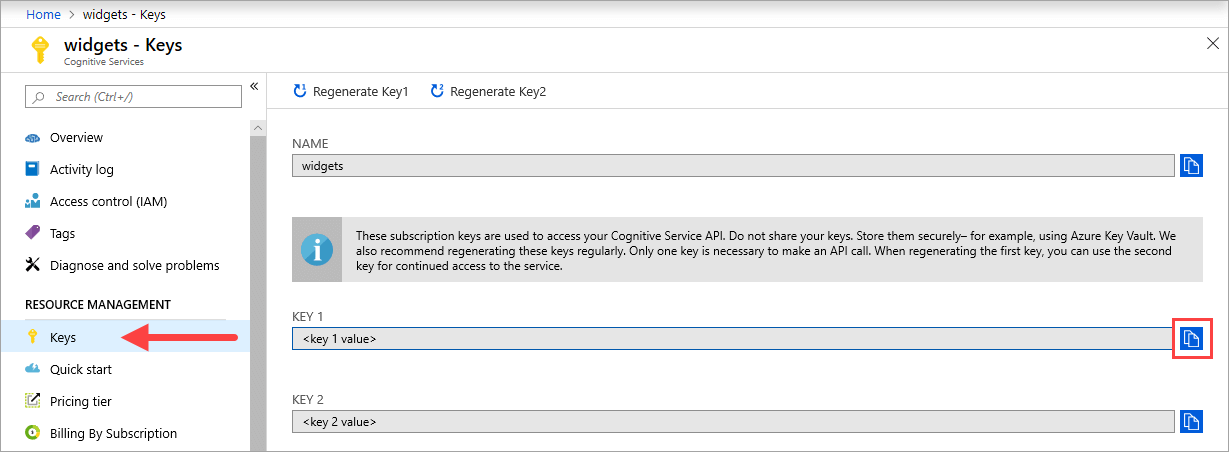

Chaves

O {API_KEY} valor é usado para iniciar o contêiner e está disponível na página Chaves do portal do Azure do recurso de serviços de IA do Azure correspondente. Vá para a página Teclas e selecione o ícone Copiar para área de transferência.

Importante

Essas chaves de assinatura são usadas para acessar sua API de serviços de IA do Azure. Não partilhe as suas chaves. Armazene-os de forma segura. Por exemplo, use o Azure Key Vault. Também recomendamos que regenere essas chaves regularmente. Só é necessária uma chave para fazer uma chamada à API. Ao regenerar a primeira chave, você pode usar a segunda chave para acesso contínuo ao serviço.

Requisitos e recomendações do computador host

O host é um computador baseado em x64 que executa o contêiner do Docker. Pode ser um computador em suas instalações ou um serviço de hospedagem do Docker no Azure, como:

- Serviço Kubernetes do Azure.

- Instâncias de contêiner do Azure.

- Um cluster Kubernetes implantado no Azure Stack. Para obter mais informações, consulte Implantar o Kubernetes no Azure Stack.

A tabela a seguir descreve as especificações mínimas e recomendadas para contêineres de Reconhecimento de Entidade Nomeada Personalizada. Cada núcleo da CPU deve ter pelo menos 2,6 gigahertz (GHz) ou mais rápido. As transações permitidas por segundo (TPS) também estão listadas.

| Especificações mínimas do host | Especificações de host recomendadas | TPS mínimo | TPS máximo | |

|---|---|---|---|---|

| Reconhecimento personalizado de entidade nomeada | 1 núcleo, 2 GB de memória | 1 núcleo, 4 GB de memória | 15 | 30 |

O núcleo da CPU e a memória correspondem às --cpus configurações e --memory , que são usadas como parte do docker run comando.

Exporte seu modelo personalizado de reconhecimento de entidade nomeada

Antes de prosseguir com a execução da imagem do docker, você precisará exportar seu próprio modelo treinado para expô-lo ao contêiner. Use o seguinte comando para extrair seu modelo e substituir os espaços reservados abaixo por seus próprios valores:

| Marcador de Posição | Value | Formato ou exemplo |

|---|---|---|

| {API_KEY} | A chave para o recurso de Reconhecimento de Entidade Nomeada Personalizada. Você pode encontrá-lo na página Chave e ponto de extremidade do seu recurso, no portal do Azure. | xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx |

| {ENDPOINT_URI} | O ponto de extremidade para acessar a API de Reconhecimento de Entidade Nomeada Personalizada. Você pode encontrá-lo na página Chave e ponto de extremidade do seu recurso, no portal do Azure. | https://<your-custom-subdomain>.cognitiveservices.azure.com |

| {PROJECT_NAME} | O nome do projeto que contém o modelo que você deseja exportar. Pode encontrá-lo no separador dos seus projetos no portal Language Studio. | myProject |

| {TRAINED_MODEL_NAME} | O nome do modelo treinado que você deseja exportar. Pode encontrar os seus modelos treinados no separador Avaliação do modelo no seu projeto no portal Language Studio. | myTrainedModel |

curl --location --request PUT '{ENDPOINT_URI}/language/authoring/analyze-text/projects/{PROJECT_NAME}/exported-models/{TRAINED_MODEL_NAME}?api-version=2023-04-15-preview' \

--header 'Ocp-Apim-Subscription-Key: {API_KEY}' \

--header 'Content-Type: application/json' \

--data-raw '{

"TrainedmodelLabel": "{TRAINED_MODEL_NAME}"

}'

Obtenha a imagem do contêiner com docker pull

A imagem do contêiner Reconhecimento de Entidade Nomeada Personalizada pode ser encontrada no sindicato do Registro do mcr.microsoft.com contêiner. Ele reside dentro do azure-cognitive-services/textanalytics/ repositório e é chamado customnerde . O nome da imagem de contêiner totalmente qualificada é, mcr.microsoft.com/azure-cognitive-services/textanalytics/customner.

Para usar a versão mais recente do contêiner, você pode usar a latest tag . Você também pode encontrar uma lista completa de tags no MCR.

Use o docker pull comando para baixar uma imagem de contêiner do Microsoft Container Registry.

docker pull mcr.microsoft.com/azure-cognitive-services/textanalytics/customner:latest

Gorjeta

Você pode usar o comando docker images para listar as imagens de contêiner baixadas. Por exemplo, o comando a seguir lista o ID, o repositório e a tag de cada imagem de contêiner baixada, formatada como uma tabela:

docker images --format "table {{.ID}}\t{{.Repository}}\t{{.Tag}}"

IMAGE ID REPOSITORY TAG

<image-id> <repository-path/name> <tag-name>

Execute o contêiner com docker run

Quando o contêiner estiver no computador host, use o comando docker run para executar os contêineres. O contentor continuará a funcionar até ser parado.

Importante

- Os comandos docker nas seções a seguir usam a barra invertida,

\, como um caractere de continuação de linha. Substitua ou remova isso com base nos requisitos do sistema operacional do host. - As

Eulaopções ,Billinge devemApiKeyser especificadas para executar o contêiner, caso contrário, o contêiner não será iniciado. Para obter mais informações, consulte Faturamento.

Para executar o contêiner Reconhecimento de Entidade Nomeada Personalizada , execute o seguinte docker run comando. Substitua os espaços reservados abaixo pelos seus próprios valores:

| Marcador de Posição | Value | Formato ou exemplo |

|---|---|---|

| {API_KEY} | A chave para o recurso de Reconhecimento de Entidade Nomeada Personalizada. Você pode encontrá-lo na página Chave e ponto de extremidade do seu recurso, no portal do Azure. | xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx |

| {ENDPOINT_URI} | O ponto de extremidade para acessar a API de Reconhecimento de Entidade Nomeada Personalizada. Você pode encontrá-lo na página Chave e ponto de extremidade do seu recurso, no portal do Azure. | https://<your-custom-subdomain>.cognitiveservices.azure.com |

| {PROJECT_NAME} | O nome do projeto que contém o modelo que você deseja exportar. Pode encontrá-lo no separador dos seus projetos no portal Language Studio. | myProject |

| {LOCAL_PATH} | O caminho onde o modelo exportado na etapa anterior será baixado. Você pode escolher qualquer caminho de sua preferência. | C:/custom-ner-model |

| {TRAINED_MODEL_NAME} | O nome do modelo treinado que você deseja exportar. Pode encontrar os seus modelos treinados no separador Avaliação do modelo no seu projeto no portal Language Studio. | myTrainedModel |

docker run --rm -it -p5000:5000 --memory 4g --cpus 1 \

-v {LOCAL_PATH}:/modelPath \

mcr.microsoft.com/azure-cognitive-services/textanalytics/customner:latest \

EULA=accept \

BILLING={ENDPOINT_URI} \

APIKEY={API_KEY} \

projectName={PROJECT_NAME}

exportedModelName={TRAINED_MODEL_NAME}

Este comando:

- Executa um contêiner de Reconhecimento de Entidade Nomeada Personalizado e baixa o modelo exportado para o caminho local especificado.

- Aloca um núcleo de CPU e 4 gigabytes (GB) de memória

- Expõe a porta TCP 5000 e aloca um pseudo-TTY para o contêiner

- Remove automaticamente o recipiente depois que ele sai. A imagem do contêiner ainda está disponível no computador host.

Executar vários contêineres no mesmo host

Se você pretende executar vários contêineres com portas expostas, certifique-se de executar cada contêiner com uma porta exposta diferente. Por exemplo, execute o primeiro contêiner na porta 5000 e o segundo contêiner na porta 5001.

Você pode ter esse contêiner e um contêiner de serviços de IA do Azure diferente em execução no HOST juntos. Você também pode ter vários contêineres do mesmo contêiner de serviços de IA do Azure em execução.

Consultar o ponto final de predição do contentor

O contentor fornece APIs de ponto final de predição de consulta com base em REST.

Utilize o anfitrião, http://localhost:5000, para APIs de contentor.

Validar se um contêiner está em execução

Há várias maneiras de validar se o contêiner está em execução. Localize o endereço IP externo e a porta exposta do contêiner em questão e abra seu navegador da Web favorito. Use as várias URLs de solicitação a seguir para validar que o contêiner está em execução. Os URLs de solicitação de exemplo listados aqui são http://localhost:5000, mas seu contêiner específico pode variar. Certifique-se de confiar no endereço IP externo e na porta exposta do contêiner.

| URL do Pedido | Propósito |

|---|---|

http://localhost:5000/ |

O contentor fornece uma home page. |

http://localhost:5000/ready |

Solicitada com GET, essa URL fornece uma verificação de que o contêiner está pronto para aceitar uma consulta no modelo. Essa solicitação pode ser usada para sondas de vivacidade e prontidão do Kubernetes. |

http://localhost:5000/status |

Também solicitada com GET, essa URL verifica se a chave de api usada para iniciar o contêiner é válida sem causar uma consulta de ponto de extremidade. Essa solicitação pode ser usada para sondas de vivacidade e prontidão do Kubernetes. |

http://localhost:5000/swagger |

O contentor fornece um conjunto completo de documentação para os pontos finais e uma funcionalidade Experimentar. Com esse recurso, você pode inserir suas configurações em um formulário HTML baseado na Web e fazer a consulta sem ter que escrever nenhum código. Depois que a consulta retorna, um comando CURL de exemplo é fornecido para demonstrar os cabeçalhos HTTP e o formato de corpo necessários. |

Parar o contentor

Para desligar o contêiner, no ambiente de linha de comando em que o contêiner está sendo executado, selecione Ctrl+C.

Resolução de Problemas

Se você executar o contêiner com uma montagem de saída e registro em log habilitados, o contêiner gerará arquivos de log que serão úteis para solucionar problemas que acontecem ao iniciar ou executar o contêiner.

Gorjeta

Para obter mais informações e orientações sobre solução de problemas, consulte Perguntas frequentes (FAQ) sobre contêineres de IA do Azure.

Faturação

Os contêineres de Reconhecimento de Entidade Nomeada Personalizada enviam informações de cobrança para o Azure, usando um recurso de Reconhecimento de Entidade Nomeada Personalizada em sua conta do Azure.

As consultas ao contêiner são cobradas na camada de preço do recurso do Azure usado para o ApiKey parâmetro.

Os contêineres de serviços de IA do Azure não são licenciados para serem executados sem estarem conectados ao ponto de extremidade de medição ou cobrança. Você deve habilitar os contêineres para comunicar informações de faturamento com o ponto de extremidade de faturamento em todos os momentos. Os contêineres de serviços de IA do Azure não enviam dados do cliente, como a imagem ou o texto que está sendo analisado, para a Microsoft.

Ligar ao Azure

O contêiner precisa dos valores do argumento de faturamento para ser executado. Esses valores permitem que o contêiner se conecte ao ponto de extremidade de faturamento. O contêiner relata o uso a cada 10 a 15 minutos. Se o contêiner não se conectar ao Azure dentro da janela de tempo permitida, o contêiner continuará a ser executado, mas não atenderá consultas até que o ponto de extremidade de cobrança seja restaurado. A conexão é tentada 10 vezes no mesmo intervalo de tempo de 10 a 15 minutos. Se ele não puder se conectar ao ponto de extremidade de faturamento dentro das 10 tentativas, o contêiner interromperá o atendimento de solicitações. Consulte as Perguntas frequentes sobre o contêiner de serviços de IA do Azure para obter um exemplo das informações enviadas à Microsoft para cobrança.

Argumentos de faturação

O docker run comando iniciará o contêiner quando todas as três opções a seguir forem fornecidas com valores válidos:

| Opção | Description |

|---|---|

ApiKey |

A chave de API do recurso de serviços de IA do Azure que é usada para rastrear informações de cobrança. O valor dessa opção deve ser definido como uma chave de API para o recurso provisionado especificado em Billing. |

Billing |

O ponto de extremidade do recurso de serviços de IA do Azure usado para rastrear informações de cobrança. O valor dessa opção deve ser definido como o URI do ponto de extremidade de um recurso provisionado do Azure. |

Eula |

Indica que você aceitou a licença para o contêiner. O valor desta opção deve ser definido como accept. |

Resumo

Neste artigo, você aprendeu conceitos e fluxo de trabalho para baixar, instalar e executar contêineres de Reconhecimento de Entidade Nomeada Personalizada. Em resumo:

- O Reconhecimento de Entidade Nomeada Personalizado fornece contêineres Linux para o Docker.

- As imagens de contêiner são baixadas do Microsoft Container Registry (MCR).

- As imagens de contêiner são executadas no Docker.

- Você pode usar a API REST ou o SDK para chamar operações em contêineres personalizados de Reconhecimento de Entidade Nomeada especificando o URI do host do contêiner.

- Você deve especificar informações de faturamento ao instanciar um contêiner.

Importante

Os contêineres de IA do Azure não são licenciados para serem executados sem estarem conectados ao Azure para medição. Os clientes precisam permitir que os contêineres comuniquem informações de faturamento com o serviço de medição em todos os momentos. Os contêineres de IA do Azure não enviam dados do cliente (por exemplo, texto que está sendo analisado) para a Microsoft.

Próximos passos

- Consulte Configurar contêineres para obter definições de configuração.