Executar o Jupyter Notebook para produzir um modelo de detecção de objetos usando AutoML

Nesta seção, continuaremos trabalhando no Jupyter Notebook para executar as etapas que produzirão o modelo de detecção de objetos. Essa tarefa será realizada usando o AutoML para pesquisa visual computacional. A execução da inferência em uma amostra de teste que nunca foi vista pelo modelo durante o treinamento permite ver o modelo em ação.

Executar o Jupyter Notebook para produzir um modelo de detecção de objetos usando AutoML

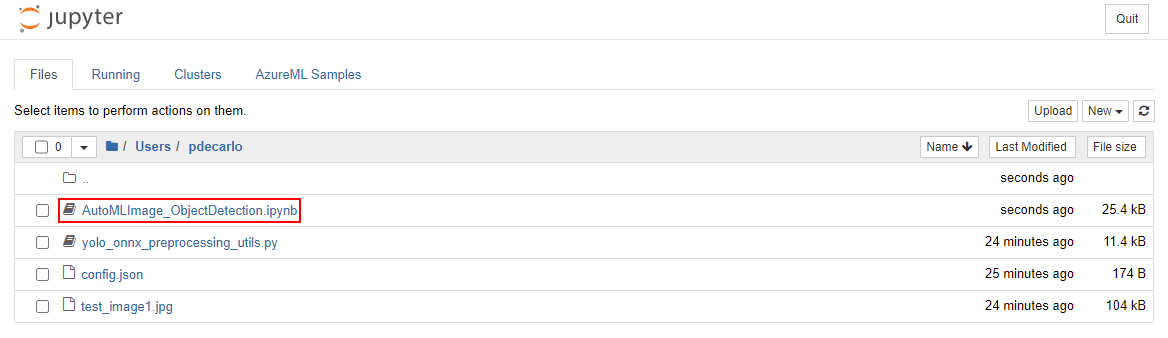

Se ainda não fez isso, navegue até o workspace do Jupyter e selecione o arquivo AutoMLImage_ObjectDetection.ipynb para abrir o Jupyter Notebook.

Prossiga para a seção Configurar a execução do AutoML para tarefas de imagem e comece a executar a célula em Usando valores de hiperparâmetro padrão para o algoritmo especificado. Esta etapa usará uma AutoMLImageConfig para criar uma configuração de treinamento de modelo que atribuirá hiperparâmetros padrão para produzir um modelo de detecção de objetos otimizado.

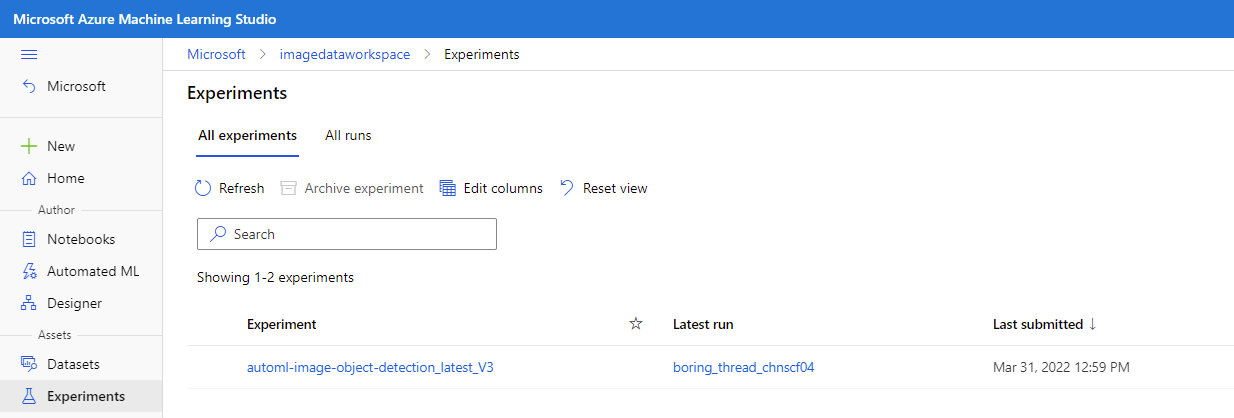

Continue executando as células na seção Enviando uma execução de AutoML para Tarefas de Pesquisa Visual Computacional. Essa operação enviará uma tarefa de experimento que será executada na instância de treinamento atribuída na seção Configuração do destino de computação. Depois de executar essas células, você pode monitorar o progresso no Estúdio do Azure Machine Learning localizando a seção Ativos no painel esquerdo e selecionando Experimentos.

Em seguida, você pode selecionar o trabalho em execução, que deve ter o nome automl-image-object-detection_latest_V3. Essa ação permitirá que você veja o progresso do treinamento do modelo.

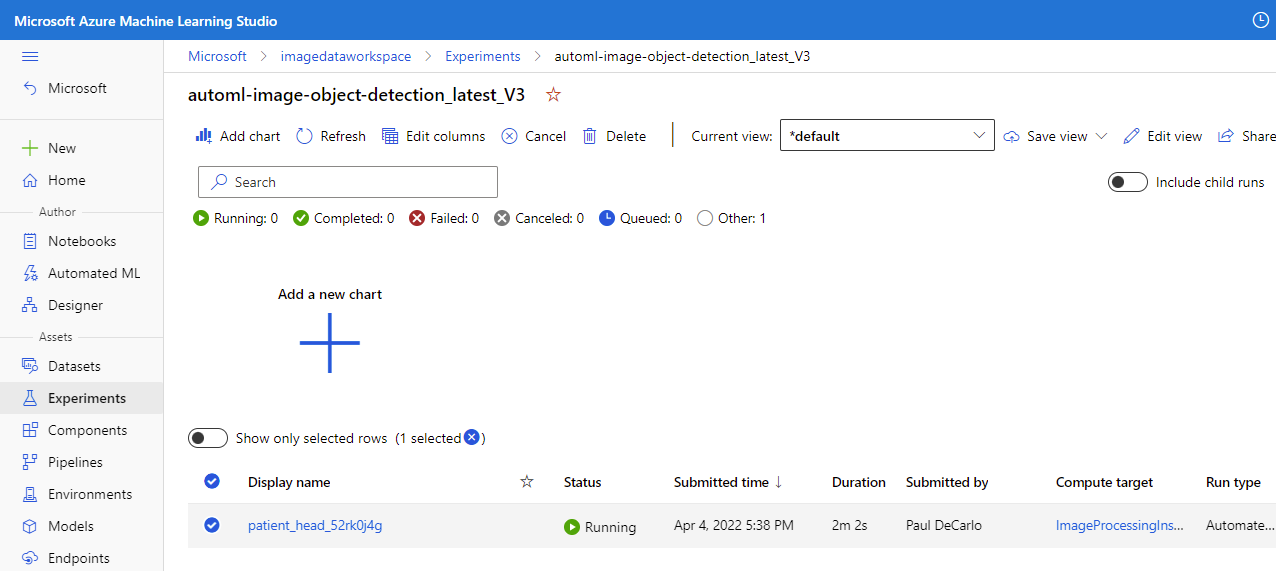

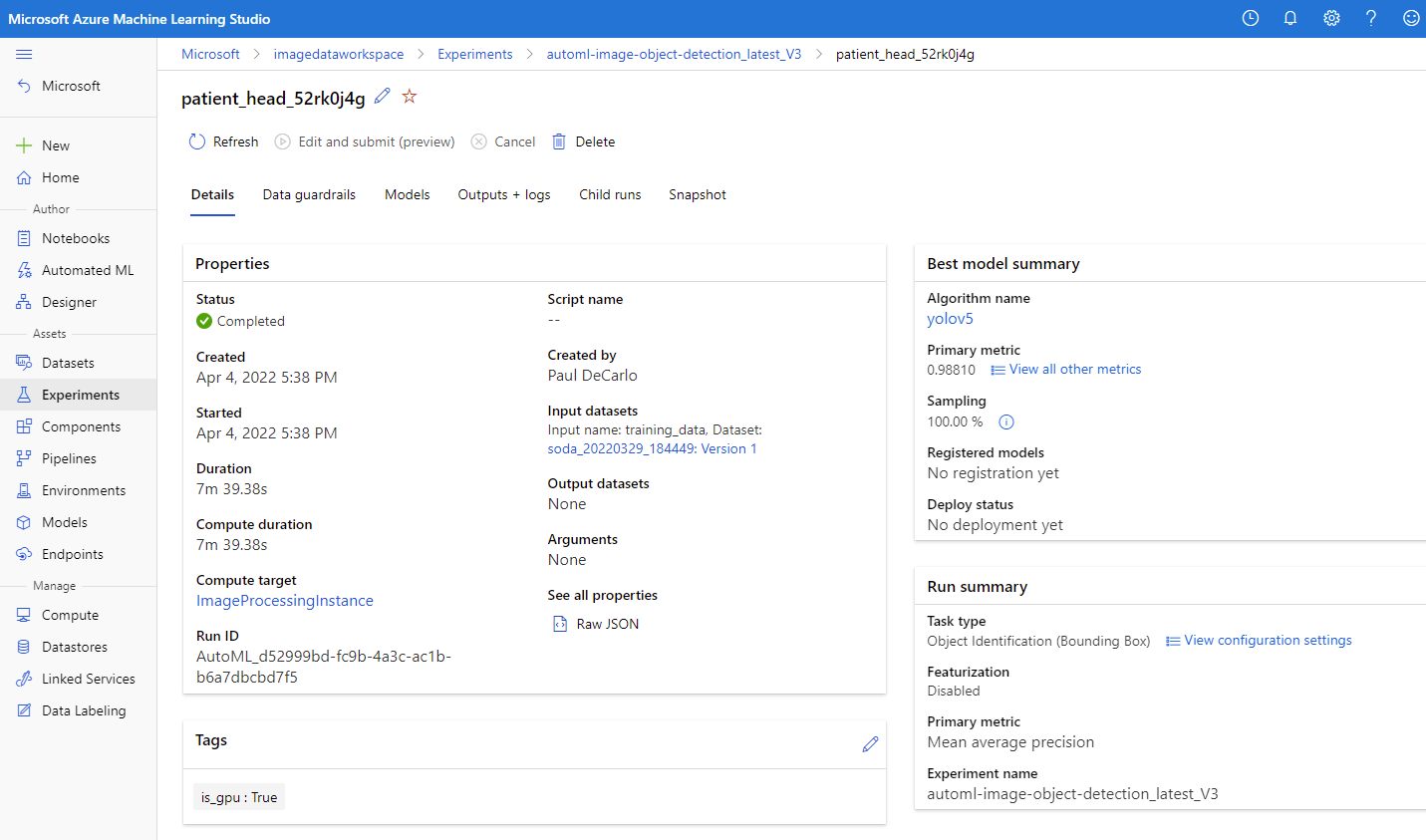

Quando o experimento for concluído, você verá o seguinte.

Selecione o Nome de exibição do trabalho para apresentar os Detalhes dele, em que você pode ver os resultados do treinamento do modelo.

Agora que o modelo está treinado, podemos continuar e executar as células na seção Registrar o modelo de visão ideal da execução de AutoML. Esse processo selecionará automaticamente a execução filho com a maior precisão.

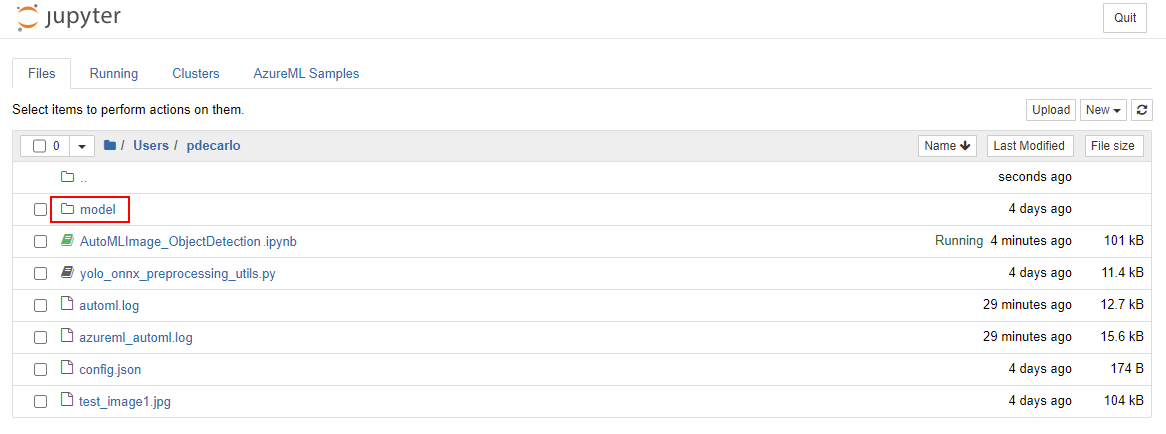

Continue e execute as células na seção Baixar o modelo e outros arquivos associados, por exemplo, rótulos. Há uma célula opcional que você pode executar especificando uma run_id de AutoML específica. A saída de qualquer uma dessas células fornecerá o modelo e o rótulo em uma pasta de modelos recém-criada acessível no workspace do Jupyter. Navegue até o workspace do Jupyter e abra a pasta modelos e você verá as saídas labels.json e model.onnx.

Selecione labels.json e model.onnx e faça Download dos arquivos de saída. Esses arquivos são o modelo treinado e os rótulos associados a ele.

Navegue de volta até o Jupyter Notebook e execute todas as células na seção Carregar os rótulos e os arquivos de modelo ONNX. Esta etapa carregará a saída e os rótulos do modelo para se preparar para a execução.

Continue e execute as células em Obter os detalhes de entrada e saída esperados para um modelo ONNX. Essa tarefa analisará o modelo para determinar as formas de entrada e saída que definem a Rede Neural de Convolução presente no modelo.

Continue e execute as células na seção Pré-processamento de inferência de imagem. Isso pré-processará a amostra test_image1.jpg que foi carregada no workspace anteriormente. A etapa de pré-processamento transformará a imagem para corresponder à forma de entrada esperada determinada na etapa anterior.

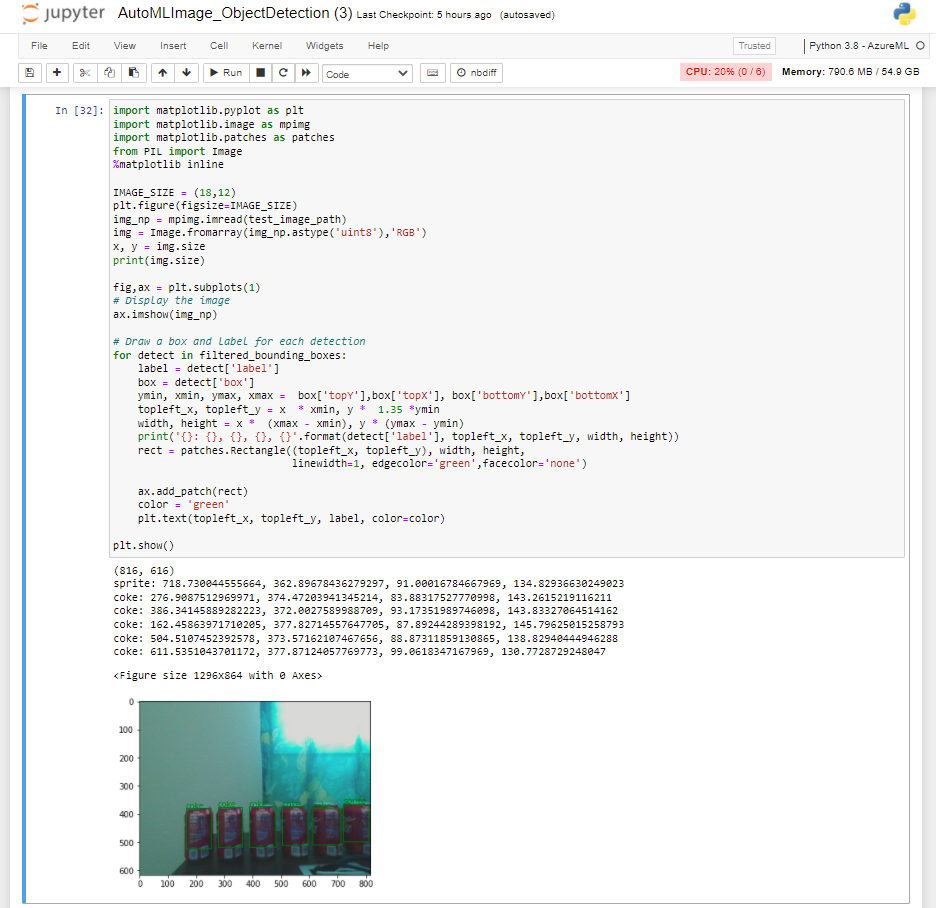

Continue e execute as células na seção Detecção de objetos com YOLO. Esta seção executará inferência na amostra test_image1.jpg e demonstrará a saída do modelo de detecção de objetos visualmente na célula final. Aqui, você pode ver a precisão do modelo, pois ele detecta o objeto em uma amostra de imagem nunca vista antes.