Entenda o ciclo de vida de desenvolvimento de um aplicativo de modelo de linguagem grande (LLM)

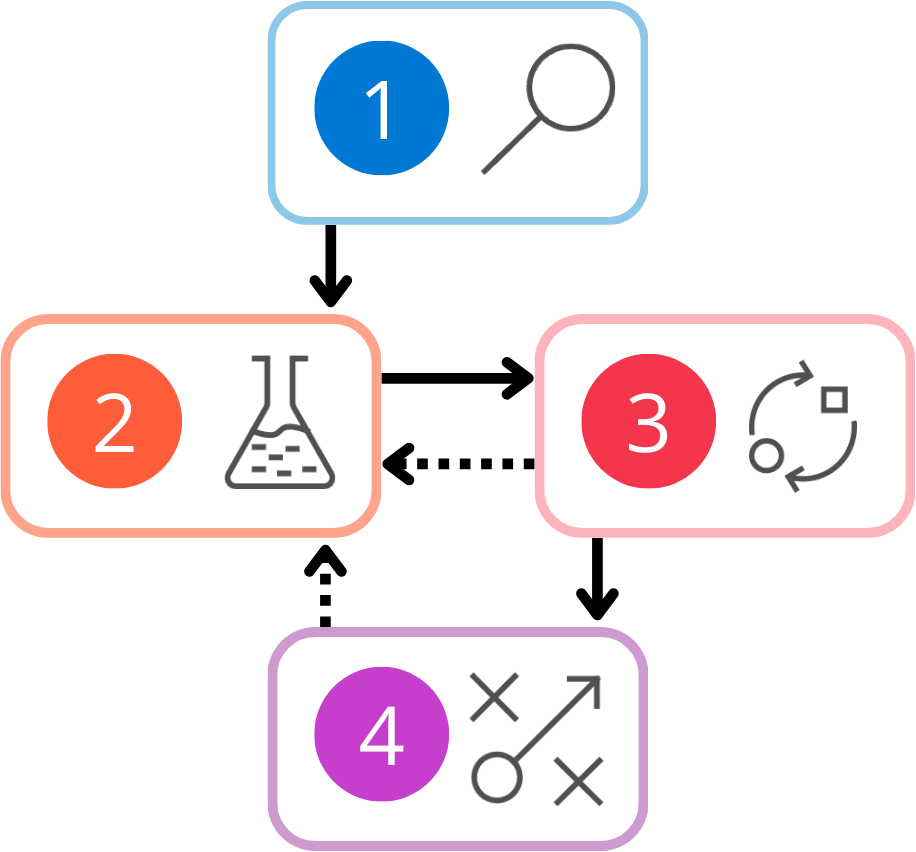

Antes de entender como trabalhar com o prompt flow, vamos explorar o ciclo de vida de desenvolvimento de um aplicativo LLM (Modelo de Linguagem Grande).

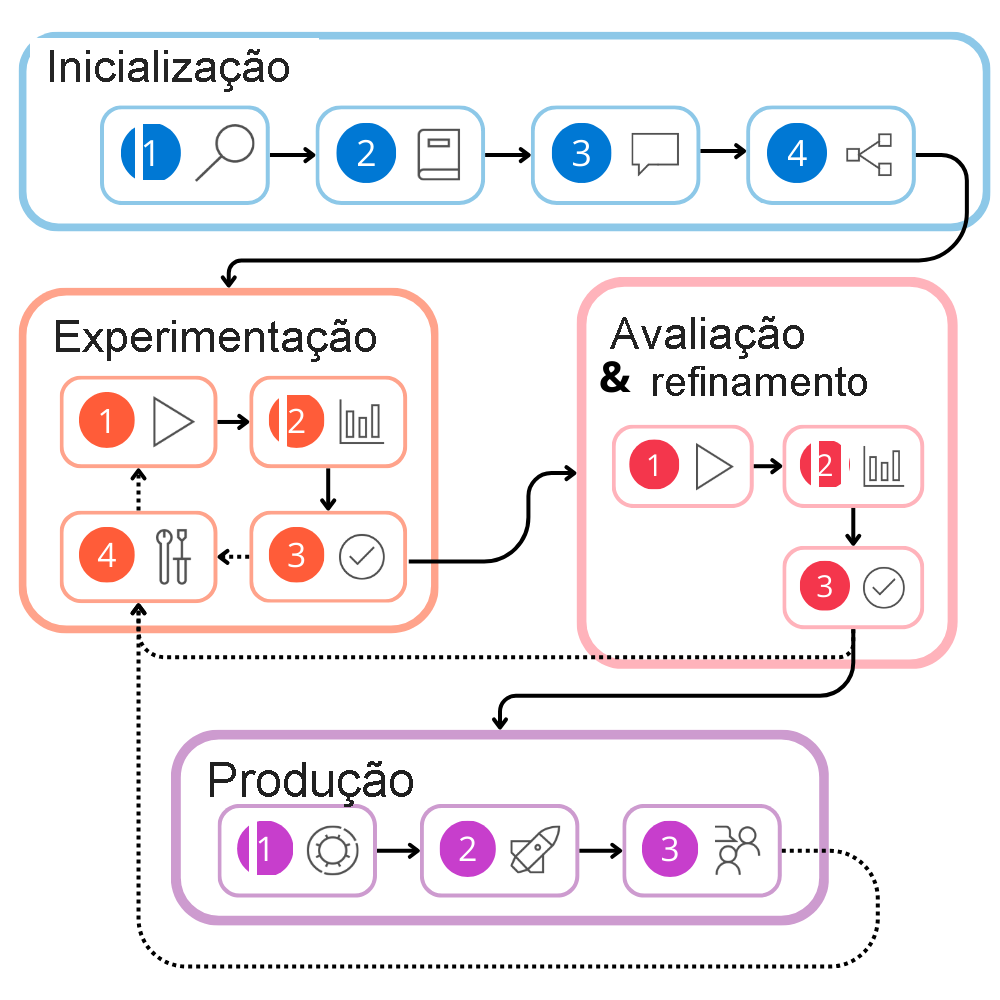

O ciclo de vida consiste nos seguintes estágios:

- Inicialização: Defina o caso de uso e crie a solução.

- Experimentação: Desenvolva um fluxo e teste com um pequeno conjunto de dados.

- Avaliação e refinamento: Avalie o fluxo com um conjunto de dados maior.

- Produção: Implante e monitore o fluxo e o aplicativo.

Durante a avaliação, o refinamento e a produção, você pode descobrir que sua solução precisa ser melhorada. Você pode voltar à experimentação e continuar desenvolvendo o fluxo até ficar satisfeito com os resultados.

Vamos explorar cada uma dessas fases com mais detalhes.

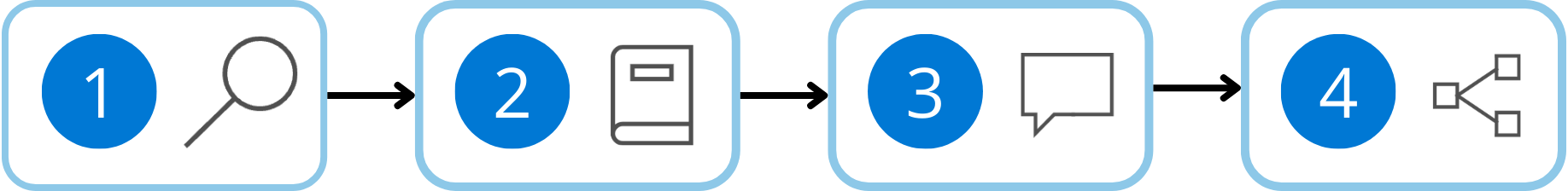

Inicialização

Imagine que você deseja criar e desenvolver um aplicativo LLM para classificar artigos de notícias. Antes de começar a criar qualquer coisa, você precisa definir quais categorias você deseja como saída. Você precisa qual é a aparência típica de um artigo de notícias, como apresentar o artigo como entrada para seu aplicativo e como o aplicativo gera a saída desejada.

Em outras palavras, durante a inicialização, você:

- Define o objetivo

- Coleta um conjunto de dados de exemplo

- Cria um prompt básico

- Cria o fluxo

Para criar, desenvolver e testar um aplicativo LLM, você precisa de um conjunto de dados de exemplo que serve como entrada. Um conjunto de dados de exemplo é um pequeno subconjunto representativo dos dados que você pretende analisar como entrada para seu aplicativo LLM.

Ao coletar ou criar o conjunto de dados de exemplo, você deve garantir a diversidade nos dados para abranger vários cenários e casos de borda. Você também deve remover informações confidenciais de privacidade do conjunto de dados para evitar vulnerabilidades.

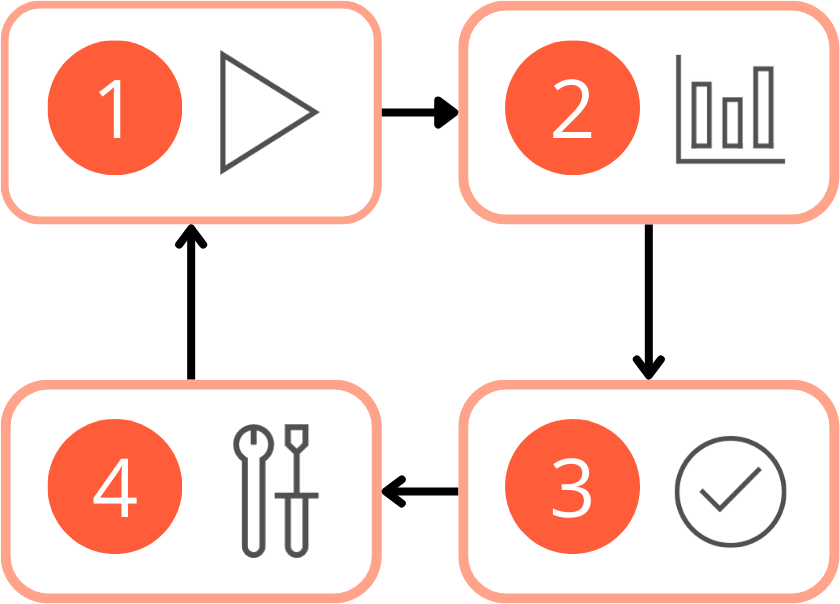

Experimentação

Você coletou um conjunto de dados de exemplo de artigos de notícias e decidiu em quais categorias deseja que os artigos sejam classificados. Você criou um fluxo que usa um artigo de notícias como entrada e usa um LLM para classificar o artigo. Para testar se o fluxo gera a saída esperada, execute-a no conjunto de dados de exemplo.

A fase de experimentação é um processo iterativo durante o qual você (1) executa o fluxo em um conjunto de dados de exemplo. Em seguida, você (2) avalia o desempenho do prompt. Se você estiver (3) satisfeito com o resultado, poderá passar para avaliação e refinamento. Se você achar que há espaço para melhorias, poderá (4) modificar o fluxo alterando o prompt ou o próprio fluxo.

Avaliação e refinamento

Quando estiver satisfeito com a saída do fluxo que classifica artigos de notícias, com base no conjunto de dados de exemplo, você poderá avaliar o desempenho do fluxo em relação a um conjunto de dados maior.

Ao testar o fluxo em um conjunto de dados maior, você pode avaliar o quão bem o aplicativo LLM generaliza para novos dados. Durante a avaliação, você pode identificar possíveis gargalos ou áreas para otimização ou refinamento.

Ao editar seu fluxo, primeiro você deve executá-lo em um conjunto de dados menor antes de executá-lo novamente em um conjunto de dados maior. Testar seu fluxo com um conjunto de dados menor permite que você responda mais rapidamente a quaisquer problemas.

Depois que seu aplicativo LLM parecer robusto e confiável no tratamento de vários cenários, você poderá mover o aplicativo LLM para produção.

Produção

Por fim, seu aplicativo de classificação de artigo de notícias está pronto para produção.

Durante a produção, você:

- Otimiza o fluxo que classifica os artigos de entrada para eficiência e eficácia.

- Implanta seu fluxo em um ponto de extremidade. Quando você chama o ponto de extremidade, o fluxo é disparado para ser executado e a saída desejada é gerada.

- Monitore o desempenho da solução coletando dados de uso e comentários do usuário final. Ao entender como o aplicativo é executado, você pode melhorar o fluxo sempre que necessário.

Explore o ciclo de vida de desenvolvimento completo

Agora que você entende cada estágio do ciclo de vida de desenvolvimento de um aplicativo LLM, você pode explorar a visão geral completa: