Atualizar de modelos do GitHub para o serviço de inferência de modelo de IA do Azure

Se você deseja desenvolver um aplicativo de IA generativa, pode usar Modelos do GitHub para encontrar e experimentar modelos de IA gratuitamente. O playground e o uso gratuito da API são limitados por solicitações por minuto, solicitações por dia, tokens por solicitação e solicitações simultâneas. Se você tiver uma limitação de fluxo, precisará aguardar a redefinição do limite de fluxo atingido antes de fazer mais solicitações.

Quando estiver pronto para levar seu aplicativo para produção, você poderá atualizar sua experiência implantando um recurso dos Serviços de IA do Azure em uma assinatura do Azure e começar a usar o serviço de inferência de modelo de IA do Azure. Você não precisa adicionar ou alterar nada mais em seu código.

O artigo a seguir explica como começar a usar modelos do GitHub nos modelos de IA do Azure para serviços de IA do Azure.

Pré-requisitos

Para concluir este tutorial, você precisará de:

Uma conta do GitHub com acesso a Modelos do GitHub.

Uma assinatura do Azure. Se você não tiver uma, será solicitado que você crie ou atualize sua conta do Azure para uma conta paga conforme o uso quando estiver pronto para implantar seu modelo na produção.

Atualizar para os serviços de IA do Azure

Os limites de fluxo para o playground e o uso gratuito da API destinam-se a ajudá-lo a experimentar modelos e desenvolver seu aplicativo de IA. Quando estiver pronto para colocar seu aplicativo em produção,use uma chave e ponto de extremidade de uma conta paga do Azure. Você não precisa adicionar ou alterar nada mais em seu código.

Para obter a chave e o ponto de extremidade:

No playground do modelo, selecione Obter chave de API.

Selecione Obter chave de produção.

Se você não tiver uma conta do Azure, selecione Criar minha conta e siga as etapas para criar uma.

Se você tiver uma conta do Azure, selecione Entrar novamente.

Se sua conta existente for uma conta gratuita, primeiro você precisará atualizar para um plano Pagamento conforme o uso. Depois de atualizar, volte para o playground e selecione Obter chave de API novamente e entre com sua conta atualizada.

Depois de conectar sua conta do Azure, você será levado ao Azure AI Foundry.

Na parte superior da página, selecione Ir para seu recurso de IA do GitHub para acessar o Azure AI Foundry / Github](https://ai.azure.com/github). Pode levar um ou dois minutos para carregar os detalhes iniciais do modelo no portal do Azure AI Foundry.

A página é carregada com os detalhes do modelo. Selecione o botão Criar uma implantação para implantar o modelo em sua conta.

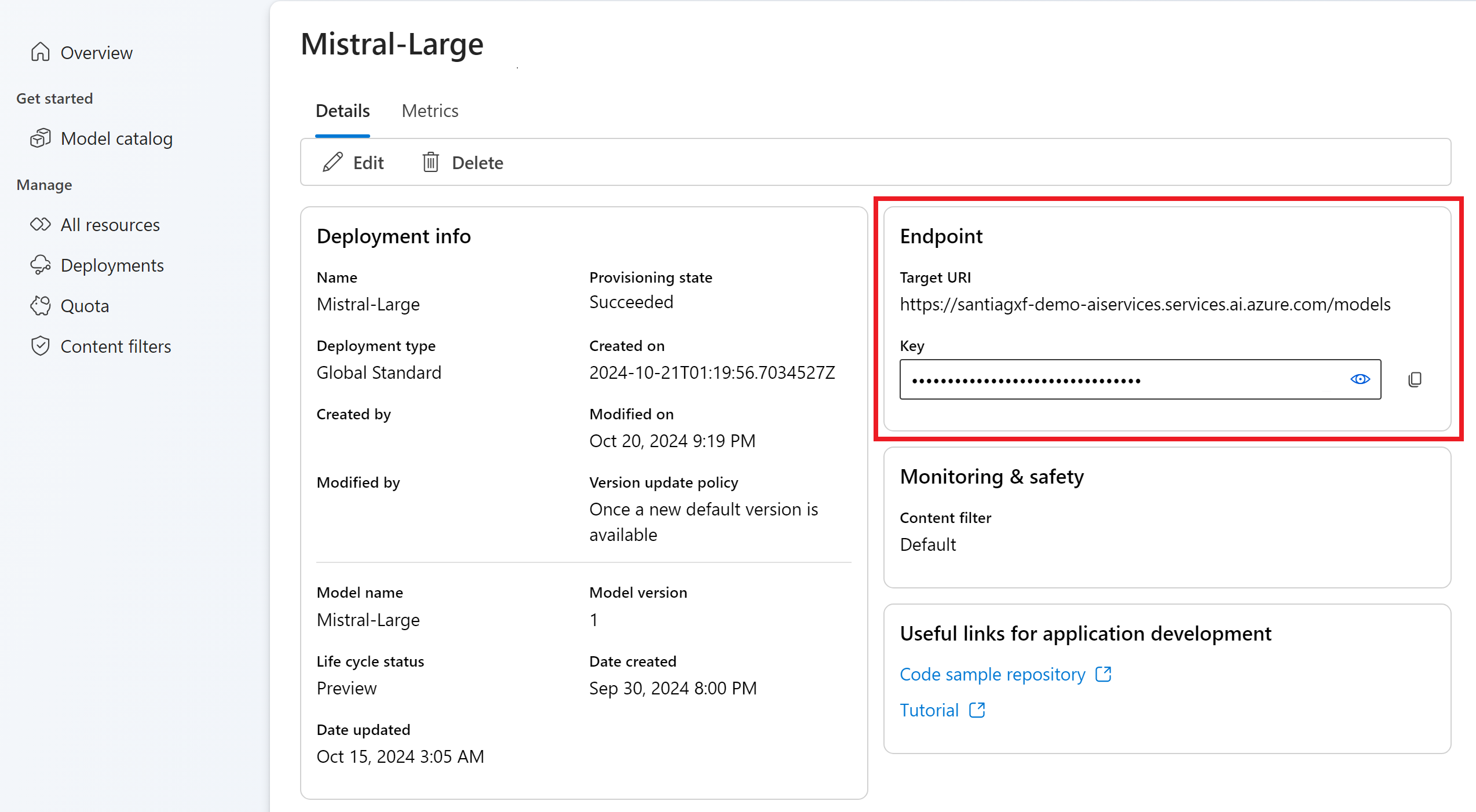

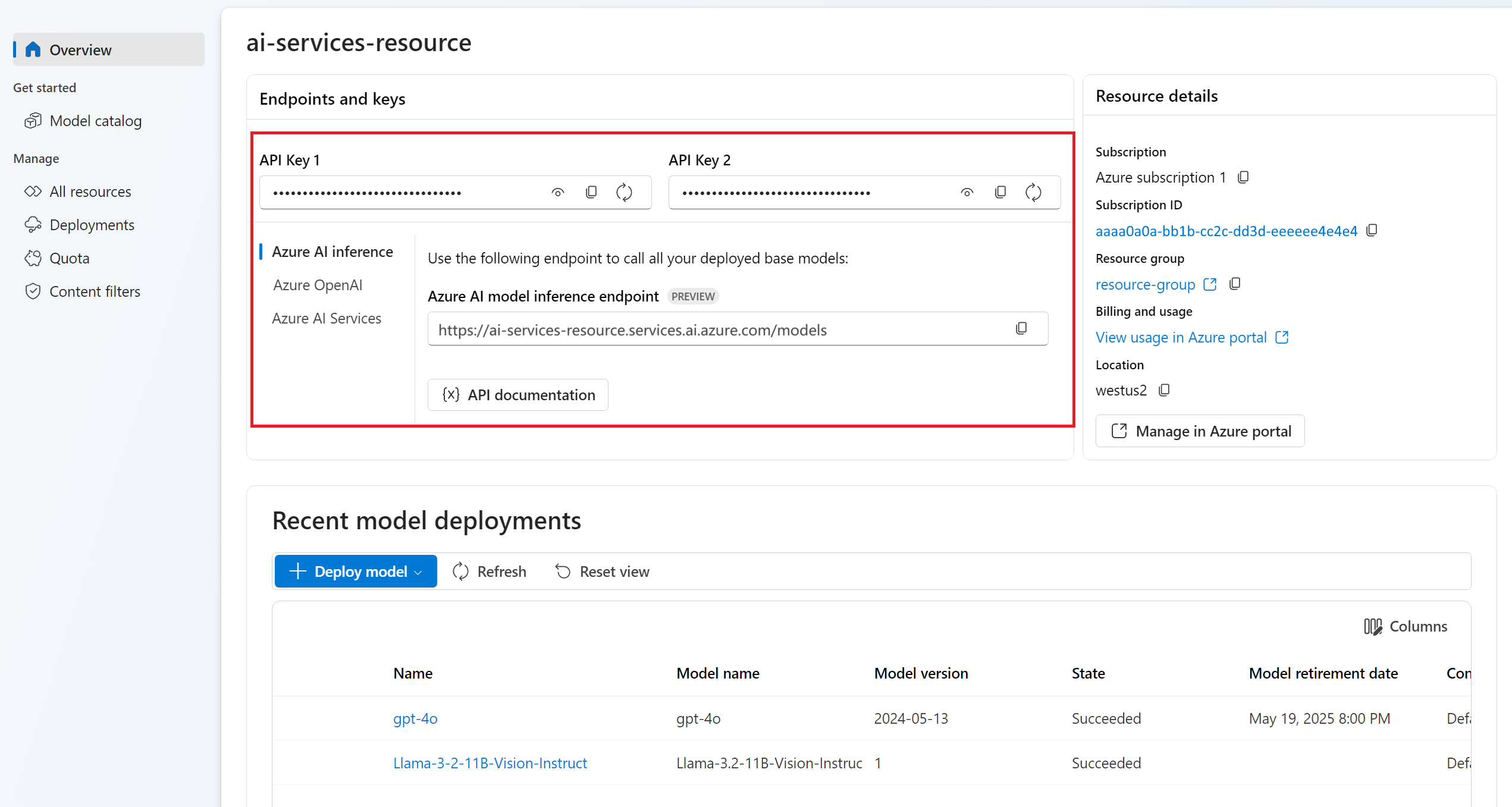

Depois de implantado, a Chave de API e o ponto de extremidade do modelo são mostrados na Visão Geral. Use esses valores em seu código para usar o modelo em seu ambiente de produção.

Neste ponto, o modelo selecionado está pronto para consumir.

Dica

Use o parâmetro model="<deployment-name> para rotear sua solicitação para essa implantação. As implantações funcionam como um alias de um determinado modelo em determinadas configurações. Consulte a página de conceito de Roteamento para saber como os Serviços de IA do Azure roteiam implantações.

Atualizar o código para usar o novo ponto de extremidade

Depois que o recurso dos Serviços de IA do Azure estiver configurado, você poderá começar a consumi-lo do código. Você precisa da URL do ponto de extremidade e da chave para ela, que podem ser encontradas na seção Visão geral:

Você pode usar qualquer um dos SDKs com suporte para obter previsões do ponto de extremidade. Os seguintes SDKs têm suporte oficial:

- SDK de OpenAI

- SDK do OpenAI do Azure

- SDK de Inferência de IA do Azure

Consulte a seção de idiomas e SDKs com suporte para obter mais detalhes e exemplos. O exemplo a seguir mostra como usar o SDK de inferência do modelo de IA do Azure com o modelo recém-implantado:

Instale o pacote azure-ai-inference usando seu gerenciador de pacotes, como o pip:

pip install azure-ai-inference>=1.0.0b5

Aviso

O recurso dos Serviços de IA do Azure requer a versão azure-ai-inference>=1.0.0b5 para Python.

Em seguida, você poderá usar o pacote para consumir o modelo. O exemplo a seguir mostra como criar um cliente para consumir conclusões de chat:

import os

from azure.ai.inference import ChatCompletionsClient

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint=os.environ["AZUREAI_ENDPOINT_URL"],

credential=AzureKeyCredential(os.environ["AZUREAI_ENDPOINT_KEY"]),

)

Explore nossos exemplos e leia a documentação de referência da API para começar.

Gere sua primeira conclusão de chat:

from azure.ai.inference.models import SystemMessage, UserMessage

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="Explain Riemann's conjecture in 1 paragraph"),

],

model="mistral-large"

)

print(response.choices[0].message.content)

Etapa 5: explorar mais recursos

A inferência do modelo de IA do Azure dá suporte a mais recursos não disponíveis nos Modelos do GitHub, incluindo:

- Explorar o catálogo de modelos para ver outros modelos não disponíveis nos Modelos do GitHub.

- Configurar os filtros de conteúdo.

- Configure a limitação de taxa (para modelos específicos).

- Explore mais SKUs de implantação (para modelos específicos).

- Configure a rede privada.

Tem problemas?

Consulte a seção de perguntas frequentes para obter mais ajuda.

Próximas etapas

- Adicionar mais modelos ao ponto de extremidade.

- Explore o catálogo de modelos no portal do Azure AI Foundry.