Uzyskiwanie dostępu do usługi Azure OpenAI

Pierwszym krokiem tworzenia rozwiązania do generowania sztucznej inteligencji za pomocą usługi Azure OpenAI jest aprowizowanie zasobu usługi Azure OpenAI w ramach subskrypcji platformy Azure. Możesz rozpocząć pracę, tworząc zasób w witrynie Azure Portal lub za pomocą interfejsu wiersza polecenia platformy Azure.

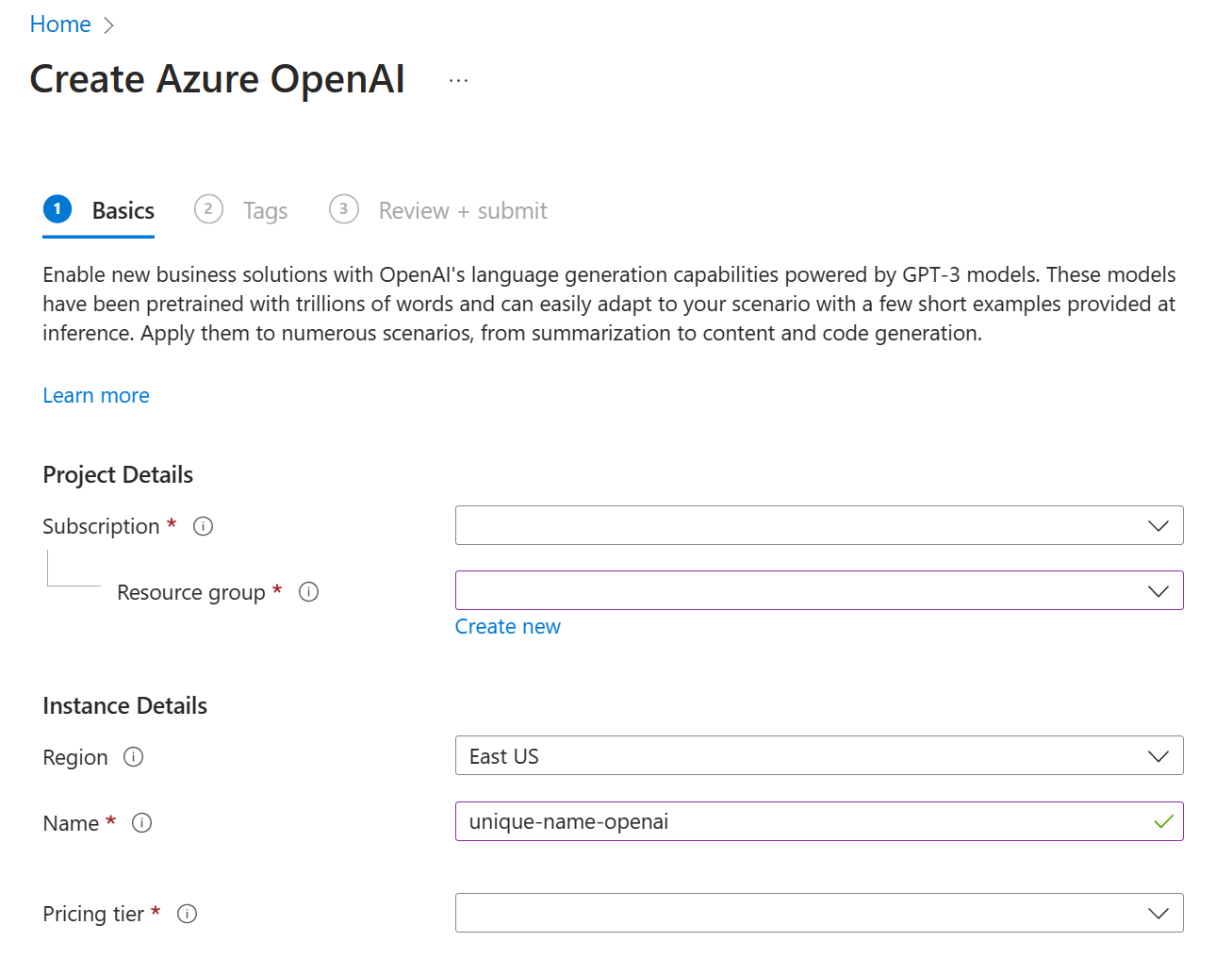

Tworzenie zasobu usługi Azure OpenAI w witrynie Azure Portal

Podczas tworzenia zasobu usługi Azure OpenAI Service należy podać nazwę subskrypcji, nazwę grupy zasobów, region, unikatową nazwę wystąpienia i wybrać warstwę cenową.

Tworzenie zasobu usługi Azure OpenAI Service w interfejsie wiersza polecenia platformy Azure

Aby utworzyć zasób usługi Azure OpenAI z poziomu interfejsu wiersza polecenia, zapoznaj się z tym przykładem i zastąp następujące zmienne własnymi:

- MyOpenAIResource: zastąp element unikatową nazwą zasobu

- OAIResourceGroup: zastąp ciąg nazwą grupy zasobów

- eastus: zastąp element regionem, aby wdrożyć zasób

- subscriptionID: zastąp element identyfikatorem subskrypcji

az cognitiveservices account create \

-n MyOpenAIResource \

-g OAIResourceGroup \

-l eastus \

--kind OpenAI \

--sku s0 \

--subscription subscriptionID

Uwaga

Regiony dostępne dla usługi można znaleźć za pomocą polecenia interfejsu wiersza polecenia az account list-locations. Aby dowiedzieć się, jak zalogować się do platformy Azure i utworzyć grupę platformy Azure za pośrednictwem interfejsu wiersza polecenia, zapoznaj się z dokumentacją tutaj. Usługa Azure OpenAI Service zapewnia dostęp do wielu typów modeli. Niektóre modele są dostępne tylko w wybranych regionach. Aby uzyskać informacje o dostępności w regionach, zapoznaj się z przewodnikiem dostępności modelu Azure OpenAI. Możesz utworzyć dwa zasoby usługi Azure OpenAI na region.

Korzystanie z rozwiązania Azure OpenAI Foundry

Usługa Azure AI Foundry zapewnia dostęp do zarządzania modelami, wdrażania, eksperymentowania, dostosowywania i zasobów szkoleniowych.

Dostęp do usługi Azure AI Foundry można uzyskać za pośrednictwem witryny Azure Portal po utworzeniu zasobu lub https://ai.azure.com/ na stronie, logując się do konta platformy Azure. Podczas przepływu pracy logowania wybierz odpowiedni katalog, subskrypcję platformy Azure i zasób usługi Azure OpenAI.

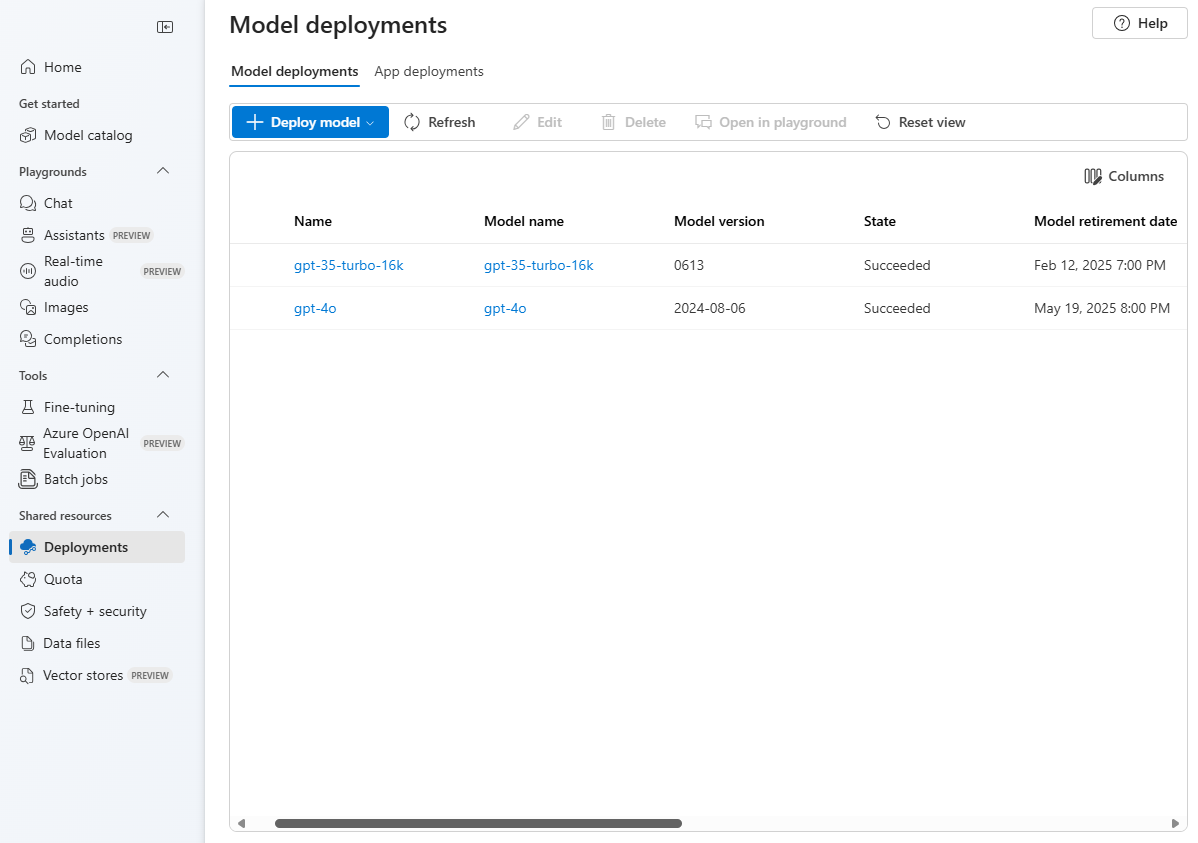

Po pierwszym otwarciu rozwiązania Azure AI Foundry należy przejść do strony Azure OpenAI (gdzie koncentrujesz się tylko na modelach usługi Azure OpenAI ), wybierz zasób, jeśli jeszcze tego nie zrobiono, i wdrożysz pierwszy model. W tym celu wybierz stronę Wdrożenia , z której można wdrożyć model podstawowy i rozpocząć eksperymentowanie z nim.

Uwaga

Jeśli nie jesteś właścicielem zasobu, musisz mieć następujące mechanizmy kontroli dostępu opartej na rolach: 1. Użytkownik openAI usług Cognitive Services: ta rola umożliwia wyświetlanie zasobów i korzystanie z placu zabaw czatu. 2. Współautor openAI usług Cognitive Services: ta rola umożliwia użytkownikowi tworzenie nowych wdrożeń.

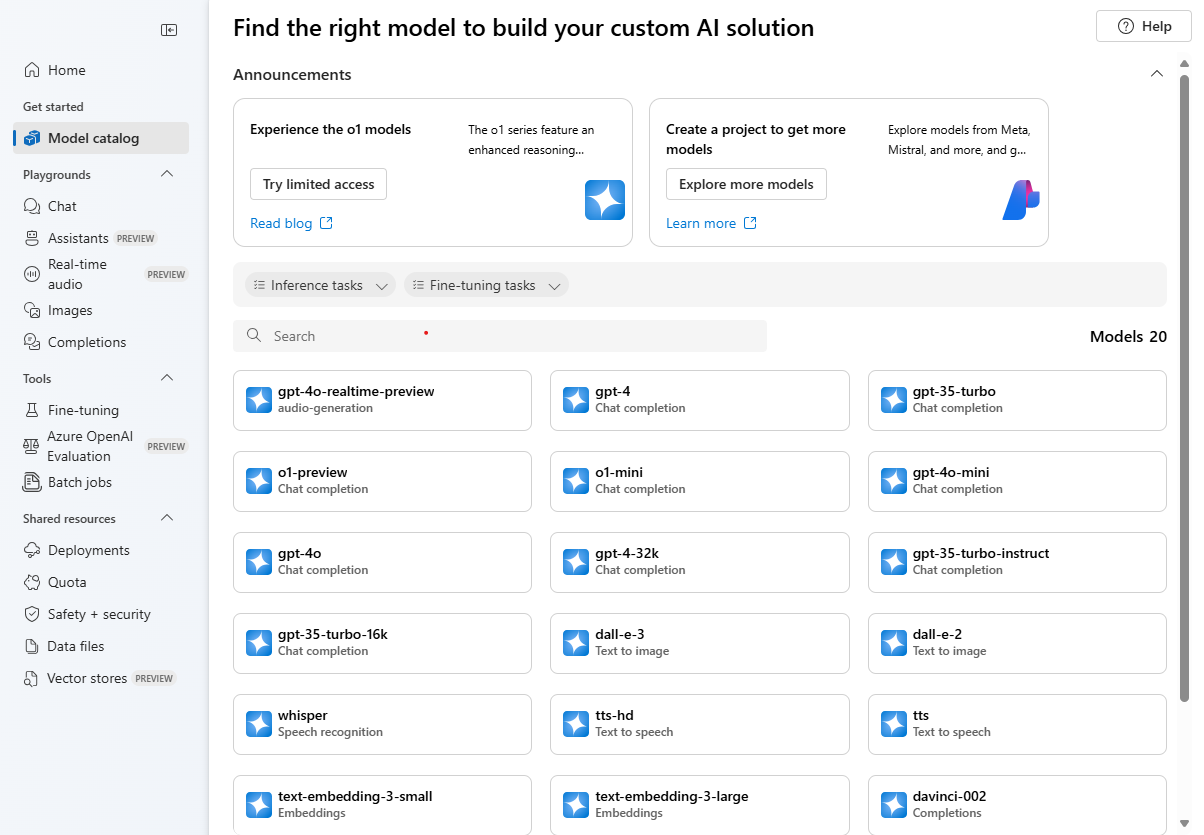

Typy modeli OpenAI

Aby rozpocząć tworzenie za pomocą usługi Azure OpenAI, musisz wybrać model podstawowy i wdrożyć go. Firma Microsoft udostępnia modele podstawowe i opcję tworzenia dostosowanych modeli podstawowych. W tej lekcji omówiono obecnie dostępne modele podstawowe.

Usługa Azure OpenAI obejmuje kilka typów modelu:

- Modele GPT-4 to najnowsza generacja modeli wstępnie wytrenowanych (GPT), które mogą generować języki naturalne i uzupełnianie kodu na podstawie monitów języka naturalnego.

- Modele GPT 3.5 mogą generować języki naturalne i uzupełnianie kodu na podstawie monitów języka naturalnego. W szczególności modele GPT-35-turbo są zoptymalizowane pod kątem interakcji opartych na czacie i działają dobrze w większości scenariuszy generowania sztucznej inteligencji.

- Osadzanie modeli konwertuje tekst na wektory liczbowe i są przydatne w scenariuszach analizy języka, takich jak porównywanie źródeł tekstu pod kątem podobieństw.

- Modele DALL-E są używane do generowania obrazów na podstawie monitów języka naturalnego. Obecnie modele DALL-E są dostępne w wersji zapoznawczej.

- Modele szeptu służą do konwertowania mowy na tekst.

- Modele zamiany tekstu na mowę służą do konwertowania tekstu na mowę.

Uwaga

Ceny są określane według tokenów i według typu modelu. Dowiedz się więcej o najnowszych cenach tutaj.

W portalu usługi Azure AI Foundry na stronie Wykaz modeli znajduje się lista dostępnych modeli podstawowych i dostępna jest opcja tworzenia dodatkowych dostosowanych modeli przez dostrajanie modeli podstawowych. Modele, które mają stan Powodzenie , oznaczają, że zostały pomyślnie wytrenowane i można je wybrać do wdrożenia.

Zauważysz, że istnieją różne modele wykraczające poza platformę OpenAI dostępne w katalogu modeli, w tym modele firmy Microsoft, Meta, Mistral i inne. Usługa Azure AI Foundry umożliwia wdrożenie dowolnego z tych modeli dla danego przypadku użycia. W tym module skupimy się na modelach usługi Azure OpenAI.

Wdrażanie modeli OpenAI

Najpierw należy wdrożyć model na czacie lub wykonywać wywołania interfejsu API w celu odbierania odpowiedzi na monity. Podczas tworzenia nowego wdrożenia należy wskazać, który model podstawowy ma zostać wdrożony. Można wdrożyć dowolną liczbę wdrożeń, o ile ich tokeny na minutę (TPM) pozostają w ramach limitu przydziału wdrożenia.

Wdrażanie przy użyciu rozwiązania Azure AI Foundry

Na stronie wykazu modeli portalu usługi Azure AI Foundry możesz utworzyć nowe wdrożenie, wybierając nazwę modelu z listy.

Wdrażanie przy użyciu interfejsu wiersza polecenia platformy Azure

Model można również wdrożyć przy użyciu konsoli programu . W tym przykładzie zastąp następujące zmienne własnymi wartościami zasobów:

- OAIResourceGroup: zastąp ciąg nazwą grupy zasobów

- MyOpenAIResource: zastąp ciąg nazwą zasobu

- MyModel: zastąp element unikatową nazwą modelu

- gpt-35-turbo: zastąp modelem bazowym, który chcesz wdrożyć

az cognitiveservices account deployment create \

-g OAIResourceGroup \

-n MyOpenAIResource \

--deployment-name MyModel \

--model-name gpt-35-turbo \

--model-version "0125" \

--model-format OpenAI \

--sku-name "Standard" \

--sku-capacity 1

Wdrażanie przy użyciu interfejsu API REST

Model można wdrożyć przy użyciu interfejsu API REST. W treści żądania należy określić model podstawowy, który chcesz wdrożyć. Zobacz przykład w dokumentacji usługi Azure OpenAI.

Eksplorowanie monitów interfejsu OpenAI

Po wdrożeniu modelu możesz przetestować sposób wykonywania monitów. Monit to tekstowa część żądania, która jest wysyłana do punktu końcowego uzupełniania wdrożonego modelu. Odpowiedzi są określane jako uzupełnienia, które mogą mieć postać tekstu, kodu lub innych formatów.

Typy monitów

Monity można pogrupować w typy żądań na podstawie zadania.

| Typ zadania | Przykład monitu | Przykład ukończenia |

|---|---|---|

| Klasyfikowanie zawartości | Tweet: Podobała mi się podróż. Opinia: |

Pozytywna |

| Generowanie nowej zawartości | Wyświetlanie listy sposobów podróży | 1. Rower 2. Samochód ... |

| Trzymanie konwersacji | Przyjazny asystent sztucznej inteligencji | Zobacz przykłady |

| Przekształcanie (tłumaczenie i konwersja symboli) | Angielski: Witaj Francuski: |

Bonjour |

| Podsumowywanie zawartości | Podaj podsumowanie zawartości {text} |

Zawartość udostępnia metody uczenia maszynowego. |

| Pobieranie miejsca, w którym zostało przerwane | Jednym ze sposobów na uprawę pomidorów | jest rośliną nasiona. |

| Udzielanie faktycznych odpowiedzi | Ile księżyców ma Ziemia? | Jeden |

Jakość ukończenia

Kilka czynników wpływa na jakość uzupełniania uzyskanych z generowania rozwiązania sztucznej inteligencji.

- Sposób, w jaki monit jest inżynierowany. Dowiedz się więcej o inżynierii monitów w jednostce Inżynieryjnej monitu w dalszej części tego modułu.

- Parametry modelu (opisane poniżej).

- Dane, na których jest trenowany model, które można dostosować za pomocą dostosowywania modelu.

Masz większą kontrolę nad ukończeniami zwracanym przez trenowanie modelu niestandardowego niż przez inżynierię monitu i korektę parametrów.

Wykonywanie wywołań interfejsu API

Możesz rozpocząć wykonywanie wywołań do wdrożonego modelu za pośrednictwem interfejsu API REST, języka Python lub języka C#. Jeśli wdrożony model ma bazę modelu GPT-3.5 lub GPT-4, skorzystaj z dokumentacji uzupełniania czatu, która zawiera punkty końcowe i zmienne wymagane dla tych modeli podstawowych.

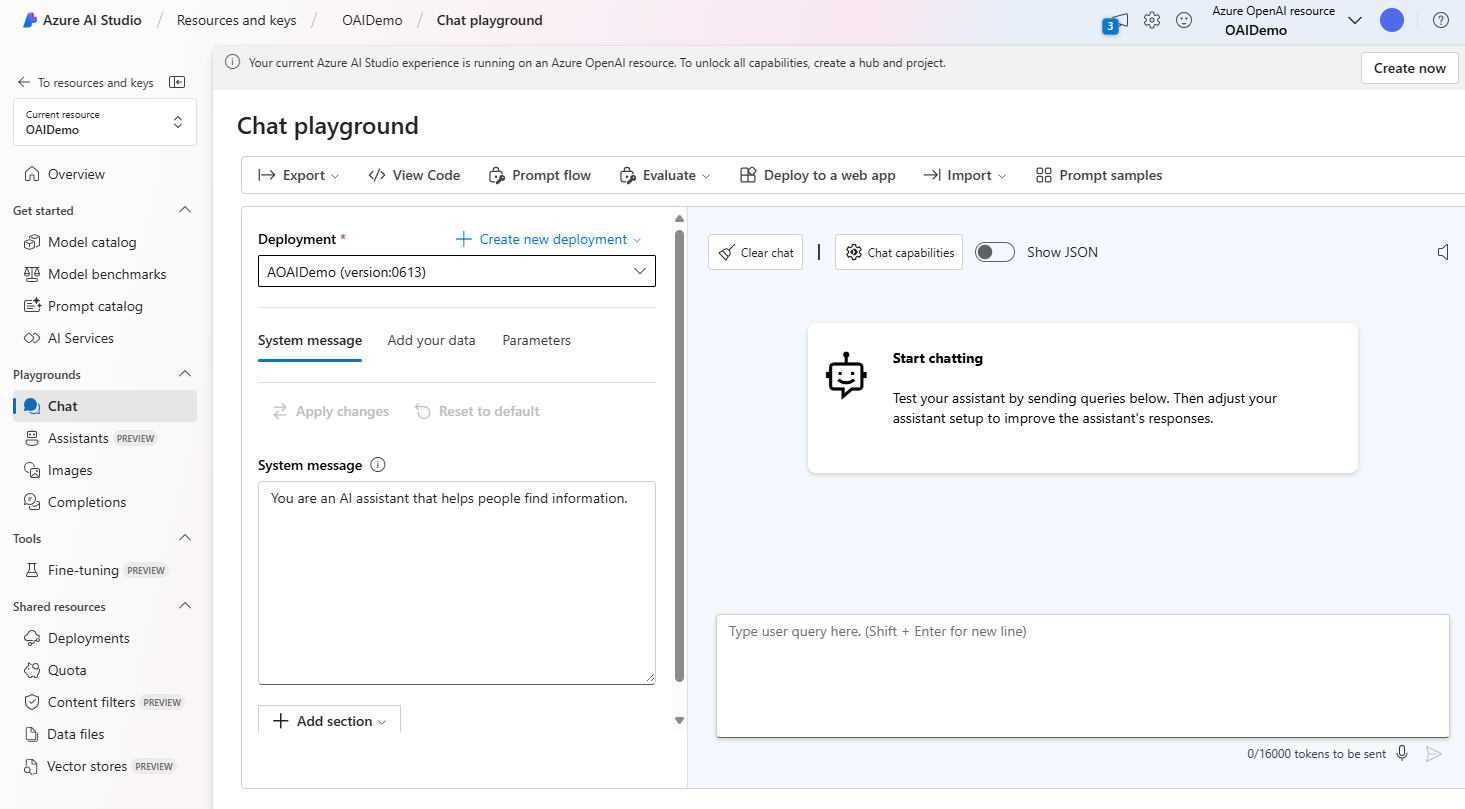

Korzystanie z placu zabaw usługi Azure Studio

Place zabaw to przydatne interfejsy w rozwiązaniu Azure AI Foundry, których można użyć do eksperymentowania z wdrożonym modelem bez konieczności tworzenia własnej aplikacji klienckiej. Portal usługi Azure AI Foundry oferuje wiele placów zabaw z różnymi opcjami dostrajania parametrów.

Czat — plac zabaw

Plac zabaw czatu jest oparty na interfejsie konwersacji i komunikatów. Możesz zainicjować sesję z komunikatem systemowym, aby skonfigurować kontekst czatu.

Na placu zabaw czatu możesz użyć przykładów monitów, dostosować parametry i dodać kilka przykładów. Termin "few-shot" odnosi się do udostępniania kilku przykładów, aby pomóc modelowi dowiedzieć się, co musi zrobić. Można o tym myśleć w przeciwieństwie do zero-shot, który odnosi się do dostarczania żadnych przykładów.