Przetwarzanie danych IoT w czasie rzeczywistym na platformie Apache Flink® przy użyciu usługi Azure HDInsight w usłudze AKS

Azure IoT Hub to zarządzana usługa hostowana w chmurze, która działa jako centralne centrum komunikatów do komunikacji między aplikacją IoT a dołączonymi urządzeniami. Miliony urządzeń i ich rozwiązań zaplecza można połączyć niezawodnie i bezpiecznie. Prawie każde urządzenie może być połączone z centrum IoT Hub.

W tym przykładzie kod na platformie Apache Flink® przetwarza dane IoT w czasie rzeczywistym przy użyciu usługi Azure HDInsight w środowisku AKS i zapisuje do magazynu ADLS Gen2.

Warunki wstępne

- Utwórz usługę Azure IoTHub

- Tworzenie klastra Flink 1.17.0 na platformie HDInsight na platformie AKS

- Uzyskaj dostęp do usługi ADLS Gen2 przy użyciu tożsamości zarządzanej.

- IntelliJ na potrzeby programowania

Notatka

Na potrzeby tej demonstracji używamy maszyny wirtualnej z systemem Windows jako środowiska deweloperskiego projektu Maven w tej samej sieci wirtualnej co usługa HDInsight w usłudze AKS.

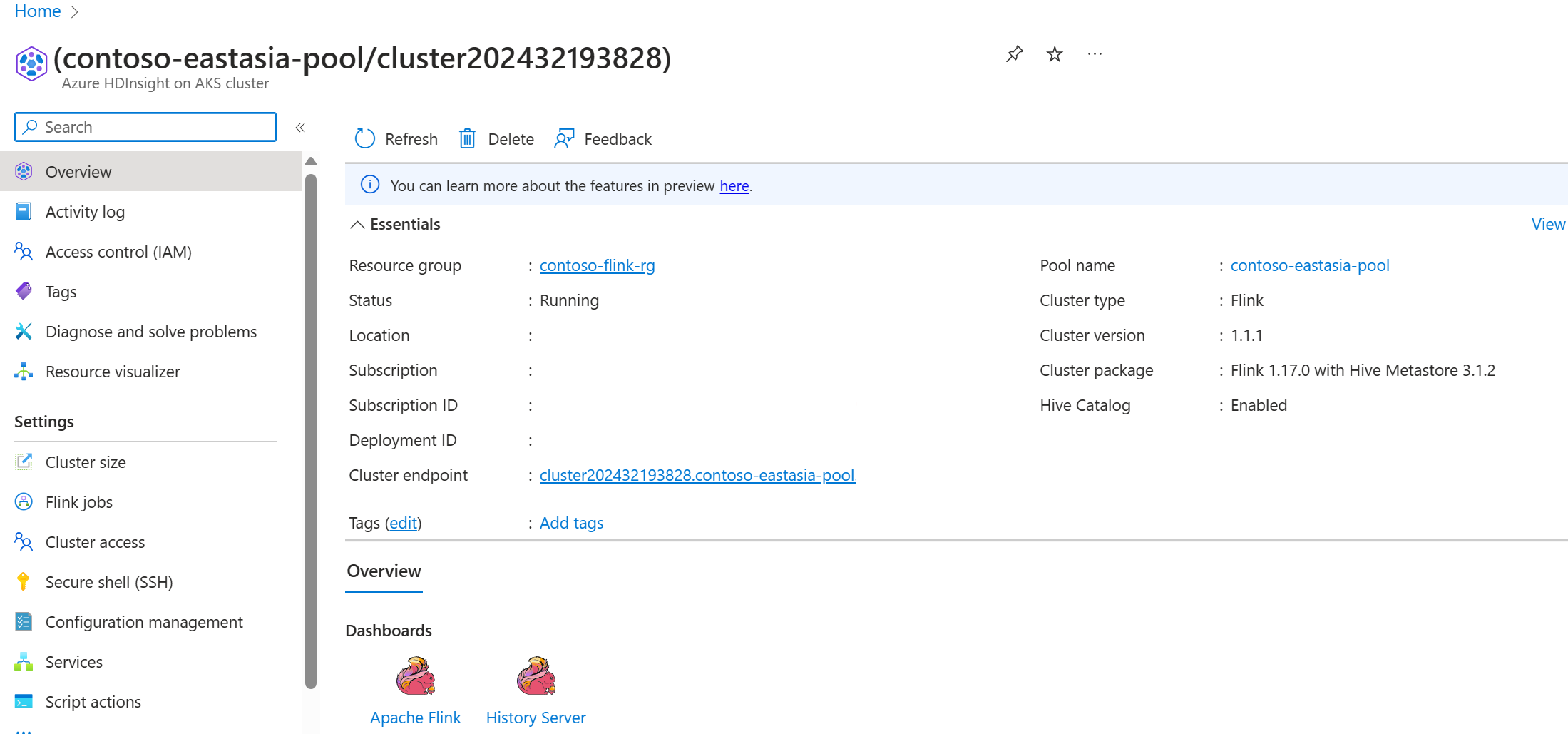

Klaster Flink 1.17.0 działający na HDInsight na AKS

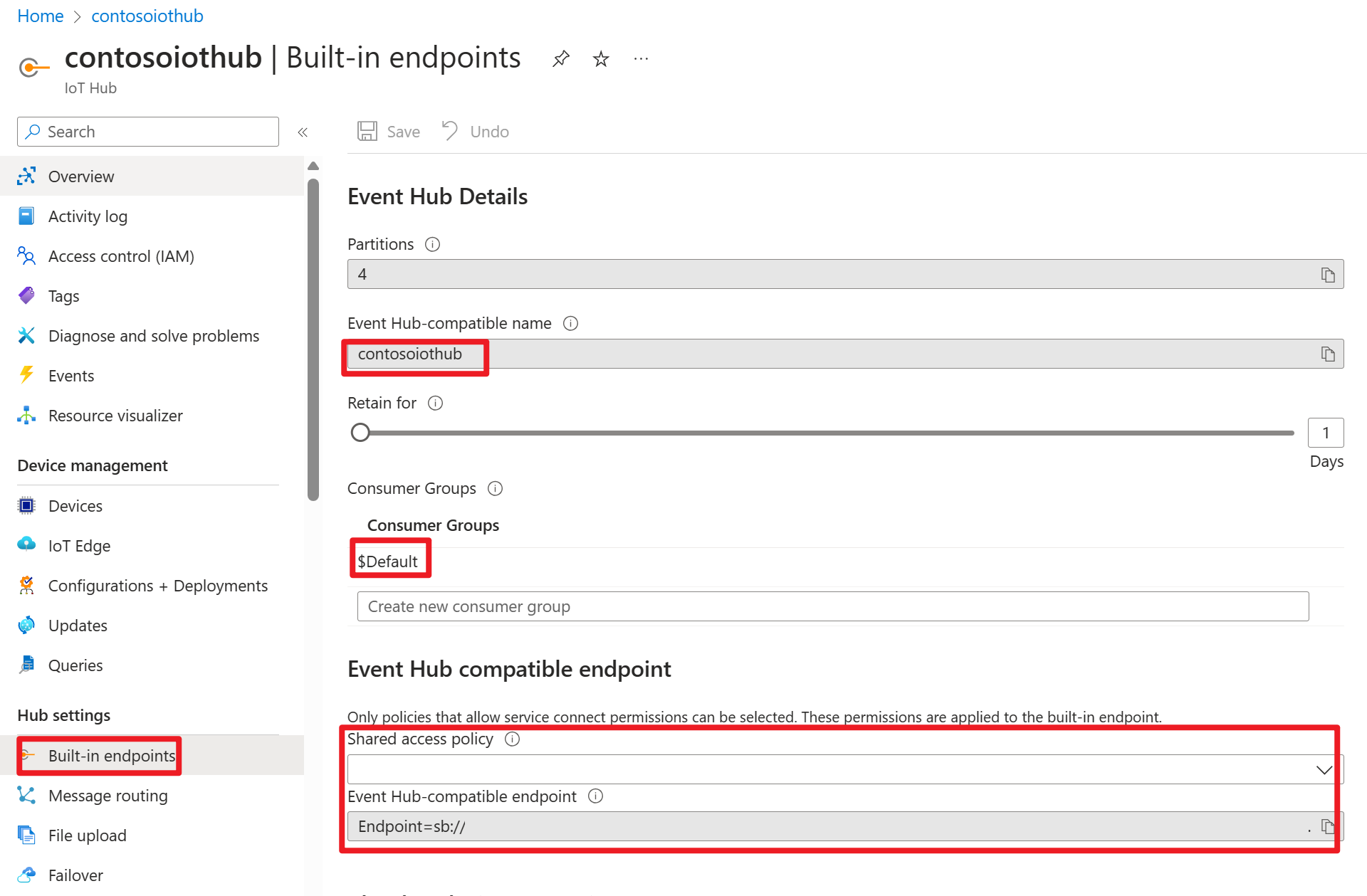

Usługa Azure IOT Hub w witrynie Azure Portal

W parametrach połączenia można znaleźć adres URL magistrali usług (adres URL podstawowej przestrzeni nazw centrum zdarzeń), który należy dodać jako serwer bootstrap w źródle platformy Kafka. W tym przykładzie jest to iothub-ns-contosoiot-55642726-4642a54853.servicebus.windows.net:9093.

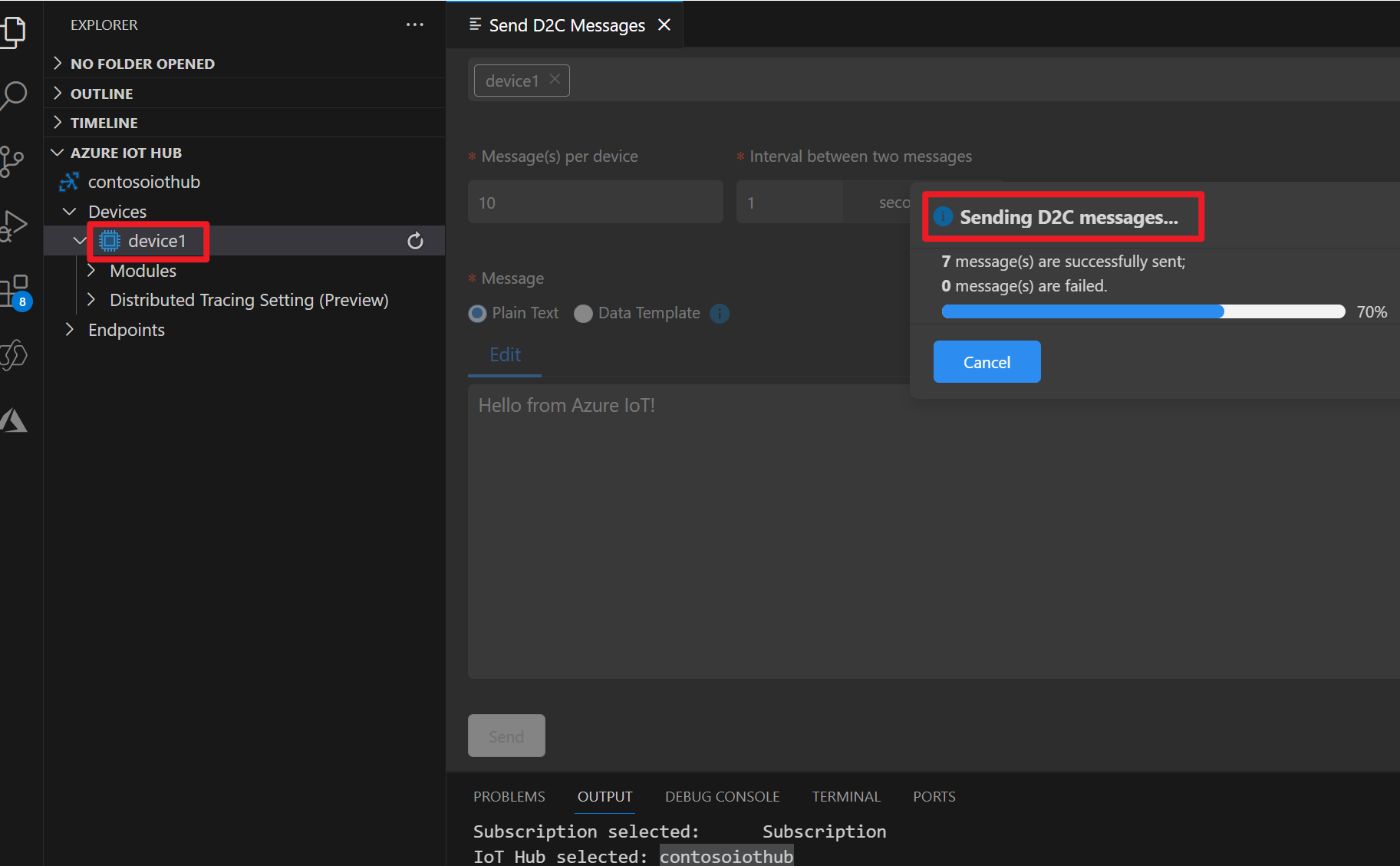

Przygotowywanie komunikatu do urządzenia Azure IOT

Każde centrum IoT zawiera wbudowane punkty końcowe systemu do obsługi komunikatów systemu i urządzeń.

Aby uzyskać więcej informacji, zobacz Jak używać programu VS Code jako symulatora urządzenia usługi IoT Hub.

Kod w Flink

IOTdemo.java

KafkaSource: usługa IoTHub jest oparta na centrum zdarzeń, dlatego obsługuje interfejs API przypominający platformę Kafka. Dlatego w naszym zadaniu Apache Flink możemy zdefiniować KafkaSource z odpowiednimi parametrami do pobierania komunikatów z usługi IoTHub.

FileSink: zdefiniuj ujście ABFS.

package contoso.example

import org.apache.flink.api.common.eventtime.WatermarkStrategy;

import org.apache.flink.api.common.serialization.SimpleStringEncoder;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.client.program.StreamContextEnvironment;

import org.apache.flink.configuration.MemorySize;

import org.apache.flink.connector.file.sink.FileSink;

import org.apache.flink.connector.kafka.source.KafkaSource;

import org.apache.flink.connector.kafka.source.enumerator.initializer.OffsetsInitializer;

import org.apache.flink.core.fs.Path;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.functions.sink.filesystem.rollingpolicies.DefaultRollingPolicy;

import org.apache.kafka.clients.consumer.OffsetResetStrategy;

import java.time.Duration;

public class IOTdemo {

public static void main(String[] args) throws Exception {

// create execution environment

StreamExecutionEnvironment env = StreamContextEnvironment.getExecutionEnvironment();

String connectionString = "<your iot hub connection string>";

KafkaSource<String> source = KafkaSource.<String>builder()

.setBootstrapServers("<your iot hub's service bus url>:9093")

.setTopics("<name of your iot hub>")

.setGroupId("$Default")

.setProperty("partition.discovery.interval.ms", "10000")

.setProperty("security.protocol", "SASL_SSL")

.setProperty("sasl.mechanism", "PLAIN")

.setProperty("sasl.jaas.config", String.format("org.apache.kafka.common.security.plain.PlainLoginModule required username=\"$ConnectionString\" password=\"%s\";", connectionString))

.setStartingOffsets(OffsetsInitializer.committedOffsets(OffsetResetStrategy.EARLIEST))

.setValueOnlyDeserializer(new SimpleStringSchema())

.build();

DataStream<String> kafka = env.fromSource(source, WatermarkStrategy.noWatermarks(), "Kafka Source");

String outputPath = "abfs://<container>@<account_name>.dfs.core.windows.net/flink/data/azureiothubmessage/";

final FileSink<String> sink = FileSink

.forRowFormat(new Path(outputPath), new SimpleStringEncoder<String>("UTF-8"))

.withRollingPolicy(

DefaultRollingPolicy.builder()

.withRolloverInterval(Duration.ofMinutes(2))

.withInactivityInterval(Duration.ofMinutes(3))

.withMaxPartSize(MemorySize.ofMebiBytes(5))

.build())

.build();

kafka.sinkTo(sink);

env.execute("Sink Azure IOT hub to ADLS gen2");

}

}

Maven pom.xml

<groupId>contoso.example</groupId>

<artifactId>FlinkIOTDemo</artifactId>

<version>1.0-SNAPSHOT</version>

<properties>

<maven.compiler.source>1.8</maven.compiler.source>

<maven.compiler.target>1.8</maven.compiler.target>

<flink.version>1.17.0</flink.version>

<java.version>1.8</java.version>

<scala.binary.version>2.12</scala.binary.version>

</properties>

<dependencies>

<!-- https://mvnrepository.com/artifact/org.apache.flink/flink-streaming-java -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-java</artifactId>

<version>${flink.version}</version>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java</artifactId>

<version>${flink.version}</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.flink/flink-clients -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-clients</artifactId>

<version>${flink.version}</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.flink/flink-connector-files -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-files</artifactId>

<version>${flink.version}</version>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-kafka</artifactId>

<version>${flink.version}</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-assembly-plugin</artifactId>

<version>3.0.0</version>

<configuration>

<appendAssemblyId>false</appendAssemblyId>

<descriptorRefs>

<descriptorRef>jar-with-dependencies</descriptorRef>

</descriptorRefs>

</configuration>

<executions>

<execution>

<id>make-assembly</id>

<phase>package</phase>

<goals>

<goal>single</goal>

</goals>

</execution>

</executions>

</plugin>

</plugins>

</build>

</project>

Opakuj plik jar i prześlij zadanie w klastrze Flink

Przekaż plik jar do zasobnika webssh i prześlij plik jar.

user@sshnode-0 [ ~ ]$ bin/flink run -c IOTdemo -j FlinkIOTDemo-1.0-SNAPSHOT.jar

SLF4J: Failed to load class "org.slf4j.impl.StaticLoggerBinder".

SLF4J: Defaulting to no-operation (NOP) logger implementation

SLF4J: See http://www.slf4j.org/codes.html#StaticLoggerBinder for further details.

Job has been submitted with JobID de1931b1c1179e7530510b07b7ced858

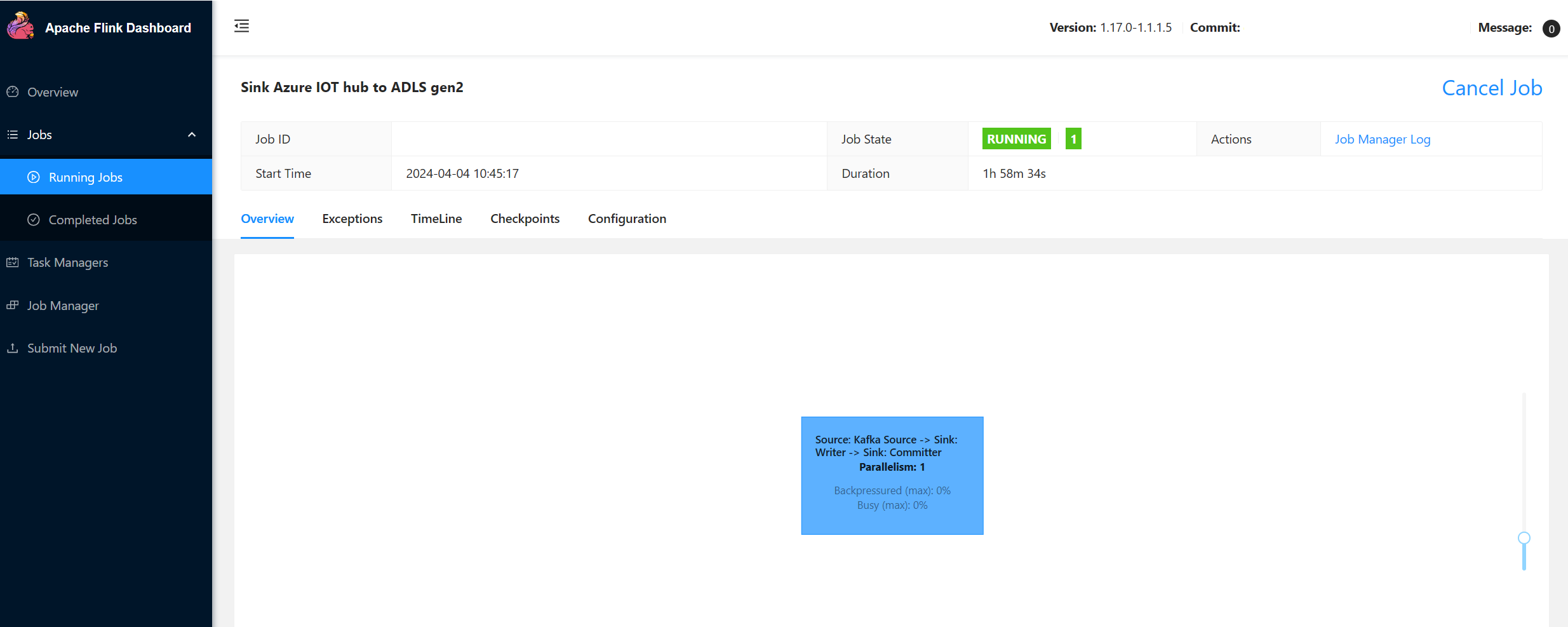

Sprawdź zadanie w interfejsie użytkownika Flink Dashboard.

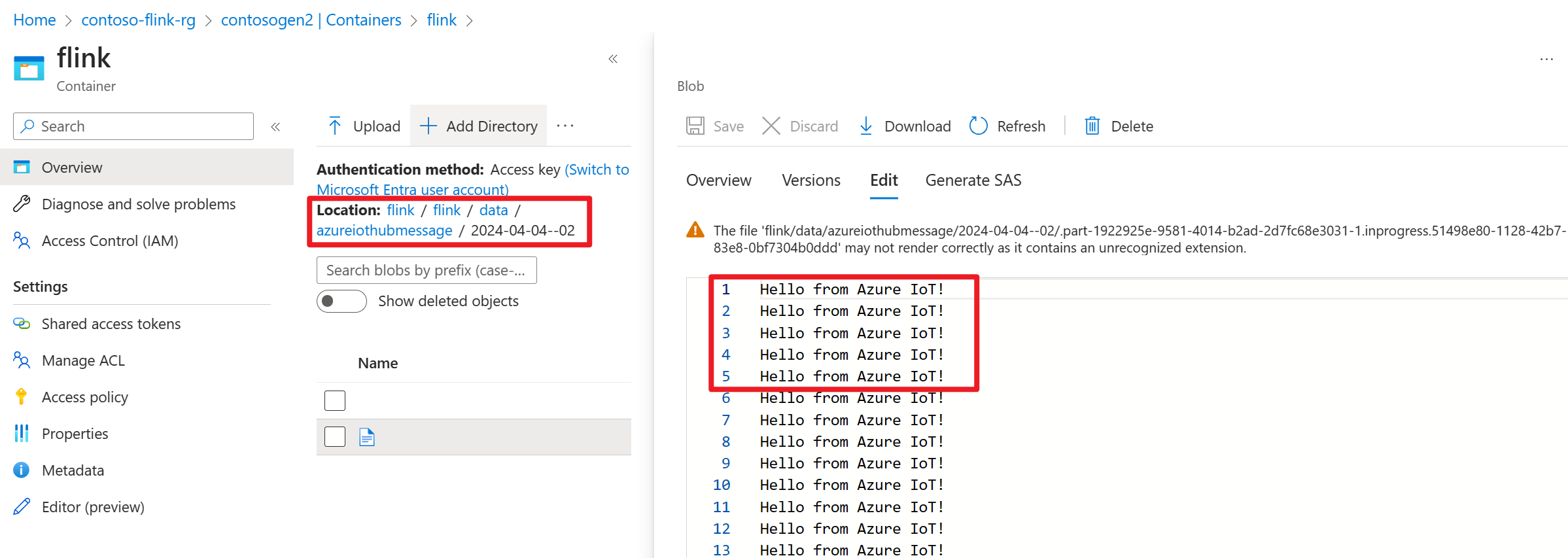

Sprawdź wynik w usłudze ADLS gen2 na portalu Azure

Odniesienie

- Strona internetowa Apache Flink

- Nazwy projektów Apache, Apache Kafka, Kafka, Apache Flink, Flink i powiązanych projektów open source są znakami towarowymiApache Software Foundation (ASF).