Uwaga

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

Akcelerator strefy docelowej usługi Azure API Management zapewnia podejście architektoniczne i implementację referencyjną w celu przygotowania subskrypcji strefy docelowej do skalowalnej infrastruktury usługi API Management. Implementacja jest zgodna z architekturą i najlepszymi praktykami ram Cloud Adoption Framework dla stref startowych Azure, koncentrując się na zasadach projektowania stref startowych w skali przedsiębiorstwa.

Klienci wdrażają usługę API Management na różne sposoby. Możesz użyć tej architektury jako wytyczne projektowe dla implementacji greenfield i jako oceny implementacji brownfield, które już używają usługi API Management. Możesz dostosować implementację referencyjną, aby utworzyć architekturę pasującą do Twojego obciążenia i umieścić organizację na ścieżce do zrównoważonej skali.

Udostępniony szablon infrastruktury jako kodu (IaC) można zmodyfikować tak, aby pasował do konwencji nazewnictwa, używać istniejących zasobów, takich jak agenci usługi Azure DevOps i azure Key Vault, i rozszerzać je na różne zaplecza. Można na przykład dodawać połączenia do interfejsów API hostowanych w usłudze Azure App Service lub Azure Kubernetes Service (AKS).

Implementowanie podstaw platformy

Akcelerator strefy docelowej usługi API Management zakłada, że fundament pod platformę jest już na miejscu. Ta fundacja obsługuje usługi współdzielone, takie jak sieć, bezpieczeństwo, tożsamość i usługi zarządzania. Te usługi są wymagane do efektywnego konstruowania i operacjonalizacji strefy docelowej w skali przedsiębiorstwa i zapewnienia pomyślnego wdrożenia. Fundament platformy nie jest obowiązkowy podczas implementacji akceleratora strefy lądowania usługi API Management, ale zapewnia wiele zabezpieczeń i zarządzania niezbędnych do bezpiecznego zarządzania środowiskiem chmurowym. Jeśli masz go już, możesz pominąć ten krok. Aby uzyskać więcej informacji, zobacz następujące artykuły:

Co zapewnia akcelerator strefy docelowej usługi API Management

Podejście akceleratora strefy docelowej zapewnia wiele scenariuszy i następujących zasobów do obsługi projektu:

Modułowe podejście umożliwiające dostosowanie zmiennych środowiskowych.

Wskazówki dotyczące projektowania ułatwiające ocenę krytycznych decyzji.

Architektura strefy docelowej.

Implementacja obejmująca następujące elementy:

Szablon, który umożliwia wdrożenie usługi API Management z bezpieczną konfiguracją bazową, bez zapleczy i z przykładowym interfejsem API.

Implementacja referencyjna usługi API Management zatwierdzona przez firmę Microsoft w celu przetestowania wdrożonego środowiska.

Scenariusz bramy generatywnej sztucznej inteligencji, który jest wdrażany na wierzchu bezpiecznej linii bazowej. Wdrożenie udostępnia punkty końcowe usługi Azure OpenAI jako elementy zaplecza oraz aprowizuje interfejs API dostępny dla klienta, który może obsługiwać różne funkcje odciążania bramy. Obowiązki obejmują równoważenie obciążenia wielu punktów końcowych usługi Azure OpenAI, śledzenie użycia tokenów, implementowanie adaptacyjnego ograniczania szybkości i zarządzanie nagłymi wzrostami obciążeń w ramach modeli rozliczeniowych płatności zgodnie z rzeczywistym użyciem.

Wytyczne dotyczące projektowania

Poniższe artykuły zawierają wskazówki dotyczące tworzenia strefy docelowej na podstawie obszarów projektowych stref docelowych platformy Azure:

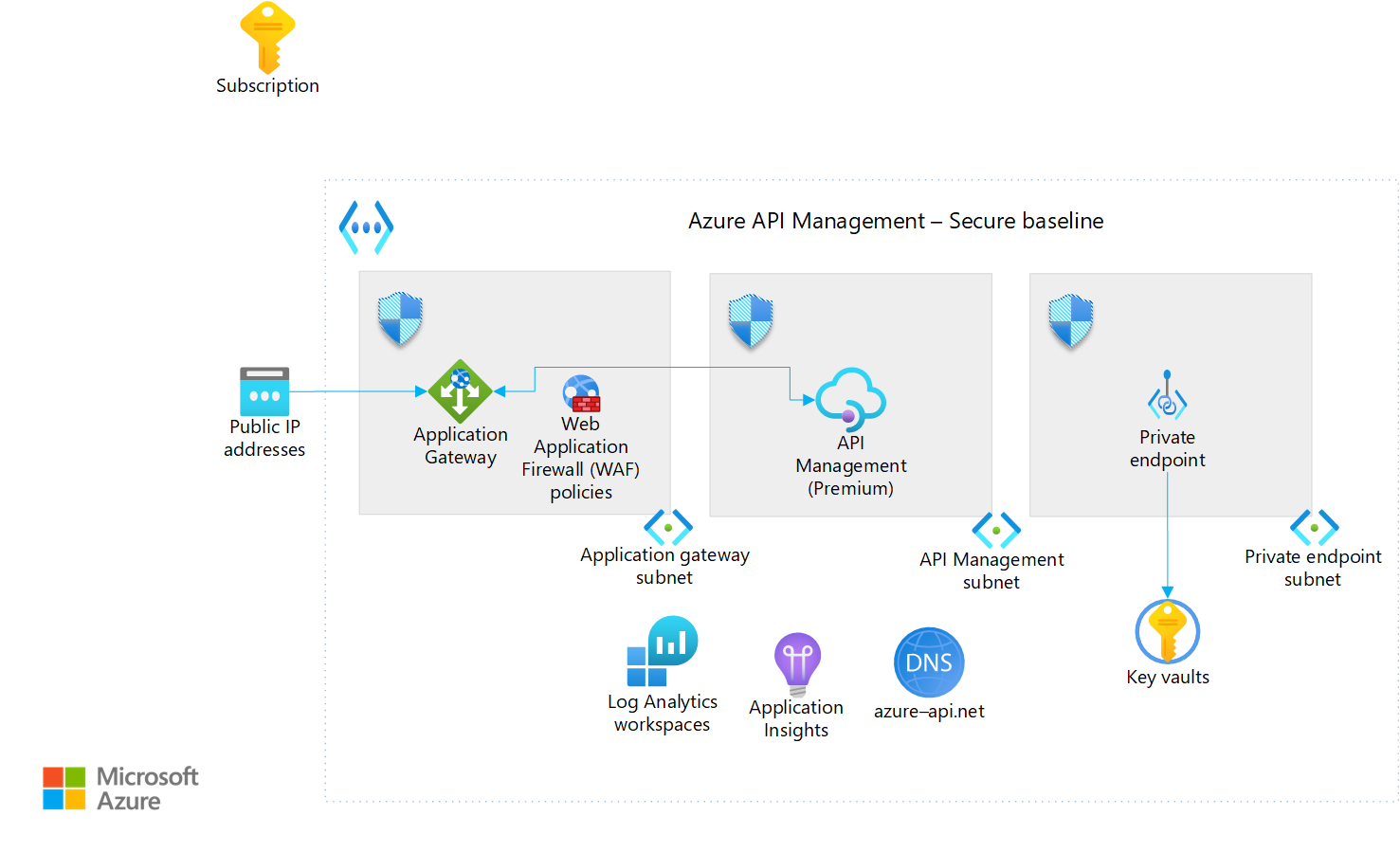

Przykładowa architektura referencyjna koncepcyjna

Poniższa architektura referencyjna koncepcyjna to przykład przedstawiający obszary projektowania i najlepsze rozwiązania.

Ta architektura składa się z usługi API Management wdrożonej w sieci wirtualnej w trybie wewnętrznym i jest frontonowana przez usługę Application Gateway.

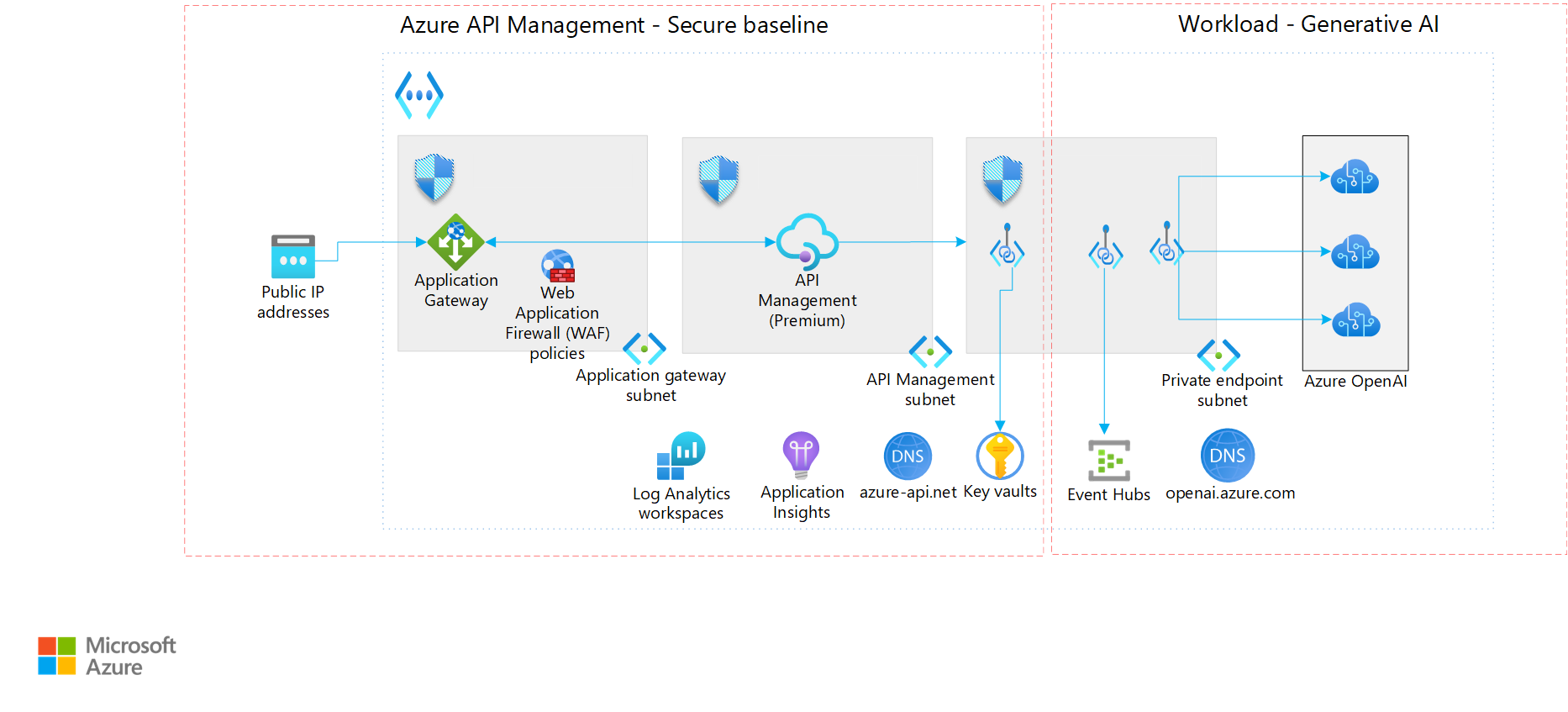

Scenariusz platformy generatywnej sztucznej inteligencji

Przykładowy kod bramy generowania sztucznej inteligencji opisuje sposób aprowizowania zasobów generacyjnych sztucznej inteligencji i interakcji z nimi za pośrednictwem usługi API Management. Odciążanie bramy sieciowej jest typowym wzorcem projektowym podczas interakcji z modelami generatywnymi AI. Aby uzyskać więcej informacji na temat tego wzorca, zobacz Access Azure OpenAI and other language models through a gateway (Uzyskiwanie dostępu do usługi Azure OpenAI i innych modeli językowych za pośrednictwem bramy). Implementacja opiera się na podstawowej warstwie usługi API Management i obejmuje prywatne wdrożenia endpointów usługi Azure OpenAI. Obejmuje ona również zasady usługi API Management dostosowane specjalnie do generowania przypadków użycia sztucznej inteligencji.

Skorzystaj z przewodnika wdrażania, aby wdrożyć prywatne punkty końcowe usługi Azure OpenAI i określony zestaw zasad punktów końcowych w usłudze API Management, aby zarządzać ruchem do tych punktów końcowych. Przetestuj zasady, wysyłając żądania do bramy. Należy użyć podanych fragmentów zasad lub zmodyfikować rozwiązanie, aby uwzględnić własne zasady niestandardowe.

Zalecaną metodą wdrożenia przedsiębiorstwa jest rozpoczęcie od miejsca docelowego Azure, aby upewnić się, że skalowalność, zarządzanie i bezpieczeństwo są zgodne z zalecanymi praktykami Framework Adopcji Chmury. Jeśli planujesz rozpocząć integrację linii bazowej z usługą Azure OpenAI w strefie wdrożeniowej Azure, wykonaj kroki opisane w punkcie odniesienia usługi Azure OpenAI w strefie wdrożeniowej aplikacji.

Wdrażanie akceleratora strefy docelowej usługi API Management

Implementacja akceleratora strefy docelowej usługi API Management z szablonami IaC jest dostępna w witrynie GitHub.

Następny krok

Dowiedz się więcej na temat zagadnień projektowych dotyczących zarządzania tożsamościami i dostępem w strefach docelowych platformy Azure.