Quickstart: Gegevens transformeren met apache Spark-taakdefinitie

In deze quickstart gebruikt u Azure Synapse Analytics om een pijplijn te maken met behulp van de Apache Spark-taakdefinitie.

Vereisten

- Azure-abonnement: Als u geen Azure-abonnement hebt, maakt u een gratis Azure-account voordat u begint.

- Azure Synapse-werkruimte: Maak een Synapse-werkruimte met behulp van Azure Portal aan de hand van de instructies in quickstart: Een Synapse-werkruimte maken.

- Apache Spark-taakdefinitie: Maak een Apache Spark-taakdefinitie in de Synapse-werkruimte volgens de instructies in zelfstudie: Apache Spark-taakdefinitie maken in Synapse Studio.

Ga naar Synapse Studio

Wanneer uw Azure Synapse-werkruimte is gemaakt, kunt u Synapse Studio op twee manieren openen:

- Open de Synapse-werkruimte in de Azure-portal. Selecteer Openen op de kaart Synapse Studio openen onder Aan de slag.

- Open Azure Synapse Analytics en meld u aan bij uw werkruimte.

In deze quickstart gebruiken we de werkruimte met de naam 'sampletest' als voorbeeld.

Een pijplijn maken met een Apache Spark-taakdefinitie

Een pijplijn bevat de logische stroom voor het uitvoeren van een reeks activiteiten. In deze sectie maakt u een pijplijn die een Apache Spark-taakdefinitieactiviteit bevat.

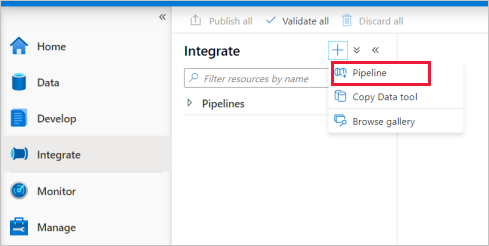

Ga naar het tabblad Integreren . Selecteer het pluspictogram naast de kop van de pijplijnen en selecteer Pijplijn.

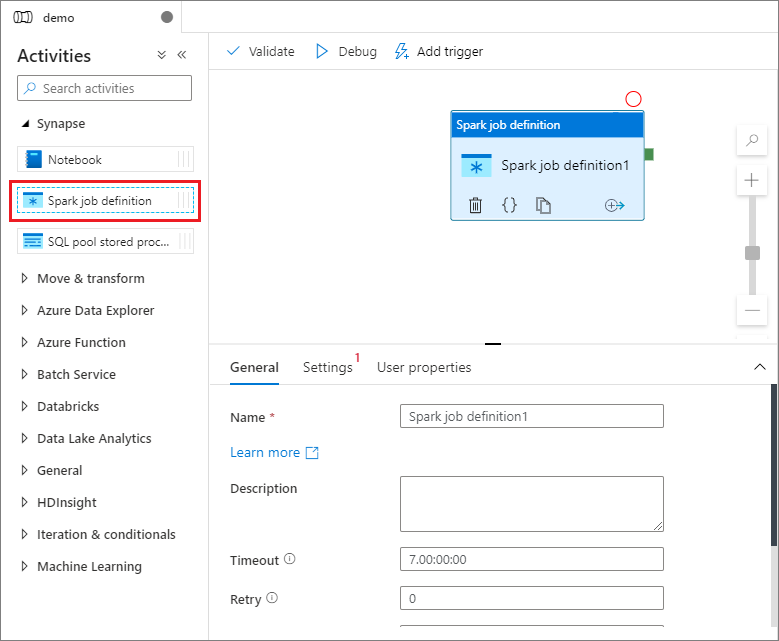

Voer op de pagina Eigenschappen-instellingen van de pijplijn demo in voor Naam.

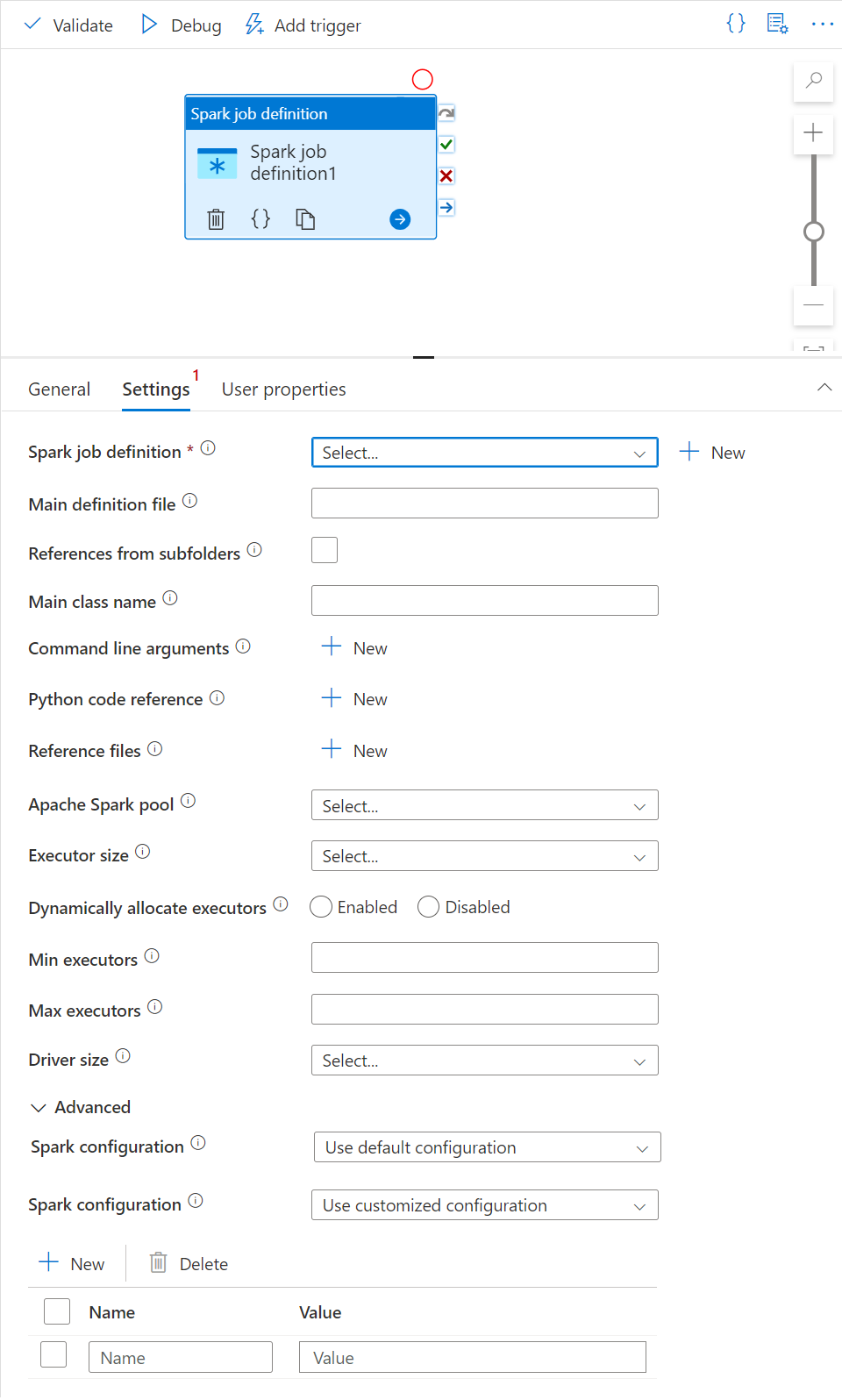

Sleep onder Synapse in het deelvenster Activiteiten de Spark-taakdefinitie naar het pijplijncanvas.

Canvas voor Apache Spark-taakdefinitie instellen

Zodra u uw Apache Spark-taakdefinitie hebt gemaakt, wordt u automatisch verzonden naar het Canvas van de Spark-taakdefinitie.

Algemene instellingen

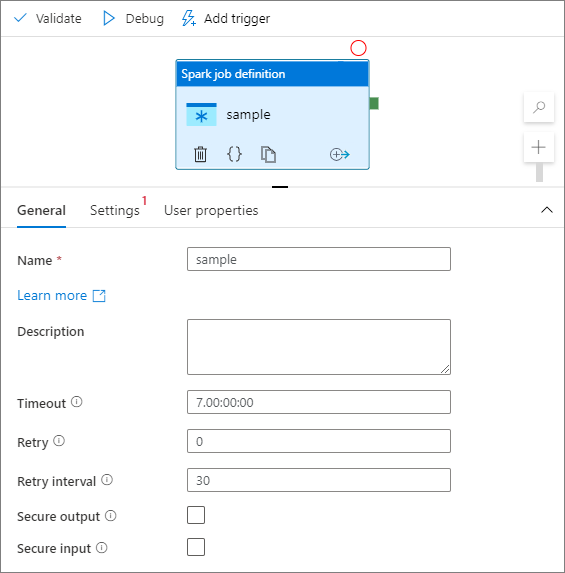

Selecteer de spark-taakdefinitiemodule op het canvas.

Voer op het tabblad Algemeen voorbeeld in voor Naam.

(Optie) U kunt ook een beschrijving invoeren.

Time-out: De maximale hoeveelheid tijd die een activiteit kan uitvoeren. De standaardwaarde is zeven dagen, wat ook de maximale hoeveelheid tijd is die is toegestaan. De indeling is in D.HH:MM:SS.

Opnieuw proberen: maximum aantal nieuwe pogingen.

Interval voor opnieuw proberen: het aantal seconden tussen elke nieuwe poging.

Beveiligde uitvoer: wanneer deze optie is ingeschakeld, wordt de uitvoer van de activiteit niet vastgelegd in logboekregistratie.

Beveiligde invoer: wanneer deze optie is ingeschakeld, wordt invoer van de activiteit niet vastgelegd in logboekregistratie.

Tabblad Instellingen

In dit deelvenster kunt u verwijzen naar de Spark-taakdefinitie die moet worden uitgevoerd.

Vouw de lijst met Spark-taakdefinities uit. U kunt een bestaande Apache Spark-taakdefinitie kiezen. U kunt ook een nieuwe Apache Spark-taakdefinitie maken door de knop Nieuw te selecteren om te verwijzen naar de Spark-taakdefinitie die moet worden uitgevoerd.

(Optioneel) U kunt informatie invullen voor de Apache Spark-taakdefinitie. Als de volgende instellingen leeg zijn, worden de instellingen van de Spark-taakdefinitie zelf gebruikt om uit te voeren; als de volgende instellingen niet leeg zijn, vervangen deze instellingen de instellingen van de Spark-taakdefinitie zelf.

Eigenschappen Beschrijving Primair definitiebestand Het primaire bestand dat wordt gebruikt voor de taak. Selecteer een PY/JAR/ZIP-bestand in uw opslag. U kunt Bestand uploaden selecteren om het bestand te uploaden naar een opslagaccount.

Voorbeeld:abfss://…/path/to/wordcount.jarVerwijzingen uit submappen Submappen scannen vanuit de hoofdmap van het hoofddefinitiebestand. Deze bestanden worden toegevoegd als referentiebestanden. De mappen met de naam 'jars', 'pyFiles', 'files' of 'archieven' worden gescand en de naam van de mappen is hoofdlettergevoelig. Hoofdklassenaam De volledig gekwalificeerde id of de hoofdklasse die zich in het hoofddefinitiebestand bevindt.

Voorbeeld:WordCountOpdrachtregelargumenten U kunt opdrachtregelargumenten toevoegen door op de knop Nieuw te klikken. Er moet worden opgemerkt dat het toevoegen van opdrachtregelargumenten de opdrachtregelargumenten overschrijft die zijn gedefinieerd door de Spark-taakdefinitie.

Monster:abfss://…/path/to/shakespeare.txtabfss://…/path/to/resultApache Spark-pool U kunt Een Apache Spark-pool selecteren in de lijst. Naslaginformatie over Python-code Andere Python-codebestanden die worden gebruikt voor referentie in het hoofddefinitiebestand.

Het ondersteunt het doorgeven van bestanden (.py, .py3, .zip) aan de eigenschap 'pyFiles'. Hiermee wordt de eigenschap 'pyFiles' overschreven die is gedefinieerd in de Spark-taakdefinitie.Verwijzingsbestanden Andere bestanden die worden gebruikt voor verwijzing in het hoofddefinitiebestand. Uitvoerders dynamisch toewijzen Deze instelling wordt toegewezen aan de eigenschap dynamische toewijzing in de Spark-configuratie voor toewijzing van spark-toepassingsexecutors. Min.uitvoerders Minimum aantal uitvoerders dat moet worden toegewezen in de opgegeven Spark-pool voor de taak. Maximum aantal uitvoerders Maximum aantal uitvoerders dat moet worden toegewezen in de opgegeven Spark-pool voor de taak. Grootte van stuurprogramma Aantal kernen en het geheugen die moet worden gebruikt voor het stuurprogramma dat in de gespecificeerde Apache Spark-pool voor de taak is opgegeven. Spark-configuratie Geef waarden op voor Spark-configuratie-eigenschappen die worden vermeld in het artikel: Spark-configuratie - toepassingseigenschappen. Gebruikers kunnen standaardconfiguratie en aangepaste configuratie gebruiken.

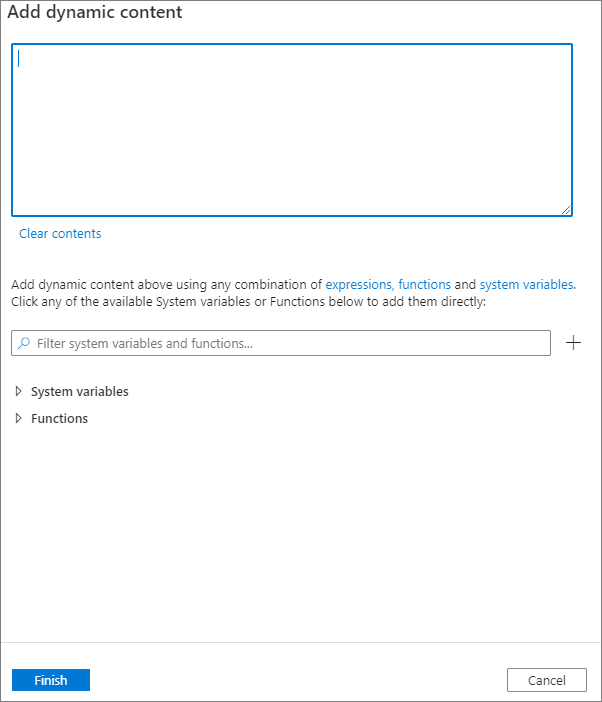

U kunt dynamische inhoud toevoegen door te klikken op de knop Dynamische inhoud toevoegen of door op alt+ Shift+D te drukken. Op de pagina Dynamische inhoud toevoegen kunt u elke combinatie van expressies, functies en systeemvariabelen gebruiken om aan dynamische inhoud toe te voegen.

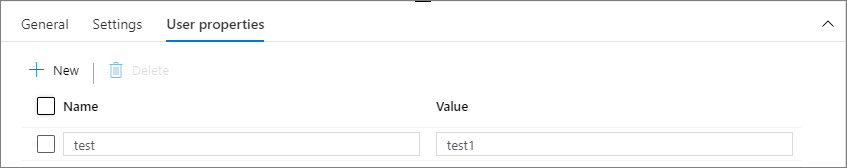

Tabblad Gebruikerseigenschappen

U kunt eigenschappen toevoegen voor activiteit in apache Spark-taakdefinities in dit deelvenster.

Gerelateerde inhoud

Ga naar de volgende artikelen voor meer informatie over ondersteuning voor Azure Synapse Analytics: