Modellen buiten Azure Machine Learning verpakken en implementeren (preview)

U kunt modellen buiten Azure Machine Learning implementeren voor onlinebediening door modelpakketten (preview) te maken. Met Azure Machine Learning kunt u een modelpakket maken waarmee alle afhankelijkheden worden verzameld die vereist zijn voor het implementeren van een machine learning-model op een serviceplatform. U kunt een modelpakket verplaatsen tussen werkruimten en zelfs buiten Azure Machine Learning. Zie Modelpakketten voor implementatie (preview) voor meer informatie over modelpakketten.

Belangrijk

Deze functie is momenteel beschikbaar als openbare preview-versie. Deze preview-versie wordt geleverd zonder een service level agreement en we raden deze niet aan voor productieworkloads. Misschien worden bepaalde functies niet ondersteund of zijn de mogelijkheden ervan beperkt.

Zie Aanvullende gebruiksvoorwaarden voor Microsoft Azure-previews voor meer informatie.

In dit artikel leert u hoe u een model verpakt en implementeert in een Azure-app Service.

Vereisten

Voordat u de stappen in dit artikel volgt, moet u ervoor zorgen dat u over de volgende vereisten beschikt:

Een Azure-abonnement. Als u nog geen abonnement op Azure hebt, maak dan een gratis account aan voordat u begint. Probeer de gratis of betaalde versie van Azure Machine Learning.

Een Azure Machine Learning-werkruimte. Als u nog geen werkruimte hebt, gebruikt u de stappen in het artikel Werkruimten beheren om er een te maken.

Notitie

Werkruimten waarvoor Private Link is ingeschakeld, bieden geen ondersteuning voor verpakkingsmodellen voor implementatie buiten Azure Machine Learning.

Op rollen gebaseerd toegangsbeheer van Azure (Azure RBAC) wordt gebruikt om toegang te verlenen tot bewerkingen in Azure Machine Learning. Als u de stappen in dit artikel wilt uitvoeren, moet aan uw gebruikersaccount de rol eigenaar of inzender voor de Azure Machine Learning-werkruimte of een aangepaste rol worden toegewezen. Zie Toegang tot een Azure Machine Learning-werkruimte beheren voor meer informatie.

Uw systeem voorbereiden

Volg deze stappen om uw systeem voor te bereiden.

Het voorbeeld in dit artikel is gebaseerd op codevoorbeelden in de opslagplaats azureml-examples . Als u de opdrachten lokaal wilt uitvoeren zonder YAML en andere bestanden te hoeven kopiëren/plakken, kloont u eerst de opslagplaats en wijzigt u vervolgens mappen in de map:

git clone https://github.com/Azure/azureml-examples --depth 1 cd azureml-examples/cliIn dit artikel wordt het voorbeeld gebruikt in de mapeindpunten /online/deploy-with-packages/mlflow-model.

Maak verbinding met de Azure Machine Learning-werkruimte waar u uw werk gaat doen.

Voor pakketten moet het model worden geregistreerd in uw werkruimte of in een Azure Machine Learning-register. In dit voorbeeld is er een lokale kopie van het model in de opslagplaats, dus u hoeft het model alleen in het register in de werkruimte te publiceren. U kunt deze stap overslaan als het model dat u probeert te implementeren al is geregistreerd.

Een modelpakket implementeren in de Azure-app-service

In deze sectie verpakt u het eerder geregistreerde MLflow-model en implementeert u het in de Azure-app Service.

Voor het implementeren van een model buiten Azure Machine Learning moet u een pakketspecificatie maken. Als u een pakket wilt maken dat volledig is losgekoppeld van Azure Machine Learning, geeft u de

copymodus op in de modelconfiguratie. Decopymodus vertelt het pakket dat de artefacten in het pakket moeten worden gekopieerd. De volgende code laat zien hoe u de kopieermodus voor de modelconfiguratie opgeeft:Maak een YAML-pakketspecificatie:

package-external.yml

$schema: http://azureml/sdk-2-0/ModelVersionPackage.json target_environment: heart-classifier-mlflow-pkg inferencing_server: type: azureml_online model_configuration: mode: copyTip

Wanneer u de modelconfiguratie opgeeft die wordt gebruikt

copyvoor de moduseigenschap , garandeert u dat alle modelartefacten worden gekopieerd in de gegenereerde Docker-installatiekopieën in plaats van te worden gedownload uit het Azure Machine Learning-modelregister, waardoor echte draagbaarheid buiten Azure Machine Learning mogelijk is. Zie Een pakketspecificatie maken voor een volledige specificatie over alle opties bij het maken van pakketten.Start de pakketbewerking.

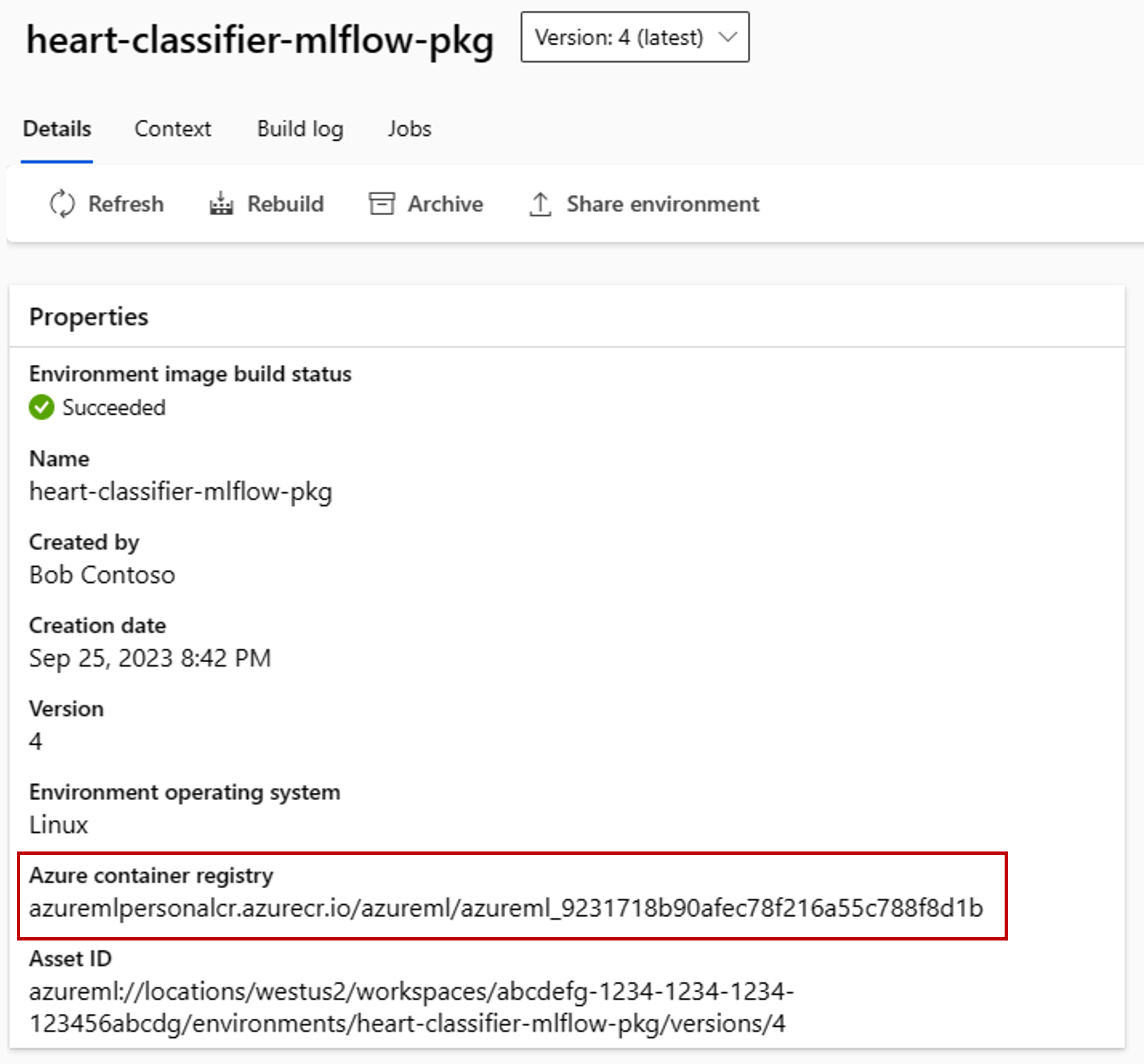

Het resultaat van de pakketbewerking is een omgeving in Azure Machine Learning. Het voordeel van deze omgeving is dat elke omgeving een bijbehorende Docker-installatiekopieën heeft die u in een externe implementatie kunt gebruiken. Installatiekopieën worden gehost in Azure Container Registry. In de volgende stappen ziet u hoe u de naam van de gegenereerde installatiekopieën krijgt:

Ga naar de Azure Machine Learning Studio.

Selecteer de sectie Omgevingen .

Selecteer het tabblad Aangepaste omgevingen .

Zoek de omgeving met de naam heart-classifier-mlflow-package, de naam van het pakket dat u zojuist hebt gemaakt.

Kopieer de waarde die zich in het veld Azure Container Registry bevindt .

Implementeer dit pakket nu in een App Service.

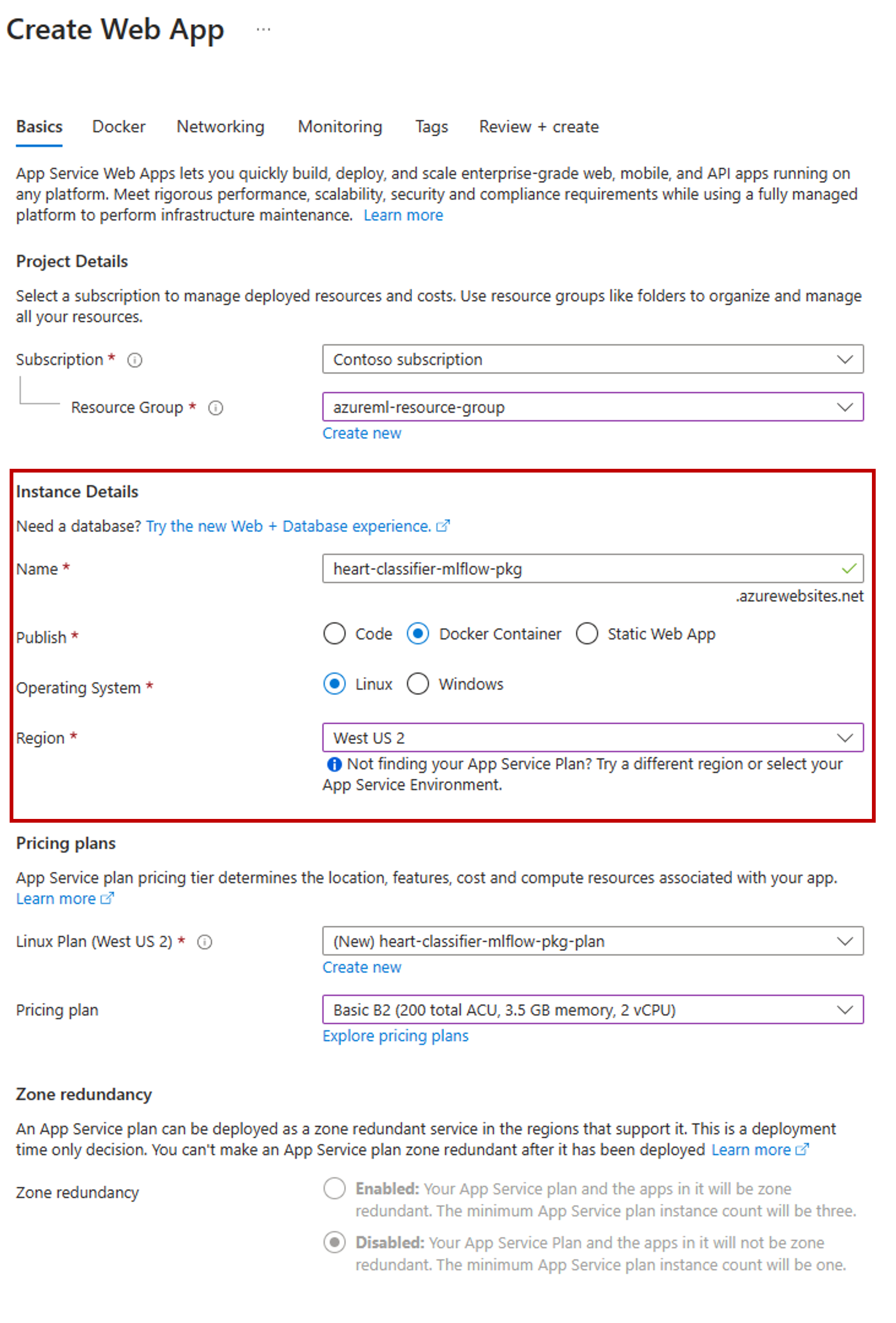

Ga naar Azure Portal en maak een nieuwe App Service-resource.

Selecteer in de wizard Maken het abonnement en de resourcegroep die u gebruikt.

Geef in de sectie Instantiedetails een naam op voor de app.

Voor Publiceren selecteert u Docker-container.

Selecteer Linux voor besturingssysteem.

Configureer de rest van de pagina indien nodig en selecteer Volgende.

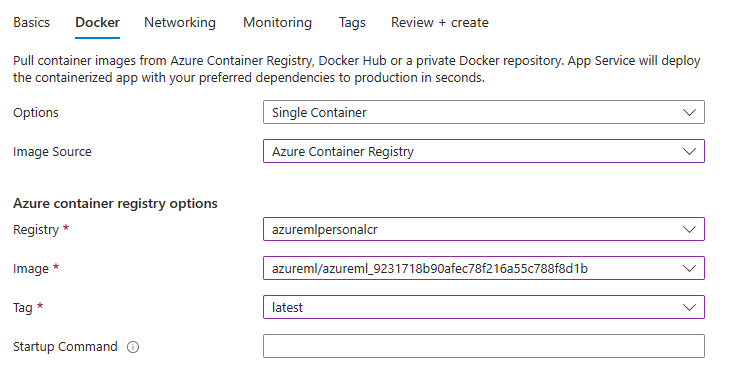

Ga naar het tabblad Docker .

Selecteer voor Opties één container.

Selecteer Azure Container Registry voor De bron van de installatiekopieën.

Configureer de azure-containerregisteropties als volgt:

Selecteer voor Registry het Azure Container Registry dat is gekoppeld aan de Azure Machine Learning-werkruimte.

Selecteer voor Afbeelding de afbeelding die u in stap 3(e) van deze zelfstudie hebt gevonden.

Selecteer voor Tag de meest recente.

Configureer de rest van de wizard indien nodig.

Selecteer Maken. Het model wordt nu geïmplementeerd in de App Service die u hebt gemaakt.

De manier waarop u voorspellingen aanroept en opkrijgt, is afhankelijk van de deductieserver die u hebt gebruikt. In dit voorbeeld hebt u de Azure Machine Learning-deductieserver gebruikt, waarmee voorspellingen worden gemaakt onder de route

/score. Zie de details van het pakket azureml-inference-server-http voor meer informatie over de invoerindelingen en -functies.Bereid de nettolading van de aanvraag voor. De indeling voor een MLflow-model dat is geïmplementeerd met azure Machine Learning-deductieserver is als volgt:

sample-request.json

{ "input_data": { "columns": [ "age", "sex", "cp", "trestbps", "chol", "fbs", "restecg", "thalach", "exang", "oldpeak", "slope", "ca", "thal" ], "index": [1], "data": [ [1, 1, 4, 145, 233, 1, 2, 150, 0, 2.3, 3, 0, 2] ] } }Test de modelimplementatie om te zien of het werkt.

cat -A sample-request.json | curl http://heart-classifier-mlflow-pkg.azurewebsites.net/score \ --request POST \ --header 'Content-Type: application/json' \ --data-binary @-