Azure OpenAI schalen voor JavaScript-chat met behulp van RAG met Azure Container Apps

Meer informatie over het toevoegen van taakverdeling aan uw toepassing om de chat-app uit te breiden buiten het Azure OpenAI Service-token en de quotumlimieten voor modellen. Deze benadering maakt gebruik van Azure Container Apps om drie Azure OpenAI-eindpunten en een primaire container te maken om binnenkomend verkeer naar een van de drie eindpunten te leiden.

Voor dit artikel moet u twee afzonderlijke voorbeelden implementeren:

Chat-app

Als u de chat-app nog niet hebt geïmplementeerd, wacht u totdat het voorbeeld van de load balancer is geïmplementeerd.

Als u de chat-app al eenmaal hebt geïmplementeerd, wijzigt u de omgevingsvariabele ter ondersteuning van een aangepast eindpunt voor de load balancer en implementeert u deze opnieuw.

De chat-app is beschikbaar in deze talen:

- .NET

- JavaScript

- Python

Loadbalancer-app

Notitie

In dit artikel worden een of meer AI-app-sjablonen gebruikt als basis voor de voorbeelden en richtlijnen in het artikel. AI-app-sjablonen bieden u goed onderhouden referentie-implementaties die eenvoudig te implementeren zijn. Ze helpen u om een startpunt van hoge kwaliteit voor uw AI-apps te garanderen.

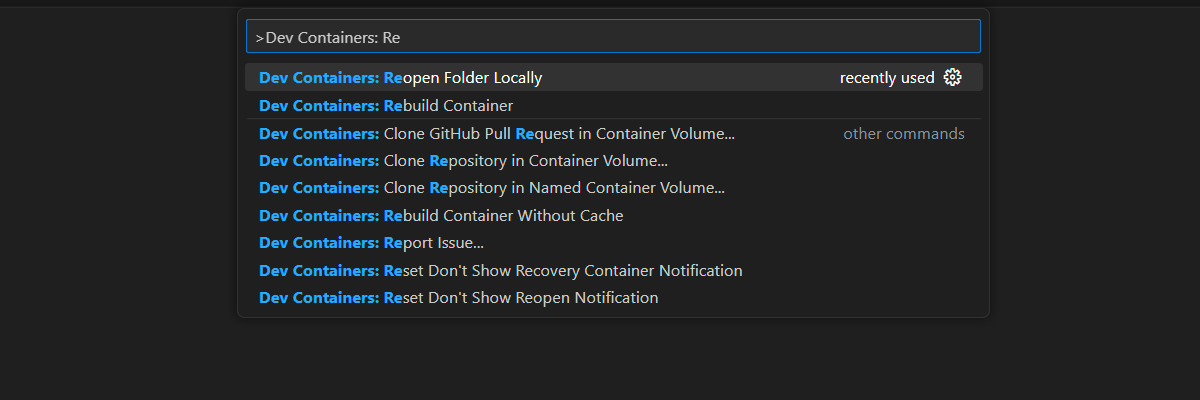

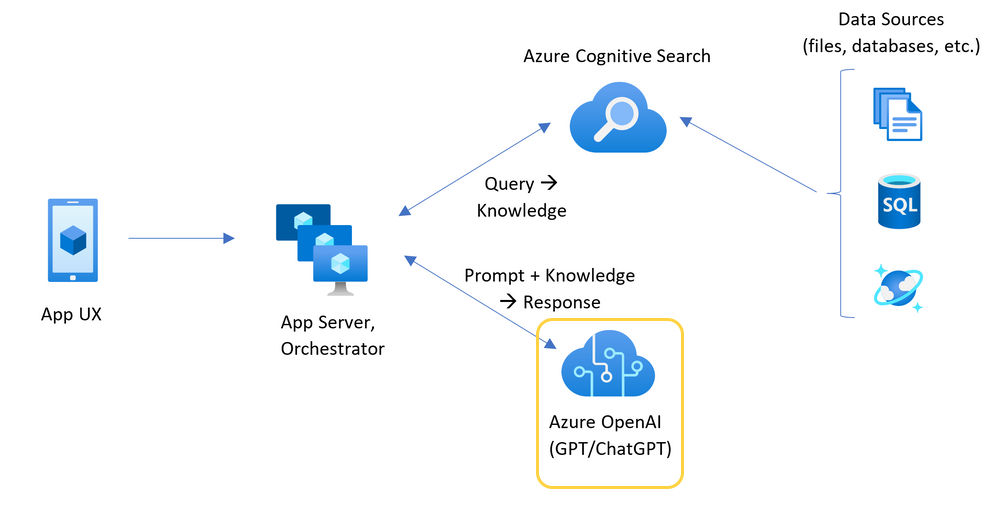

Architectuur voor taakverdeling van Azure OpenAI met Azure Container Apps

Omdat de Azure OpenAI-resource specifieke token- en modelquotumlimieten heeft, is een chat-app die gebruikmaakt van één Azure OpenAI-resource gevoelig voor gespreksfouten vanwege deze limieten.

Als u de chat-app wilt gebruiken zonder deze limieten te bereiken, gebruikt u een oplossing met gelijke taakverdeling met Container Apps. Met deze oplossing wordt naadloos één eindpunt van Container Apps beschikbaar gesteld aan uw chat-app-server.

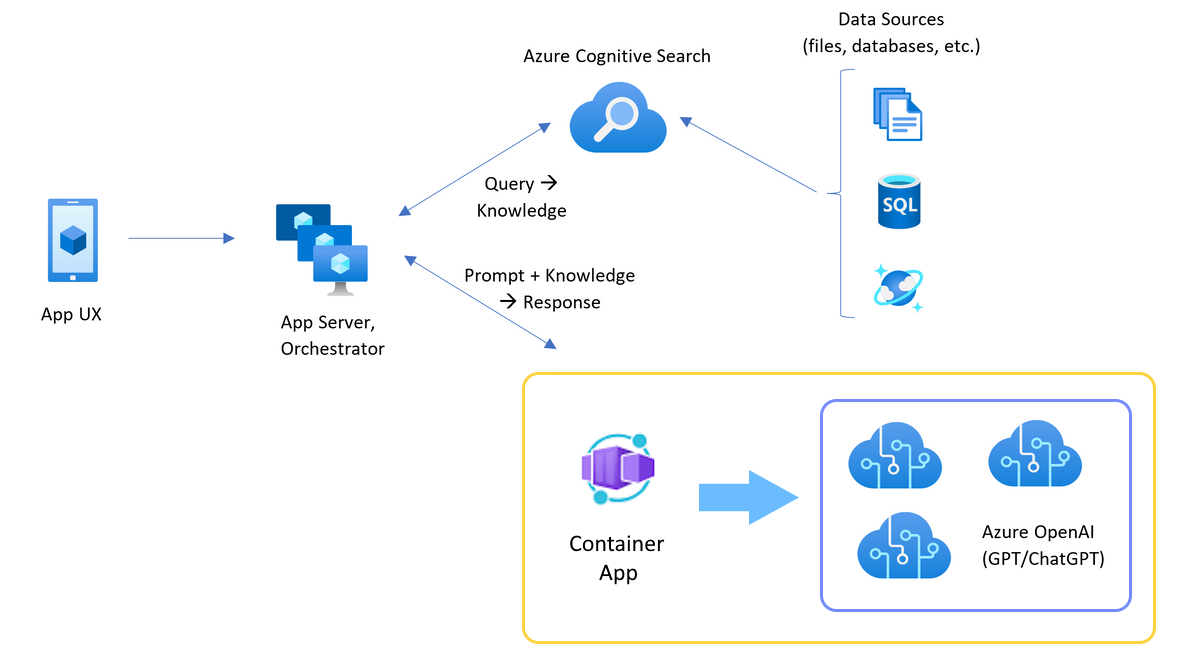

De container-app bevindt zich voor een verzameling Azure OpenAI-bronnen. De containerapp lost twee scenario's op: normaal en gelimiteerd. Tijdens een normaal scenario waar token- en modelquota beschikbaar zijn, retourneert de Azure OpenAI-resource een 200 terug via de container-app en app-server.

Wanneer een resource zich in een beperkt scenario bevindt vanwege quotumlimieten, kan de container-app een andere Azure OpenAI-resource onmiddellijk opnieuw proberen om te voldoen aan de oorspronkelijke aanvraag voor de chat-app.

Diagram met een throttling-scenario met een 429 mislukte antwoordcode en een antwoordheader van het aantal seconden dat de client moet wachten voordat de client het opnieuw kan proberen.

Vereisten

Azure-abonnement. Maak er gratis een

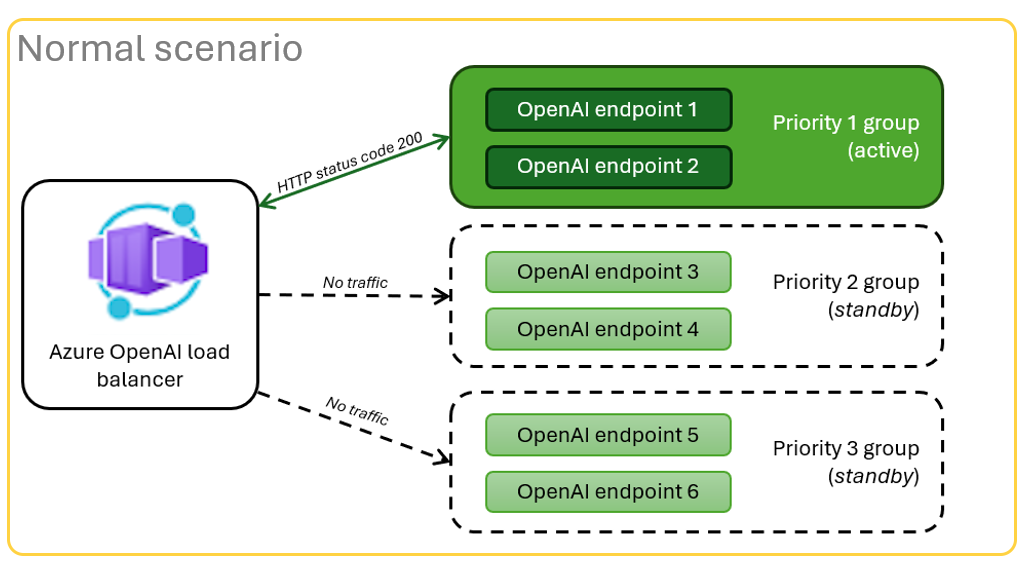

Dev-containers zijn beschikbaar voor beide voorbeelden, met alle afhankelijkheden die nodig zijn om dit artikel te voltooien. U kunt de dev-containers uitvoeren in GitHub Codespaces (in een browser) of lokaal met behulp van Visual Studio Code.

- Codespaces (aanbevolen)

- Visual Studio Code

- Een GitHub-account.

Open de voorbeeld-app voor de load balancer van Container Apps.

- GitHub Codespaces (aanbevolen)

- Visual Studio Code

GitHub Codespaces beheert een ontwikkelcontainer met Visual Studio Code voor het web als de gebruikersinterface. Voor de eenvoudigste ontwikkelomgeving gebruikt u GitHub Codespaces zodat u de juiste ontwikkelhulpprogramma's en afhankelijkheden vooraf hebt geïnstalleerd om dit artikel te voltooien.

Belangrijk

Alle GitHub-accounts kunnen Elke maand maximaal 60 uur gratis GitHub Codespaces gebruiken met twee kernexemplaren. Zie GitHub Codespaces maandelijks inbegrepen opslag- en kernuren voor meer informatie.

De load balancer van Azure Container Apps implementeren

Meld u aan bij de Azure Developer CLI om verificatie te bieden voor de inrichtings- en implementatiestappen:

azd auth login --use-device-codeStel een omgevingsvariabele in om Azure CLI-authenticatie te gebruiken voor de stap na de provisioning.

azd config set auth.useAzCliAuth "true"Implementeer de load balancer-app:

azd upSelecteer een abonnement en regio voor de implementatie. Ze hoeven niet hetzelfde abonnement en dezelfde regio te zijn als de chat-app.

Wacht tot de implementatie is voltooid voordat u doorgaat.

Het implementatie-eindpunt ophalen

Gebruik de volgende opdracht om het geïmplementeerde eindpunt voor de container-app weer te geven:

azd env get-valuesKopieer de

CONTAINER_APP_URLwaarde. U gebruikt deze in de volgende sectie.

De chat-app opnieuw inzetten met het load balancer-eindpunt

Deze voorbeelden zijn voltooid in het chat-app voorbeeld.

- Eerste implementatie

- Herschikking

Open de dev-container van de chat-app met behulp van een van de volgende opties.

Taal GitHub Codespaces Visual Studio Code .NET Openen in GitHub Codespaces

Openen in Dev Containers JavaScript Openen in GitHub Codespaces

Openen in Dev Containers Python Openen in GitHub Codespaces

Openen in Dev Containers Meld u aan bij de Azure Developer CLI (

AZD):azd auth loginVoltooi de aanmeldingsinstructies.

Maak een

AZD-omgeving met een naam zoalschat-app:azd env new <name>Voeg de volgende omgevingsvariabele toe, waarmee de back-end van de chat-app een aangepaste URL voor de Azure OpenAI-aanvragen moet gebruiken:

azd env set OPENAI_HOST azure_customVoeg de volgende omgevingsvariabele toe. Vervang

<CONTAINER_APP_URL>door de URL uit de vorige sectie. Deze actie vertelt de back-end van de chat-app wat de waarde is van de aangepaste URL voor de Azure OpenAI-aanvraag.azd env set AZURE_OPENAI_CUSTOM_URL <CONTAINER_APP_URL>De chat-app implementeren:

azd up

U kunt nu de chat-app gebruiken met de zekerheid dat deze is ontworpen om op te schalen voor veel gebruikers zonder dat het quotum opraakt.

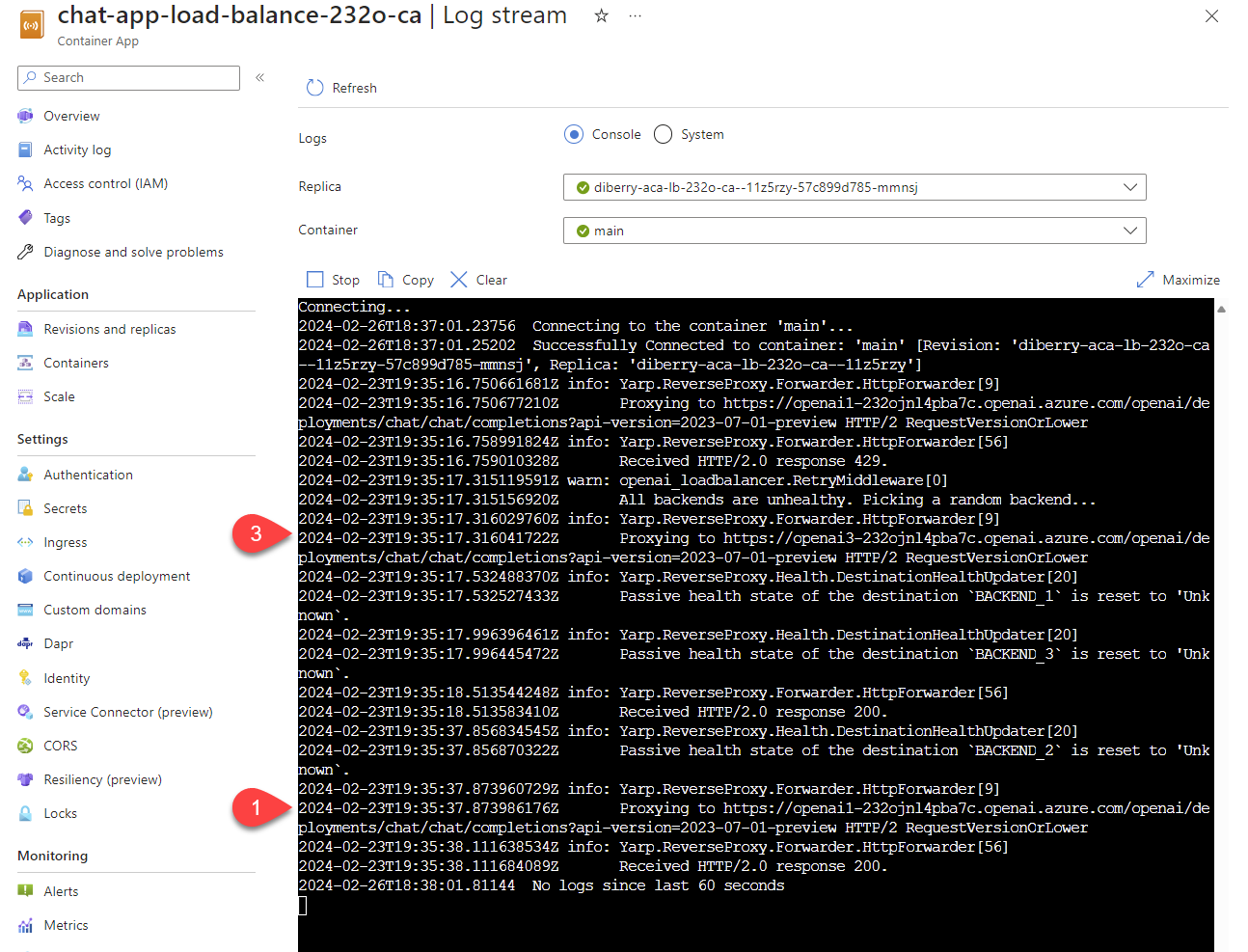

Logboeken streamen om de resultaten van de load balancer te bekijken

In de Azure Portal zoekt u uw resourcegroep.

Selecteer in de lijst met resources in de groep de Azure Container Apps-resource.

Selecteer Monitoring>Logboekstream om het logboek weer te geven.

Gebruik de chat-app om verkeer in het logboek te genereren.

Zoek naar de logboeken, die verwijzen naar de Azure OpenAI-resources. Elk van de drie resources heeft zijn numerieke identiteit in de logboekcommentaar die begint met

Proxying to https://openai3, waarbij3de derde Azure OpenAI-resource aangeeft.

Wanneer de load balancer de status ontvangt dat de aanvraag het quotum overschrijdt, draait de load balancer automatisch naar een andere resource.

Het TPM-quotum configureren

Standaard wordt elk van de Azure OpenAI-exemplaren in de load balancer geïmplementeerd met een capaciteit van 30.000 tokens per minuut (TPM). U kunt de chat-app met vertrouwen gebruiken, wetende dat deze is ontworpen om mee te groeien met veel gebruikers zonder dat er een tekort aan quotum ontstaat. Wijzig deze waarde wanneer:

- U krijgt fouten in de implementatiecapaciteit: verlaag de waarde.

- U hebt een hogere capaciteit nodig: Verhoog de waarde.

Gebruik de volgende opdracht om de waarde te wijzigen:

azd env set OPENAI_CAPACITY 50Implementeer de load balancer opnieuw:

azd up

Middelen opschonen

Wanneer u klaar bent met de chat-app en de load balancer, moet u de resources opschonen. De Azure-resources die in dit artikel zijn gemaakt, worden gefactureerd voor uw Azure-abonnement. Als u deze resources in de toekomst niet meer nodig hebt, verwijdert u deze om te voorkomen dat er meer kosten in rekening worden gebracht.

Resources voor chat-apps opschonen

Ga terug naar het artikel over de chat-app om bronnen op te ruimen.

Resources voor upload balancer opschonen

Voer de volgende Azure Developer CLI-opdracht uit om de Azure-resources te verwijderen en de broncode te verwijderen:

azd down --purge --force

De schakelopties bieden:

-

purge: verwijderde resources worden onmiddellijk opgeschoond, zodat u de Azure OpenAI-servicetokens per minuut opnieuw kunt gebruiken. -

force: Het verwijderen gebeurt stilzwijgend, zonder dat toestemming van de gebruiker is vereist.

GitHub Codespaces en Visual Studio Code opschonen

- GitHub Codespaces

- Visual Studio Code

Als u de GitHub Codespaces-omgeving verwijdert, zorgt u ervoor dat u de hoeveelheid gratis rechten per kernuren die u voor uw account krijgt, kunt maximaliseren.

Belangrijk

Zie GitHub Codespaces maandelijks inbegrepen opslag- en kernuren voor meer informatie over de rechten van uw GitHub-account.

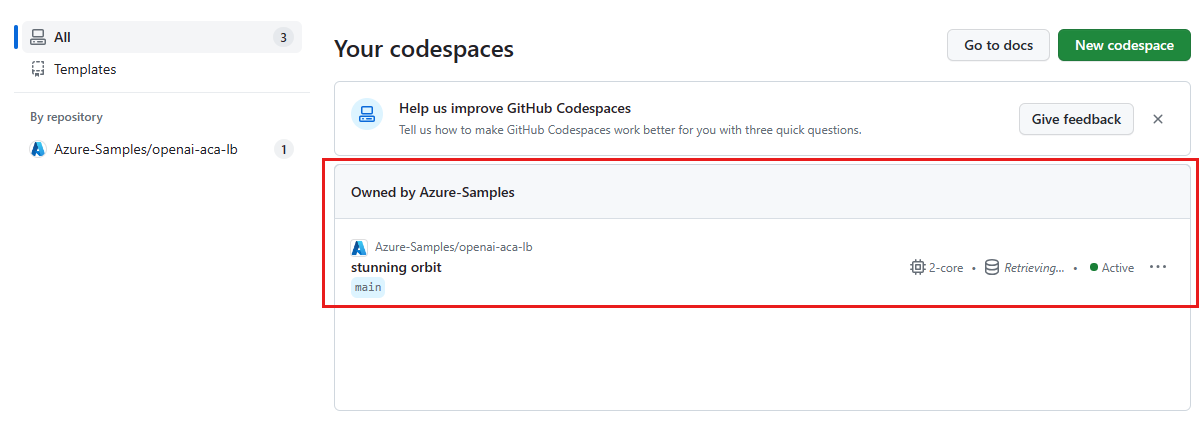

Meld u aan bij het GitHub Codespaces-dashboard.

Zoek uw huidige codespaces die afkomstig zijn van de azure-samples/openai-aca-lb GitHub-repository.

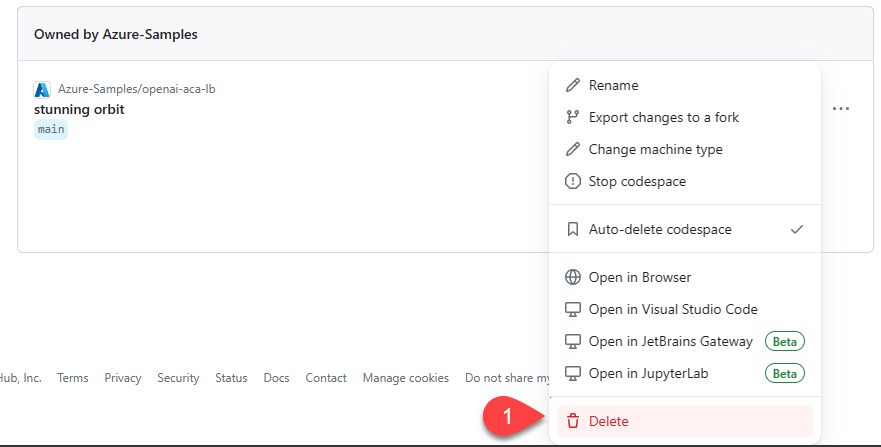

Open het contextmenu voor de coderuimte en selecteer Verwijderen.

Hulp vragen

Als u problemen ondervindt bij het implementeren van de Azure API Management Load Balancer, voegt u uw probleem toe aan de repository's Issues webpage.

Voorbeeldcode

Voorbeelden die in dit artikel worden gebruikt, zijn:

- JavaScript-chat-app met RAG

- Load Balancer met Azure Container Apps

Volgende stap

- Gebruik Azure Load Testing om uw chatapp te loadtesten met de Azure Load Testing Service.

- Meer informatie over hoe AZD wordt gebruikt in deze sjabloon:

- Tech community blogbericht

- Reactor-videoserie