LLM 이해

LLM(대규모 언어 모델)은 자연어 텍스트를 처리하고 생성할 수 있는 AI의 한 형식입니다. 책, 문서, 웹 페이지, 이미지 등의 원본에서 수집된 방대한 양의 데이터를 학습하여 언어의 패턴과 규칙을 확인합니다.

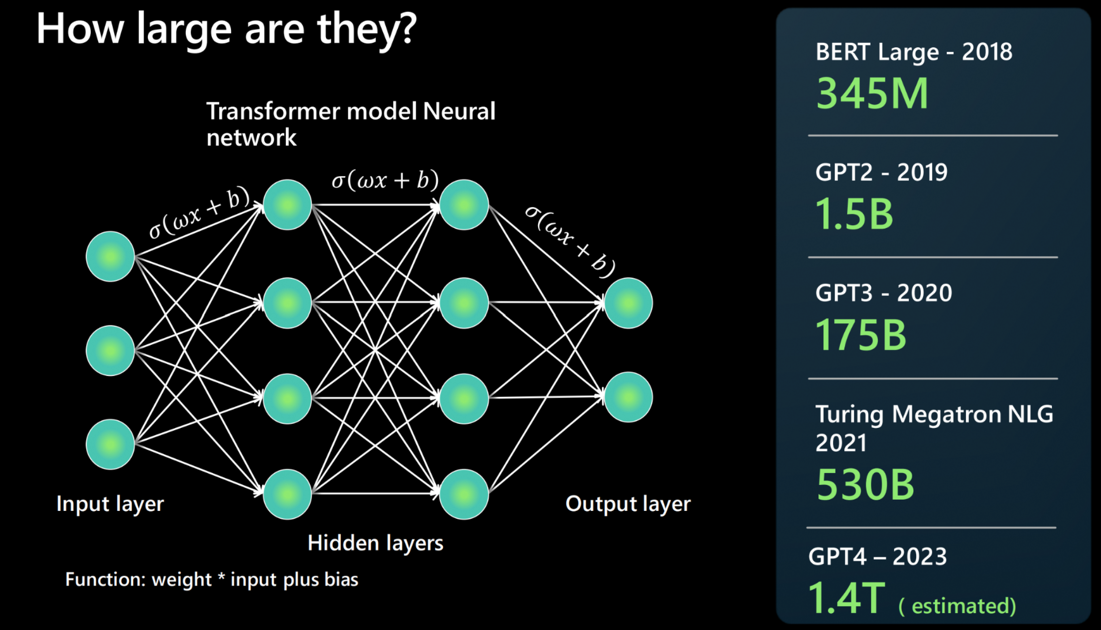

크기는 얼마나 되나요?

LLM은 신경망 아키텍처를 사용하여 빌드됩니다. 입력을 받고, 언어의 다양한 측면을 분해하는 여러 숨겨진 계층이 있으며, 출력 계층에서 생성됩니다.

사람들은 종종 최신 기본 모델이 이전 모델보다 더 크다고 보고하는데 이것이 무엇을 의미하나요? 즉, 모델에 있는 매개 변수가 많을수록 처리하고, 학습하고, 생성할 수 있는 데이터가 더 많아집니다.

신경망 아키텍처의 두 뉴런 사이의 각 연결에는 가중치 * 입력 + 바이어스라는 함수가 있습니다. 이 네트워크는 모델이 언어를 처리하는 방법을 결정하는 숫자 값을 생성합니다.

LLM은 실제로 규모가 크고 빠르게 성장하고 있습니다. 일부 모델은 2018년에 수백만 개의 매개 변수를 계산할 수 있습니다. 그러나 오늘날 GPT-4는 수조개의 매개 변수를 계산할 수 있습니다.

기본 모델은 LLM에 어디에 적합하나요?

기본 모델은 LLM의 특정 인스턴스 또는 버전을 나타냅니다. 예를 들어, GPT-3, GPT-4 또는 Codex입니다.

기본 모델은 대규모 텍스트 모음 또는 Codex 모델 인스턴스인 경우 코드에 대해 학습되고 미세 조정됩니다.

기본 모델은 다양한 형식의 학습 데이터를 취하고 변환기 아키텍처를 사용하여 일반 모델을 빌드합니다. 프롬프트 또는 미세 조정을 통해 특정 작업을 달성하기 위해 적응 및 특수화를 만들 수 있습니다.

LLM은 기존의 NLP(자연어 처리)와 어떻게 다른가요?

기존 NLP와 LLM을 구분하는 몇 가지 사항이 있습니다.

| 기존 NLP | 대규모 언어 모델 |

|---|---|

| 기능당 하나의 모델이 필요합니다. | 단일 모델은 많은 자연어 사용 사례에 사용됩니다. |

| ML 모델을 학습하기 위해 레이블이 지정된 데이터 집합을 제공합니다. | 기본 모델에서 레이블이 지정되지 않은 수 테라바이트의 데이터를 사용합니다. |

| 모델이 수행하려는 작업을 자연어로 설명합니다. | 특정 사용 사례에 맞게 고도로 최적화되었습니다. |

LLM에서 수행할 수 없는 작업

LLM에서 수행할 수 있는 작업을 이해하는 것이 중요한 만큼, LLM에서 수행할 수 없는 작업을 이해하여 업무에 적합한 도구를 선택하는 것도 중요합니다.

언어 이해: LLM은 기존 텍스트를 기반으로 패턴을 모아 더 많은 텍스트를 생성하는 예측 엔진입니다. 언어나 수학을 이해하지 못합니다.

팩트 이해: LLM에는 정보 검색과 창의적인 쓰기를 위한 별도의 모드가 없습니다. 이는 단순히 다음으로 가능성이 높은 토큰을 예측합니다.

매너, 감정 또는 윤리를 이해함: LLM은 의인화하여 나타내거나 윤리를 이해할 수 없습니다. 기본 모델의 출력은 학습 데이터와 프롬프트의 조합입니다.