Microsoft が責任ある AI にどのように取り組んでいるかを調べる

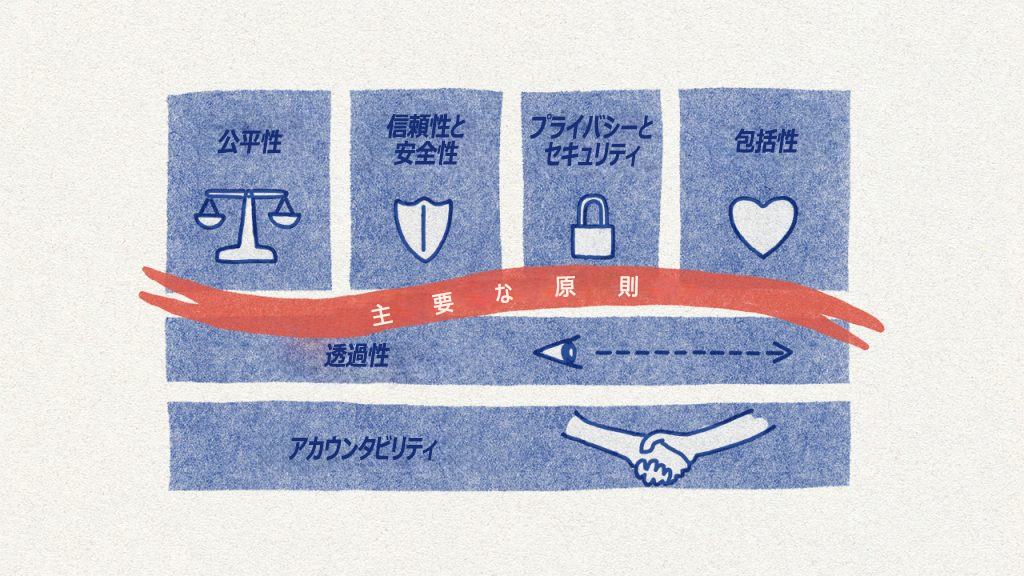

Microsoft は、倫理と責任を重視して AI を運用に統合しています。 このアプローチの基本原則は次のとおりです。

- 公平性。 Microsoft は、偏見をなくし、すべてのユーザーに対して平等の扱いを保証することを目的としています。

- 信頼性と安全性。 厳密なテストにより、Microsoft の AI が一貫して安全に動作することを保証します。

- プライバシーとセキュリティ。 データは保護されています。 トレーニング フェーズと展開フェーズの両方で、Microsoft はユーザーの詳細を保護することに重点を置いています。

- 包括性。 AI ツールは、身体能力、性別、民族性に関係なく、すべてのユーザーにとってアクセス可能で有益になるように作られています。

- 透過性。 Microsoft は、AI システムの動作方法と目的についてユーザーに常に情報を提供することを信念としています。

- 説明責任。 倫理的および法的基準が最前線にあり、AI 開発者やデザイナーは自分の作成物に対して説明責任を負います。

責任ある AI に対する Microsoft の戦略

Microsoft は、信頼できる倫理的で安全な AI ソリューションを開発および展開するグローバル リーダーです。 このビジョンを実現するために、Microsoft は、AI が責任を持って透過的に設計および使用されるよう徹底するために共同作業を行うさまざまなチーム、プロセス、リソース、イニシアチブに投資してきました。 このメモで、Brad Smith は AI ガバナンスのブループリントをリリースしました。これは、拡張可能、相互運用可能、適切な AI の規制フレームワークを作成するための、政府やその他の利害関係者向けの Microsoft の提案を提示しています。

また、Microsoft エンジニアは、責任ある AI 基準 v2 に含まれる高い基準に準拠する AI 製品およびサービスを構築します。 Microsoft セキュリティ エキスパートは、悪意のある攻撃や不正アクセスから AI システムとデータの機密性、整合性、可用性を保護します。 Microsoft の AI Assurance Program の一環として、Microsoft は、お客様が独自の AI デプロイをセキュリティで保護し、潜在的なリスクを軽減するための取り組みを支援するツールとフレームワークも開発しています。

Microsoft は、以下を組み合わせて活用しています。

- 倫理的 AI の原則

- 責任ある AI のコンプライアンス基準

- プライバシー中心の機械学習を含む包括的な AI 研究

研究者、エンジニア、ポリシー スペシャリストのチームが、Microsoft の AI システムを継続的に改良しています。 彼らは、トレーニング データの強化、有害なコンテンツのフィルター処理、バイアスへの対処に取り組んでいます。

Microsoft のミッションは 2 つあります。AI システムが理解され、信頼できることを保証すること、そして AI を責任を持って使用するための知識を顧客に提供することです。