Scala la chat di Azure OpenAI per Python usando RAG con Azure Container Apps

Scopri come aggiungere il bilanciamento del carico alla tua applicazione per estendere l'app di chat oltre i limiti di quota relativi ai token e ai modelli del servizio OpenAI di Azure. Questo approccio usa app contenitore di Azure per creare tre endpoint OpenAI di Azure e un contenitore primario per indirizzare il traffico in ingresso a uno dei tre endpoint.

Questo articolo richiede la distribuzione di due esempi distinti:

App di chat

Se l'app chat non è ancora stata distribuita, attendere fino a quando non viene distribuito l'esempio di bilanciamento del carico.

Se l'app chat è già stata distribuita una sola volta, modificare la variabile di ambiente per supportare un endpoint personalizzato per il servizio di bilanciamento del carico e ridistribuirlo nuovamente.

L'app chat è disponibile in queste lingue:

- .NET

- JavaScript

- Python

App di bilanciamento del carico

Nota

Questo articolo usa uno o più modelli di app di intelligenza artificiale come base per gli esempi e le linee guida nell'articolo. I modelli di app di intelligenza artificiale offrono implementazioni di riferimento ben gestite che sono facili da distribuire. Consentono di garantire un punto di partenza di alta qualità per le app di intelligenza artificiale.

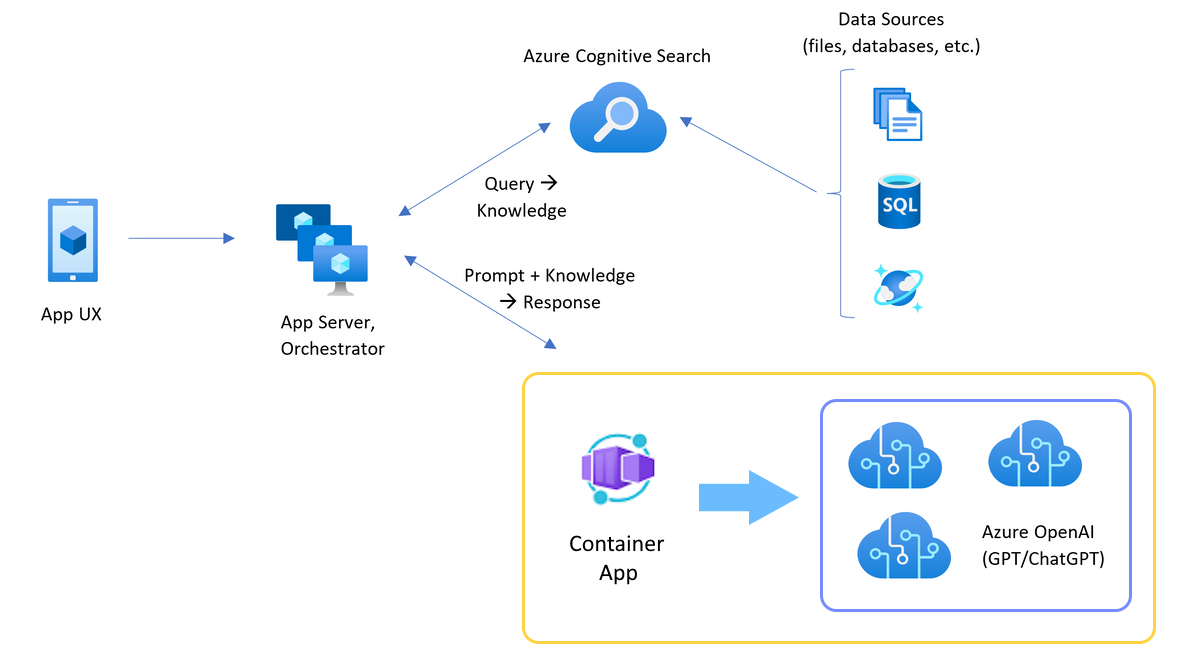

Architettura per il bilanciamento del carico di Azure OpenAI con app Azure Container

Poiché la risorsa OpenAI di Azure ha limiti di quota di token e modelli specifici, un'app di chat che usa una singola risorsa OpenAI di Azure è soggetta a errori di conversazione a causa di tali limiti.

Per usare l'app di chat senza raggiungere tali limiti, utilizza una soluzione bilanciata con App Contenitore. Questa soluzione espone senza soluzione di continuità un singolo endpoint dalle Container Apps al server dell'app di chat.

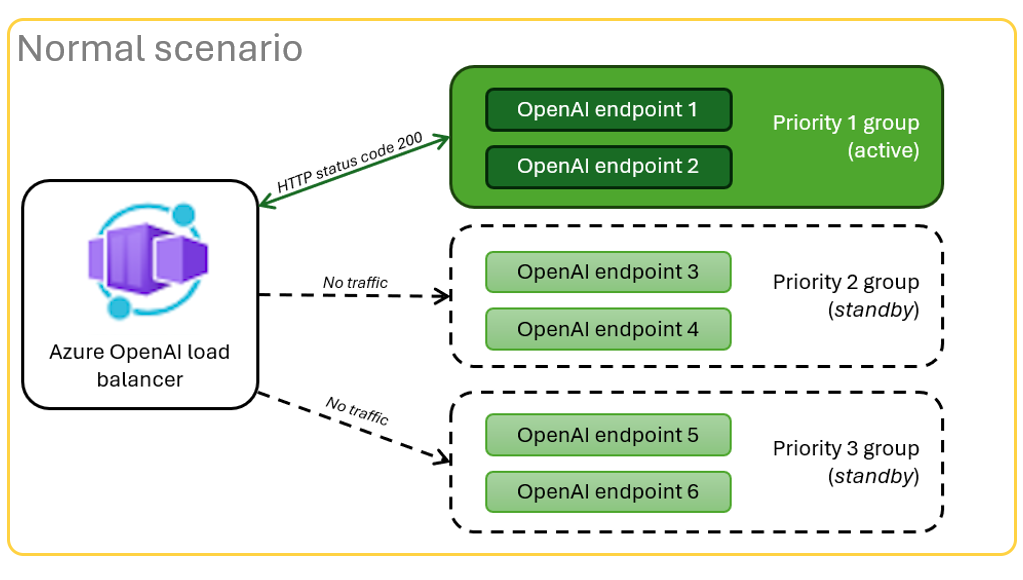

L'app contenitore è posta davanti a un insieme di risorse OpenAI di Azure. L'app contenitore risolve due scenari: normale e rallentato. Durante uno scenario normale in cui è disponibile la quota di token e modelli, la risorsa OpenAI di Azure restituisce 200 tramite l'app contenitore e il server app.

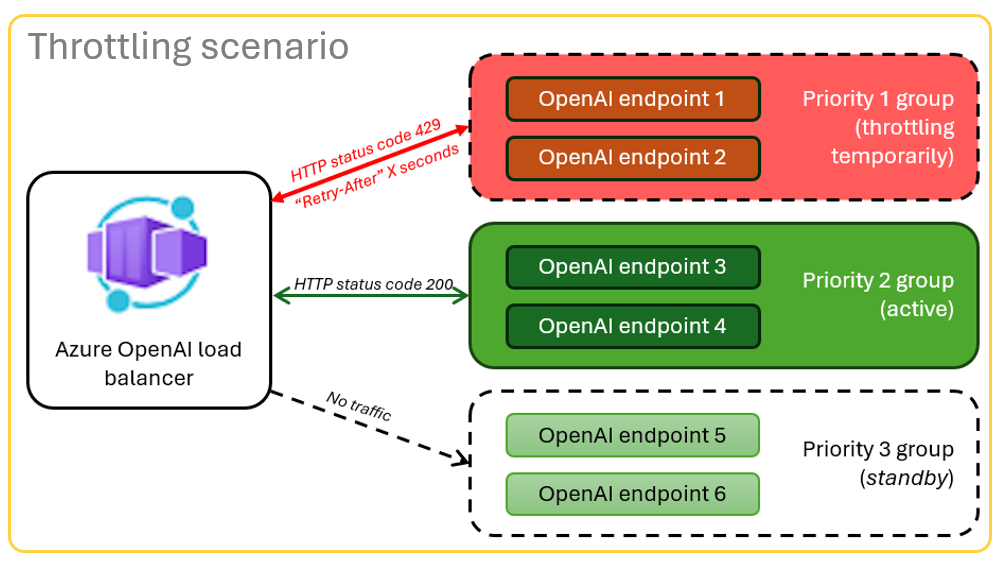

Quando una risorsa si trova in uno scenario limitato a causa dei limiti di quota, l'applicazione container può immediatamente tentare di utilizzare una risorsa OpenAI di Azure diversa per soddisfare la richiesta originale della chat app.

Prerequisiti

Una sottoscrizione di Azure. Crea uno gratis.

I contenitori di sviluppo sono disponibili per entrambi gli esempi con tutte le dipendenze richieste per completare questo articolo. È possibile eseguire i contenitori di sviluppo in GitHub Codespaces (in un browser) o in locale usando Visual Studio Code.

- gitHub Codespaces (scelta consigliata)

- di Visual Studio Code

- Account GitHub

Apri l'applicazione di esempio del bilanciamento del carico delle applicazioni container

- gitHub Codespaces (scelta consigliata)

- di Visual Studio Code

GitHub Codespaces esegue un contenitore di sviluppo gestito da GitHub con Visual Studio Code per il Web come interfaccia utente. Per l'ambiente di sviluppo più semplice, usare GitHub Codespaces per avere gli strumenti di sviluppo e le dipendenze corretti preinstallati per completare questo articolo.

Importante

Tutti gli account GitHub possono usare GitHub Codespaces per un massimo di 60 ore gratuite ogni mese con due istanze principali. Per ulteriori informazioni, vedere GitHub Codespaces archiviazione mensile inclusa e ore centrali.

Distribuire il servizio di bilanciamento del carico di App Azure Container

Accedi alla CLI Azure Developer per fornire l'autenticazione durante i passaggi di provisioning e distribuzione:

azd auth login --use-device-codeImpostare una variabile di ambiente per usare l'autenticazione di Azure CLI nel passaggio di post-provisioning.

azd config set auth.useAzCliAuth "true"Distribuire l'app di bilanciamento del carico:

azd upSelezionare una sottoscrizione e un'area per la distribuzione. Non devono appartenere alla stessa sottoscrizione e regione dell'app di chat.

Attendere il completamento della distribuzione prima di continuare.

Ottenere l'endpoint di distribuzione

Usare il comando seguente per visualizzare l'endpoint distribuito per l'app contenitore:

azd env get-valuesCopia il valore

CONTAINER_APP_URL. Tu lo usi nella sezione successiva.

Ridistribuire l'app di chat con l'endpoint del bilanciatore del carico

Questi esempi vengono completati nell'esempio di app di chat.

- distribuzione iniziale

- ridistribuzione

Aprire il contenitore di sviluppo dell'esempio di app di chat usando una delle opzioni seguenti.

Lingua GitHub Codespaces Visual Studio Code .NET JavaScript Pitone Accedi alla CLI per sviluppatori di Azure (

AZD):azd auth loginCompletare le istruzioni di accesso.

Creare un ambiente

AZDcon un nome, ad esempiochat-app:azd env new <name>Aggiungere la variabile di ambiente seguente, che indica al back-end dell'app di chat di usare un URL personalizzato per le richieste OpenAI di Azure:

azd env set OPENAI_HOST azure_customAggiungere la variabile di ambiente seguente. Sostituire

<CONTAINER_APP_URL>per l'URL della sezione precedente. Questa azione indica al back-end dell'app di chat il valore dell'URL personalizzato per la richiesta OpenAI di Azure.azd env set AZURE_OPENAI_CUSTOM_URL <CONTAINER_APP_URL>Distribuire l'app chat:

azd up

Ora puoi utilizzare l'app di chat con la certezza che sia stata progettata per scalare tra molti utenti senza esaurire la quota.

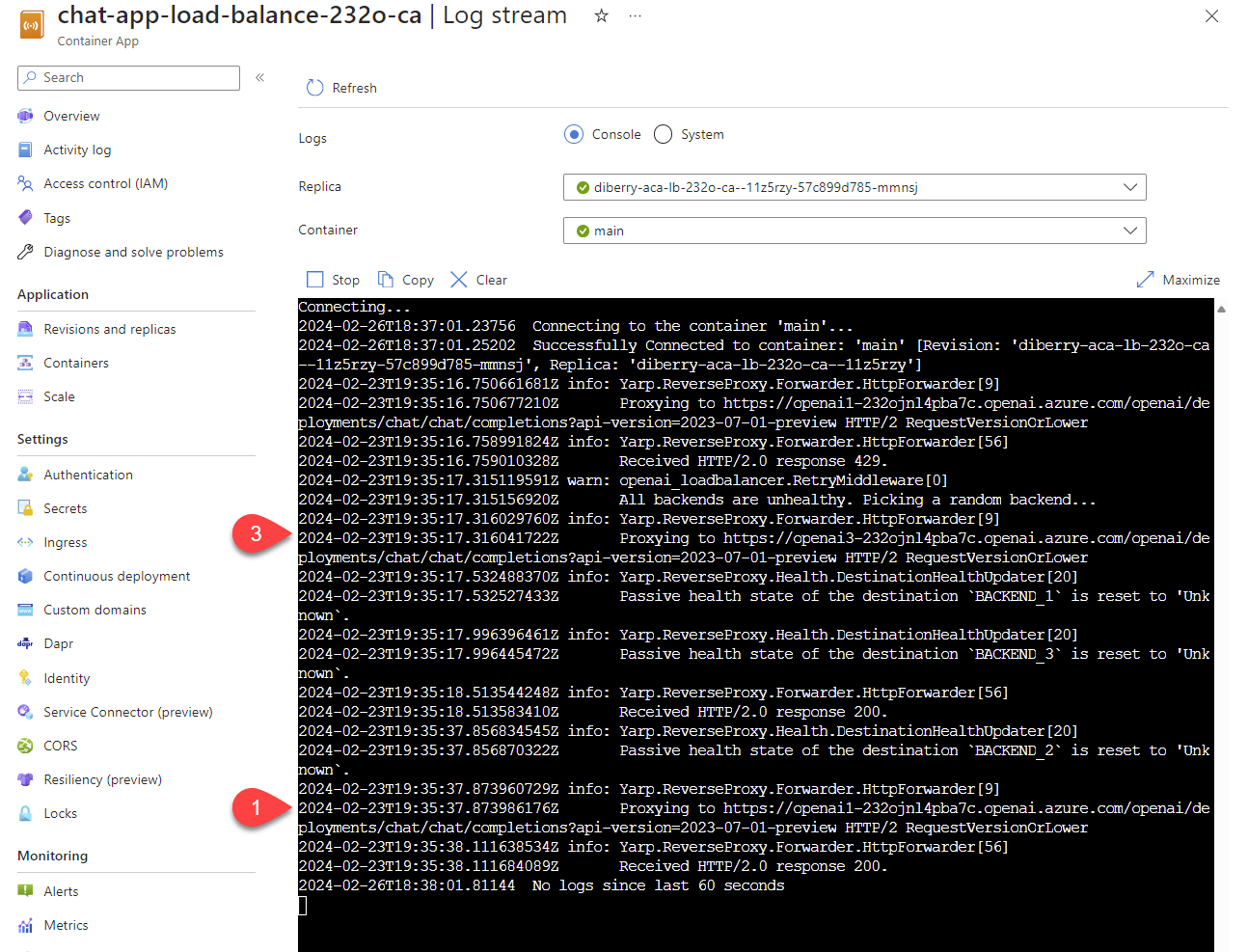

Trasmettere i log per visualizzare i risultati del servizio di bilanciamento del carico

Nell'elenco delle risorse nel gruppo, selezionare la risorsa Azure Container Apps.

Selezionare Monitoraggio>flusso di log per visualizzare il log.

Usare l'app chat per generare traffico nel log.

Cercate i log che fanno riferimento alle risorse Azure OpenAI. Ognuna delle tre risorse ha la propria identità numerica nel commento del log che inizia con

Proxying to https://openai3, dove3indica la terza risorsa OpenAI di Azure.

Quando il servizio di bilanciamento del carico riceve lo stato che la richiesta supera la quota, il servizio di bilanciamento del carico ruota automaticamente su un'altra risorsa.

Configurare la quota TPM

Per impostazione predefinita, ogni istanza di Azure OpenAI nel servizio di bilanciamento del carico viene distribuita con una capacità di 30.000 token al minuto (TPM). È possibile usare l'app di chat con la certezza che sia stata creata per gestire molti utenti senza esaurire la quota. Modificare questo valore quando:

- Ricevi errori di capacità nella distribuzione: Riduci il valore.

- È necessaria una capacità superiore: aumentare il valore.

Usare il comando seguente per modificare il valore:

azd env set OPENAI_CAPACITY 50Ridistribuire il servizio di bilanciamento del carico:

azd up

Pulire le risorse

Quando hai finito di utilizzare l'app chat e il bilanciatore di carico, ripulisci le risorse. Le risorse di Azure create e discusse in questo articolo vengono fatturate al tuo abbonamento di Azure. Se non si prevede che queste risorse siano necessarie in futuro, eliminarle per evitare di incorrere in costi aggiuntivi.

Pulire le risorse dell'app chat

Tornare all'articolo sull'app di chat per pulire le risorse:

- .NET

- JavaScript

- Python

Pulire le risorse del servizio di bilanciamento del caricamento

Eseguire il comando seguente dell'interfaccia della riga di comando per sviluppatori di Azure per eliminare le risorse di Azure e rimuovere il codice sorgente:

azd down --purge --force

Gli interruttori forniscono:

-

purge: le risorse eliminate vengono eliminate immediatamente in modo da poter riutilizzare i token del servizio OpenAI di Azure al minuto. -

force: l'eliminazione viene eseguita automaticamente, senza richiedere il consenso dell'utente.

Pulire GitHub Codespaces e Visual Studio Code

- GitHub Codespaces

- di Visual Studio Code

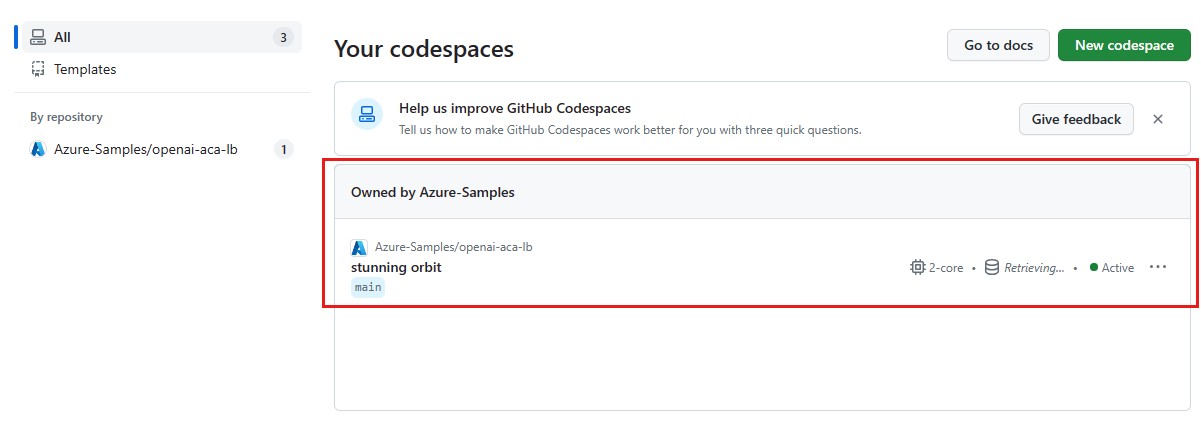

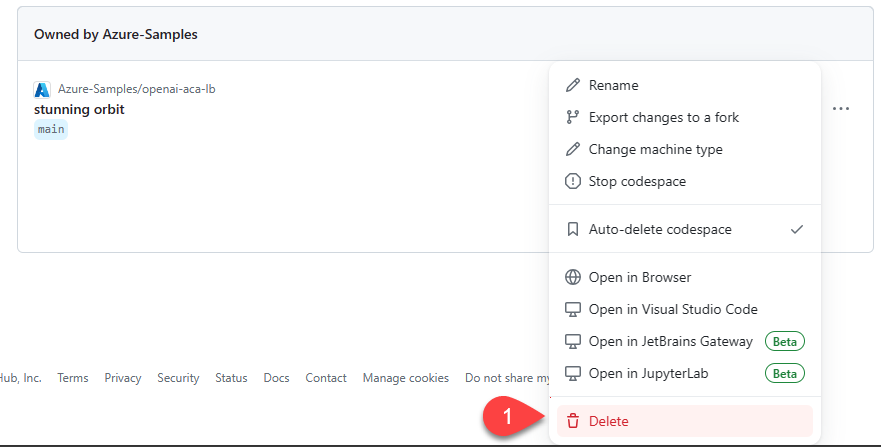

L'eliminazione dell'ambiente GitHub Codespaces assicura di poter sfruttare al massimo le ore gratuite per core che si ricevono per il proprio account.

Importante

Per ulteriori informazioni sui diritti dell'account GitHub, vedi l'archiviazione mensile inclusa e le ore di elaborazione di base di GitHub Codespaces.

Accedi al dashboard GitHub Codespaces.

Individua gli spazi di codice attualmente in esecuzione originati dal repository GitHub azure-samples/openai-aca-lb.

Aprire il menu di scelta rapida per lo spazio di codice e quindi selezionare Elimina.

Ottenere assistenza

Se si verificano problemi durante la distribuzione del servizio di bilanciamento del carico di Gestione API di Azure, aggiungere il problema alla pagina web dei problemi del repository .

Codice di esempio

Gli esempi usati in questo articolo includono:

- App di chat Python con Generazione Aumentata dal Recupero (RAG)

- Azure Load Balancer con Azure Container Apps

Contenuto correlato

Usa Test di Carico di Azure per effettuare un test di carico della tua app di chat.