Ottenere il contesto dell'applicazione e dell'utente finale per gli avvisi di intelligenza artificiale

Microsoft Defender per il cloud la protezione dalle minacce per i carichi di lavoro di intelligenza artificiale consente di migliorare l'utilità e il valore di sicurezza degli avvisi di intelligenza artificiale generati fornendo sia l'utente finale che il contesto dell'applicazione.

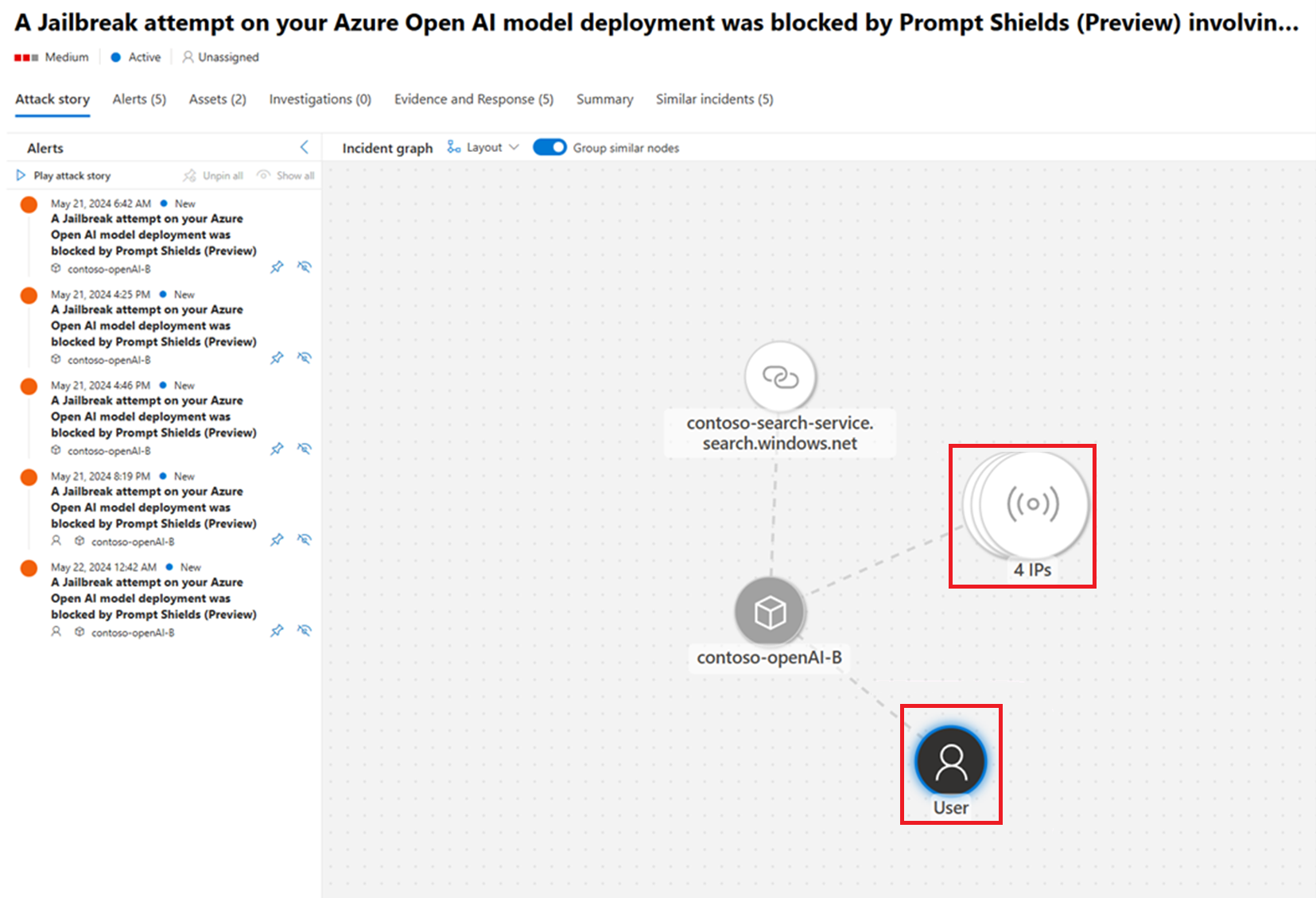

Nella maggior parte dei casi, le applicazioni e gli scenari che sfruttano i servizi di intelligenza artificiale vengono compilati come parte di un'applicazione, quindi le chiamate API al servizio di intelligenza artificiale provengono da un'applicazione Web, da un'istanza di calcolo o da un gateway di intelligenza artificiale. Questa configurazione dell'architettura introduce complessità a causa di una mancanza di contesto durante l'analisi delle richieste di intelligenza artificiale per determinare l'applicazione aziendale o l'utente finale coinvolto.

Defender per il cloud, insieme all'intelligenza artificiale di Azure, consente di aggiungere parametri alle chiamate api di intelligenza artificiale di Azure per propagare l'utente finale critico o il contesto dell'applicazione agli avvisi di intelligenza artificiale di Defender per il cloud. Questo, a sua volta, porta a una valutazione e risultati più efficaci. Ad esempio, quando si aggiunge l'indirizzo IP o l'identità dell'utente finale, è possibile bloccare l'utente o correlare eventi imprevisti e avvisi da parte dell'utente. Quando si aggiunge il contesto dell'applicazione, è possibile definire la priorità o determinare se un comportamento sospetto può essere considerato standard per tale applicazione nell'organizzazione.

Prerequisiti

Leggere la Panoramica - Protezione dalle minacce IA.

Abilitare la protezione dalle minacce per i carichi di lavoro di intelligenza artificiale (anteprima) in un'applicazione di intelligenza artificiale, con il modello sottostante OpenAI di Azure direttamente tramite il servizio Azure OpenAI. Si noti che questa funzionalità non è attualmente supportata quando si sfruttano i modelli distribuiti tramite l'API di inferenza del modello di intelligenza artificiale di Azure.

Aggiungere parametri di sicurezza alla chiamata di Azure OpenAI

Per ricevere avvisi di sicurezza IA con più contesto, è possibile aggiungere uno o tutti i parametri SecurityContext di esempio seguenti alle chiamate dell'API Azure OpenAI.

Tutti i campi in SecurityContext sono facoltativi.

Per il contesto dell'utente finale, è consigliabile passare almeno i EndUserId campi e SourceIP . I campi EndUserId e SourceIP forniscono agli analisti del Centro operazioni per la sicurezza (SOC) la possibilità di analizzare incidenti di sicurezza che coinvolgono risorse IA e applicazioni IA generative.

Per il contesto dell'applicazione, è sufficiente passare il applicationName campo come stringa semplice.

Se il nome di un campo viene digitato in modo non corretto, la chiamata dell'API Azure OpenAI avrà comunque esito positivo. Lo schema SecurityContext non richiede la convalida per passare al campo utente di Azure OpenAI. Gli sviluppatori di applicazioni devono assicurarsi che venga passato un codice JSON valido al campo user in ogni richiesta effettuata dall'applicazione ad Azure OpenAI.

Schema SecurityContext

Lo schema esatto è disponibile nella documentazione di riferimento dell'API REST OpenAI di Azure.

L'oggetto contesto di sicurezza utente fa parte del corpo della richiesta dell'API di completamento della chat.

Questa funzionalità non è attualmente supportata quando si sfruttano i modelli distribuiti tramite l'API di inferenza del modello di intelligenza artificiale di Azure.