Examiner comment Microsoft s’engage en matière d’IA responsable

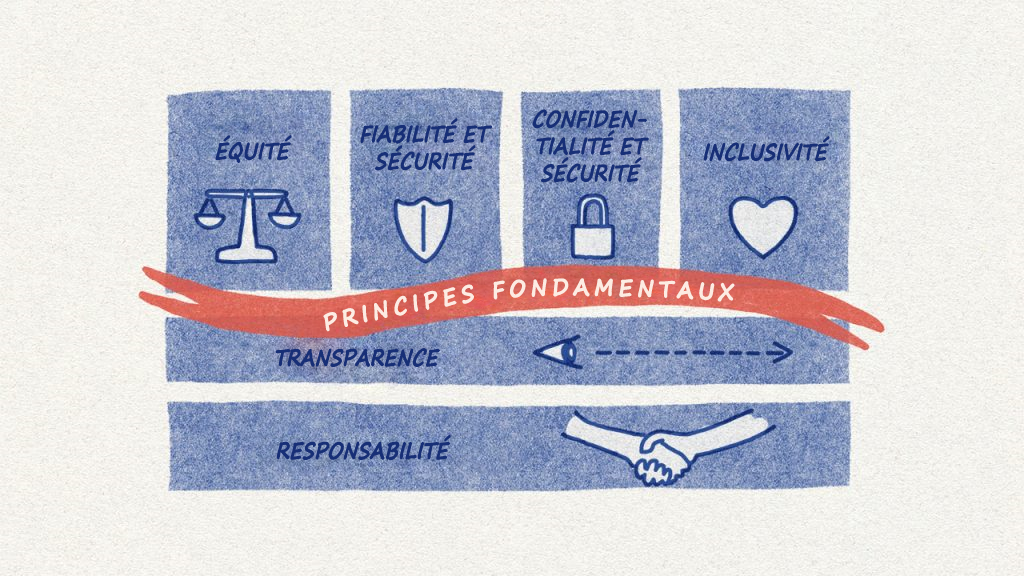

Microsoft intègre l’IA dans ses opérations en mettant l’accent sur l’éthique et la responsabilité. Les principes directeurs de cette approche sont les suivants :

- Équité. Microsoft vise à éliminer les préjugés et à garantir l'égalité de traitement pour tous les utilisateurs.

- Fiabilité et Sécurité. Des tests rigoureux garantissent que l’IA de Microsoft fonctionne de manière cohérente et sécurisée.

- Confidentialité et Sécurité. Vos données sont protégées. Dans les phases de formation et de post-déploiement, Microsoft met l’accent sur la protection des données personnelles des utilisateurs.

- Inclusion. Les outils basés sur l’IA sont conçus pour être accessibles et bénéfiques à tout le monde, quels que soient les capacités physiques, le sexe ou l’origine ethnique.

- Transparence. Microsoft s’engage à tenir les utilisateurs informés sur le fonctionnement de ses systèmes d’IA et leurs objectifs prévus.

- Responsabilité. Les normes éthiques et juridiques sont une priorité, les développeurs et les concepteurs d’IA étant tenus responsables de leurs créations.

Stratégie de Microsoft pour une IA responsable

Microsoft est un leader mondial dans le développement et le déploiement de solutions d’IA éthiques, fiables et sécurisées. Pour atteindre cette vision, Microsoft a investi dans différentes équipes, processus, ressources et initiatives qui fonctionnent en collaboration pour s’assurer que l’IA est conçue et utilisée de manière responsable et transparente. Dans cette note, Brad Smith a publié un plan pour la gouvernance de l’IA qui présente les propositions de Microsoft aux gouvernements et autres parties prenantes pour la création de cadres de travail réglementaires extensibles, interopérables et appropriés pour l’IA.

En outre, les ingénieurs Microsoft créent des produits et services d’IA conformes aux normes élevées contenues dans la norme IA responsable v2. Les experts en sécurité Microsoft protègent la confidentialité, l’intégrité et la disponibilité des systèmes et des données d’IA contre les attaques malveillantes et les accès non autorisés. Dans le cadre du programme AI Assurance de Microsoft, Microsoft développe également des outils et des cadres de travail pour aider les clients dans leurs efforts de sécurisation de leurs propres déploiements d’IA et d’atténuation des risques potentiels.

Microsoft associe l’ensemble des éléments suivants :

- Principes éthiques de l’IA

- Normes de conformité pour une IA responsable

- Recherche complète sur l’IA, y compris l’apprentissage automatique centré sur la confidentialité

Une équipe interdisciplinaire de chercheurs, d’ingénieurs et de spécialistes en politiques affine continuellement les systèmes d’IA de Microsoft. Ils travaillent sur l’amélioration des données d’apprentissage, le filtrage du contenu nuisible et la résolution des biais.

La mission de Microsoft est double : s’assurer que les systèmes d’IA sont compris et dignes de confiance, et fournir aux clients les connaissances nécessaires pour utiliser l’IA de manière responsable.