Gestion de la posture de sécurité de l’IA

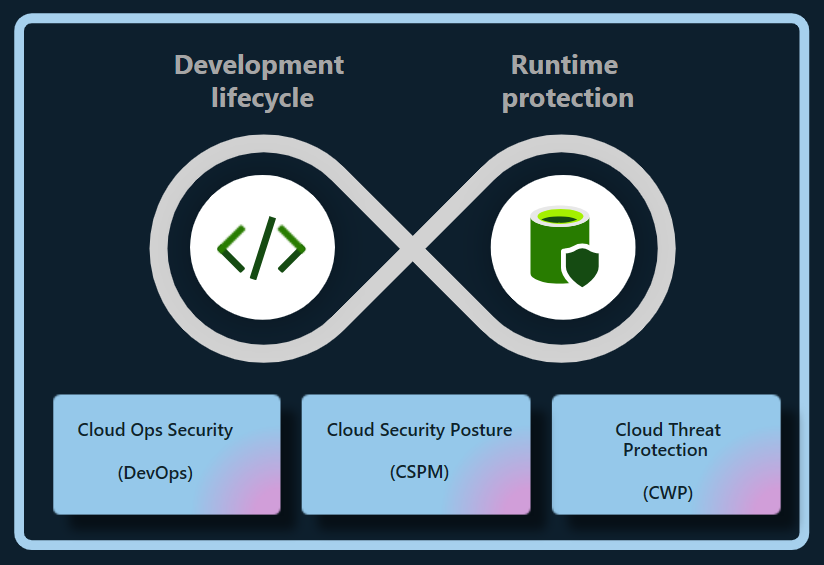

Le plan CSPM (Gestion de la posture de sécurité cloud) de Microsoft Defender pour le cloud fournit des fonctionnalités de gestion de la posture de sécurité de l’IA qui sécurisent les applications d’IA générées par l’entreprise, multi ou hybride (actuellement Azure et AWS), tout au long du cycle de vie de l’application. Defender pour le cloud réduit les risques liés aux charges de travail IA dans le cloud en effectuant les opérations suivantes :

- Découverte de la facture d’IA générative (Bill of Materials, BOM), qui inclut des composants d’application, des données et des artefacts IA de code vers le cloud.

- Renforcement de la posture de sécurité des applications IA générative avec des recommandations intégrées et en explorant et en corrigeant les risques de sécurité.

- Utilisation de l’analyse du chemin d’attaque pour identifier et corriger les risques.

Important

Pour activer les fonctionnalités de gestion de la posture de sécurité IA sur un compte AWS :

- Déjà connecté à votre compte Azure.

- Pour lequel Defender CSPM est activé.

- Qui dispose d’un type d’autorisations défini sur Accès au privilège minimum.

Pour activer les autorisations appropriées, vous devez reconfigurer les autorisations sur ce connecteur en suivant les étapes suivantes :

- Dans le Portail Azure, accédez à la page Paramètres d’environnement et sélectionnez le connecteur AWS approprié.

- Sélectionnez Configurer l’accès.

- Vérifiez que le type d’autorisations est défini sur Accès au privilège minimum.

- Suivez les étapes 5 à 8 pour terminer la configuration.

Découvrir les applications IA génératives

Defender pour le cloud découvre les charges de travail IA et identifie les détails de BOM IA de votre organisation. Cette visibilité vous permet d’identifier et de résoudre les vulnérabilités et de protéger les applications IA générative contre les menaces potentielles.

Defenders pour le cloud découvre automatiquement et en permanence les charges de travail d’IA déployées dans les services suivants :

- Azure OpenAI Service

- Azure Machine Learning

- Amazon Bedrock

Defender pour le cloud peut également découvrir des vulnérabilités dans les dépendances de bibliothèque IA générative telles que TensorFlow, PyTorch et Langchain, en analysant le code source pour les configurations incorrectes de l’infrastructure en tant que code (IaC) et les images conteneur pour les vulnérabilités. La mise à jour ou la mise à jour corrective régulière des bibliothèques peut empêcher les attaques, protéger les applications IA générative et maintenir leur intégrité.

Avec ces fonctionnalités, Defender pour le cloud offre une visibilité complète des charges de travail IA du code au cloud.

Réduire les risques pour les applications IA génératives

Defender CSPM fournit des insights contextuels sur la posture de sécurité de l’IA d’une organisation. Vous pouvez réduire les risques au sein de vos charges de travail IA à l’aide des recommandations de sécurité et de l’analyse du chemin d’accès aux attaques.

Explorer les risques à l’aide de recommandations

Defender pour le cloud évalue les charges de travail IA et émet des recommandations relatives à l’identité, à la sécurité des données et à l’exposition à Internet pour identifier et hiérarchiser les problèmes de sécurité critiques dans les charges de travail IA.

Détecter les erreurs de configuration de l’IaC

La sécurité DevOps détecte les configurations incorrectes IaC, qui peuvent exposer des applications IA générative à des vulnérabilités de sécurité, telles que des contrôles d’accès sur-exposés ou des services exposés publiquement par inadvertance. Ces erreurs de configuration peuvent entraîner des violations de données, des accès non autorisés et des problèmes de conformité, en particulier lors de la gestion de réglementations strictes en matière de confidentialité des données.

Defender pour le cloud évalue votre configuration d’applications IA générative et fournit des recommandations de sécurité pour améliorer la posture de sécurité de l’IA.

Les configurations incorrectes détectées doivent être corrigées au début du cycle de développement pour éviter des problèmes plus complexes plus tard.

Les vérifications de sécurité IaC actuelles sont les suivantes :

- Utiliser des points de terminaison privés Azure AI Service

- Restreindre les points de terminaison de service Azure AI

- Utiliser l’identité managée pour les comptes de service Azure AI

- Utiliser l’authentification basée sur l’identité pour les comptes de service Azure AI

Explorer les risques avec l’analyse des chemins d’attaque

L’analyse des chemins d’attaque détecte et atténue les risques liés aux charges de travail IA, en particulier lors de la mise au point (liaison de modèles IA à des données spécifiques) et d’un réglage précis (ajustement d’un modèle préentraîné sur un jeu de données spécifique pour améliorer ses performances sur une tâche associée), où les données peuvent être exposées.

En analysant en permanence les charges de travail IA, l’analyse du chemin d’attaque peut identifier les faiblesses et les vulnérabilités potentielles et suivre les recommandations. En outre, il s’étend aux cas où les données et les ressources de calcul sont distribuées dans Azure, AWS et GCP.