Superviser un runtime d’intégration dans un réseau virtuel managé

S’APPLIQUE À :  Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Conseil

Essayez Data Factory dans Microsoft Fabric, une solution d’analyse tout-en-un pour les entreprises. Microsoft Fabric couvre tous les aspects, du déplacement des données à la science des données, en passant par l’analyse en temps réel, l’aide à la décision et la création de rapports. Découvrez comment démarrer un nouvel essai gratuitement !

Vous pouvez utiliser un réseau virtuel managé Azure Data Factory pour connecter en toute sécurité vos sources de données à un réseau virtuel que le service Data Factory manage. Grâce à cette fonctionnalité, vous pouvez établir un environnement privé et isolé pour vos processus d’orchestration et d’intégration de données.

Lorsque vous utilisez un réseau virtuel managé, vous combinez les fonctionnalités d’intégration et d’orchestration des données dans Data Factory avec la sécurité et la flexibilité des réseaux virtuels Azure. Il vous permet de créer des pipelines d’intégration de données robustes, évolutifs et sécurisés qui se connectent en toute transparence à vos ressources réseau, qu’elles soient locales ou dans le cloud.

Un problème courant du calcul managé est le manque de visibilité sur les performances et l’intégrité, en particulier dans un environnement de réseau virtuel managé. Sans supervision appropriée, l’identification et la résolution des problèmes deviennent difficiles et peuvent entraîner des retards, des erreurs et une dégradation des performances potentiels.

En utilisant la supervision améliorée dans Data Factory, vous pouvez obtenir des insights précieux sur vos processus d’intégration de données. Ces insights peuvent améliorer l’efficacité, l’utilisation des ressources et les performances globales. Grâce à la surveillance proactive et aux alertes en temps opportun, vous pouvez résoudre les problèmes, optimiser les flux de travail et garantir la bonne exécution de vos pipelines d’intégration de données dans l’environnement de réseau virtuel managé.

Nouvelles métriques

L’introduction de nouvelles métriques améliore la visibilité et les capacités de supervision dans les environnements de réseau virtuel managé.

Azure Data Factory fournit trois types distincts de pools de calcul :

- Calcul pour une activité de copie

- Calcul pour une activité de pipeline, comme une recherche

- Calcul pour une activité externe, comme un notebook Azure Databricks

Ces pools de calcul offrent flexibilité et scalabilité pour prendre en charge diverses charges de travail et allouer les ressources de manière optimale. Chacun d’eux est adapté pour gérer des exigences d’exécution d’activité spécifiques.

Pour aider à garantir une supervision cohérente et complète sur tous les pools de calcul, nous avons implémenté les mêmes ensembles de métriques de supervision :

- Utilisation de la capacité

- Pourcentage de capacité disponible

- Longueur de la file d’attente

Quel que soit le type de pool de calcul que vous utilisez, vous pouvez accéder à un ensemble standardisé de métriques et les analyser pour obtenir des insights sur les performances et l’intégrité de vos activités d’intégration de données.

Notes

Ces métriques sont valides uniquement lorsque vous activez la durée de vie (TTL) dans un runtime d’intégration dans un réseau virtuel managé.

| Métrique | Unité | Description |

|---|---|---|

| Utilisation de la capacité Copy du runtime d’intégration MVNet | Pourcentage | Pourcentage maximal d’utilisation d’unités de Intégration de données (DIU) pour les activités de copie TTL dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Pourcentage de capacité de copie disponible du runtime d’intégration MVNet | Pourcentage | Pourcentage maximal de DIU disponibles pour les activités de copie TTL dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Longueur de file d’attente de copie du runtime d’intégration MVNet | Count | Longueur de file d’attente d’attente des activités de copie TTL dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Utilisation de la capacité de pipeline du runtime d’intégration MVNet | Pourcentage | Pourcentage maximal d’utilisation de DIU pour les activités de pipeline dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Pourcentage de capacité de pipeline disponible du runtime d’intégration MVNet | Pourcentage | Pourcentage maximal de DIU disponibles pour les activités de pipeline dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Longueur de la file d’attente de pipeline du runtime d’intégration MVNet | Count | Longueur de file d’attente des activités de pipeline dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Utilisation de la capacité externe du runtime d’intégration MVNet | Pourcentage | Pourcentage maximal d’utilisation de DIU pour les activités externes dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Pourcentage de capacité externe disponible du runtime d’intégration MVNet | Pourcentage | Pourcentage maximal de DIU disponibles pour les activités externes dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

| Longueur de la file d’attente externe du runtime d’intégration MVNet | Count | Longueur de file d’attente des activités externes dans le runtime d’intégration d’un réseau virtuel managé dans une fenêtre d’une minute. |

Pour obtenir plus d’informations sur ces mesures, consultez Métriques prises en charge pour Microsoft.DataFactory/factories.

Utilisation de métriques pour l’optimisation des performances

En utilisant les métriques, vous pouvez suivre et évaluer en toute transparence les performances et la robustesse de votre runtime d’intégration dans un réseau virtuel managé. Vous pouvez également découvrir les zones potentielles d’amélioration continue en optimisant les paramètres de calcul et le flux de travail pour optimiser l’efficacité.

Pour fournir plus de clarté sur l’application pratique de ces métriques, voici quelques exemples de scénarios.

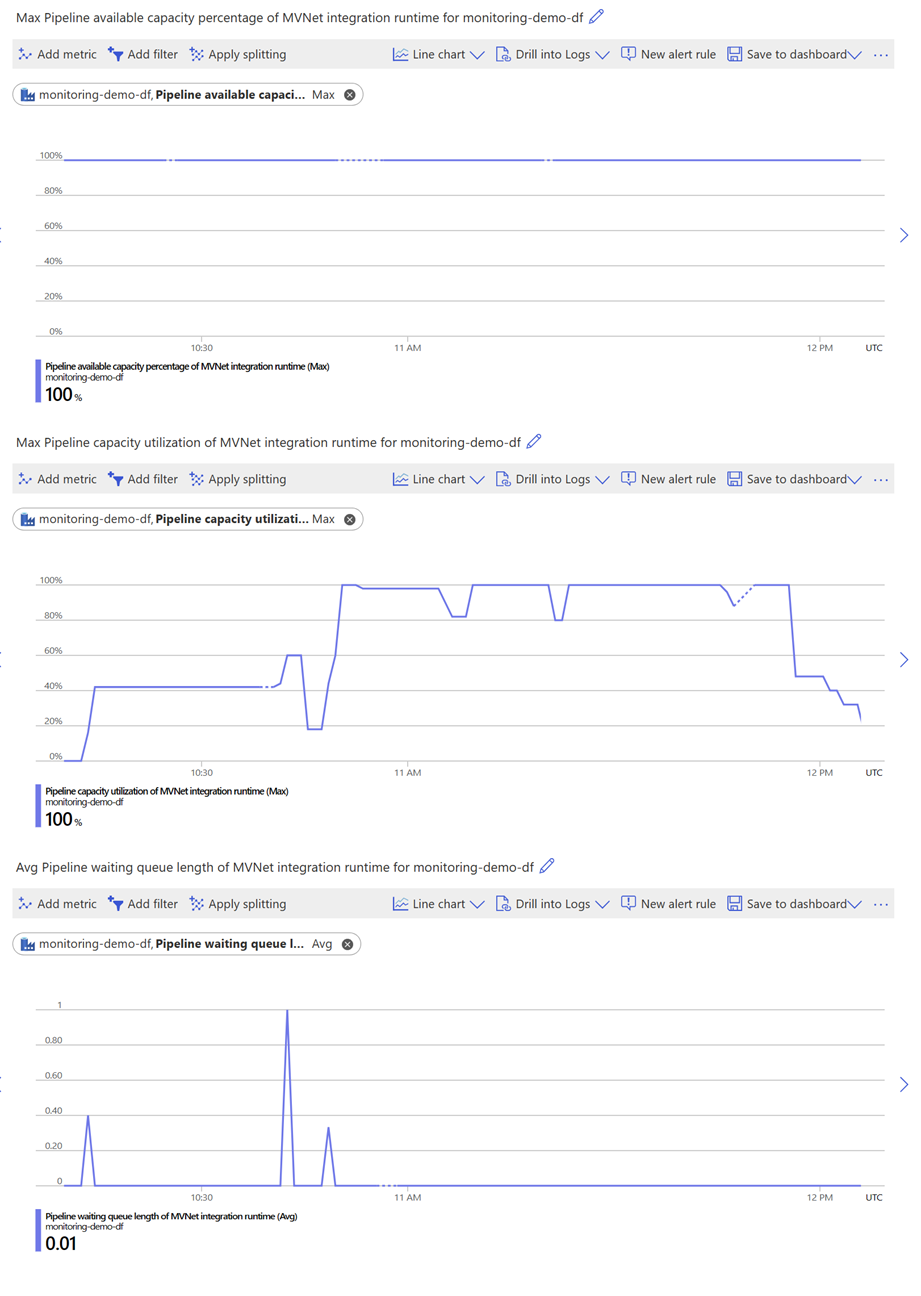

Équilibrée

Si vous constatez que l’utilisation de la capacité est inférieure à 100 % et que le pourcentage de capacité disponible est élevé, les ressources de calcul que vous avez réservées sont utilisées efficacement.

Si la longueur de la file d’attente reste continuellement faible ou que des pics occasionnels sont courts, nous vous conseillons de mettre en file d’attente d’autres activités jusqu’à ce que l’utilisation de la capacité atteigne 100 %. Cette approche permet de garantir une utilisation optimale des ressources et de maintenir un flux de travail fluide avec des délais minimaux.

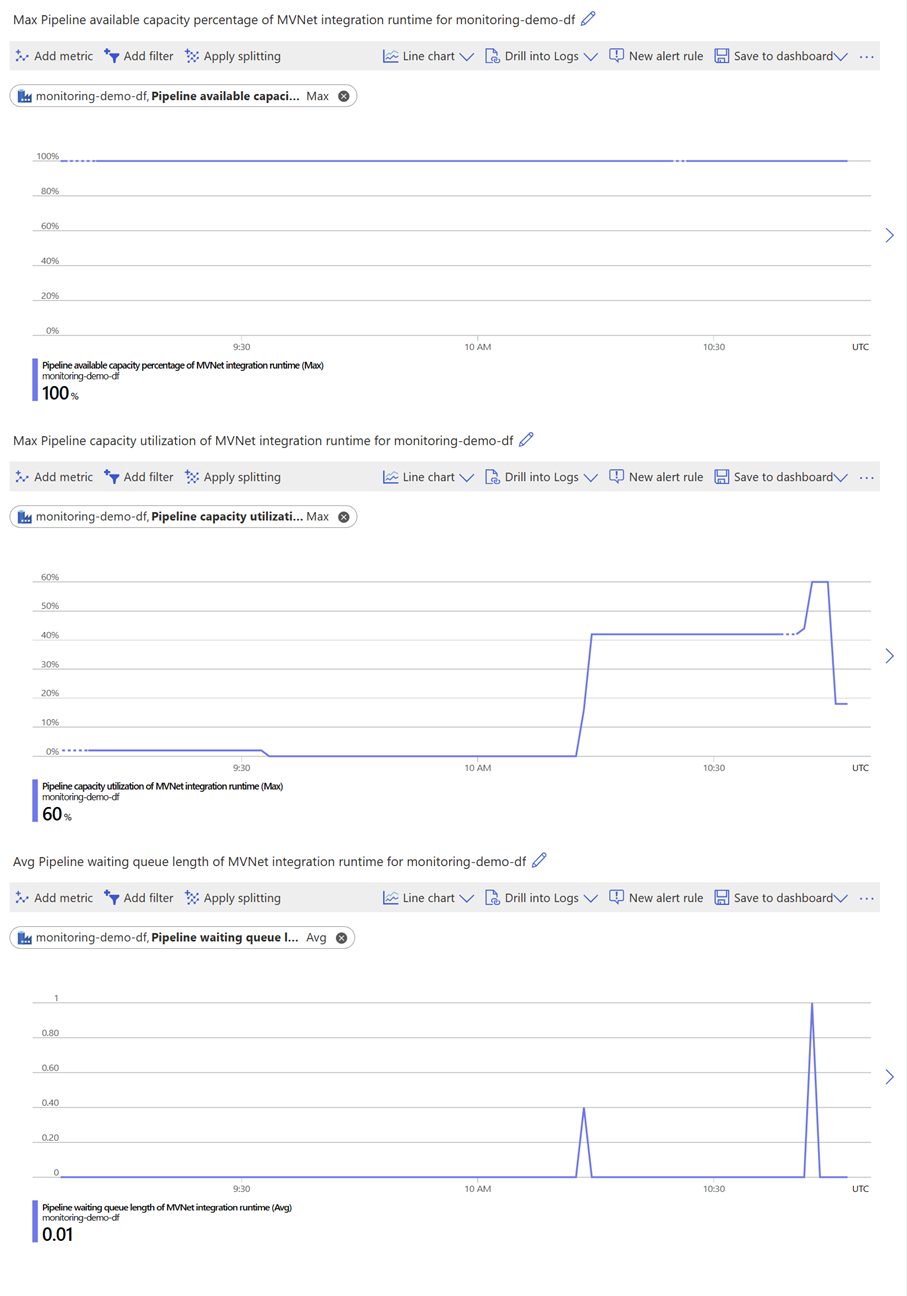

Axé sur les performances

Si vous constatez que l’utilisation de la capacité est constamment faible et que la longueur de la file d’attente reste constamment faible ou que des pics occasionnels sont courts, les ressources de calcul que vous avez réservées sont supérieures à la demande d’activités.

Dans ce cas, que le pourcentage de capacité disponible soit élevé ou faible, nous vous recommandons de réduire les ressources de calcul allouées pour réduire vos coûts. Grâce à un dimensionnement adéquat du calcul en fonction des exigences des charges de travail, vous pouvez optimiser l’utilisation de vos ressources et réaliser des économies sans compromettre l’efficacité de vos opérations.

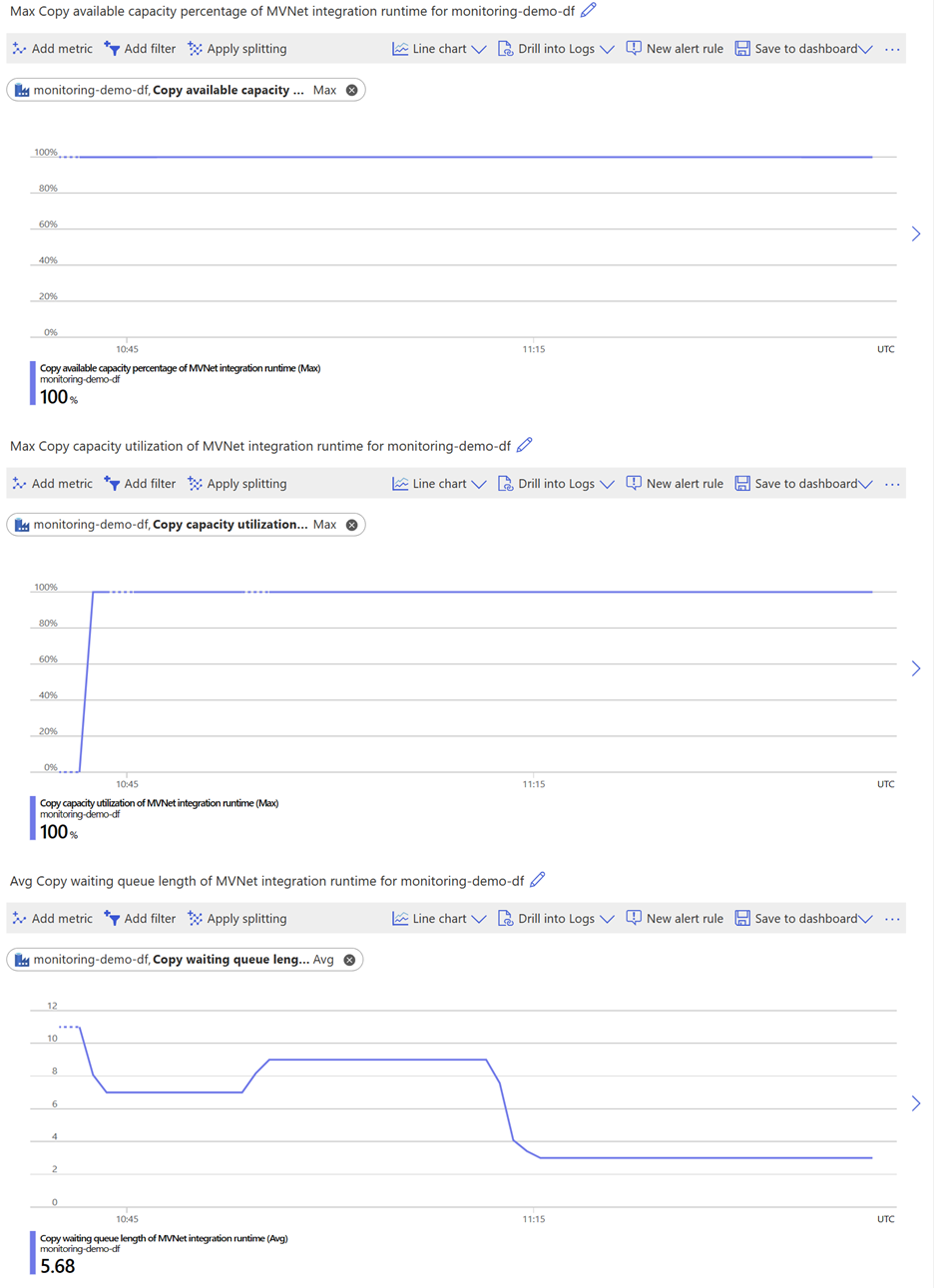

Axé sur les coûts

Si vous remarquez que toutes les métriques (y compris l’utilisation de la capacité, le pourcentage de capacité disponible et la longueur de la file d’attente) sont élevées, les ressources de calcul que vous avez réservées sont probablement insuffisantes pour vos activités.

Dans ce scénario, nous vous recommandons d’augmenter les ressources de calcul allouées pour réduire le temps en file d’attente. L’ajout d’une capacité de calcul supplémentaire permet de s’assurer que vos activités disposent de suffisamment de ressources pour s’exécuter efficacement, ce qui réduit les retards provoqués par une file d’attente encombrée.

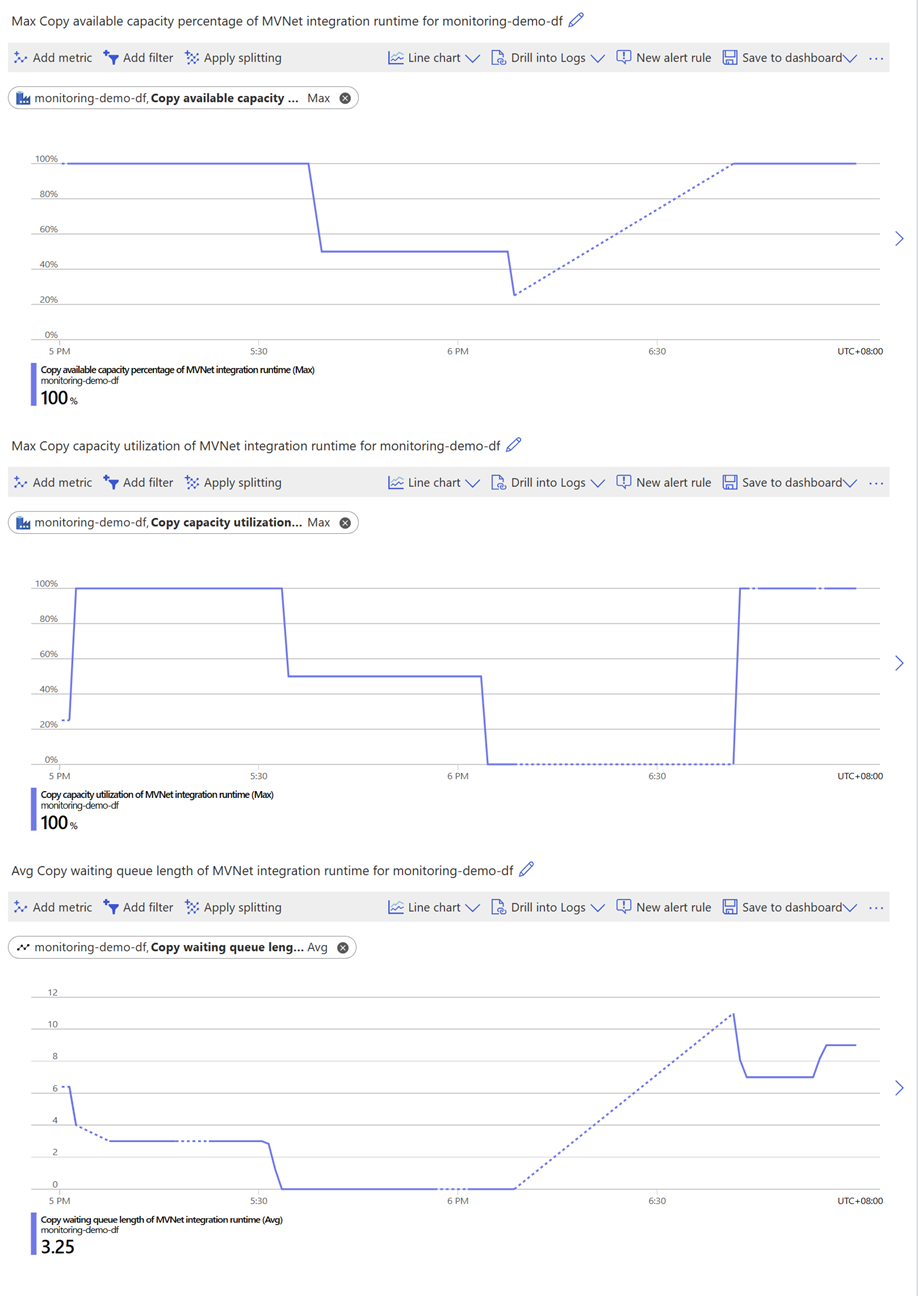

Exécution d’activité intermittente

Si vous remarquez que le pourcentage de capacité disponible oscille entre le faible et le haut au cours d’une période spécifique, cela est probablement dû à l’exécution intermittente de vos activités, où la période de durée de vie (TTL) que vous avez configurée est plus courte que l’intervalle entre vos activités. Cela peut avoir un impact significatif sur les performances de votre workflow. Pour résoudre ce problème, il existe deux solutions possibles. Tout d’abord, vous pouvez mettre en file d’attente davantage d’activités pour maintenir une charge de travail cohérente et utiliser les ressources de calcul disponibles plus efficacement. En gardant le calcul continuellement engagé, vous pouvez éviter le temps de préchauffage et obtenir de meilleures performances. Vous pouvez également envisager d’élargir la période de durée de vie pour l’aligner sur l’intervalle entre vos activités. Cela garantit que les ressources de calcul restent disponibles plus longtemps, ce qui réduit la fréquence des périodes de préchauffage et optimise la rentabilité.

En implémentant l’une de ces solutions, vous pouvez améliorer les performances de votre flux de travail, réduire les coûts et garantir une exécution plus fluide de vos activités intermittentes.

Contenu connexe

Passez au tutoriel suivant pour en savoir plus sur les réseaux virtuels managés et les points de terminaison privés managés : Réseau virtuel privé Azure Data Factory.