Modèle de lecture d’Intelligence documentaire

Ce contenu s’applique à :![]() v4.0 (GA) | Versions précédentes :

v4.0 (GA) | Versions précédentes :![]() v3.1 (GA)

v3.1 (GA)![]() v3.0 (GA)

v3.0 (GA)

Remarque

Pour extraire du texte à partir d’images externes telles que des étiquettes, des panneaux de rue et des affiches, utilisez la fonctionnalité Azure AI Image Analysis v4.0 Lecture optimisée pour les images générales (et non de document) avec une API synchrone améliorée en matière de performances. Cette fonctionnalité facilite l’incorporation d’OCR dans des scénarios d’expérience utilisateur en temps réel.

Le modèle de reconnaissance optique de caractères (OCR) Document Intelligence Read s'exécute à une résolution supérieure à celle d'Azure AI Vision Read et extrait les textes imprimés et manuscrits des documents PDF et des images numérisées. Il comprend également une prise en charge de l’extraction de texte à partir de documents Microsoft Word, Excel, PowerPoint et HTML. Il détecte les paragraphes, les lignes de texte, les mots, les localisations et les langues. Le modèle de lecture est le moteur d'OCR sous-jacent pour d'autres modèles prédéfinis de Document Intelligence tels que Disposition, Document général, Facture, Reçu, (ID) Document d’identité, Carte d’assurance maladie, W2 ainsi que des modèles personnalisés.

Qu’est-ce que la reconnaissance optique de caractères ?

La reconnaissance optique de caractères (OCR) des documents est optimisée pour les documents volumineux contenant beaucoup de texte dans plusieurs formats de fichiers et langues internationales. Il comprend des fonctionnalités telles que la numérisation à plus haute résolution des images de document pour une meilleure gestion du texte plus petit et dense, la détection de paragraphes et la gestion des formulaires pouvant être remplis. Les fonctionnalités OCR incluent également des scénarios avancés tels que les zones à caractère unique et une extraction précise des champs clés couramment trouvés dans les factures, les reçus et d’autres scénarios prédéfinis.

Options de développement (v4)

Intelligence documentaire v4.0 : 2024-11-30 (GA) prend en charge les outils, applications et bibliothèques suivants :

| Fonctionnalité | Ressources | ID de modèle |

|---|---|---|

| Modèle de lecture OCR | • Document Intelligence Studio • API REST • Kit de développement logiciel (SDK) C# • Kit de développement logiciel (SDK) Python • Kit de développement logiciel (SDK) Java • Kit de développement logiciel (SDK) JavaScript |

prebuilt-read |

Exigences relatives aux entrées (v4)

Formats de fichiers pris en charge :

| Modèle | Image : JPEG/JPG, PNG, BMP, TIFF, HEIF |

Microsoft Office : Word ( DOCX), Excel (XLSX), PowerPoint (PPTX), HTML |

|

|---|---|---|---|

| Lire | ✔ | ✔ | ✔ |

| Layout | ✔ | ✔ | ✔ |

| Document général | ✔ | ✔ | |

| Prédéfinie | ✔ | ✔ | |

| Extraction personnalisée | ✔ | ✔ | |

| Classification personnalisée | ✔ | ✔ | ✔ |

Pour de meilleurs résultats, fournissez une photo nette ou une copie de qualité par document.

Pour les PDF et TIFF, jusqu'à 2 000 pages peuvent être traitées (avec un abonnement gratuit, seules les deux premières pages sont traitées).

La taille de fichier pour l’analyse de documents est de 500 Mo pour le niveau payant (S0) et de

4Mo pour le niveau gratuit (F0).Les dimensions de l’image doivent être comprises entre 50 pixels x 50 pixels et 10 000 pixels x 10 000 pixels.

Si vos fichiers PDF sont verrouillés par mot de passe, vous devez supprimer le verrou avant leur envoi.

La hauteur minimale du texte à extraire est de 12 pixels pour une image de 1024 x 768 pixels. Cette dimension correspond environ à un texte de

8points à 150 points par pouce (ppp).Pour la formation de modèles personnalisés, le nombre maximal de pages pour les données de formation est de 500 pour le modèle personnalisé et 50 000 pour le modèle neural personnalisé.

Pour l’apprentissage du modèle d’extraction personnalisé, la taille totale des données d’entraînement est de 50 Mo pour le modèle de gabarit et de

1Go pour le modèle neuronal.Pour l’apprentissage du modèle de classification personnalisé, la taille totale des données d’entraînement est de

1Go, avec un maximum de 10 000 pages. Pour 2024-11-30 (GA), la taille totale des données d’entraînement est de2Go, avec un maximum de 10 000 pages.

Bien démarrer avec le modèle de lecture (v4)

Essayez d’extraire du texte à partir des formulaires et des documents à l’aide de Document Intelligence Studio. Vous avez besoin des ressources suivantes :

Un abonnement Azure. Vous pouvez en créer un gratuitement.

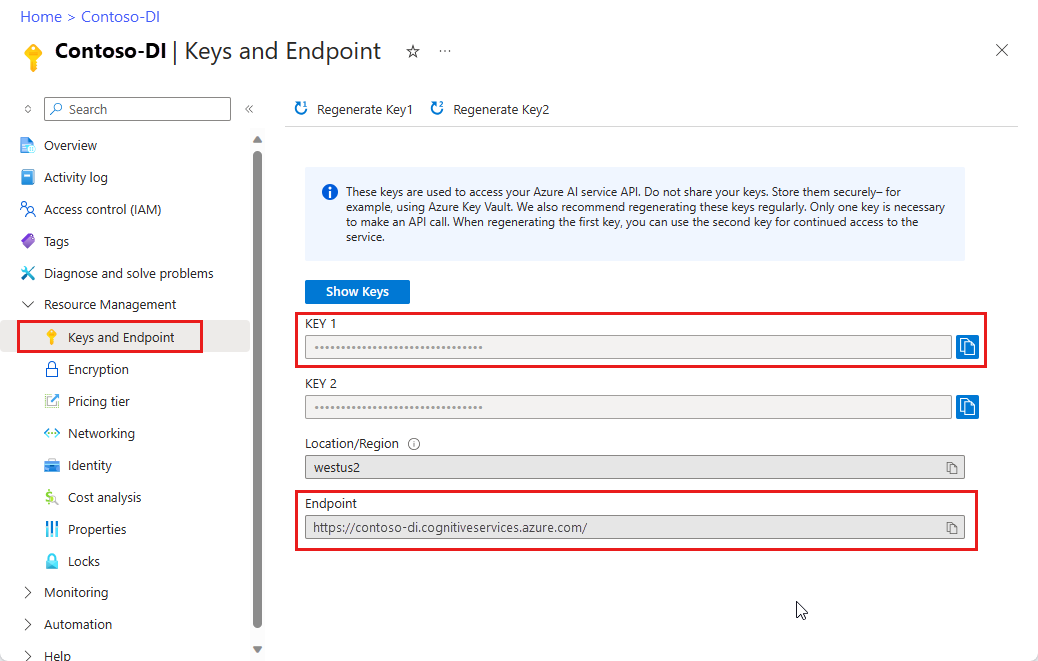

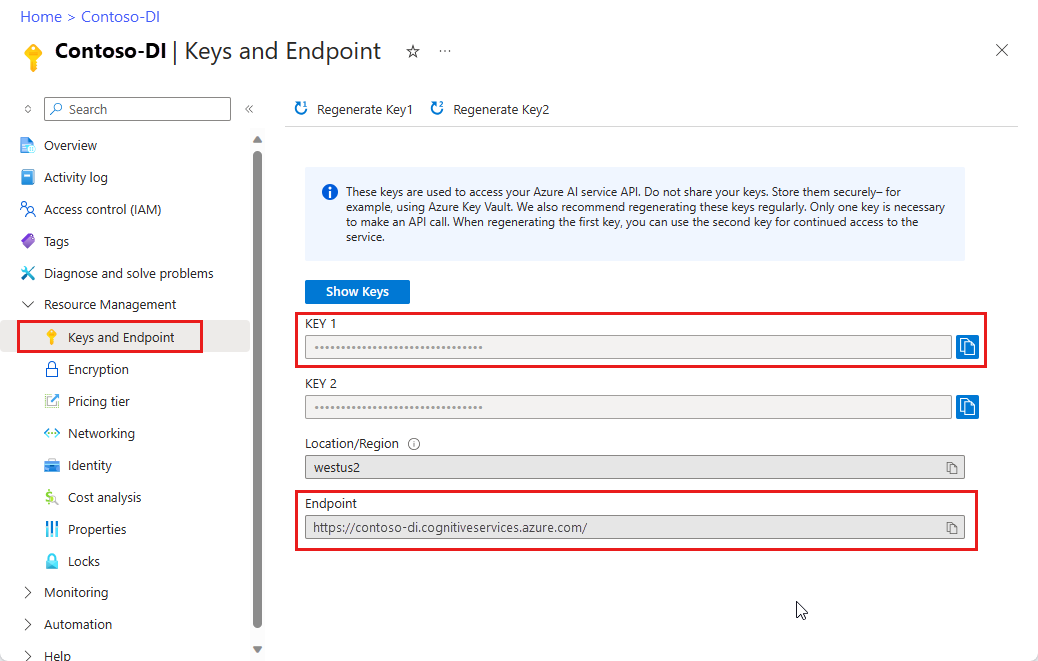

Instance Intelligence documentaire dans le Portail Azure. Vous pouvez utiliser le niveau tarifaire gratuit (

F0) pour tester le service. Une fois votre ressource déployée, sélectionnez Accéder à la ressource pour accéder à la clé et au point de terminaison.

Remarque

Actuellement, Document Intelligence Studio ne prend pas en charge les formats de fichiers Microsoft Word, Excel, PowerPoint et HTML.

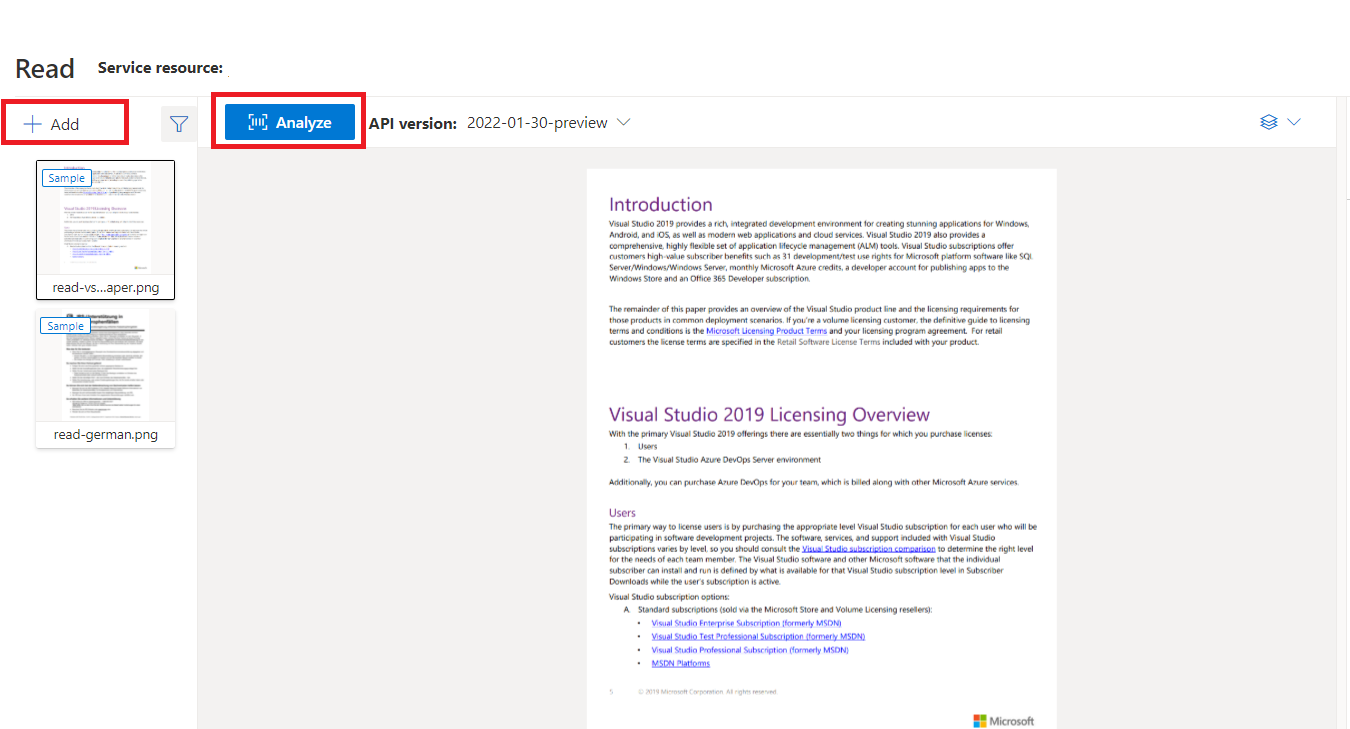

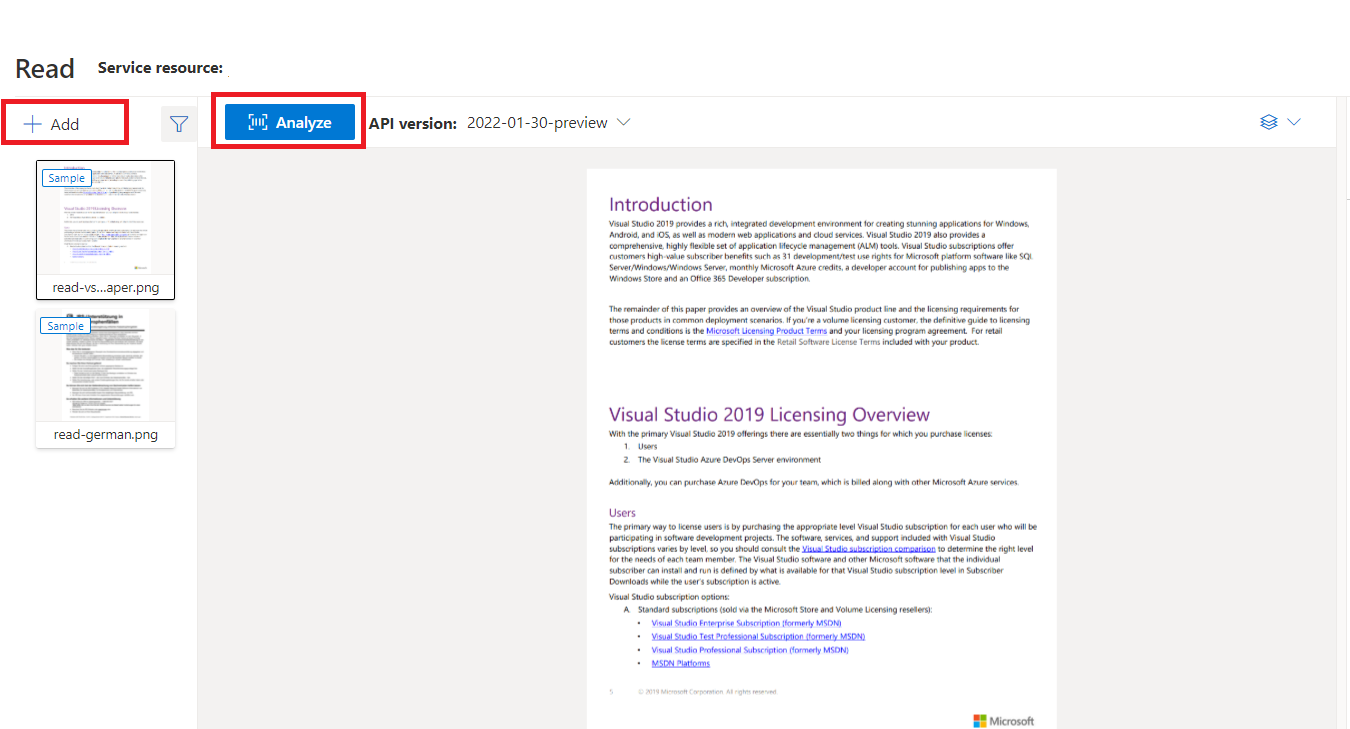

Exemple de document traité avec Document Intelligence Studio

Dans la page d’accueil de Document Intelligence Studio, sélectionnez Read.

Vous pouvez analyser l’exemple de document ou charger vos propres fichiers.

Sélectionnez le bouton Exécuter l’analyse et, si nécessaire, configurez les Options d’analyse :

Langues et paramètres régionaux pris en charge (v4)

Pour obtenir la liste complète des langues prises en charge, consultez notre page Support linguistique – Modèles d’analyse de documents.

Extraction de données (v4)

Remarque

Les fichiers Microsoft Word et HTML sont pris en charge dans la version 4.0. Les fonctionnalités suivantes ne sont actuellement pas prises en charge :

- Aucun angle, largeur/hauteur et unité retourné avec chaque objet de page.

- Aucun polygone englobant ni région englobante pour chaque objet détecté.

- Aucune plage de pages (

pages) en tant que paramètre retourné. - Aucun objet

lines.

Fichiers PDF pouvant faire l’objet d’une recherche

La fonctionnalité PDF pouvant faire l’objet d’une recherche vous permet de convertir un fichier PDF analogique, tel que des fichiers PDF d’images numérisées, en PDF avec du texte incorporé. Le texte incorporé permet une recherche en texte profond dans le contenu extrait du PDF en superposant les entités de texte détectées au-dessus des fichiers image.

Important

- Actuellement, seul le modèle OCR en lecture

prebuilt-readprend en charge la fonctionnalité PDF pouvant faire l’objet d’une recherche. Lorsque vous utilisez cette fonctionnalité, définissezmodelIdcommeprebuilt-read. D’autres types de modèle retournent une erreur pour cette préversion. - Le fichier PDF pouvant faire l’objet d’une recherche est inclus dans le modèle

2024-11-30GAprebuilt-readsans coût supplémentaire pour générer une sortie PDF pouvant faire l’objet d’une recherche.

Utiliser des fichiers PDF pouvant faire l’objet d’une recherche

Pour utiliser la fonctionnalité PDF pouvant faire l’objet d’une recherche, effectuez une requête POST à l’aide de l’opération Analyze et spécifiez le format de sortie comme pdf :

POST {endpoint}/documentintelligence/documentModels/prebuilt-read:analyze?_overload=analyzeDocument&api-version=2024-11-30&output=pdf

{...}

202

Interrogez l’achèvement de l’opération Analyze. Une fois l’opération terminée, effectuez une requête GET pour récupérer le format PDF des résultats de l’opération Analyze.

Une fois l’opération terminée, le fichier PDF peut être récupéré et téléchargé en tant que application/pdf. Cette opération permet le téléchargement direct de la forme de texte incorporé au format PDF au lieu de JSON encodé en Base64.

// Monitor the operation until completion.

GET /documentModels/prebuilt-read/analyzeResults/{resultId}

200

{...}

// Upon successful completion, retrieve the PDF as application/pdf.

GET {endpoint}/documentintelligence/documentModels/prebuilt-read/analyzeResults/{resultId}/pdf?api-version=2024-11-30

URI Parameters

Name In Required Type Description

endpoint path True

string

uri

The Document Intelligence service endpoint.

modelId path True

string

Unique document model name.

Regex pattern: ^[a-zA-Z0-9][a-zA-Z0-9._~-]{1,63}$

resultId path True

string

uuid

Analyze operation result ID.

api-version query True

string

The API version to use for this operation.

Responses

Name Type Description

200 OK

file

The request has succeeded.

Media Types: "application/pdf", "application/json"

Other Status Codes

DocumentIntelligenceErrorResponse

An unexpected error response.

Media Types: "application/pdf", "application/json"

Security

Ocp-Apim-Subscription-Key

Type: apiKey

In: header

OAuth2Auth

Type: oauth2

Flow: accessCode

Authorization URL: https://login.microsoftonline.com/common/oauth2/authorize

Token URL: https://login.microsoftonline.com/common/oauth2/token

Scopes

Name Description

https://cognitiveservices.azure.com/.default

Examples

Get Analyze Document Result PDF

Sample request

HTTP

HTTP

Copy

GET https://myendpoint.cognitiveservices.azure.com/documentintelligence/documentModels/prebuilt-invoice/analyzeResults/3b31320d-8bab-4f88-b19c-2322a7f11034/pdf?api-version=2024-11-30

Sample response

Status code:

200

JSON

Copy

"{pdfBinary}"

Definitions

Name Description

DocumentIntelligenceError

The error object.

DocumentIntelligenceErrorResponse

Error response object.

DocumentIntelligenceInnerError

An object containing more specific information about the error.

DocumentIntelligenceError

The error object.

Name Type Description

code

string

One of a server-defined set of error codes.

details

DocumentIntelligenceError[]

An array of details about specific errors that led to this reported error.

innererror

DocumentIntelligenceInnerError

An object containing more specific information than the current object about the error.

message

string

A human-readable representation of the error.

target

string

The target of the error.

DocumentIntelligenceErrorResponse

Error response object.

Name Type Description

error

DocumentIntelligenceError

Error info.

DocumentIntelligenceInnerError

An object containing more specific information about the error.

Name Type Description

code

string

One of a server-defined set of error codes.

innererror

DocumentIntelligenceInnerError

Inner error.

message

string

A human-readable representation of the error.

In this article

URI Parameters

Responses

Security

Examples

200 OK

Content-Type: application/pdf

Paramètre Pages

La collection de pages est une liste de pages dans le document. Chaque page est représentée séquentiellement dans le document, et inclut l’angle d’orientation indiquant si la page est pivotée et la largeur et la hauteur (dimensions en pixels). Les unités de page dans la sortie du modèle sont calculées comme indiqué :

| Format de fichier | Unité de page calculée | Nombre total de pages |

|---|---|---|

| Images (JPEG/JPG, PNG, BMP, HEIF) | Chaque image = 1 unité de page | Nombre total d'images |

| Chaque page du PDF = 1 unité de page | Nombre total de pages dans le fichier PDF | |

| TIFF | Chaque image dans le fichier TIFF = 1 unité de page | Nombre total d’images dans le fichier TIFF |

| Word (DOCX) | Jusqu’à 3 000 caractères = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de pages allant jusqu’à 3 000 caractères chacune |

| Excel (XLSX) | Chaque feuille de calcul = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de feuilles de calcul |

| PowerPoint (PPTX) | Chaque diapositive = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de diapositives |

| HTML | Jusqu’à 3 000 caractères = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de pages allant jusqu’à 3 000 caractères chacune |

# Analyze pages.

for page in result.pages:

print(f"----Analyzing document from page #{page.page_number}----")

print(f"Page has width: {page.width} and height: {page.height}, measured with unit: {page.unit}")

Utiliser des pages pour l’extraction de texte

Pour les documents PDF volumineux comportant plusieurs pages, utilisez le paramètre de requête pages pour indiquer des numéros de page ou des plages de pages spécifiques pour l’extraction de texte.

Extraction de paragraphes

Le modèle OCR Read de Document Intelligence extrait tous les blocs de texte identifiés dans la collection paragraphs en tant qu’objet de premier niveau sous analyzeResults. Chaque entrée de cette collection représente un bloc de texte et inclut le texte extrait sous la forme content et les coordonnées polygon limitrophes. Les informations de span pointent vers le fragment de texte de la propriété content de premier niveau contenant le texte intégral du document.

"paragraphs": [

{

"spans": [],

"boundingRegions": [],

"content": "While healthcare is still in the early stages of its Al journey, we are seeing pharmaceutical and other life sciences organizations making major investments in Al and related technologies.\" TOM LAWRY | National Director for Al, Health and Life Sciences | Microsoft"

}

]

Extraction de texte, de lignes et de mots

Le modèle OCR Read extrait le texte imprimé et manuscrit sous forme de lines et de words. Le modèle génère des coordonnées englobantes polygon et confidence pour les mots extraits. La collection styles inclut tout style manuscrit pour les lignes détectées, ainsi que les étendues pointant vers le texte associé. Cette fonctionnalité s’applique aux langues manuscrites prises en charge.

Pour Microsoft Word, Excel, PowerPoint et HTML, le modèle Read d’Intelligence documentaire version 3.1 et versions ultérieures extrait tout le texte incorporé tel quel. Les textes sont extraits sous forme de mots et de paragraphes. Les images incorporées ne sont pas prises en charge.

# Analyze lines.

if page.lines:

for line_idx, line in enumerate(page.lines):

words = get_words(page, line)

print(

f"...Line # {line_idx} has {len(words)} words and text '{line.content}' within bounding polygon '{line.polygon}'"

)

# Analyze words.

for word in words:

print(f"......Word '{word.content}' has a confidence of {word.confidence}")

Extraction de style manuscrit

La réponse inclut le classement de chaque ligne de texte selon qu’elle est de style manuscrit ou non, avec un score de confiance. Pour plus d’informations, consultezles langues prises en charge par LUIS. L’exemple suivant montre un exemple d’extrait JSON.

"styles": [

{

"confidence": 0.95,

"spans": [

{

"offset": 509,

"length": 24

}

"isHandwritten": true

]

}

Si vous avez activé la fonctionnalité de complément de police/style, vous obtenez également le résultat de police/style dans le cadre de l’objet styles.

Étapes suivantes (v4.0)

Suivez un guide de démarrage rapide Document Intelligence :

Découvrir notre API REST :

Découvrez plus d’exemples sur GitHub :

Remarque

Pour extraire du texte à partir d’images externes telles que des étiquettes, des panneaux de rue et des affiches, utilisez la fonctionnalité Azure AI Image Analysis v4.0 Lecture optimisée pour les images générales (et non de document) avec une API synchrone améliorée en matière de performances. Cette fonctionnalité facilite l’incorporation d’OCR dans des scénarios d’expérience utilisateur en temps réel.

Le modèle de reconnaissance optique de caractères (OCR) Document Intelligence Read s'exécute à une résolution supérieure à celle d'Azure AI Vision Read et extrait les textes imprimés et manuscrits des documents PDF et des images numérisées. Il comprend également une prise en charge de l’extraction de texte à partir de documents Microsoft Word, Excel, PowerPoint et HTML. Il détecte les paragraphes, les lignes de texte, les mots, les localisations et les langues. Le modèle de lecture est le moteur d'OCR sous-jacent pour d'autres modèles prédéfinis de Document Intelligence tels que Disposition, Document général, Facture, Reçu, (ID) Document d’identité, Carte d’assurance maladie, W2 ainsi que des modèles personnalisés.

Qu’est-ce que l’OCR pour les documents ?

La reconnaissance optique de caractères (OCR) des documents est optimisée pour les documents volumineux contenant beaucoup de texte dans plusieurs formats de fichiers et langues internationales. Il comprend des fonctionnalités telles que la numérisation à plus haute résolution des images de document pour une meilleure gestion du texte plus petit et dense, la détection de paragraphes et la gestion des formulaires pouvant être remplis. Les fonctionnalités OCR incluent également des scénarios avancés tels que les zones à caractère unique et une extraction précise des champs clés couramment trouvés dans les factures, les reçus et d’autres scénarios prédéfinis.

Options de développement

Document Intelligence v3.1 prend en charge les outils, applications et bibliothèques suivants :

| Fonction | Ressources | ID de modèle |

|---|---|---|

| Modèle de lecture OCR | • Document Intelligence Studio • API REST • Kit de développement logiciel (SDK) C# • Kit de développement logiciel (SDK) Python • Kit de développement logiciel (SDK) Java • Kit de développement logiciel (SDK) JavaScript |

prebuilt-read |

Intelligence documentaire v3.0 prend en charge les outils, applications et bibliothèques suivants :

| Fonction | Ressources | ID de modèle |

|---|---|---|

| Modèle de lecture OCR | • Document Intelligence Studio • API REST • Kit de développement logiciel (SDK) C# • Kit de développement logiciel (SDK) Python • Kit de développement logiciel (SDK) Java • Kit de développement logiciel (SDK) JavaScript |

prebuilt-read |

Critères des entrées

Formats de fichiers pris en charge :

| Modèle | Image : JPEG/JPG, PNG, BMP, TIFF, HEIF |

Microsoft Office : Word ( DOCX), Excel (XLSX), PowerPoint (PPTX), HTML |

|

|---|---|---|---|

| Lire | ✔ | ✔ | ✔ |

| Layout | ✔ | ✔ | ✔ |

| Document général | ✔ | ✔ | |

| Prédéfinie | ✔ | ✔ | |

| Extraction personnalisée | ✔ | ✔ | |

| Classification personnalisée | ✔ | ✔ | ✔ |

Pour de meilleurs résultats, fournissez une photo nette ou une copie de qualité par document.

Pour les PDF et TIFF, jusqu'à 2 000 pages peuvent être traitées (avec un abonnement gratuit, seules les deux premières pages sont traitées).

La taille de fichier pour l’analyse de documents est de 500 Mo pour le niveau payant (S0) et de

4Mo pour le niveau gratuit (F0).Les dimensions de l’image doivent être comprises entre 50 pixels x 50 pixels et 10 000 pixels x 10 000 pixels.

Si vos fichiers PDF sont verrouillés par mot de passe, vous devez supprimer le verrou avant leur envoi.

La hauteur minimale du texte à extraire est de 12 pixels pour une image de 1024 x 768 pixels. Cette dimension correspond environ à un texte de

8points à 150 points par pouce (ppp).Pour la formation de modèles personnalisés, le nombre maximal de pages pour les données de formation est de 500 pour le modèle personnalisé et 50 000 pour le modèle neural personnalisé.

Pour l’apprentissage du modèle d’extraction personnalisé, la taille totale des données d’entraînement est de 50 Mo pour le modèle de gabarit et de

1Go pour le modèle neuronal.Pour l’apprentissage du modèle de classification personnalisé, la taille totale des données d’entraînement est de

1Go, avec un maximum de 10 000 pages. Pour 2024-11-30 (GA), la taille totale des données d’entraînement est de2Go, avec un maximum de 10 000 pages.

Bien démarrer avec le modèle Read

Essayez d’extraire du texte à partir des formulaires et des documents à l’aide de Document Intelligence Studio. Vous avez besoin des ressources suivantes :

Un abonnement Azure. Vous pouvez en créer un gratuitement.

Instance Intelligence documentaire dans le Portail Azure. Vous pouvez utiliser le niveau tarifaire gratuit (

F0) pour tester le service. Une fois votre ressource déployée, sélectionnez Accéder à la ressource pour accéder à la clé et au point de terminaison.

Remarque

Actuellement, Document Intelligence Studio ne prend pas en charge les formats de fichiers Microsoft Word, Excel, PowerPoint et HTML.

Exemple de document traité avec Document Intelligence Studio

Dans la page d’accueil de Document Intelligence Studio, sélectionnez Read.

Vous pouvez analyser l’exemple de document ou charger vos propres fichiers.

Sélectionnez le bouton Exécuter l’analyse et, si nécessaire, configurez les Options d’analyse :

Langues et régions prises en charge

Pour obtenir la liste complète des langues prises en charge, consultez notre page Support linguistique – Modèles d’analyse de documents.

Extraction de données

Remarque

Les fichiers Microsoft Word et HTML sont pris en charge dans la version 4.0. Les fonctionnalités suivantes ne sont actuellement pas prises en charge :

- Aucun angle, largeur/hauteur et unité retourné avec chaque objet de page.

- Aucun polygone englobant ni région englobante pour chaque objet détecté.

- Aucune plage de pages (

pages) en tant que paramètre retourné. - Aucun objet

lines.

PDF pouvant faire l’objet d’une recherche

La fonctionnalité PDF pouvant faire l’objet d’une recherche vous permet de convertir un fichier PDF analogique, tel que des fichiers PDF d’images numérisées, en PDF avec du texte incorporé. Le texte incorporé permet une recherche en texte profond dans le contenu extrait du PDF en superposant les entités de texte détectées au-dessus des fichiers image.

Important

- Actuellement, seul le modèle OCR en lecture

prebuilt-readprend en charge la fonctionnalité PDF pouvant faire l’objet d’une recherche. Lorsque vous utilisez cette fonctionnalité, définissezmodelIdcommeprebuilt-read. D’autres types de modèle retournent une erreur. - Le fichier PDF pouvant faire l’objet d’une recherche est inclus dans le modèle

2024-11-30prebuilt-readsans coût supplémentaire pour générer une sortie PDF pouvant faire l’objet d’une recherche.- La fonctionnalité PDF pouvant faire l’objet d’une recherche ne prend actuellement en charge que les fichiers PDF comme entrée.

Utiliser PDF pouvant faire l’objet d’une recherche

Pour utiliser la fonctionnalité PDF pouvant faire l’objet d’une recherche, effectuez une requête POST à l’aide de l’opération Analyze et spécifiez le format de sortie comme pdf :

POST /documentModels/prebuilt-read:analyze?output=pdf

{...}

202

Interrogez l’achèvement de l’opération Analyze. Une fois l’opération terminée, effectuez une requête GET pour récupérer le format PDF des résultats de l’opération Analyze.

Une fois l’opération terminée, le fichier PDF peut être récupéré et téléchargé en tant que application/pdf. Cette opération permet le téléchargement direct de la forme de texte incorporé au format PDF au lieu de JSON encodé en Base64.

// Monitor the operation until completion.

GET /documentModels/prebuilt-read/analyzeResults/{resultId}

200

{...}

// Upon successful completion, retrieve the PDF as application/pdf.

GET /documentModels/prebuilt-read/analyzeResults/{resultId}/pdf

200 OK

Content-Type: application/pdf

Pages

La collection de pages est une liste de pages dans le document. Chaque page est représentée séquentiellement dans le document, et inclut l’angle d’orientation indiquant si la page est pivotée et la largeur et la hauteur (dimensions en pixels). Les unités de page dans la sortie du modèle sont calculées comme indiqué :

| Format de fichier | Unité de page calculée | Nombre total de pages |

|---|---|---|

| Images (JPEG/JPG, PNG, BMP, HEIF) | Chaque image = 1 unité de page | Nombre total d'images |

| Chaque page du PDF = 1 unité de page | Nombre total de pages dans le fichier PDF | |

| TIFF | Chaque image dans le fichier TIFF = 1 unité de page | Nombre total d’images dans le fichier TIFF |

| Word (DOCX) | Jusqu’à 3 000 caractères = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de pages allant jusqu’à 3 000 caractères chacune |

| Excel (XLSX) | Chaque feuille de calcul = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de feuilles de calcul |

| PowerPoint (PPTX) | Chaque diapositive = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de diapositives |

| HTML | Jusqu’à 3 000 caractères = 1 unité de page, images incorporées ou liées non prises en charge | Nombre total de pages allant jusqu’à 3 000 caractères chacune |

"pages": [

{

"pageNumber": 1,

"angle": 0,

"width": 915,

"height": 1190,

"unit": "pixel",

"words": [],

"lines": [],

"spans": []

}

]

# Analyze pages.

for page in result.pages:

print(f"----Analyzing document from page #{page.page_number}----")

print(

f"Page has width: {page.width} and height: {page.height}, measured with unit: {page.unit}"

)

Sélectionner des pages pour l’extraction de texte

Pour les documents PDF volumineux comportant plusieurs pages, utilisez le paramètre de requête pages pour indiquer des numéros de page ou des plages de pages spécifiques pour l’extraction de texte.

Paragraphes

Le modèle OCR Read de Document Intelligence extrait tous les blocs de texte identifiés dans la collection paragraphs en tant qu’objet de premier niveau sous analyzeResults. Chaque entrée de cette collection représente un bloc de texte et inclut le texte extrait sous la forme content et les coordonnées polygon limitrophes. Les informations de span pointent vers le fragment de texte de la propriété content de premier niveau contenant le texte intégral du document.

"paragraphs": [

{

"spans": [],

"boundingRegions": [],

"content": "While healthcare is still in the early stages of its Al journey, we are seeing pharmaceutical and other life sciences organizations making major investments in Al and related technologies.\" TOM LAWRY | National Director for Al, Health and Life Sciences | Microsoft"

}

]

Texte, lignes et mots

Le modèle OCR Read extrait le texte imprimé et manuscrit sous forme de lines et de words. Le modèle génère des coordonnées englobantes polygon et confidence pour les mots extraits. La collection styles inclut tout style manuscrit pour les lignes détectées, ainsi que les étendues pointant vers le texte associé. Cette fonctionnalité s’applique aux langues manuscrites prises en charge.

Pour Microsoft Word, Excel, PowerPoint et HTML, le modèle Read d’Intelligence documentaire version 3.1 et versions ultérieures extrait tout le texte incorporé tel quel. Les textes sont extraits sous forme de mots et de paragraphes. Les images incorporées ne sont pas prises en charge.

"words": [

{

"content": "While",

"polygon": [],

"confidence": 0.997,

"span": {}

},

],

"lines": [

{

"content": "While healthcare is still in the early stages of its Al journey, we",

"polygon": [],

"spans": [],

}

]

# Analyze lines.

for line_idx, line in enumerate(page.lines):

words = line.get_words()

print(

f"...Line # {line_idx} has {len(words)} words and text '{line.content}' within bounding polygon '{format_polygon(line.polygon)}'"

)

# Analyze words.

for word in words:

print(

f"......Word '{word.content}' has a confidence of {word.confidence}"

)

Style manuscrit des lignes de texte

La réponse inclut le classement de chaque ligne de texte selon qu’elle est de style manuscrit ou non, avec un score de confiance. Pour plus d’informations, consultezles langues prises en charge par LUIS. L’exemple suivant montre un exemple d’extrait JSON.

"styles": [

{

"confidence": 0.95,

"spans": [

{

"offset": 509,

"length": 24

}

"isHandwritten": true

]

}

Si vous avez activé la fonctionnalité de complément de police/style, vous obtenez également le résultat de police/style dans le cadre de l’objet styles.

Étapes suivantes

Suivez un guide de démarrage rapide Document Intelligence :

Découvrir notre API REST :

Découvrez plus d’exemples sur GitHub :