Modelos compatibles con el servicio agente de Azure AI

Los agentes están impulsados por un amplio conjunto de modelos con diferentes funcionalidades y puntos de precio. La disponibilidad de los modelos varía según la región y la nube. Algunas herramientas y funcionalidades requieren los modelos más recientes. Los siguientes modelos están disponibles en los SDK disponibles. La tabla siguiente es para pago por uso. Para obtener información sobre la disponibilidad de la unidad de procesamiento aprovisionada (PTU), consulte rendimiento aprovisionado en la documentación de Azure OpenAI. Puede usar modelos estándar globales si se admiten en las regiones que se enumeran aquí.

Modelos de Azure OpenAI

El servicio agente de Azure AI admite los mismos modelos que la API de finalizaciones de chat en Azure OpenAI, en las siguientes regiones.

| Región | gpt-4o, 2024-05-13 | gpt-4o, 2024-08-06 | gpt-4o-mini, 2024-07-18 | gpt-4, 0613 | gpt-4, 1106-Preview | gpt-4, 0125-Preview | gpt-4, turbo-2024-04-09 | gpt-4-32k, 0613 | gpt-35-turbo, 0613 | gpt-35-turbo, 1106 | gpt-35-turbo, 0125 | gpt-35-turbo-16k, 0613 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| australiaeast | - | - | - | ✅ | ✅ | - | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| estado | ✅ | ✅ | ✅ | - | - | ✅ | ✅ | - | ✅ | - | ✅ | ✅ |

| eastus2 | ✅ | ✅ | ✅ | - | ✅ | - | ✅ | - | ✅ | - | ✅ | ✅ |

| francecentral | - | - | - | ✅ | ✅ | - | - | ✅ | ✅ | ✅ | - | ✅ |

| japaneast | - | - | - | - | - | - | - | - | ✅ | - | ✅ | ✅ |

| norwayeast | - | - | - | - | ✅ | - | - | - | - | - | - | - |

| southindia | - | - | - | - | ✅ | - | - | - | - | ✅ | ✅ | - |

| suecia central | ✅ | ✅ | ✅ | ✅ | ✅ | - | ✅ | ✅ | ✅ | ✅ | - | ✅ |

| uksouth | - | - | - | - | ✅ | ✅ | - | - | ✅ | ✅ | ✅ | ✅ |

| westus | ✅ | ✅ | ✅ | - | ✅ | - | ✅ | - | - | ✅ | ✅ | - |

| westus3 | ✅ | ✅ | ✅ | - | ✅ | - | ✅ | - | - | - | ✅ | - |

Más modelos

El servicio agente de Azure AI también admite los siguientes modelos del catálogo de modelo de Azure AI Foundry.

- Meta-Llama-405B-Instruct

- Mistral-large-2407

- Cohere-command-r-plus

- Cohere-command-r

Para usar estos modelos, puede usar el portal de Azure AI Foundry para realizar una implementación y, a continuación, hacer referencia a él en el agente.

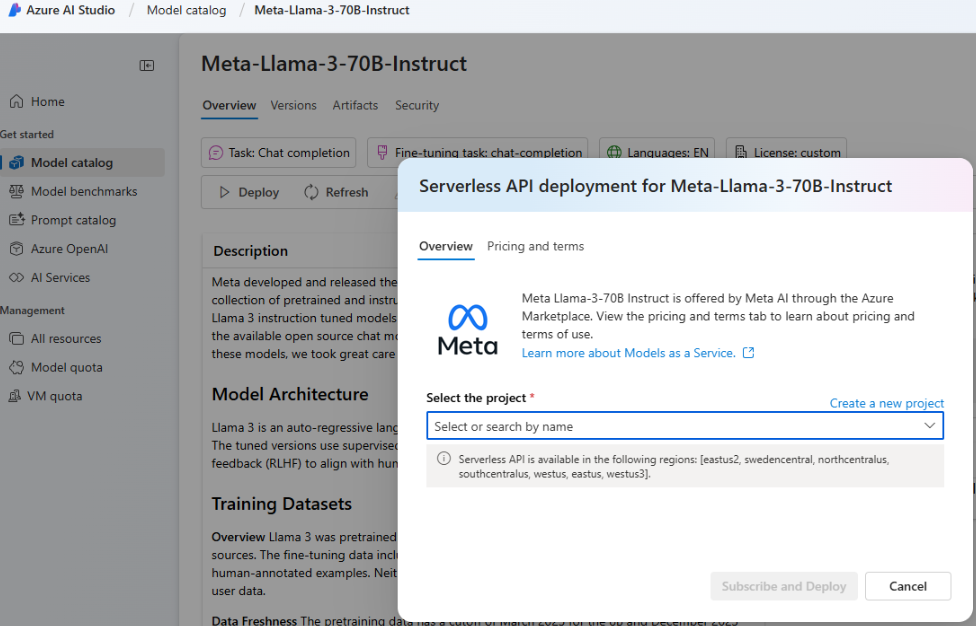

Vaya al portal de Azure AI Foundry y seleccione Catálogo de modelo en el menú de navegación izquierdo y desplácese hacia abajo hasta Meta-Llama-3-70B-Instruct. También puede encontrar y usar uno de los modelos enumerados anteriormente.

Seleccione Implementar.

En la pantalla Opciones de implementación que aparece, seleccione API sin servidor con Seguridad del contenido de Azure AI.

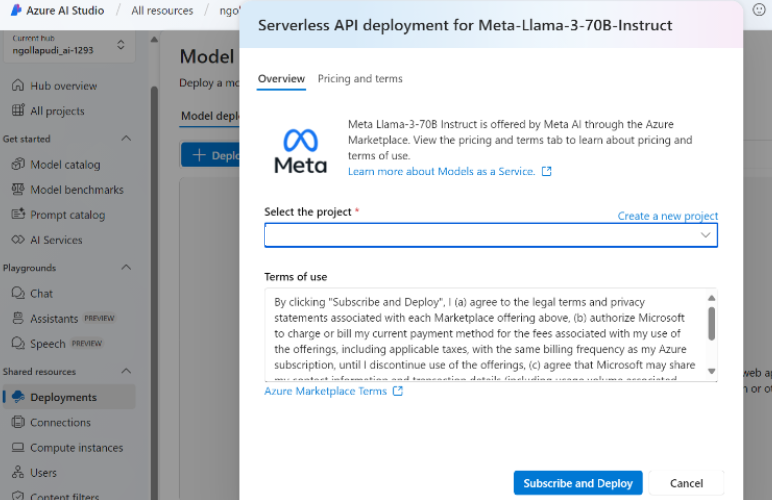

Seleccione el proyecto y, a continuación, seleccione Suscribir e implementar.

Agregue la conexión sin servidor al centro o proyecto. El nombre de implementación que elija será el que utilice como referencia en el código.

Al llamar a la API de creación del agente, establezca el parámetro

modelsen el nombre de la implementación. Por ejemplo: