Semantische Suche und Identifikation

Automatische Anmerkungen sind heutzutage in der gesamten Automobilbranche in der Regel ein halbautomatischer Prozess. Voraussetzung für diesen Prozess ist das Durchlaufenlassen von Video- oder Bildmaterial durch Dienste, die automatisch versuchen, in den Bildern oder Frames Objekte wie Verkehrszeichen oder Szenenbeschreibungen, beispielsweise das Überholen eines Fahrzeugs, zu erkennen. Die Objekte sind von entscheidender Bedeutung für die Identifizierung relevanter Szenarien für das Training und die Validierung des autonomen Wahrnehmungsstapels. Aufgrund dieser verschiedenen Faktoren wird der gesamte Prozess schwerfällig.

Um den Prozess zu verbessern, ist eine Grundlage für die Datenverwaltung wichtig, wie sie z. B. in der DataOps-Referenzarchitektur beschrieben ist. Diese Grundlage ermöglicht die Indizierung, Kommentierung, Suche und Auswahl relevanter Datensets für das Trainieren der Modelle für das maschinelle Sehen, die für autonomes Fahren erforderlich sind. Die Vektorsuche und Einbettungen können bei der Identifizierung relevanter Szenen und Szenarien helfen, die für die nachgelagerten Lern- und Validierungsprozesse mit Anmerkungen versehen werden. Sie können manuelle Überprüfungen durchführen und den Schwerpunkt der Prozesse auf Workloads für wichtige Szenen legen.

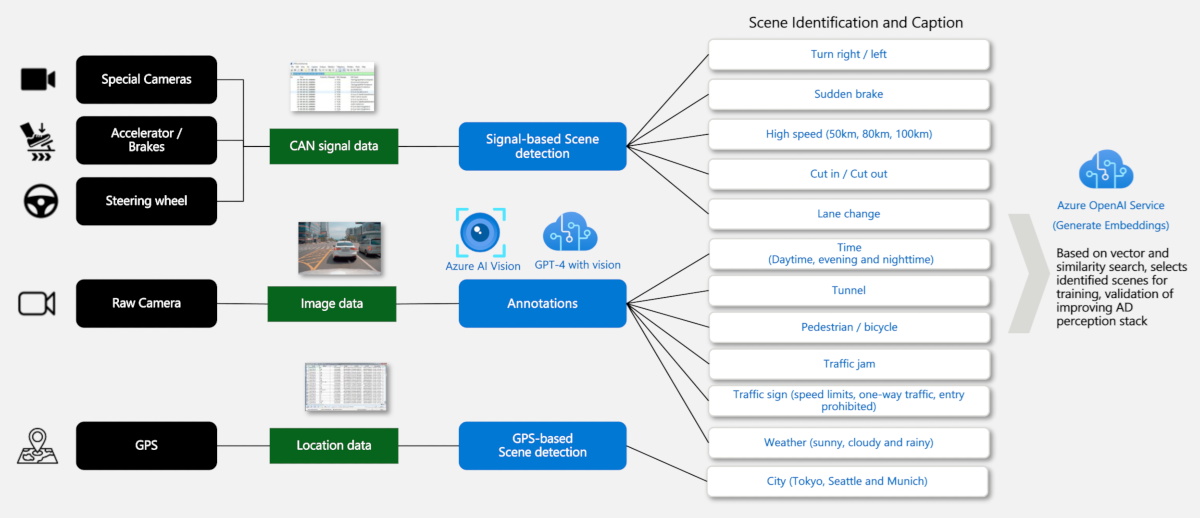

Im folgenden Diagramm wird der Workflow zur Unterstützung dieses Szenarios dargestellt:

Der Workflow beginnt mit realen Aufzeichnungen aus Fahrzeugen. Die Aufzeichnungen helfen außerdem dabei, aus identifizierten Szenen später synthetische Szenarien abzuleiten. Der Dienst Azure KI Vision versieht die Aufzeichnungen automatisch mit Anmerkungen zum Erkennen von Objekten und erlangt ein Verständnis der aufgezeichneten Frames für Kamera und Bilder.

Das Fahrzeug und speziell ausgestattete Kameras liefern bereits heute Informationen z. B. zum Spurwechsel.

Verschiedene Signalströme wie Kamera, CAN-Telemetrie und Standorte werden zusammengeführt, um Szenen zu identifizieren und zu erfassen und ein Verständnis der enthaltenen Objekte zu erlangen. So haben wir uns beispielsweise mit Tata Consultancy Services zusammengeschlossen, um die vom Dienst Azure KI Vision generierten automatischen Anmerkungen mit CAN-basierter Szenenerkennung zu verbessern, siehe Intelligente und nachhaltige Fahrzeuge zum Leben erwecken.

Der Dienst Azure OpenAI erhält Informationen zur Generierung von Einbettungen in Vorbereitung für die semantische und vektorbasierte Suche in Szenen. Beim Generieren einer Einbettung wird Text in einen dichten Vektor aus Fließkommazahlen umgewandelt, der eine Datendarstellung für Modelle für maschinelles Lernen und Algorithmen abbilden, die leicht genutzt werden kann. Ausführliche Informationen finden Sie unter Einbettungen mit Azure OpenAI generieren.

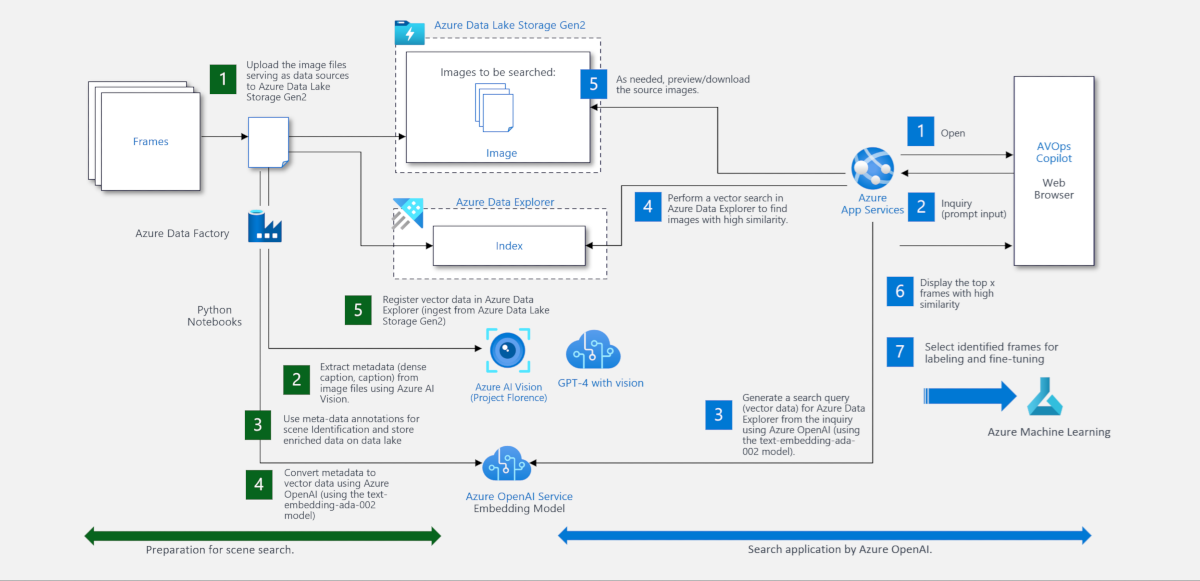

Im folgenden Diagramm wird die technische Architektur unter Verwendung der Microsoft AI-Dienste abgebildet:

Sie können die Suche in Szenen unter Einbeziehung von mit Anmerkungen versehenen Ergebnissen beispielsweise mithilfe eines Notebooks durchführen oder sie in benutzerdefinierte UI-Webtools oder Copilot für AD-Entwickler integrieren, um relevante Szenen auszuwählen und zu extrahieren.