Modellkatalog und Sammlungen

Der Modellkatalog in Azure Machine Learning Studio ist der Hub, über den Sie eine Vielzahl von Modellen entdecken und verwenden können, mit denen Sie generative KI-Anwendungen erstellen können. Der Modellkatalog enthält Hunderte von Modellen von Modellanbietern wie Azure OpenAI Service, Mistral, Meta, Cohere, NVIDIA und Hugging Face, darunter auch Modelle, die von Microsoft trainiert wurden. Modelle von anderen Anbietern als Microsoft sind Nicht-Microsoft-Produkte, wie in den Produktbedingungen von Microsoft definiert und unterliegen den mit dem Modell gelieferten Geschäftsbedingungen.

Modellsammlungen

Modelle werden im Modellkatalog in Sammlungen organisiert. Im Modellkatalog gibt es drei Arten von Sammlungen:

- Von Azure KI kuratierte Modelle: Die beliebtesten Modelle mit offener Gewichtung und die proprietären Modelle von Drittanbietern, gepackt und optimiert für den nahtlosen Einsatz auf der Azure KI-Plattform. Die Verwendung dieser Modelle unterliegt den Lizenzbedingungen des Modellanbieters, die mit dem Modell geliefert werden. Bei der Bereitstellung in Azure Machine Learning unterliegt die Verfügbarkeit des Modells der entsprechenden Azure-SLA, und Microsoft bietet Support für Bereitstellungsprobleme. Modelle von Partnern wie Meta, NVIDIA oder Mistral AI sind Beispiele für Modelle, die in der Sammlung „Kuratiert von Azure KI“ im Katalog zur Verfügung stehen. Diese Modelle können durch ein grünes Häkchen auf den Modellkacheln im Katalog identifiziert werden, oder Sie können nach der Sammlung „Kuratiert von Azure KI“ filtern.

- Azure OpenAI-Modelle, exklusiv verfügbar auf Azure: Azure OpenAI-Vorzeigemodelle über die Sammlung „Azure OpenAI“ durch eine Integration mit dem Azure OpenAI Service. Diese Modelle werden von Microsoft unterstützt, und ihre Verwendung unterliegt den Produktbedingungen und der SLA für Azure OpenAI Service.

- Offene Modelle aus dem Hugging Face-Hub: Hunderte von Modellen aus dem Hugging Face-Hub sind über die Sammlung „Hugging Face“ für Echtzeitrückschluss mit Online-Endpunkten zugänglich. Hugging Face erstellt und unterhält Modelle, die in der Hugging Face-Sammlung aufgelistet sind. Verwenden Sie das HuggingFace-Forum oder den HuggingFace-Support, um Hilfe zu erhalten. Erfahren Sie mehr darüber, wie Sie Modelle von Hugging Face bereitstellen.

Vorschlagen von Ergänzungen zum Modellkatalog: Mithilfe dieses Formulars können Sie das Hinzufügen eines Modells zum Modellkatalog beantragen.

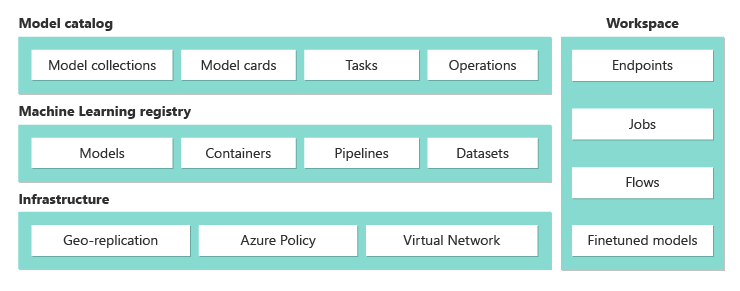

Übersicht über die Funktionen des Modellkatalogs

Informationen zu Azure OpenAI-Modellen finden Sie unter Azure OpenAI Service.

Einige der Modelle in den Sammlungen Kuratiert von Azure KI und Offene Modelle aus dem Hugging Face Hub können mit einer verwalteten Computeoption bereitgestellt werden, andere mit serverlosen APIs mit nutzungsbasierter Bezahlung. Diese Modelle können entdeckt, verglichen, ausgewertet, verfeinert (wenn unterstützt) und im großen Stil bereitgestellt und in Ihre generativen KI-Anwendungen mit Sicherheits- und Datengovernance auf Unternehmensniveau integriert werden.

- Entdecken: Überprüfen Sie Modellkarten, testen Sie Stichprobenrückschlüsse und durchsuchen Sie Codebeispiele, um das Modell auszuwerten, zu verfeinern oder bereitzustellen.

- Vergleichen: Vergleichen Sie Benchmarks zwischen den in der Branche verfügbaren Modellen und Datasets, um zu beurteilen, welches Modell Ihrem Geschäftsszenario entspricht.

- Auswerten: Werten Sie aus, ob das Modell für Ihre bestimmte Workload geeignet ist, indem Sie Ihre eigenen Testdaten bereitstellen. Auswertungsmetriken gestalten die Visualisierung einfach, wie gut das ausgewählte Modell in Ihrem Szenario funktioniert hat.

- Verfeinern: Passen Sie optimierbare Modelle mit Ihren eigenen Trainingsdaten an, und wählen Sie das beste Modell aus, indem Sie Metriken aus all Ihren Feinabstimmungsaufträgen vergleichen. Integrierte Optimierungen beschleunigen die Feinabstimmung und reduzieren den für die Feinabstimmung benötigten Arbeitsspeicher und die Compute-Ressourcen.

- Bereitstellen: Nahtloses Bereitstellen von vortrainierten oder verfeinerten Modellen für den Rückschluss. Modelle, die mit verwalteten Computeressourcen bereitgestellt werden können, können auch heruntergeladen werden.

Modellbereitstellung: Verwaltete Computeressourcen und serverlose API (nutzungsbasierte Bezahlung)

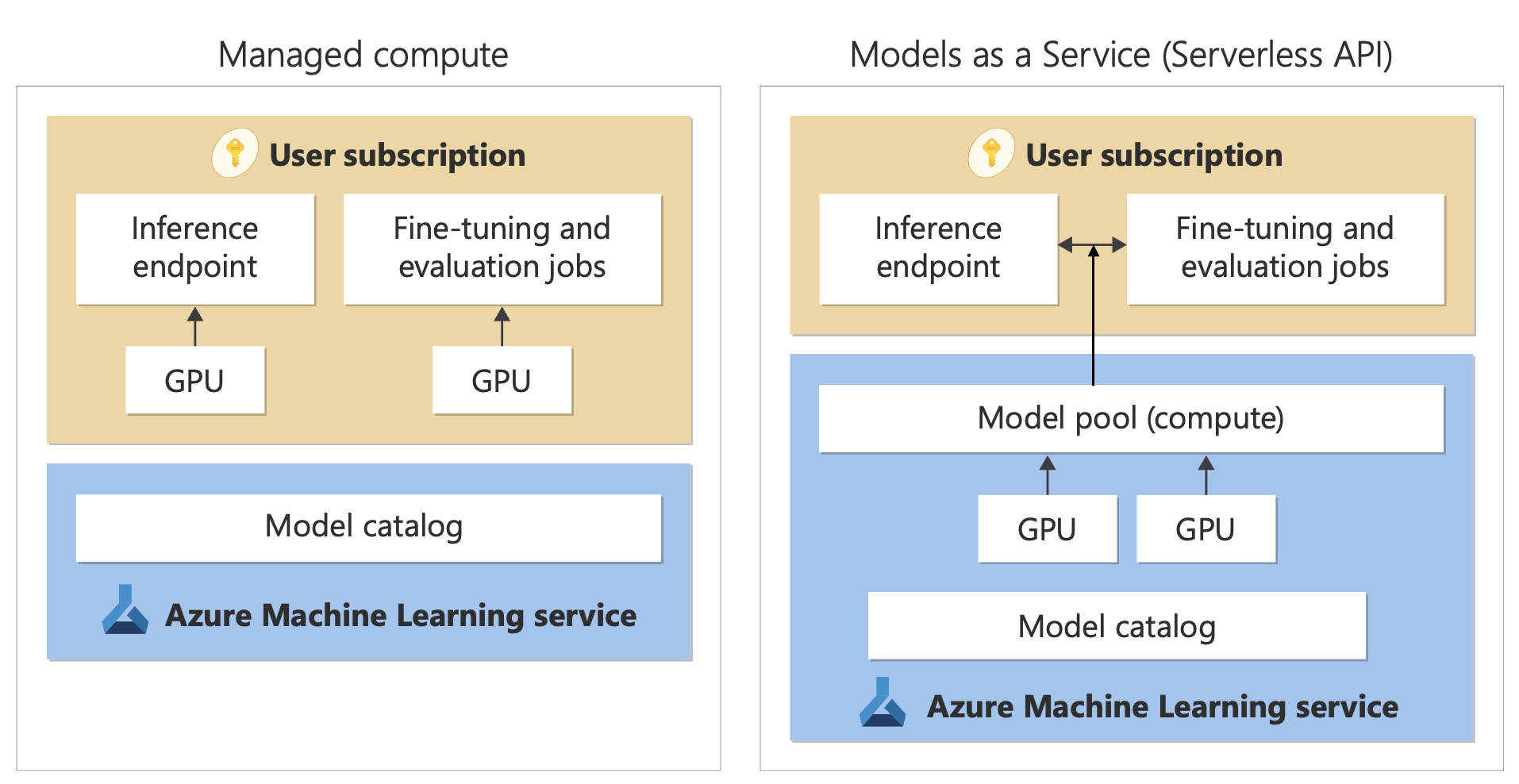

Der Modellkatalog bietet zwei unterschiedliche Möglichkeiten zum Bereitstellen von Modellen aus dem Katalog für Ihre Verwendung: verwaltete Computeressourcen und serverlose APIs. Die für jedes Modell verfügbaren Bereitstellungsoptionen variieren. Erfahren Sie in den folgenden Tabellen mehr über die Features der Bereitstellungsoptionen und die Optionen, die für bestimmte Modelle verfügbar sind. Erfahren Sie mehr über die Datenverarbeitung mit den Bereitstellungsoptionen.

| Features | Verwaltete Computeressourcen | Serverlose API (nutzungsbasierte Bezahlung) |

|---|---|---|

| Bereitstellungserfahrung und Abrechnung | Modellgewichtungen werden für dedizierte VMs mit verwalteten Onlineendpunkten bereitgestellt. Der verwaltete Onlineendpunkt, der über eine oder mehrere Bereitstellungen verfügen kann, stellt eine REST-API für den Rückschluss zur Verfügung. Ihnen werden die VM-Kernstunden in Rechnung gestellt, die von den Bereitstellungen verbraucht werden. | Der Zugriff auf Modelle erfolgt über eine Bereitstellung, die eine API für den Zugriff auf das Modell bereitstellt. Die API bietet Zugriff auf das Modell, das für den Rückschluss in einem zentralen GPU-Pool gehostet wird, der von Microsoft verwaltet wird. Dieser Zugriffsmodus wird als „Modelle als ein Dienst“ bezeichnet. Sie werden für Eingaben und Ausgaben an die APIs in Rechnung gestellt, in der Regel in Token. Preisinformationen werden vor der Bereitstellung bereitgestellt. |

| API-Authentifizierung | Schlüssel und Microsoft Entra ID-Authentifizierung. Weitere Informationen | Nur Schlüssel. |

| Inhaltssicherheit | Verwenden Sie APIs des Azure-Inhaltssicherheitsdiensts. | Azure KI Inhaltssicherheit-Filter sind integriert mit Rückschluss-APIs verfügbar. Azure KI Inhaltssicherheit-Filter können separat abgerechnet werden. |

| Netzwerkisolation | Verwaltetes virtuelles Netzwerk mit Onlineendpunkten. Weitere Informationen |

Bereitstellungsoptionen

| Modell | Verwaltete Computeressourcen | Serverlose API (nutzungsbasierte Bezahlung) |

|---|---|---|

| Modelle der Llama-Familie | Llama-3.3-70B-Instruct Llama-2-7b Llama-2-7b-chat Llama-2-13b Llama-2-13b-chat Llama-2-70b Llama-2-70b-chat Llama-3-8B-Instruct Llama-3-70B-Instruct Llama-3-8B Llama-3-70B |

Llama-3.3-70B-Instruct Llama-3-70B-Instruct Llama-3-8B-Instruct Llama-2-7b Llama-2-7b-chat Llama-2-13b Llama-2-13b-chat Llama-2-70b Llama-2-70b-chat |

| Modelle der Mistral-Familie | mistralai-Mixtral-8x22B-v0-1 mistralai-Mixtral-8x22B-Instruct-v0-1 mistral-community-Mixtral-8x22B-v0-1 mistralai-Mixtral-8x7B-v01 mistralai-Mistral-7B-Instruct-v0-2 mistralai-Mistral-7B-v01 mistralai-Mixtral-8x7B-Instruct-v01 mistralai-Mistral-7B-Instruct-v01 |

Mistral Large (2402) Mistral Large (2407) Mistral-small Ministral-3B Mistral-Nemo |

| Modelle der Cohere-Familie | Nicht verfügbar | Cohere-command-r-plus-08-2024 Cohere-command-r-08-2024 Cohere-command-r-plus Cohere-command-r Cohere-embed-v3-english Cohere-embed-v3-multilingual Cohere-rerank-v3-english Cohere-rerank-v3-multilingual |

| JAIS | Nicht verfügbar | jais-30b-chat |

| Modelle der Phi-3-Familie | Phi-3-mini-4k-Instruct Phi-3-mini-128k-Instruct Phi-3-small-8k-Instruct Phi-3-small-128k-Instruct Phi-3-medium-4k-instruct Phi-3-medium-128k-instruct Phi-3-vision-128k-Instruct Phi-3.5-mini-Instruct Phi-3.5-vision-Instruct Phi-3.5-MoE-Instruct |

Phi-3-mini-4k-Instruct Phi-3-mini-128k-Instruct Phi-3-small-8k-Instruct Phi-3-small-128k-Instruct Phi-3-medium-4k-instruct Phi-3-medium-128k-instruct Phi-3.5-mini-Instruct Phi-3.5-vision-Instruct Phi-3.5-MoE-Instruct |

| Nixtla | Nicht verfügbar | TimeGEN-1 |

| Andere Modelle | Verfügbar | Nicht verfügbar |

Verwaltete Computeressourcen

Die Funktion zum Bereitstellen von Modellen mit verwalteten Computeressourcen baut auf Plattformfunktionen von Azure Machine Learning auf, um im gesamten GenAIOps-Lebenszyklus (auch als LLMOps bezeichnet) eine nahtlose Integration der umfangreichen Sammlung von Modellen im Modellkatalog zu ermöglichen.

Wie werden Modelle für verwaltete Computeressourcen zur Verfügung gestellt?

Die Modelle werden über Azure Machine Learning-Registrierungen verfügbar gemacht, die den ML-orientierten Ansatz für das Hosten und Verteilen von Machine Learning-Ressourcen ermöglichen. Dazu gehören Modellgewichtungen, Container-Runtimes für die Ausführung der Modelle sowie Pipelines zur Auswertung und Feinabstimmung der Modelle und DataSets für Benchmarks und Beispiele. Diese ML-Registrierungen bauen auf einer hoch skalierbaren und unternehmensfähigen Infrastruktur auf, die Folgendes bietet:

Liefert Modellartefakte für den Zugriff mit geringer Wartezeit für alle Azure-Regionen mit integrierter Georeplikation.

Unterstützt Unternehmenssicherheitsanforderungen wie Zugriff auf Modelle mit Azure Policy einschränken und sichere Bereitstellung mit verwalteten virtuellen Netzwerken.

Bewertung und Feinabstimmung von Modellen, die mit verwalteten Computeressourcen bereitgestellt werden

Sie können die Modelle in der Sammlung „Kuratiert von Azure KI“ in Azure Machine Learning mithilfe von Azure Machine Learning-Pipelines bewerten und eine Feinabstimmung dafür vornehmen. Sie können entweder Ihren eigenen Auswertungs- und Feinabstimmungscode bringen und einfach auf Modellgewichtungen zugreifen, oder Azure Machine Learning-Komponenten verwenden, die integrierte Auswertungs- und Feinabstimmungsfunktionen bieten. Für weitere Informationen folgen Sie diesem Link.

Bereitstellen von Modellen für Rückschlüsse mit verwalteten Computeressourcen

Modelle, die für die Bereitstellung mit verwalteten Computeressourcen zur Verfügung stehen, können auf Azure Machine Learning-Onlineendpunkten für Echtzeitrückschlüsse bereitgestellt oder für Azure Machine Learning-Batchrückschlüsse für die Batchverarbeitung Ihrer Daten verwendet werden. Für die Bereitstellung mit verwalteten Computeressourcen müssen Sie über eine Quote für virtuelle Maschinen in Ihrem Azure-Abonnement für genau die SKUs verfügen, die für die optimale Ausführung des Modells erforderlich sind. Einige Modelle ermöglichen Ihnen die Bereitstellung im vorübergehend freigegebenen Kontingent zum Testen des Modells. Weitere Informationen zum Bereitstellen von Modellen:

- Bereitstellen von Meta-Llama-Modellen

- Bereitstellen von offenen Modellen, die von Azure KI erstellt wurden

- Bereitstellen von Hugging Face-Modellen

Erstellen von generativen KI-Apps mit verwalteten Computeressourcen

Prompt Flow bietet Funktionen zum Erstellen, Experimentieren, Durchlaufen und Bereitstellen Ihrer KI-Anwendungen. Modelle, die mit verwalteten Computeressourcen bereitgestellt werden, können Sie mit dem Open Model LLM-Tool in Prompt Flow verwenden. Sie können auch die REST-API verwenden, die von den verwalteten Computeressourcen in beliebten LLM-Tools wie LangChain mit der Azure Machine Learning-Erweiterung verfügbar gemacht wird.

Inhaltssicherheit für mit verwalteten Computeressourcen bereitgestellte Modelle

Der Dienst Azure KI Inhaltssicherheit (Azure AI Content Safety, AACS) kann mit Modellen, die mit verwalteten Computeressourcen bereitgestellt werden, verwendet werden, um eine Überprüfung auf verschiedene Kategorien schädlicher Inhalte wie sexuellen Inhalten, Gewalt, Hass und Selbstverletzung sowie auf komplexe Bedrohungen, beispielsweise durch die Erkennung von Jailbreak-Risiken und die Erkennung von geschütztem Materialtext, durchzuführen. Sie können für die Referenzintegration mit AACS für Llama 2 auf dieses Notebook verweisen, oder das Tool für die Inhaltssicherheit (Text) in Prompt Flow verwenden, um Antworten vom Modell an AACS zur Überprüfung zu übergeben. Diese Nutzung wird Ihnen gemäß den AACS-Preisen separat in Rechnung gestellt.

Arbeiten mit Modellen, die nicht im Modellkatalog enthalten sind

Für Modelle, die nicht im Modellkatalog verfügbar sind, bietet Azure Machine Learning eine offene und erweiterbare Plattform für das Arbeiten mit Modellen Ihrer Wahl. Sie können ein Modell mit jedem Framework oder jeder Runtime bereitstellen, indem Sie die Funktionen der offenen und erweiterbaren Plattform von Azure Machine Learning nutzen, z. B. Azure Machine Learning-Umgebungen für Container, die Frameworks und Runtimes packen können, und Azure Machine Learning-Pipelines für Code, um die Modelle zu bewerten oder Feinabstimmungen dafür vorzunehmen. In diesem Notizbuch finden Sie Beispielreferenzen zum Importieren von Modellen und zum Arbeiten mit den integrierten Runtimes und Pipelines.

Serverlose APIs mit nutzungsbasierter Bezahlung

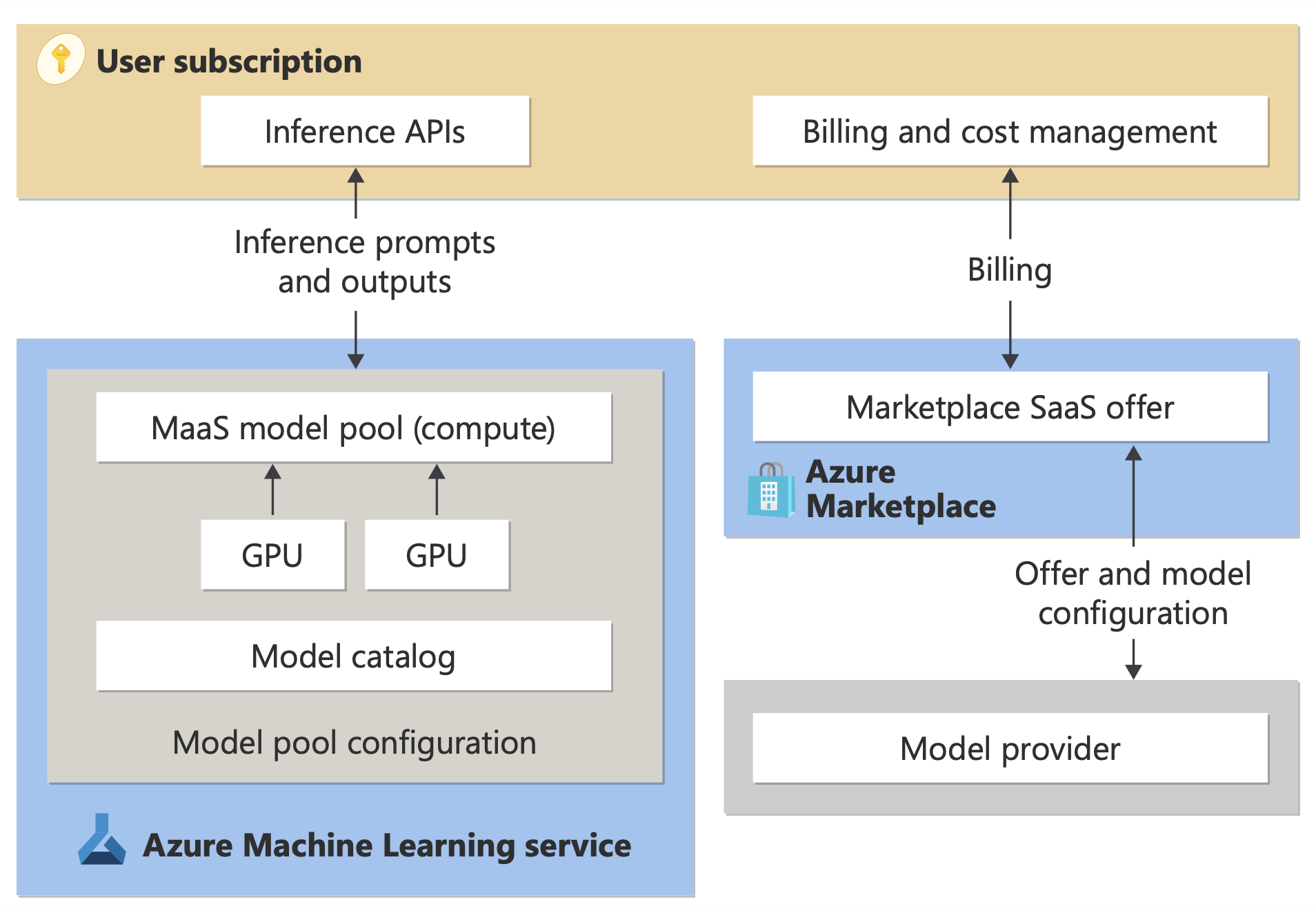

Bestimmte Modelle im Modellkatalog können mit serverlosen APIs mit nutzungsbasierter Bezahlung bereitgestellt werden. Diese Bereitstellungsmethode wird als „Models-as-a-Service“ (MaaS) bezeichnet. Modelle, die über MaaS verfügbar sind, werden in von Microsoft verwalteter Infrastruktur gehostet, wodurch API-basierter Zugriff auf das Modell des Modellanbieters ermöglicht wird. Der API-basierte Zugriff kann die Kosten für den Zugriff auf ein Modell dramatisch reduzieren und die Bereitstellungserfahrung erheblich vereinfachen. Die meisten MaaS-Modelle verfügen über tokenbasierte Preise.

Wie werden Drittanbietermodelle in MaaS verfügbar gemacht?

Modelle, die für die Bereitstellung als serverlose APIs mit nutzungsbasierter Abrechnung verfügbar sind, werden vom Modellanbieter angeboten, aber in der von Microsoft verwalteten Azure-Infrastruktur gehostet und über eine API zugänglich gemacht. Modellanbieter definieren die Lizenzbedingungen und legen den Preis für die Verwendung ihrer Modelle fest, während Azure Machine Learning Service die Hostinginfrastruktur verwaltet, die Rückschluss-APIs verfügbar macht und als Datenverarbeiter für übermittelte Prompts und Inhaltsausgaben von über MaaS bereitgestellten Modellen fungiert. Weitere Informationen zur Datenverarbeitung für MaaS finden Sie im Artikel Datenschutz.

Bezahlen des Modellverbrauchs in MaaS

Die Erfahrung für Ermittlung, Abonnement und Verbrauch für Modelle, die über MaaS bereitgestellt werden, befindet sich im Azure KI Foundry-Portal und im Azure Machine Learning Studio. Benutzer akzeptieren Lizenzbedingungen für die Verwendung der Modelle, und Preisinformationen für den Verbrauch werden während der Bereitstellung bereitgestellt. Modelle von Drittanbietern werden über Azure Marketplace gemäß den Nutzungsbedingungen des Commercial Marketplace in Rechnung gestellt. Modelle von Microsoft werden mit Azure-Verbrauchseinheiten als Erstanbieter-Verbrauchsdienste in Rechnung gestellt. Wie in den Produktbedingungen beschrieben, werden Erstanbieter-Verbrauchsdienste mit Azure-Verbrauchseinheiten erworben, unterliegen jedoch nicht den Azure-Dienstbedingungen. Die Verwendung dieser Modelle unterliegt den bereitgestellten Lizenzbedingungen.

Bereitstellen von Modellen für en Rückschluss über MaaS

Durch die Bereitstellung eines Modells über MaaS können Benutzer Zugriff auf die Verwendung von Rückschluss-APIs erhalten, ohne dass Infrastruktur konfiguriert oder GPUs bereitgestellt werden müssen, was Entwicklungszeit und Ressourcen spart. Diese APIs können in mehrere LLM-Tools integriert werden, und der Verbrauch wird wie im vorherigen Abschnitt beschrieben abgerechnet.

Verfeinern von Modellen durch MaaS mit nutzungsbasierter Bezahlung

Für Modelle, die über MaaS verfügbar sind und die Feinabstimmung unterstützen, können Benutzer die Hosting-Feinabstimmung mit Abrechnung über nutzungsbasierte Bezahlung nutzen, um die Modelle mithilfe von Daten anzupassen, die sie bereitstellen. Weitere Informationen finden Sie unter Verfeinern eines Llama 2-Modells im Azure KI Foundry-Portal.

RAG mit Modellen, die über MaaS bereitgestellt werden

Azure KI Foundry ermöglicht Benutzern die Verwendung von Vektorindizes und Retrieval Augmented Generation. Modelle, die mit serverlosen APIs bereitgestellt werden können, können verwendet werden, um Einbettungen und Rückschlüsse basierend auf benutzerdefinierten Daten zu generieren, um spezifische Antworten für ihren Anwendungsfall zu generieren. Weitere Informationen finden Sie unter Retrieval Augmented Generation und Indizes.

Regionale Verfügbarkeit von Angeboten und Modellen

Die nutzungsbasierte Bezahlung ist nur für Benutzende verfügbar, deren Azure-Abonnement zu einem Abrechnungskonto in einem Land gehört, in dem der Modellanbieter das Angebot verfügbar gemacht hat. Wenn das Angebot in der relevanten Region verfügbar ist, müssen die Benutzer über einen Hub oder ein Projekt in der Azure-Region verfügen, in der das Modell für die Bereitstellung oder Optimierung verfügbar ist. Ausführliche Informationen finden Sie unter Regionale Verfügbarkeit für Modelle an serverlosen API-Endpunkten.

Inhaltssicherheit für Modelle, die über MaaS bereitgestellt werden

Wichtig

Dieses Feature ist zurzeit als öffentliche Preview verfügbar. Diese Vorschauversion wird ohne Vereinbarung zum Servicelevel bereitgestellt und ist nicht für Produktionsworkloads vorgesehen. Manche Features werden möglicherweise nicht unterstützt oder sind nur eingeschränkt verwendbar.

Weitere Informationen finden Sie unter Zusätzliche Nutzungsbestimmungen für Microsoft Azure-Vorschauen.

Für Sprachmodelle, die über serverlose APIs bereitgestellt werden, implementiert Azure KI eine Standardkonfiguration für Textmoderationsfilter von Azure KI Inhaltssicherheit, welche schädliche Inhalte wie Hass, Selbstverletzung, sexuelle und gewalttätige Inhalte entdecken. Weitere Informationen zur Inhaltsfilterung (Vorschau) finden Sie unter Schadenkategorien in Azure KI Inhaltssicherheit.

Tipp

Die Inhaltsfilterung (Vorschau) ist für bestimmte Modelltypen, die über serverlose APIs bereitgestellt werden, nicht verfügbar. Zu diesen Modelltypen gehören Einbettungsmodelle und Zeitreihenmodelle.

Die Inhaltsfilterung (Vorschau) erfolgt synchron, während der Dienst Prompts zur Generierung von Inhalten verarbeitet. Möglicherweise werden Sie gemäß den Azure KI Inhaltssicherheit-Preisen für diese Verwendung separat in Rechnung gestellt. Sie können die Inhaltsfilterung (Vorschau) für einzelne serverlose Endpunkte deaktivieren, entweder:

- Zum Zeitpunkt der ersten Bereitstellung eines Sprachmodells

- Später, indem Sie den Umschalter für die Inhaltsfilterung auf der Seite mit den Bereitstellungsdetails verwenden

Angenommen, Sie entscheiden sich für die Verwendung einer anderen API als der Azure KI Model Inference-API, um mit einem Modell zu arbeiten, das über eine serverlose API bereitgestellt wird. In einer solchen Situation ist die Inhaltsfilterung (Vorschau) nicht aktiviert, es sei denn, Sie implementieren sie separat mithilfe von Azure KI Inhaltssicherheit.

Erste Schritte mit Azure KI Inhaltssicherheit finden Sie im Schnellstart: Analysieren von Textinhalten. Wenn Sie beim Arbeiten mit Modellen, die über serverlose APIs bereitgestellt werden, keine Inhaltsfilterung (Vorschau) verwenden, besteht ein höheres Risiko, dass Benutzer schädlichen Inhalten ausgesetzt werden.

Netzwerkisolation für Modelle, die über serverlose APIs bereitgestellt werden

Endpunkte für Modelle, die als serverlose APIs bereitgestellt werden, folgen der PNA-Kennzeichnungseinstellung (Public Network Access) des Arbeitsbereichs, in dem die Bereitstellung vorhanden ist. Um Ihren MaaS-Endpunkt zu sichern, deaktivieren Sie das PNA-Flag in Ihrem Arbeitsbereich. Sie können eingehende Kommunikation von einem Client zu Ihrem Endpunkt sichern, indem Sie einen privaten Endpunkt für den Arbeitsbereich verwenden.

So legen Sie das PNA-Flag für den Arbeitsbereich fest:

- Öffnen Sie das Azure-Portal.

- Suchen Sie nach Azure Machine Learning und wählen Sie Ihren Arbeitsbereich aus der Liste der Arbeitsbereiche aus.

- Verwenden Sie auf der Seite „Übersicht“ den linken Navigationsbereich, um zu Einstellungen>Netzwerk zu wechseln.

- Auf der Registerkarte Öffentlicher Zugriff können Sie Einstellungen für das Flag für den Zugriff auf das öffentliche Netzwerk konfigurieren.

- Speichern Sie die Änderungen. Es kann bis zu fünf Minuten dauern, bis Ihre Änderungen verteilt sind.

Begrenzungen

- Wenn Sie einen Arbeitsbereich mit einem privaten Endpunkt haben, der vor dem 11. Juli 2024 erstellt wurde, folgen neue MaaS-Endpunkte, die diesem Arbeitsbereich hinzugefügt wurden, nicht der Netzwerkkonfiguration. Stattdessen müssen Sie einen neuen privaten Endpunkt für den Arbeitsbereich erstellen und neue serverlose API-Bereitstellungen im Arbeitsbereich erstellen, damit die neuen Bereitstellungen der Netzwerkkonfiguration des Arbeitsbereichs folgen können.

- Wenn Sie einen Arbeitsbereich mit MaaS-Bereitstellungen haben, die vor dem 11. Juli 2024 erstellt wurden, und Sie einen privaten Endpunkt in diesem Arbeitsbereich aktivieren, folgen die vorhandenen MaaS-Bereitstellungen nicht der Netzwerkkonfiguration des Arbeitsbereichs. Damit serverlose API-Bereitstellungen im Arbeitsbereich der Konfiguration des Arbeitsbereichs folgen können, müssen Sie die Bereitstellungen erneut erstellen.

- Derzeit ist Unterstützung für Ihre Daten für MaaS-Bereitstellungen in privaten Arbeitsbereichen nicht verfügbar, da private Arbeitsbereiche das PNA-Flag deaktiviert haben.

- Jede Netzwerkkonfigurationsänderung (z. B. das Aktivieren oder Deaktivieren des PNA-Flags) kann bis zu fünf Minuten dauern, bis sie verteilt sind.